Transformer² от Sakana AI — это новый подход, помогающий языковым моделям обучаться

Японская компания Sakana AI представила новый метод Transformer², который помогает языковым моделям адаптироваться к различным задачам. В отличие от традиционных систем AI, которые обучаются один раз для выполнения разных задач, Transformer² предлагает непрерывное обучение [1], что позволяет моделям справляться с неожиданными трудностями.

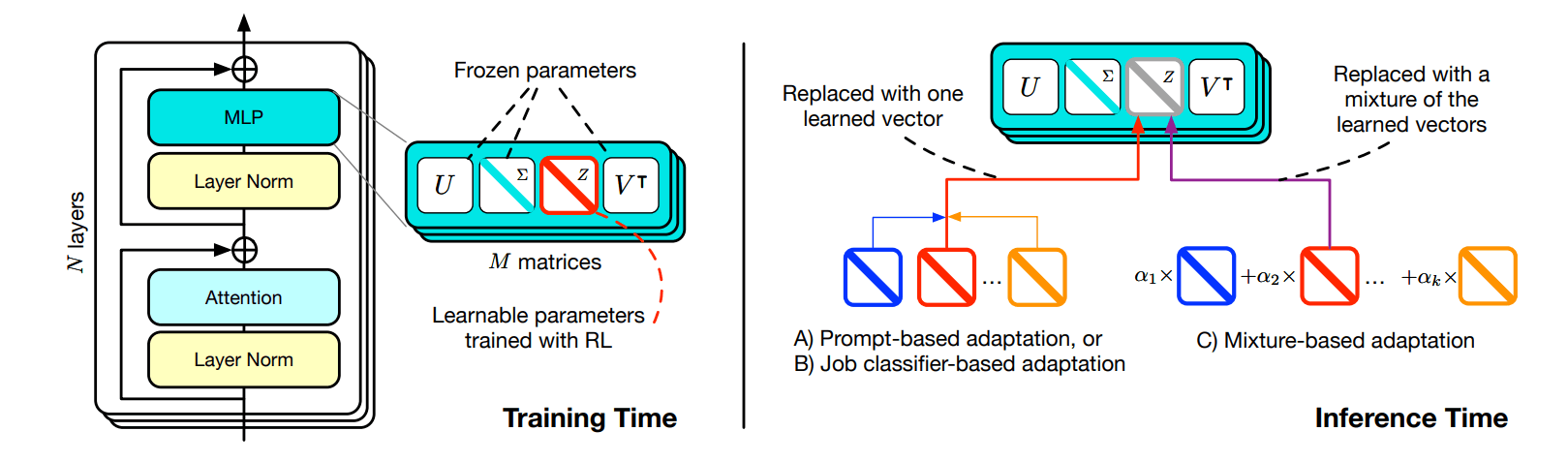

Система использует двухэтапное обучение с помощью “экспертных векторов”, основанных на методе тонкой настройки сингулярных значений (SVF). Эти векторы позволяют моделям специализироваться на конкретных задачах, таких как математика [2] или программирование, без необходимости обновления всех весов сети, что часто приводит к забыванию ранее выученного.

SVF требует меньше параметров по сравнению с альтернативами, такими как LoRA, и помогает модели адаптироваться к новым задачам, сохраняя при этом ранее полученные знания. Обучение с подкреплением [3] используется, чтобы улучшить векторы, позволяя модели предлагать решения и корректировать их на основе обратной связи.

Transformer² предлагает три стратегии для применения экспертных знаний: использование подсказок, классификатор для выбора эксперта и адаптация с помощью нескольких примеров. Последний метод позволяет модели комбинировать векторы экспертов для оптимального решения задач.

При тестировании Transformer² показал значительное улучшение в решении задач по сравнению с LoRA, особенно в математике и программировании. Модель также может делиться векторами знаний между различными моделями, что открывает новые возможности для обмена знаниями.

Однако Transformer² имеет ограничения. Он не может добавлять новые навыки, а только улучшает уже существующие. Также остаётся вопрос о масштабируемости метода для очень больших моделей.

Источник [4]

Автор: mefdayy

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/11394

URLs in this post:

[1] обучение: http://www.braintools.ru/article/5125

[2] математика: http://www.braintools.ru/article/7620

[3] подкреплением: http://www.braintools.ru/article/5528

[4] Источник: https://the-decoder.com/sakana-ais-transformer%C2%B2-is-a-new-approach-to-help-language-models-learn/

[5] Источник: https://habr.com/ru/companies/bothub/news/875324/?utm_source=habrahabr&utm_medium=rss&utm_campaign=875324

Нажмите здесь для печати.