Новая модель искусственного интеллекта Alibaba превосходит DeepSeek-V3

Компания Alibaba разработала новую языковую модель под названием Qwen2.5-Max, которая, по словам компании, использует рекордное количество обучающих данных — более 20 триллионов токенов.

Компания Alibaba представила Qwen2.5-Max — новую языковую AI-модель, обученную на рекордных, по заявлению компании, 20 триллионах токенов данных. Эта модель входит в существующее семейство Qwen2.5 от Alibaba, в которое входят Qwen2.5-VL [1] и Qwen2.5-1M [2].

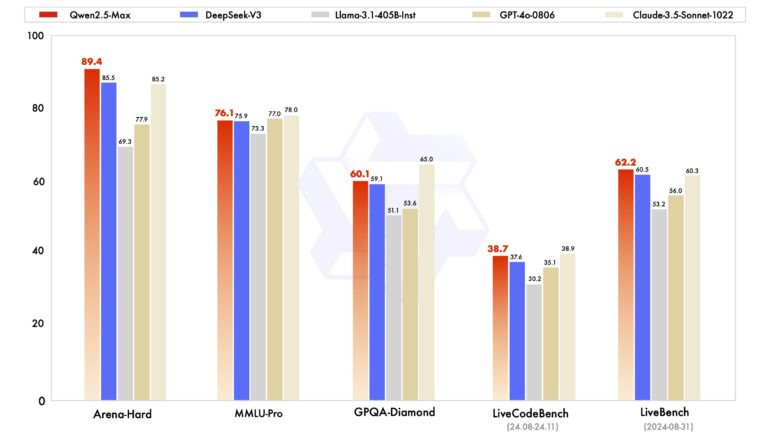

Qwen2.5-Max, созданный с использованием архитектуры «смесь экспертов» (MoE), в тестах на производительность не уступает и превосходит некоторые ведущие AI-модели, такие как Deepseek-V3 [3], GPT-4o [4], Claude 3.5 Sonnet [5] и Llama-3.1-405B [6]. Хотя точный размер обучающих данных некоторых коммерческих конкурентов остаётся конфиденциальным, Deepseek-V3 и Llama-3.1-405B использовали примерно по 15 триллионов токенов.

Модель показывает особенно высокие результаты в тестах Arena-Hard и LiveBench, а в других тестах не уступает конкурентам. Команда Alibaba использовала для разработки модели устоявшиеся методы обучения [7], в том числе контролируемую тонкую настройку и обучение с подкреплением [8] на основе обратной связи от человека.

Теперь пользователи могут получить доступ к Qwen2.5-Max через API Alibaba Cloud или протестировать его в Qwen Chat [9], чат-боте компании, который предлагает такие функции, как поиск в интернете и создание контента. Хотя Alibaba не раскрывает источники своих данных, эксперты предполагают, что синтетические данные, вероятно, играют важную роль.

Несмотря на значительные инвестиции в обучающие данные, преимущество модели в производительности по сравнению с конкурентами остаётся незначительным. Это соответствует недавним обсуждениям в сообществе AI, в ходе которых высказывается предположение, что улучшение вычислительной мощности во время тестирования, а не только размер обучающих данных, может быть ключом к расширению возможностей языковых моделей [10].

В отличие от других моделей в семействе Qwen2.5 [11], версия Max будет доступна только через API и не будет выпущена с открытым исходным кодом. Alibaba предлагает разработчикам конкурентоспособные цены и интерфейс, совместимый с OpenAI, чтобы стимулировать [12] переход на их облачную платформу. Однако, как и другие модели китайского языка, Qwen2.5-Max работает в соответствии с китайскими государственными ограничениями на контент [13].

Источник [14]

Автор: mefdayy

Источник [15]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/11671

URLs in this post:

[1] Qwen2.5-VL: https://the-decoder.com/alibaba-says-its-new-qwen2-5-vl-model-is-a-useful-visual-agent/

[2] Qwen2.5-1M: https://the-decoder.com/alibabas-qwen-releases-open-source-model-that-handles-1-million-input-tokens/

[3] Deepseek-V3: https://the-decoder.com/deepseeks-5-6m-chinese-llm-wonder-shakes-up-the-ai-elite/

[4] GPT-4o: https://the-decoder.com/openais-new-multimodal-gpt-4-omni-combines-text-vision-and-audio-in-a-single-model/

[5] Claude 3.5 Sonnet: https://the-decoder.com/anthropic-launches-claude-3-5-potentially-the-most-capable-ai-model-yet/

[6] Llama-3.1-405B: https://the-decoder.com/meta-takes-on-openais-gpt-4o-with-llama-3-405b-its-largest-open-source-llm-to-date/

[7] обучения: http://www.braintools.ru/article/5125

[8] подкреплением: http://www.braintools.ru/article/5528

[9] Qwen Chat: https://the-decoder.com/alibaba-launches-free-web-interface-qwen-chat-for-qwen-ai-models/

[10] ключом к расширению возможностей языковых моделей: https://the-decoder.com/study-shows-test-time-compute-scaling-is-a-path-to-better-ai-systems/

[11] семействе Qwen2.5: https://the-decoder.com/qwen-2-5-alibabas-new-ai-models-challenge-the-competition/

[12] стимулировать: http://www.braintools.ru/article/5596

[13] китайскими государственными ограничениями на контент: https://the-decoder.com/deepseeks-v3-is-the-latest-example-of-state-controlled-censorship-in-chinese-llms/

[14] Источник: https://the-decoder.com/alibabas-new-ai-model-outperforms-deepseek-v3/

[15] Источник: https://habr.com/ru/companies/bothub/news/877740/?utm_source=habrahabr&utm_medium=rss&utm_campaign=877740

Нажмите здесь для печати.