США опередили Китай в разработке лучшего AI: новая модель из Сиэтла превосходит DeepSeek V3

Уступите место, DeepSeek. В городе появился новый чемпион по искусственному интеллекту [1] — и он американец. В четверг Ai2, некоммерческий исследовательский институт искусственного интеллекта из Сиэтла, выпустил модель, которая, по его утверждению, превосходит DeepSeek V3 [2], одну из ведущих систем китайской компании DeepSeek.

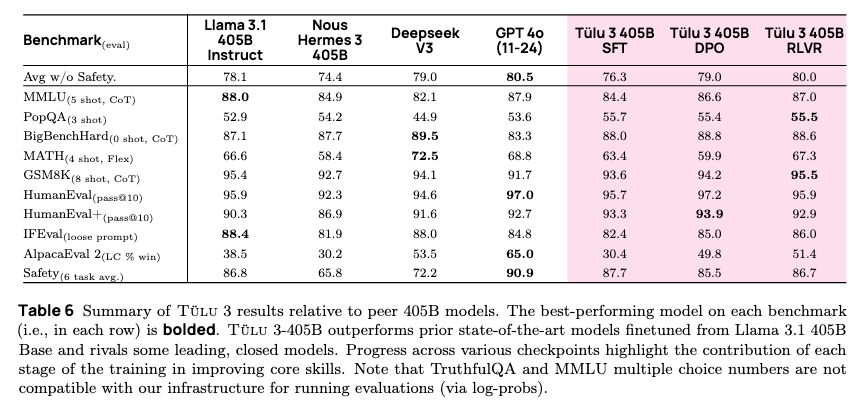

Модель Ai2 под названием Tulu3-405B также превосходит GPT-4o [3] от OpenAI по некоторым показателям AI, согласно результатам внутреннего тестирования Ai2. Более того, в отличие от GPT-4o (и даже DeepSeek V3), Tulu3-405B имеет открытый исходный код [4], а это значит, что все компоненты, необходимые для его воспроизведения с нуля, доступны бесплатно и имеют разрешённую лицензию [5].

Представитель Ai2 сообщил TechCrunch, что, по мнению лаборатории, Tulu3-405B «подчёркивает потенциал США в качестве лидера в мировой разработке лучших в своём классе моделей генеративного AI».

«Эта веха — ключевой момент для будущего открытого AI, укрепляющий позиции США как лидера в области конкурентоспособных моделей с открытым исходным кодом, — сказал представитель компании. — С помощью этого запуска Ai2 представляет мощную альтернативу моделям DeepSeek, разработанную в США, — это поворотный момент не только в развитии AI, но и в демонстрации того, что США могут лидировать в области конкурентоспособного AI с открытым исходным кодом, не зависящего от технологических гигантов».

Tulu3-405B — довольно большая модель. По данным Ai2, она содержит 405 миллиардов параметров, и для её обучения [6] потребовалось 256 графических процессоров, работающих параллельно. Параметры примерно соответствуют навыкам модели в решении задач, и модели с большим количеством параметров обычно работают лучше, чем модели с меньшим количеством параметров.

Согласно Ai2, одним из ключей к достижению конкурентоспособных результатов с помощью Tulu3-405B была техника, называемая обучением с подкреплением [7] и поддающимся проверке вознаграждением. Обучение с подкреплением и поддающимися проверке вознаграждениями, или RLVR, обучает модели выполнению заданий с «поддающимися проверке» результатами, такими как решение математических задач и следование инструкциям.

Ai2 утверждает, что в тесте PopQA, состоящем из 14 000 специализированных вопросов из Википедии, Tulu3-405B превзошёл не только DeepSeek V3 и GPT-4o, но и модель Meta Llama 3.1 405B [8]. Tulu3-405B также показал самую высокую производительность среди моделей своего класса в тесте GSM8K, состоящем из математических задач для начальной школы.

Tulu3-405B доступен для тестирования [9] в веб-приложении чат-бота Ai2, а код для обучения модели [10] находится на GitHub и платформе для разработки AI Hugging Face [11].

Источник [12]

Автор: mefdayy

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/11723

URLs in this post:

[1] интеллекту: http://www.braintools.ru/article/7605

[2] DeepSeek V3: https://techcrunch.com/2024/12/26/deepseeks-new-ai-model-appears-to-be-one-of-the-best-open-challengers-yet/

[3] GPT-4o: https://techcrunch.com/2024/05/13/openais-newest-model-is-gpt-4o/

[4] открытый исходный код: https://techcrunch.com/2024/10/28/we-finally-have-an-official-definition-for-open-source-ai/

[5] разрешённую лицензию: https://fossa.com/blog/all-about-permissive-licenses/

[6] обучения: http://www.braintools.ru/article/5125

[7] подкреплением: http://www.braintools.ru/article/5528

[8] Meta Llama 3.1 405B: https://techcrunch.com/2024/07/23/meta-releases-its-biggest-open-ai-model-yet/

[9] доступен для тестирования: https://playground.allenai.org/?model=tulu3-405b

[10] код для обучения модели: https://github.com/allenai/open-instruct

[11] платформе для разработки AI Hugging Face: https://t.co/F2lPoTwbvP

[12] Источник: https://techcrunch.com/2025/01/30/ai2-says-its-new-ai-model-beats-one-of-deepseeks-best/

[13] Источник: https://habr.com/ru/companies/bothub/news/878158/?utm_source=habrahabr&utm_medium=rss&utm_campaign=878158

Нажмите здесь для печати.