Microsoft представила технологию Phi-4-mini-flash-reasoning, которая повышает пропускную способность токенов в 10 раз

Компания Microsoft представила Phi-4-mini-flash-reasoning — облегчённую модель искусственного интеллекта [1], созданную для сценариев с жёсткими ограничениями по вычислительным ресурсам, памяти [2] или задержкам. Модель, разработанная для периферийных устройств и мобильных приложений, призвана обеспечить высокую эффективность логического вывода без требований к аппаратному обеспечению.

Phi-4-mini-flash-reasoning содержит 3,8 миллиарда параметров и основан на семействе Phi-4, представленном в декабре [3], с упором на математические рассуждения.

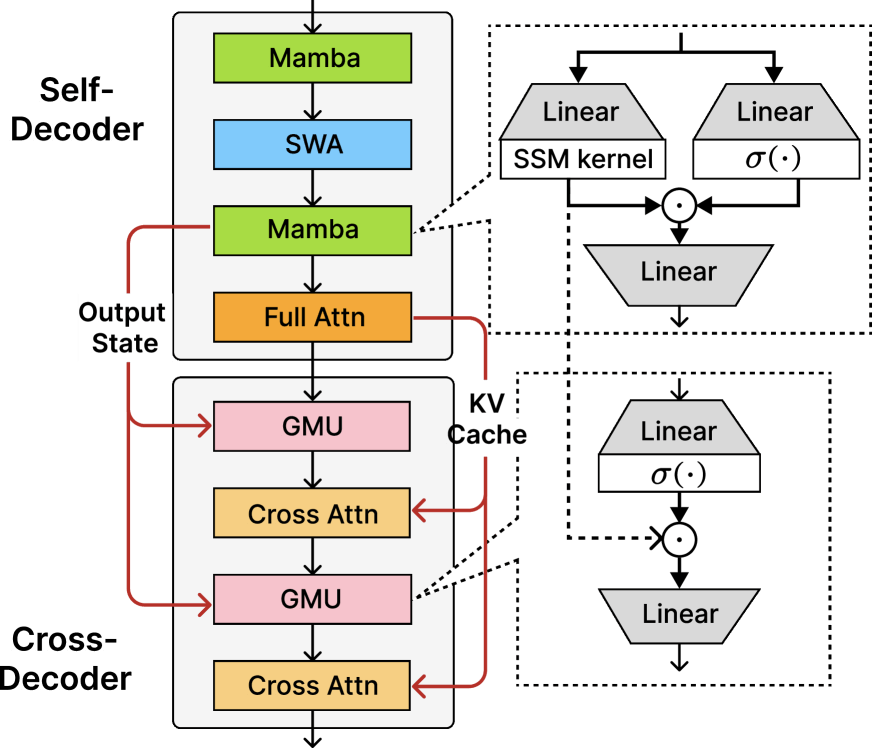

В основе новой модели лежит обновленная архитектура под названием SambaY, которая теперь включает блок стробированной памяти (GMU) и «дифференцированное внимание». Традиционные трансформаторы полагаются на комплексное внимание [4] на каждом уровне, чтобы решить, какие части входного сигнала имеют наибольшее значение.

GMU упрощает этот процесс, заменяя сложные операции перекрёстного внимания простым поэлементным умножением текущего входного сигнала и состояния памяти из предыдущего слоя. Это позволяет модели динамически определять, на каких токенах следует сосредоточиться, без обычных вычислительных затрат.

SambaY сочетает в себе несколько механизмов внимания: один слой полного внимания создаёт кэш «ключ-значение», к которому могут обращаться последующие слои, а глобальные мультиплексоры заменяют примерно половину слоёв перекрёстного внимания, позволяя слоям обмениваться информацией с помощью облегчённых операций умножения. Такой подход сокращает как использование памяти, так и вычислительные требования. В типичных моделях объём данных, передаваемых между памятью и процессором, увеличивается по мере роста длины последовательности, но в SambaY этот показатель практически не меняется.

Новая архитектура для более эффективного анализа данных

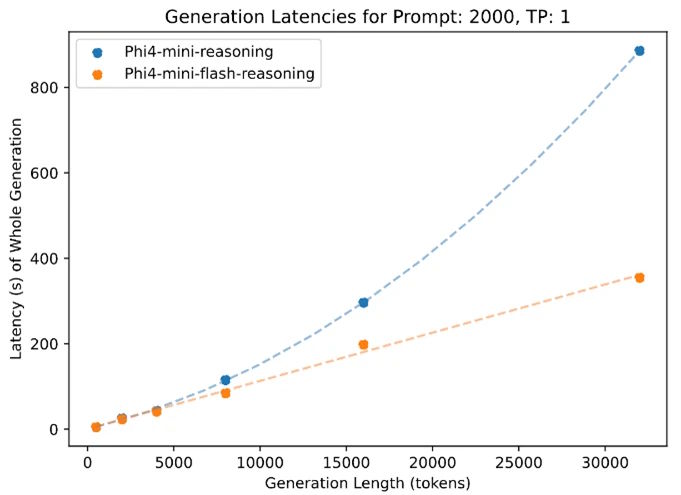

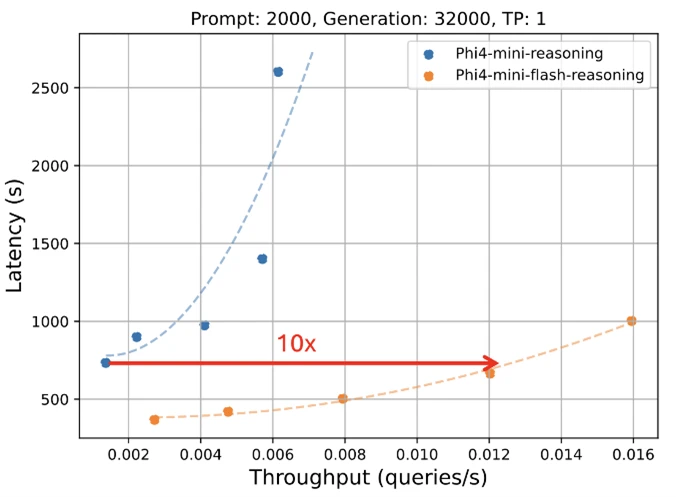

Эти архитектурные изменения значительно повышают производительность. По словам Microsoft, технология Phi-4-mini-flash-reasoning обеспечивает в десять раз более высокую пропускную способность и сокращает среднюю задержку в два-три раза по сравнению с предшественником. Однако эти результаты основаны на тестах с использованием промышленных графических процессоров, а не устройств с ограниченными ресурсами, для которых предназначена эта модель.

Phi-4-mini-flash-reasoning также отлично справляется с обработкой длинных контекстов. Модель поддерживает контекстное окно размером до 64 000 токенов и может сохранять скорость и производительность даже при максимальной нагрузке. Microsoft отмечает эффективность архитектуры SambaY, которая обеспечивает стабильную скорость обработки даже при увеличении длины последовательности, что является явным преимуществом по сравнению со стандартными моделями-трансформерами, которые в таких сценариях замедляются.

Превосходство над более крупными моделями в тестах на логическое мышление

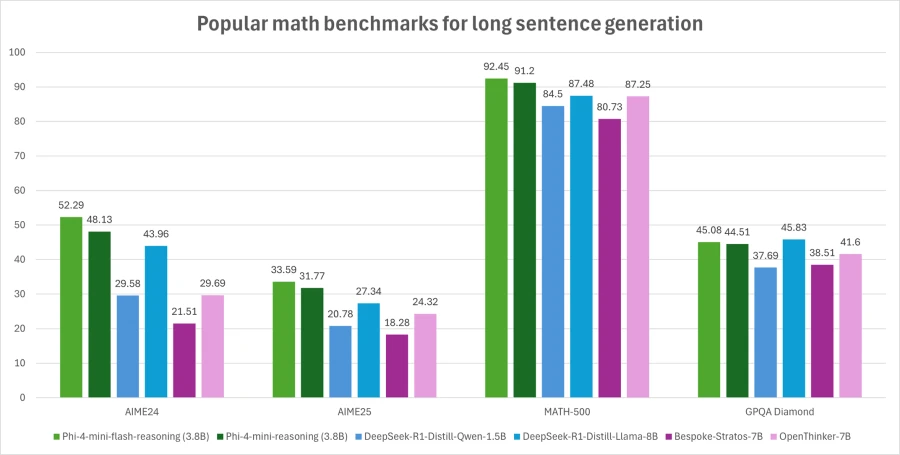

Версия flash выделяется в тестах производительности. Модель Phi-4-mini-flash-reasoning была обучена на пяти триллионах токенов из тех же данных, что и Phi-4-mini, включая синтетические данные, с использованием 1000 графических процессоров A100 в течение 14 дней.

В ходе тестирования она стабильно превосходила базовую модель, особенно в задачах, требующих глубоких знаний, и в задачах по программированию, демонстрируя прирост производительности на несколько процентных пунктов. Модель также лучше справлялась с математическими и научными задачами, и всё это без ресурсоёмкого этапа обучения [5] с подкреплением [6], который использовался в предыдущих версиях.

Phi-4-mini-flash-reasoning доступна на Hugging Face [7], а Microsoft опубликовала примеры кода в Phi Cookbook [8]. Полный исходный код для обучения доступен на GitHub [9].

Делегируйте часть рутинных задач вместе с BotHub [10]! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [11] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Перевод, источник новости здесь [12].

Автор: mefdayy

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/17228

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] памяти: http://www.braintools.ru/article/4140

[3] семействе Phi-4, представленном в декабре: https://the-decoder.com/microsoft-releases-full-phi-4-model-with-weights-under-mit-license/

[4] внимание: http://www.braintools.ru/article/7595

[5] обучения: http://www.braintools.ru/article/5125

[6] подкреплением: http://www.braintools.ru/article/5528

[7] Hugging Face: https://huggingface.co/microsoft/phi-4-mini-flash-reasoning

[8] Phi Cookbook: https://github.com/microsoft/PhiCookBook

[9] GitHub: https://github.com/microsoft/ArchScale

[10] BotHub: https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=MICROSOFT_HAS_INTRODUCED_THE_TECHNOLOGY_OF_PHI-4-MINI-FLASH-REASONING_WHICH_INCREASES_TOKEN_THROUGHPUT_BY_10_TIMES

[11] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[12] здесь: https://the-decoder.com/microsoft-introduces-phi-4-mini-flash-reasoning-with-up-to-10x-higher-token-throughput/

[13] Источник: https://habr.com/ru/companies/bothub/news/927148/?utm_source=habrahabr&utm_medium=rss&utm_campaign=927148

Нажмите здесь для печати.