Прорыв от Google: активное обучение с экономией данных на 10 000× при дообучении LLM

Google разработала масштабируемый процесс active learning, который позволяет в десятки тысяч раз сократить объём размеченных данных, необходимых для тонкой настройки больших языковых моделей на сложных задачах — например, при модерации рекламного контента.

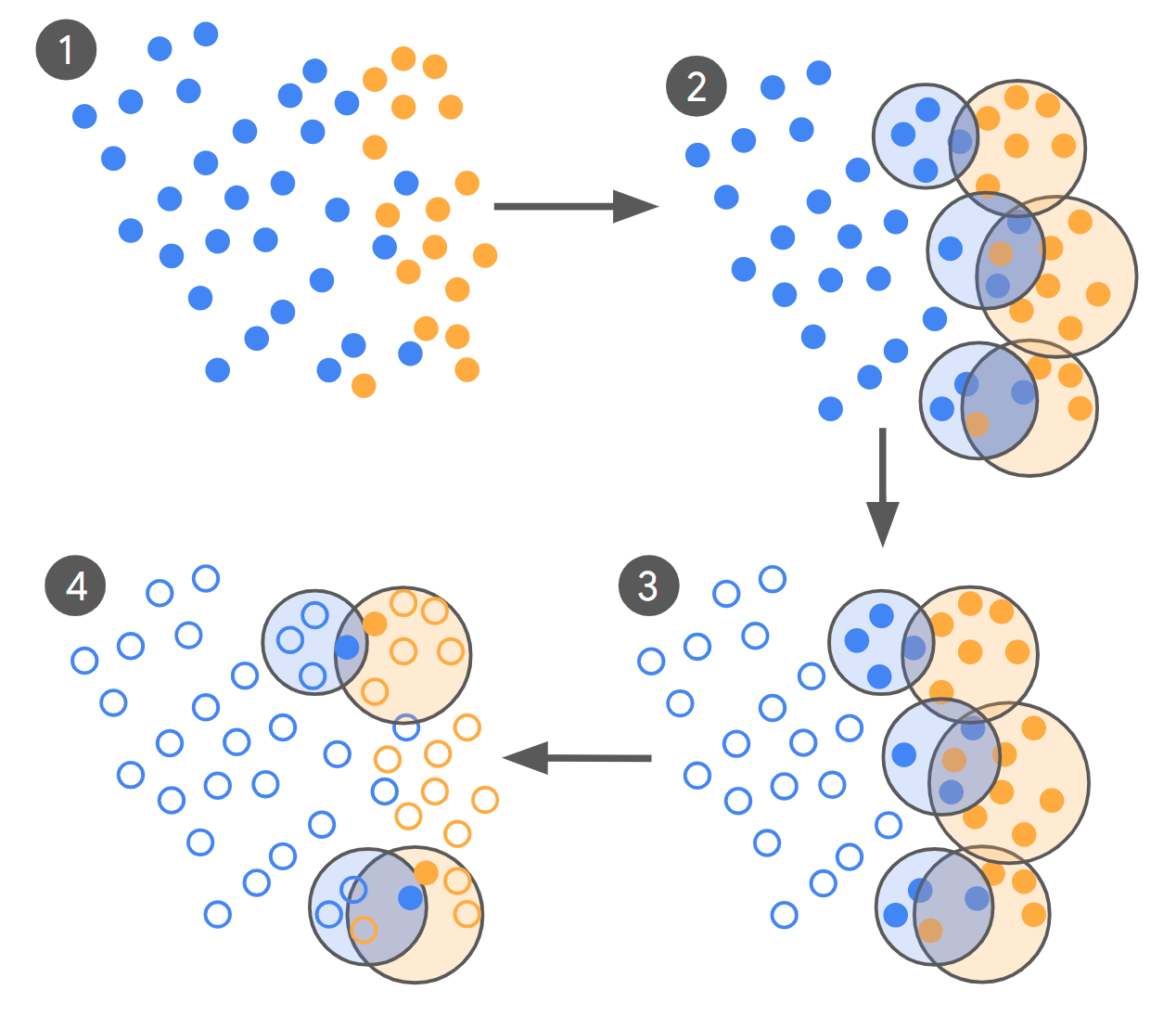

Метод работает следующим образом: сначала стартовая модель (LLM-0) принимает промпт и автоматически размечает огромный массив данных, создавая базовую разметку. Затем кластеризация анализирует эту разметку и выявляет примеры, где модель ошибается или проявляет неуверенность. Эти примеры считаются наиболее спорными и ценными для обучения [1].

Далее происходит отбор данных: из выявленных кластеров выбираются наиболее информативные и разнообразные примеры, которые требуют улучшения.

Эти данные передаются экспертам для ручной разметки, чтобы обеспечить высокую точность и качество. После этого обновленные данные используются для дообучения модели.

Этот процесс повторяется: модель дообучается, снова происходит кластеризация и отбор спорных примеров, затем эксперты выполняют разметку, и модель снова дообучается. Таким образом, метод постоянно совершенствуется, повышая точность и качество работы модели.

Результаты:

-

Сокращение с 100 000 размеченных примеров до менее 500 при сохранении или улучшении качества.

-

Улучшение метрики Cohen’s Kappa на 55–65%.

-

В больших продакшн-моделях — до 3–4 порядков меньше данных при сопоставимом или лучшем качестве.

Что такое Cohen’s Kappa?

Это метрика, которая показывает, насколько два «судьи» (например, эксперт и модель) согласны между собой с поправкой на случайные совпадения.

-

0.0 — нет согласия (или хуже случайного)

-

0.41–0.60 — умеренное согласие

-

0.61–0.80 — значительное

-

0.81–1.00 — почти полное согласие. В задачах с дисбалансом классов Kappa даёт более честную оценку, чем обычная точность (accuracy).

Чем лучше предыдущих методов:

-

Точечная разметка: размечаются только самые информативные примеры.

-

Масштабируемость: метод применим к наборам данных с сотнями миллиардов примеров.

-

Экономия ресурсов: меньше времени и затрат на разметку.

-

Быстрая адаптация: подходит для доменов с быстро меняющимися правилами (реклама, модерация, безопасность).

При умном отборе данных LLM можно адаптировать в тысячи раз быстрее и дешевле, чем при традиционном обучении на больших размеченных наборах.

Делегируйте часть рутинных задач вместе с BotHub [2]! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [3] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [4]

Автор: mefdayy

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/18177

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] BotHub: https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=BREAKTHROUGH_FROM_GOOGLE:_ACTIVE_LEARNING_WITH_10,000%C3%97_DATA_EFFICIENCY_IN_LLM_FINETUNING

[3] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[4] Источник: https://research.google/blog/achieving-10000x-training-data-reduction-with-high-fidelity-labels/

[5] Источник: https://habr.com/ru/companies/bothub/news/935376/?utm_source=habrahabr&utm_medium=rss&utm_campaign=935376

Нажмите здесь для печати.