Google нашла способ сделать большие языковые модели быстрее и дешевле без потери качества

Google Research анонсировала технологию Speculative Cascades — гибридный подход, который объединяет сразу два проверенных метода ускорения генерации текста и меняет правила игры на рынке LLM. Этот способ позволяет делать работу нейросетей быстрее и дешевле, не жертвуя качеством ответа, а в некоторых случаях даже улучшая его.

Большие языковые модели сегодня лежат в основе чат-ботов, поисковых систем и интеллектуальных ассистентов. Но их главный минус — это огромные затраты вычислительных ресурсов, что напрямую влияет на стоимость и скорость. Для массового внедрения таких систем нужно найти баланс. С одной стороны — быстрые ответы и низкие затраты, а с другой — точность и надёжность.

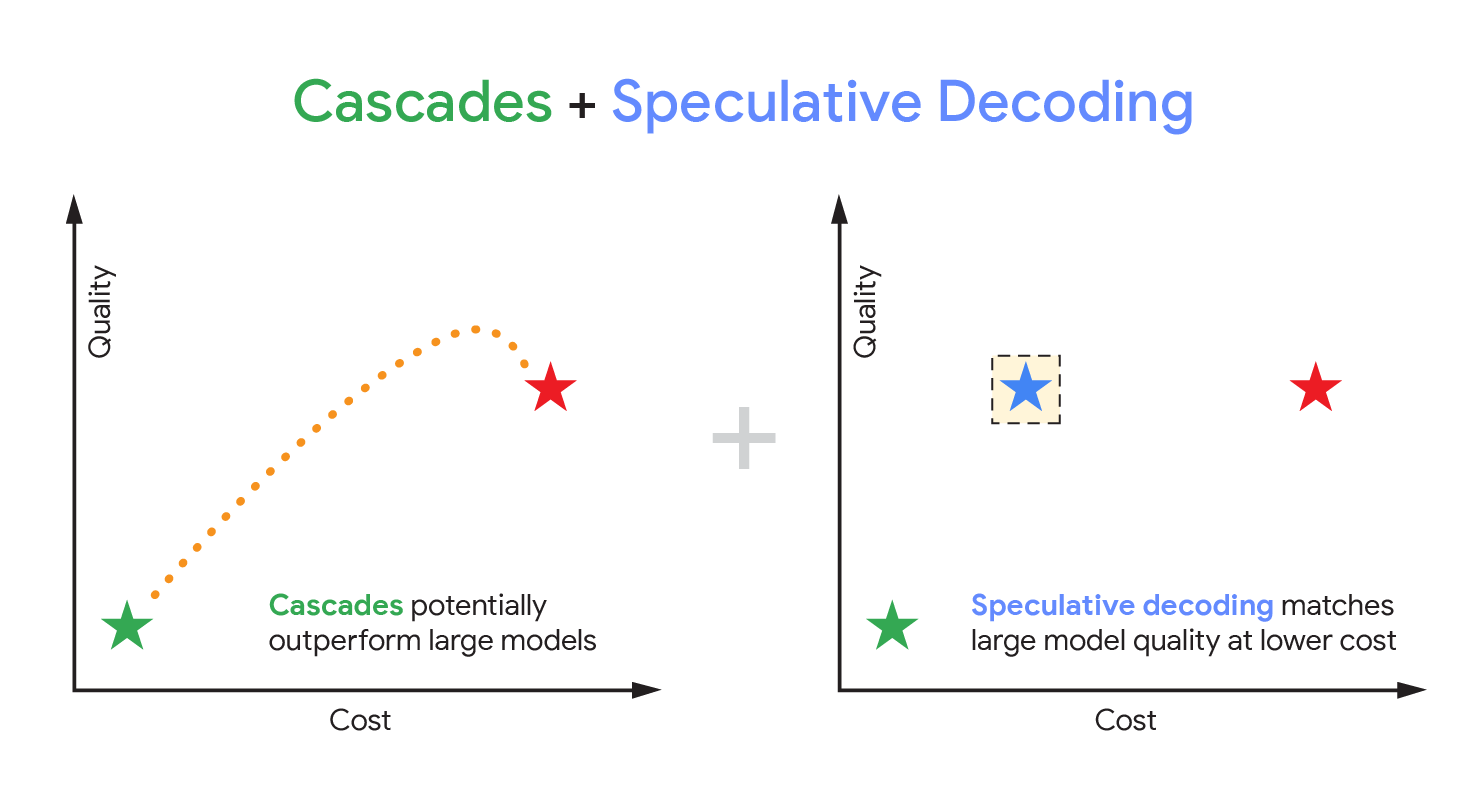

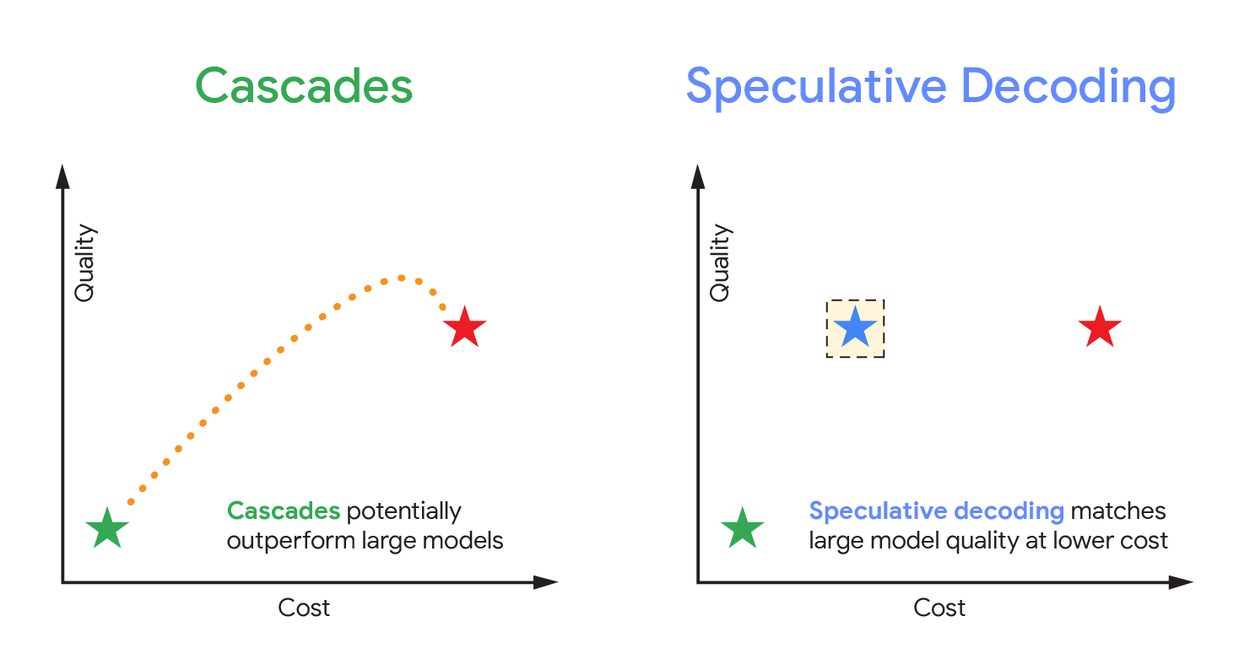

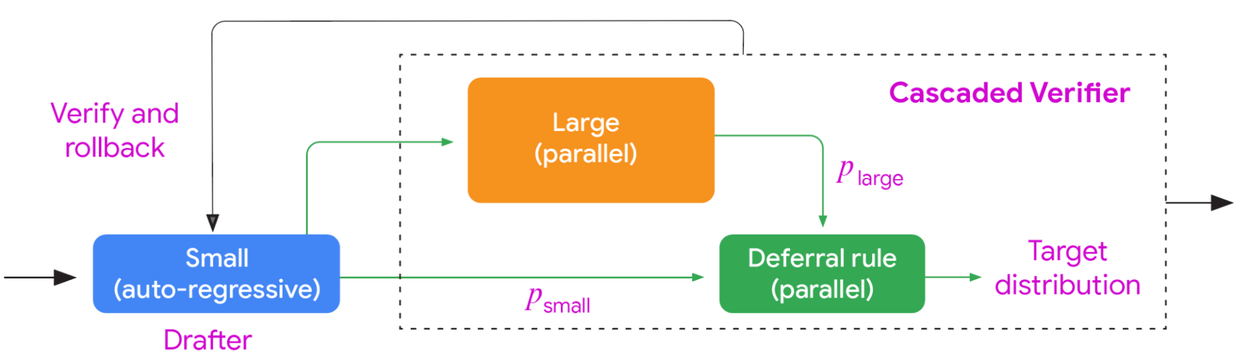

До сих пор применялись два подхода. Первый — каскады [1]. Маленькая модель пытается ответить сама, а если задача оказывается слишком сложной, её подхватывает большая. Экономия есть, но качество сильно колеблется от запроса к запросу. Второй способ — спекулятивная декодировка. Здесь маленькая модель предсказывает сразу несколько слов, а большая быстро проверяет и подтверждает результат. Это ускоряет генерацию, но нагрузка на крупную модель остаётся высокой.

В Speculative Cascades оба подхода объединены. Иногда маленькая модель полностью справляется с запросом сама. Иногда она используется как ускоритель, выдавая черновой вариант, который большая модель быстро проверяет. В итоге ресурсы расходуются эффективнее, скорость повышается, а итоговое качество остаётся на уровне крупных LLM.

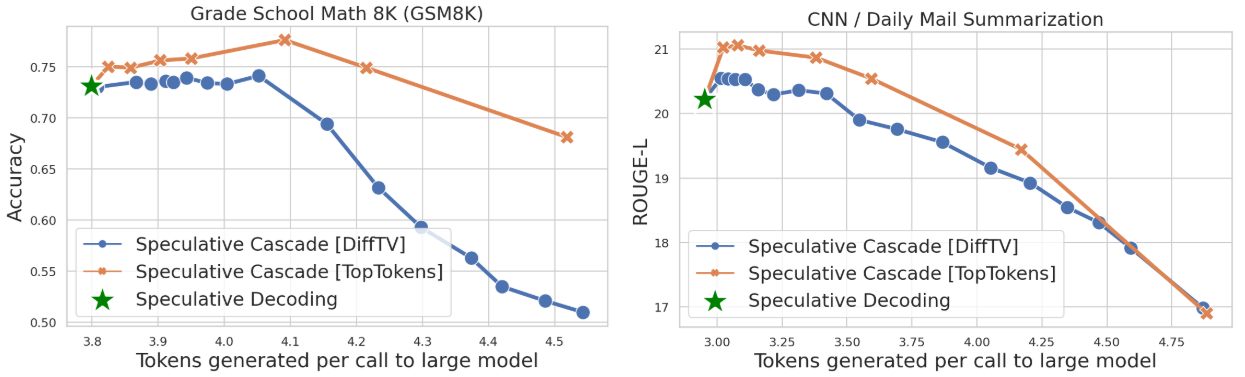

Тесты на моделях Gemma [3]и T5 [4]показали впечатляющие результаты. Новый метод оказался быстрее спекулятивной [5]декодировки, дешевле и надёжнее каскадов. Особенно сильный прирост наблюдается в задачах математического рассуждения: там Speculative Cascades не только ускорил работу, но и улучшил точность.

Ещё одно преимущество метода — гибкость. Разработчики могут сами выбирать баланс между скоростью и качеством: для массовых чат-ботов можно сделать ставку на сверхбыстрые ответы, а для аналитических систем — на проверенную и детализированную информацию.

Эксперты отмечают, что если технология будет внедрена в коммерческие продукты Google, включая семейство моделей Gemini, это может снизить стоимость работы ИИ-сервисов для бизнеса и пользователей по всему миру. По сути, речь идёт о создании нового «ускорителя» для всей отрасли, который позволит масштабировать использование LLM без критического роста затрат на GPU и энергопотребление.

Делегируйте часть рутинных задач вместе с BotHub! [6] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [7] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Подробнее [8]

Автор: cognitronn

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/19443

URLs in this post:

[1] каскады: https://openreview.net/pdf?id=XUZ2S0JVJP

[2] мышления: http://www.braintools.ru/thinking

[3] Gemma : https://ai.google.dev/gemma/docs?hl=ru

[4] T5 : https://research.google/blog/exploring-transfer-learning-with-t5-the-text-to-text-transfer-transformer/

[5] спекулятивной : https://arxiv.org/abs/2405.19261

[6] BotHub!: https://bothub.chat/?utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_source=contentmarketing&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_medium=habr&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_campaign=news&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_content=GOOGLE%20FINDS%20WAY%20TO%20MAKE%20LARGE%20LANGUAGE%20MODELS%20FASTER%20AND%20CHEAPER%20WITHOUT%20SACRIFICING%20QUALITY

[7] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[8] Подробнее: https://research.google/blog/speculative-cascades-a-hybrid-approach-for-smarter-faster-llm-inference/

[9] Источник: https://habr.com/ru/companies/bothub/news/946464/?utm_source=habrahabr&utm_medium=rss&utm_campaign=946464

Нажмите здесь для печати.