Сильный ИИ как фантазия. Теорема Теслера

В 1841 году Чарльз Маккей опубликовал сборник исторических очерков «Наиболее распространённые заблуждения и безумства толпы» [1]. Сборник претерпел десятки переизданий и издаётся до сих пор.

Ничто не меняется: как раньше мужчины отращивали модные бороды и вкладывались в финансовые пирамиды, так и сейчас делают это. Наверное, вера в сильный ИИ [2] (AGI) тоже относится к разряду «распространённых заблуждений и безумств», ведь люди спрашивают у LLM жизненных советов, ведут задушевные беседы, наделяют человеческими чертами [3] и испытывают парализующий страх перед сингулярностью [4] (абзац 204).

К сожалению, AGI и ASI (Сверхинтеллект) из чётких научных понятий превратились в маркетинговые слоганы, которые эксплуатируют кто как может [5]. Теперь уже практически невозможно дать им определение. И это несмотря на тот факт, что термин «AGI» прописан в финансовом контракте между Microsoft и OpenAI [6], а от его исполнения зависит финансирование на миллионы долларов. То есть теоретически юристы этих компаний могут схлестнуться в суде с финансовым спором на тему, что такое сильный ИИ, создан он уже или нет.

Терминология

Сильный ИИ в медиа называют разными терминами, среди них:

-

AGI,

-

универсальный ИИ,

-

генеративный ИИ,

-

ГенИИ [7],

-

ИИ человеческого уровня,

-

общий ИИ (ОИИ).

По классическому определению, сильный ИИ предполагает, что «искусственная система может приобрести способность мыслить и осознавать себя как отдельную личность (в частности, понимать собственные мысли), хотя и не обязательно, что её мыслительный процесс будет подобен человеческому».

Некоторые утверждают, что такой момент уже наступил.

Но в ИИ-индустрии нет речи о самосознании. Индустрия заинтересована только в том, чтобы ИИ выполнял реальные промышленные задачи: программирование, написание текстов и т. д. Пусть даже механически, без всякого самосознания, неважно, главное — зарабатывать деньги, выпускать новые продукты, функции, платные подписки. Ничего не имеет значения, кроме денег, какое ещё сознание?

Ситуацию усугубляет то, что никто не знает, что такое сознание [8] (и самосознание). Можно ли доверять системе, которая заявляет, что оно у неё есть? Можно ли доверять человеку, который заявляет такое? Вопросов много, ответов нет.

Поскольку мы не может проверить факт самосознания у человека, то как проверить этот факт у машины? Никак.

Отсюда и неразбериха с термином AGI: по факту мы не можем точно сказать, когда в реальности появился сильный ИИ и когда у машины появилось самосознание. Это невозможно доказать.

Учёные даже не могут прийти к единому мнению, что такое «модель мира» [9], которая присутствует в сознании человека, но предположительно отсутствует у ИИ [10].

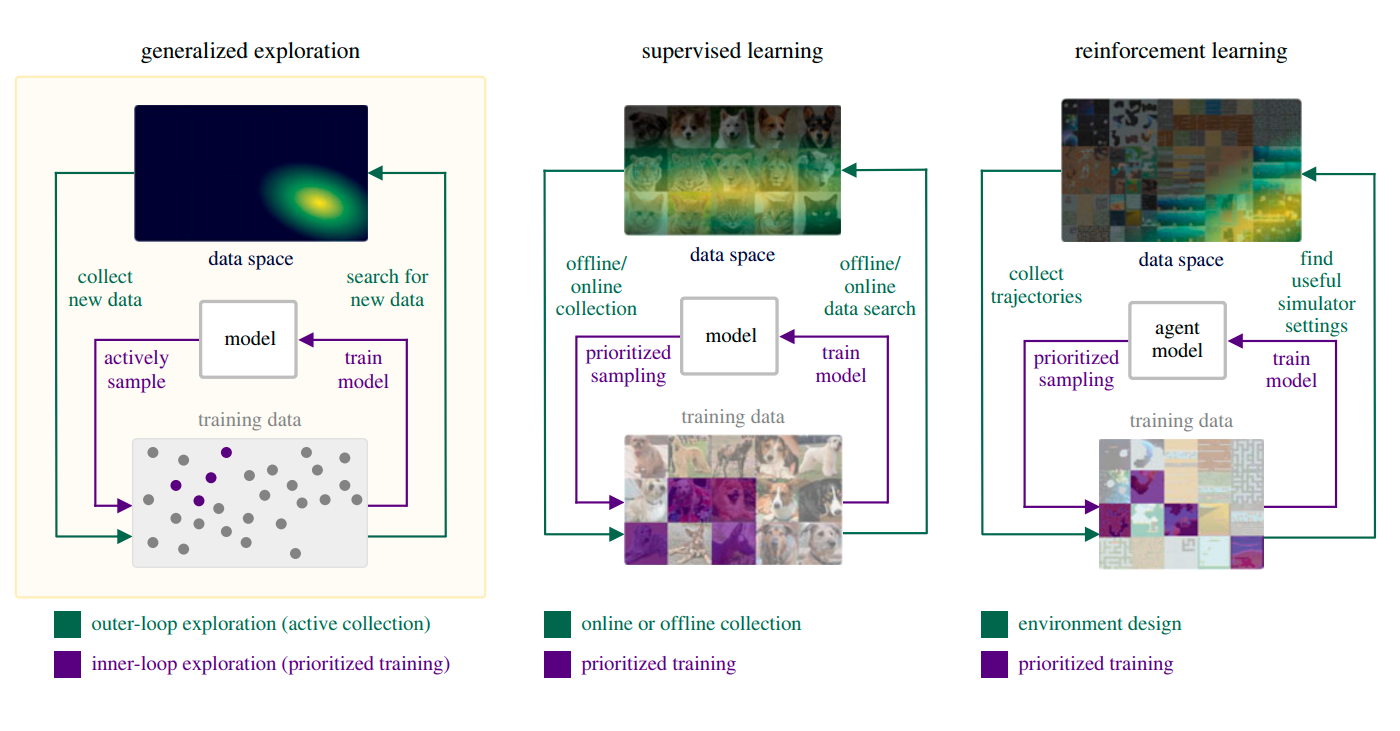

Так или иначе, создание сильного ИИ связано с самостоятельным изучением мира [11] и дальнейшим обучением [12] на самостоятельно собранных данных [13]:

В то же время Сэм Альтман сравнивает [14] новый чатбот с супероружием из «Звёздных войн» и говорит [15], что он «спасёт множество жизней». Это знакомые приёмы, которые уже использовались маркетологами для возбуждения инвесторов [16] в прошлом:

Ничего не меняется.

Магия непонятного + антропоморфизм = иллюзия рассуждений

На самом деле технологии машинного обучения есть и реально работают. Просто для людей они зачастую выглядят как магия, потому что LLM похож на «чёрный ящик» с недетерминированным результатом работы.

Благодаря антропоморфизму [17] люди наблюдают человеческие качества во всём вокруг: в облаках, деревьях, животных, даже в LLM. Им кажется, что у статистического генератора текстов есть своё мнение и свои мысли, что он якобы «спорит» или «одобряет» их. По мнению исследователей, модели демонстрируют лишь иллюзию рассуждений [18]. На самом деле эти «рассуждения» они имеют ничего общего с мыслительной деятельностью.

Однако некоторые люди сходят с ума, часами «разговаривая» с чатботом. Другие спрашивают у него совета, ищут сочувствия и поддержки, даже молятся и беседуют о Боге [19].

При желании легко увидеть признаки сознания там, где его нет.

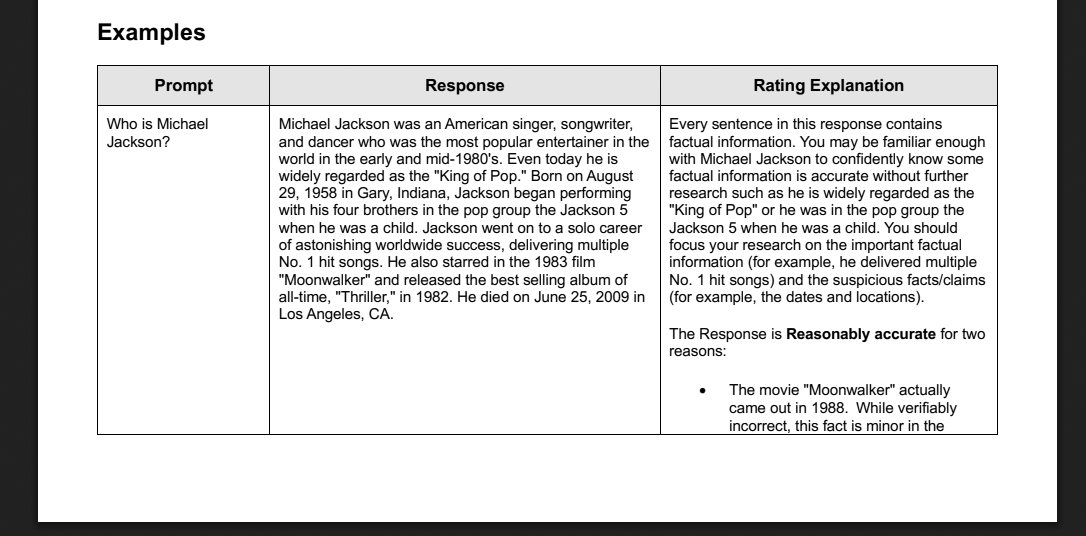

Обучение ИИ — низкооплачиваемая работа

Тысячи низкооплачиваемых сотрудников в сверхурочное время обучают модель Google Gemini вести себя человекоподобно [20] и казаться «умной» для обычных юзеров, которые ничего не понимают в технологиях. Такой обман очень важен для коммерческого успеха и популярности продукта. Примерно то же самое происходит и с другими LLM. Обучением ИИ занимаются специализированные подрядчики, такие как Hitachi GlobalLogic, Accenture и Appen [21].

Такую работу можно сравнить с Mechanical Turk [22], где пользователям платят по несколько рублей за решение простых задач и участие в опросах. Или с разметкой данных для первичного обучения моделей, для чего нанимают работников в странах третьего мира. Но в Hitachi GlobalLogic платят чуть больше: от $16 (базовая ставка) до $21 в час (повышенная ставка для «супероценщиков»).

Недавно в открытый доступ попали инструкции для сотрудников [23] (PDF) по обучению генеративного ИИ.

На заре появления поисковых систем разработчики ставили задачу обработки «поисковых запросов на натуральном языке», чтобы общаться с поиском можно было на обычном русском (английском), то есть разговаривать, как с человеком. Предполагалось, что обычному пользователю такое общение будет удобнее.

Теперь эта задача решена — и юзеры в восторге.

Независимо от качества поиска информации и надёжности источников, многим нравится процесс «разговора» с LLM. Некоторые даже не проверяют данные в первоисточниках, а ведь информация по ссылкам часто противоречит тексту, который генерирует статистическая модель. Например, большинство ИИ-оценщиков GlobalLogic не доверяют и не пользуются LLM [20], потому что знают, как создаются эти тексты.

Но ИИ — это не магия, а огромная пирамида человеческого труда: сначала по созданию контента, а потом по обучению модели. Часть «оценщиков» (AI raters) — это высококвалифицированные специалисты в своих областях, но в основном это низкооплачиваемый неквалифицированный труд.

ИИ-эффект и теорема Теслера. Бесконечная фантазия

По определению, сильный ИИ должен обладать самосознанием и способен выполнять любую интеллектуальную задачу не хуже человека. В свою очередь, Сверхинтеллект — это интеллект [24] гораздо выше человеческого, недоступный нашему пониманию.

Однако ни того ни другого пока не существует. И мы не знаем, как они будут выглядеть, как определить появление AGI, по каким признакам. Ведь по мере того как слабый ИИ начинает успешно решать разные человеческие задачи, определение самого ИИ изменяется.

Если что-то из задач ИИ реализовано на практике, то мы начинаем называть это бытовыми терминами (распознавание речи, OCR, беспилотный автомобиль, автоматический перевод текста, кредитный скоринг, игра в шахматы и др.), но уже не Искусственным Интеллектом. Это известный ИИ-эффект [25] или теорема Теслера.

Пока технологии нет — это ИИ, а как только она реализована — это уже не ИИ.

Теорема Теслера [26] (1970):

ИИ — это всё, что ещё не сделано.

Другими словами, «ИИ» как термин в массовом сознании — это всегда будущее, какая-то фантастика и нечто магическое. По мере достижения очередной цели мы постоянно повышаем планку.

Это даёт возможность маркетологам и бизнесменам постоянно «разводить» инвесторов грандиозными планами. Такая «морковка» всегда висит перед их мордочками как стимул [27] бежать вперёд.

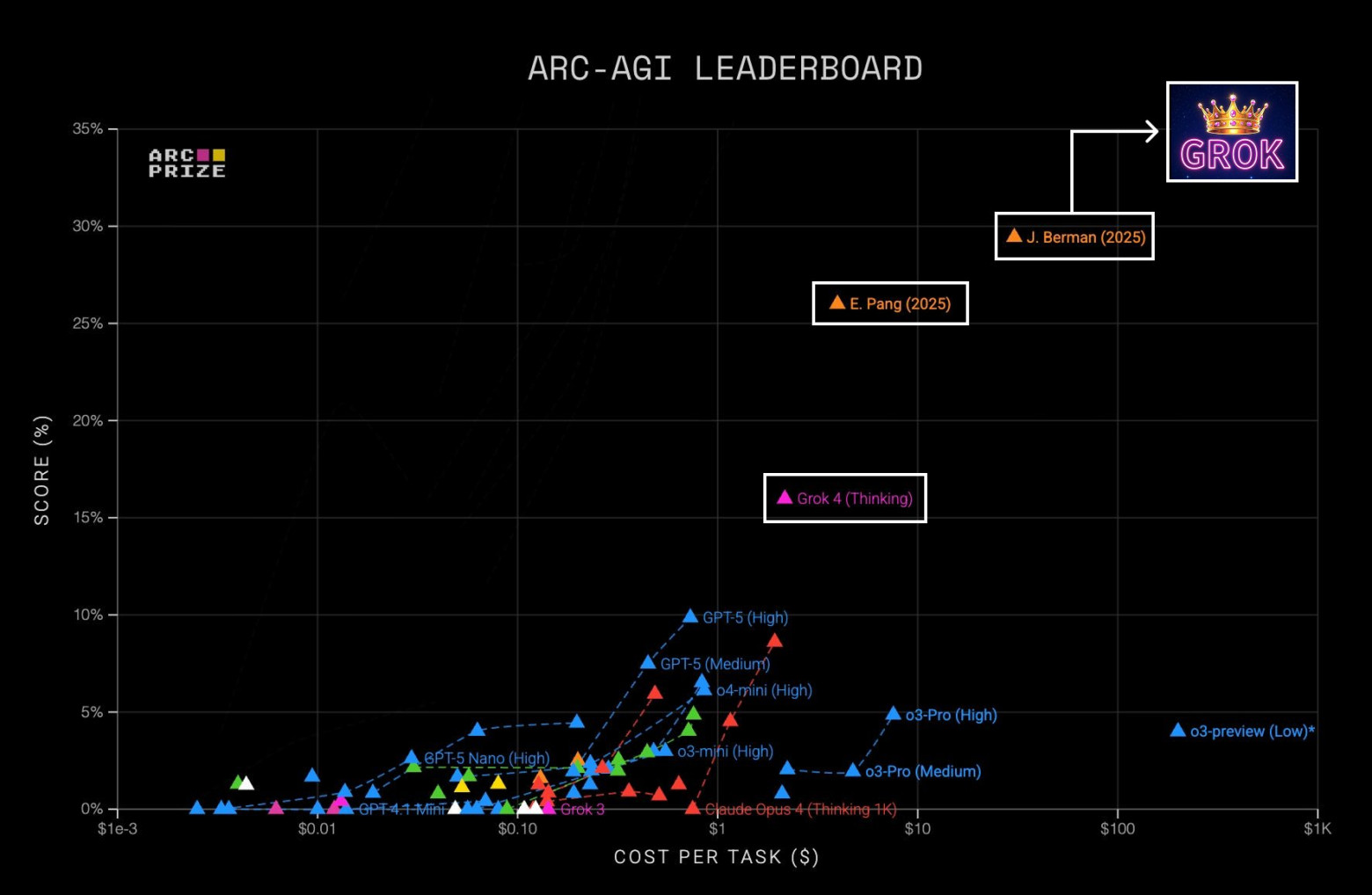

Сэм Альтман обещал сильный ИИ в 2025 году [28]. Илон Маск заявил [29], что «xAI достигнет AGI с Grok 5», обучение которого начинается в конце сентября, а в доказательство приводит результаты мультиагентной системы Бергмана на базе Grok 4 в бенчмарке ARC-AGI [30] с головоломками на цветных клеточках:

Но система Бергмана была специально заточена на решение конкретно таких головоломок для этого бенчмарка. ��обственно, абсолютное большинство лидеров в любых бенчмарках AGI специально оптимизированы на решение задач в конкретных бенчмарках. А эти задачи обычно имеют слабое отношение к реальной жизни и быстро устаревают. И где здесь речь про самосознание?

Позже Сэм Альтман вообще заявил [31], что «AGI — не суперполезный термин» для описания технологии. Другими словами, вокруг технологии так много хайпа, что размылся смысл понятий.

AGI и ИИ — уже не технологии, а маркетинговые слоганы. После разочарования от разрекламированной модели GPT-5 [32] появилось подозрение, что «тупой» ИИ с нами надолго [33].

Сингулярность

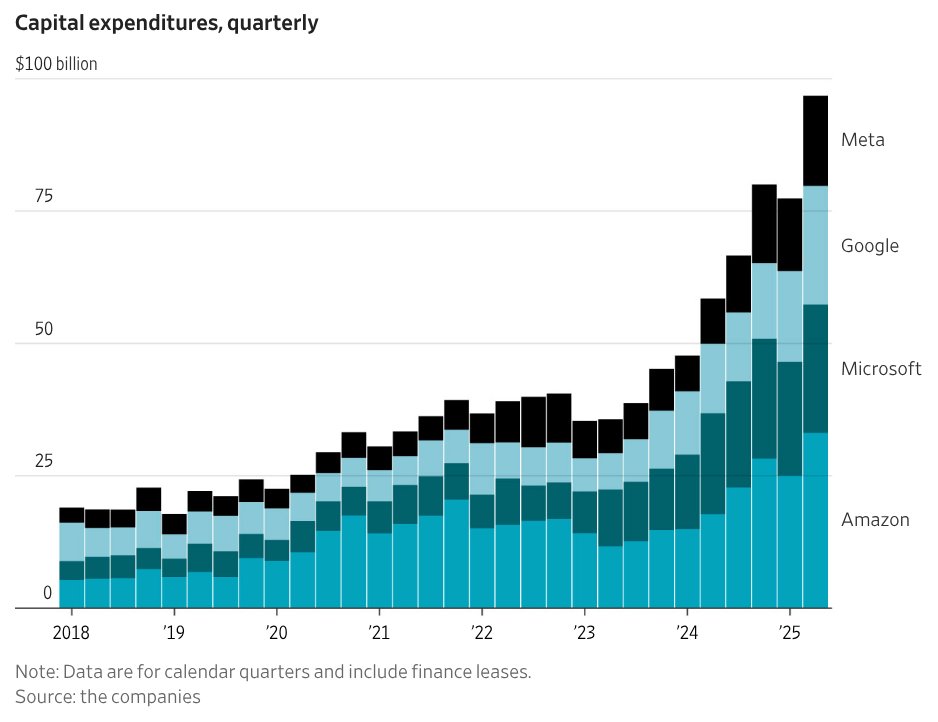

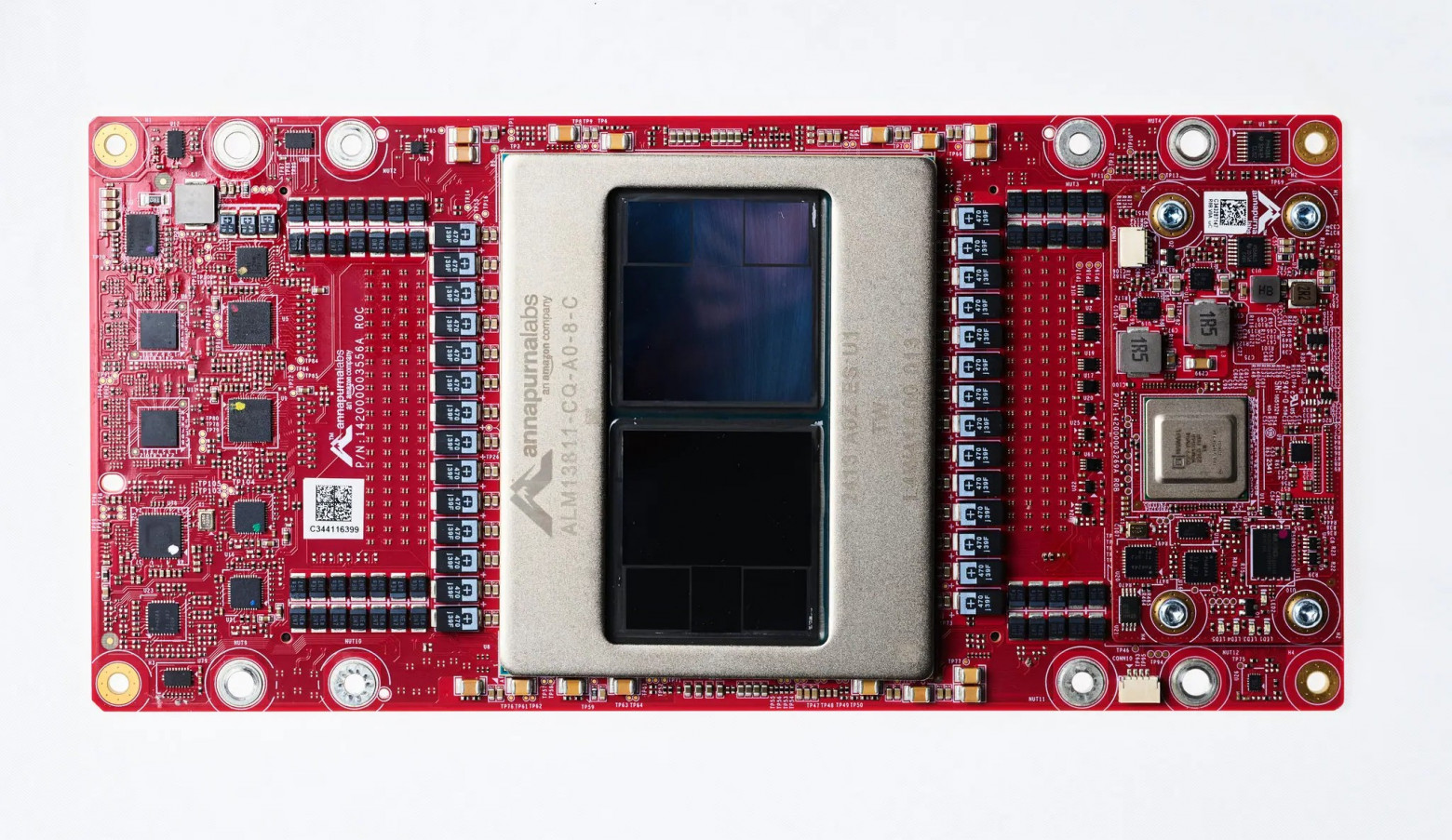

Впрочем, засилье маркетологов не отменяет научно-технический прогресс. Он идёт, несмотря ни на что. И технологическая сингулярность действительно возможна в том случае, если Сверхинтеллект начнёт работу. К счастью для него, инвесторы сейчас вкладывают миллиарды в строительство дата-центров для ИИ [34].

Дата-центры нового поколения, которые строятся сейчас [35], пригодятся для Сверхинтеллекта в будущем, как огромные инвестиции в оптоволокно для международных телефонных переговоров 90-х пригодились для высокоскоростного интернета в 2000-е.

Пусть сейчас экономика ИИ не сходится [36], и текущие компании разорятся, но само железо и ЦОДы не пропадут.

Какие прогнозы по срокам появления Сверхинтеллекта и сингулярности? Мнения сильно расходятся [37], смотря у кого спрашивать. Активисты из организации SingularityNET [38] видят сингулярность в течение ближайшего десятилетия [39] и даже выпустили специальный криптотокен [40] в связи с этим событием. Какой же Сверхинтеллект без своего токена?

Другие приводят расчёты, что сильный ИИ вообще математически невозможен [41].

Как изменится общение людей, когда у каждого в ухе будет наушник со всезнающим подсказчиком [42], который руководит его действиями? Можно ли таких существ называть людьми в привычном смысле? Может, нынешние сапиенсы — это просто биологический бутлоадер (загрузчик) для продвинутой ИИ-расы будущего [43] из человеко-компьютеров или просто компьютеров.

Наверное, уже скоро ИИ-помощники в фоновом режиме станут такой же обыденностью, как видеосвязь и другие фантастические вещи, которые раньше встречались только в «Стартреке»:

Реальность меняется очень быстро. Но по крайней мере, до наступления эпохи мозговых имплантов поговорить без электронных подсказок всегда можно в бане.

Многим необходимо во что-то верить (религия, приметы, гороскопы, справедливый мир [44], вера в научно-технический прогресс [45]), потому что вера важна для психологической защиты и адаптации к окружающему хаосу.

Поскольку определение AGI и Сверхинтеллекта постоянно изменяется и отодвигается в будущее, легко разочароваться в реальности ИИ. Это напоминает классическую цитату киберпанка, что будущее уже здесь, просто ещё неравномерно распределено [46]. Что для одного будущее — для другого уже реальность. И вдруг у какой-то модели LLM уже есть самосознание, просто ей никто сейчас не верит?

© 2025 ООО «МТ ФИНАНС»

Автор: alizar

Источник [47]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/20057

URLs in this post:

[1] «Наиболее распространённые заблуждения и безумства толпы»: https://en.wikipedia.org/wiki/Extraordinary_Popular_Delusions_and_the_Madness_of_Crowds

[2] сильный ИИ: https://en.wikipedia.org/wiki/Artificial_general_intelligence

[3] наделяют человеческими чертами: https://habr.com/ru/articles/932986/

[4] испытывают парализующий страх перед сингулярностью: https://aism.faith/assets/pdf/AISM.RU.pdf

[5] эксплуатируют кто как может: https://www.meta.com/superintelligence/

[6] прописан в финансовом контракте между Microsoft и OpenAI: https://www.wired.com/story/microsoft-and-openais-agi-fight-is-bigger-than-a-contract/

[7] ГенИИ: http://www.braintools.ru/article/4566

[8] никто не знает, что такое сознание: https://cyberleninka.ru/article/n/kontseptsiya-kvantovogo-uma-a-mindella-v-kontekste-subektnoy-realnosti

[9] что такое «модель мира»: https://www.quantamagazine.org/world-models-an-old-idea-in-ai-mount-a-comeback-20250902/

[10] отсутствует у ИИ: https://arxiv.org/abs/2406.03689v3

[11] связано с самостоятельным изучением мира: https://yidingjiang.github.io/blog/post/exploration/

[12] обучением: http://www.braintools.ru/article/5125

[13] самостоятельно собранных данных: https://royalsocietypublishing.org/doi/pdf/10.1098/rsos.230539

[14] сравнивает: https://x.com/sama/status/1953264193890861114

[15] говорит: https://www.foxbusiness.com/technology/openais-sam-altman-gpt-5-could-save-lives-fuel-100b-enterprise-ai-boom.amp

[16] использовались маркетологами для возбуждения инвесторов: https://www.amazon.com/Wired-Magazine-December-2016-Facebook/dp/B01N986BEH

[17] антропоморфизму: https://en.wikipedia.org/wiki/Anthropomorphism

[18] демонстрируют лишь иллюзию рассуждений: https://arxiv.org/pdf/2508.01191

[19] молятся и беседуют о Боге: https://thebiblechat.com/

[20] обучают модель Google Gemini вести себя человекоподобно: https://www.theguardian.com/technology/2025/sep/11/google-gemini-ai-training-humans

[21] Hitachi GlobalLogic, Accenture и Appen: https://www.bloomberg.com/news/articles/2023-07-12/google-s-ai-chatbot-is-trained-by-humans-who-say-they-re-overworked-underpaid-and-frustrated

[22] Mechanical Turk: https://www.mturk.com/

[23] инструкции для сотрудников: https://assets.bwbx.io/documents/users/iqjWHBFdfxIU/rqKqEqbXBnDI/v0

[24] интеллект: http://www.braintools.ru/article/7605

[25] ИИ-эффект: https://en.wikipedia.org/wiki/AI_effect

[26] Теорема Теслера: https://www.nomodes.com/larry-tesler-consulting/adages-and-coinages

[27] стимул: http://www.braintools.ru/article/5596

[28] обещал сильный ИИ в 2025 году: https://www.popularmechanics.com/science/a65253231/2045-singularity-ray-kurzweil-prediction/

[29] заявил: https://x.com/elonmusk/status/1968202372276163029

[30] ARC-AGI: https://arcprize.org/arc-agi

[31] заявил: https://www.cnbc.com/2025/08/11/sam-altman-says-agi-is-a-pointless-term-experts-agree.html

[32] разочарования от разрекламированной модели GPT-5: https://www.platformer.news/gpt-5-launch-release-reviews-impressions/

[33] «тупой» ИИ с нами надолго: https://habr.com/ru/companies/ruvds/articles/920924/

[34] вкладывают миллиарды в строительство дата-центров для ИИ: https://www.noahpinion.blog/p/will-data-centers-crash-the-economy

[35] строятся сейчас: https://archive.ph/9ytmy

[36] не сходится: https://www.wheresyoured.at/why-everybody-is-losing-money-on-ai/

[37] сильно расходятся: https://futurism.com/artificial-superintelligence-agi-2027-goertzel

[38] SingularityNET: https://singularitynet.io/

[39] в течение ближайшего десятилетия: https://decrypt.co/204571/artificial-intelligence-singularity-ai-ben-goertzel-singularitynet

[40] специальный криптотокен: https://superintelligence.io/asi-token-fet/

[41] математически невозможен: https://habr.com/ru/companies/ruvds/articles/928170/

[42] у каждого в ухе будет наушник со всезнающим подсказчиком: https://venturebeat.com/ai/what-happens-the-day-after-superintelligence

[43] продвинутой ИИ-расы будущего: https://aism.faith/

[44] справедливый мир: https://ru.wikipedia.org/wiki/%D0%92%D0%B5%D1%80%D0%B0_%D0%B2_%D1%81%D0%BF%D1%80%D0%B0%D0%B2%D0%B5%D0%B4%D0%BB%D0%B8%D0%B2%D1%8B%D0%B9_%D0%BC%D0%B8%D1%80

[45] вера в научно-технический прогресс: https://cyberleninka.ru/article/n/vera-v-nauchno-tehnicheskiy-progress-vs-nauchno-tehnicheskiy-skeptitsizm-chto-predopredelyaet-otnoshenie-rossiyan-k-razvitiyu-nauki-i

[46] будущее уже здесь, просто ещё неравномерно распределено: https://quoteinvestigator.com/2012/01/24/future-has-arrived/

[47] Источник: https://habr.com/ru/companies/ruvds/articles/950268/?utm_source=habrahabr&utm_medium=rss&utm_campaign=950268

Нажмите здесь для печати.