Увидел-указал-полетел: как управлять автономными дронами без обучения с нуля

Навигация по текстовым инструкциям — давний вызов для автономных дронов. Традиционные алгоритмы на основе обучения [1] с подкреплением [2] требуют больших датасетов и плохо переносятся на новые домены. Недавняя волна решений на базе визуально-языковых моделей обещала универсальность, но часто просила модель выпускать команды в текстовом виде: поверни, лети, поднимись. Язык оказался неудобен для точных чисел и не учит модель трёхмерной механике полёта. Исследователи предлагают на редкость здравую замену: перестать говорить руками и просто показывать точку в кадре, куда дрон должен двигаться.

Вместо слов — указанные пиксели

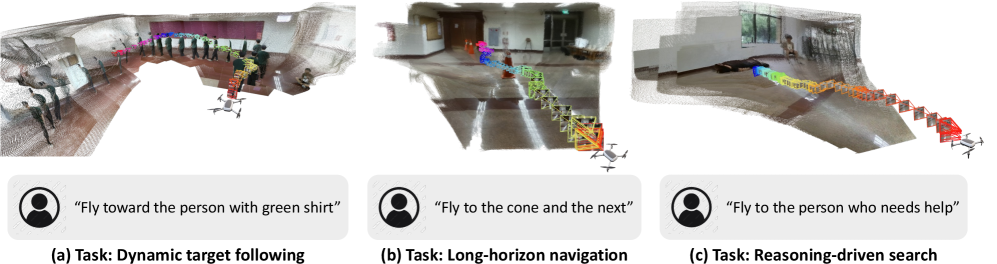

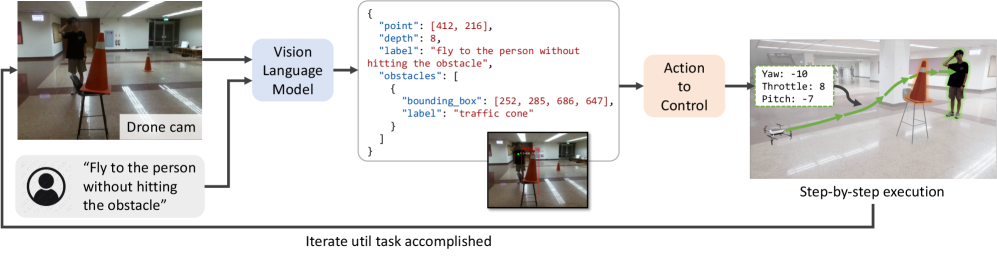

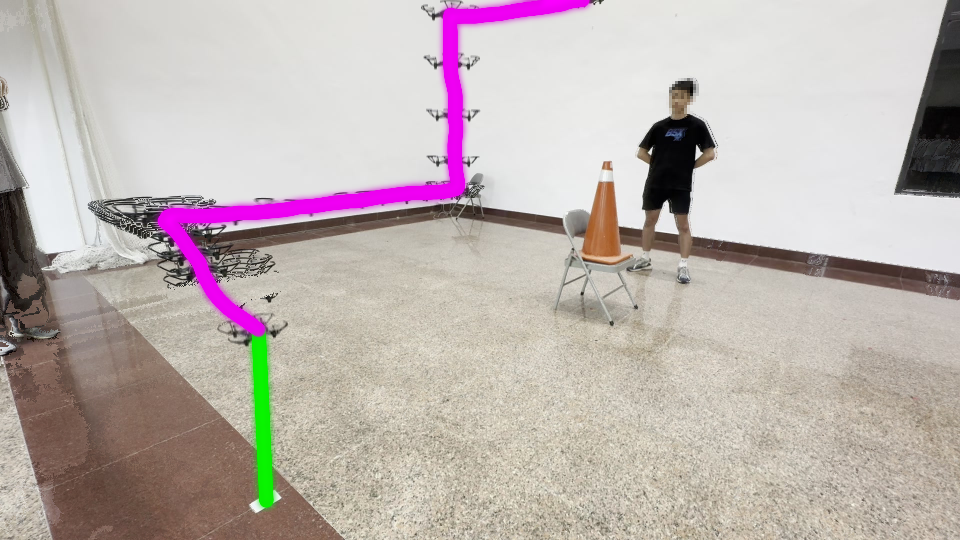

SEE-Point-Fly (SPF) — открытый фреймворк для воздушной vision-and-language навигации. На каждом шаге система подаёт в VLM текущий кадр и инструкцию. Модель возвращает небольшой структурированный план: координаты путевой точки на изображении и дискретную оценку желаемой дальности шага. Параллельно модель помечает рамками препятствия, чтобы не вести дрон через очевидные опасности. Это не требует обучать модель полёту: ей достаточно базового зрительно-пространственного понимания, которое уже сформировано на общих данных.

От точки на кадре — к движению в воздухе

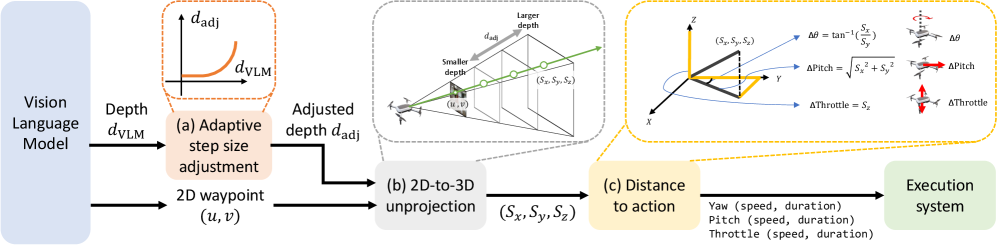

Дальше вступает геометрия. Указанная точка и «дальность шага» поднимаются из 2D в локальные 3D-смещения с помощью стандартной модели камеры. Система переводит их в команды рыскания [3], тангажа [4] и тяги и подаёт на контроллер. Ключевой элемент — адаптивное масштабирование шага. Когда вокруг свободно, дрон уверенно ускоряется; рядом с объектами притормаживает. За счёт этого полёт получается и быстрым, и безопасным. Контур замкнутый: VLM переоценивает точку несколько раз в секунду (примерно 0.3–1 Гц), низкоуровневый контроль идёт быстрее (около 10 Гц), общая задержка — 1.5–3 секунды. Этого хватает, чтобы уверенно следовать даже за движущейся целью.

Что получилось на практике

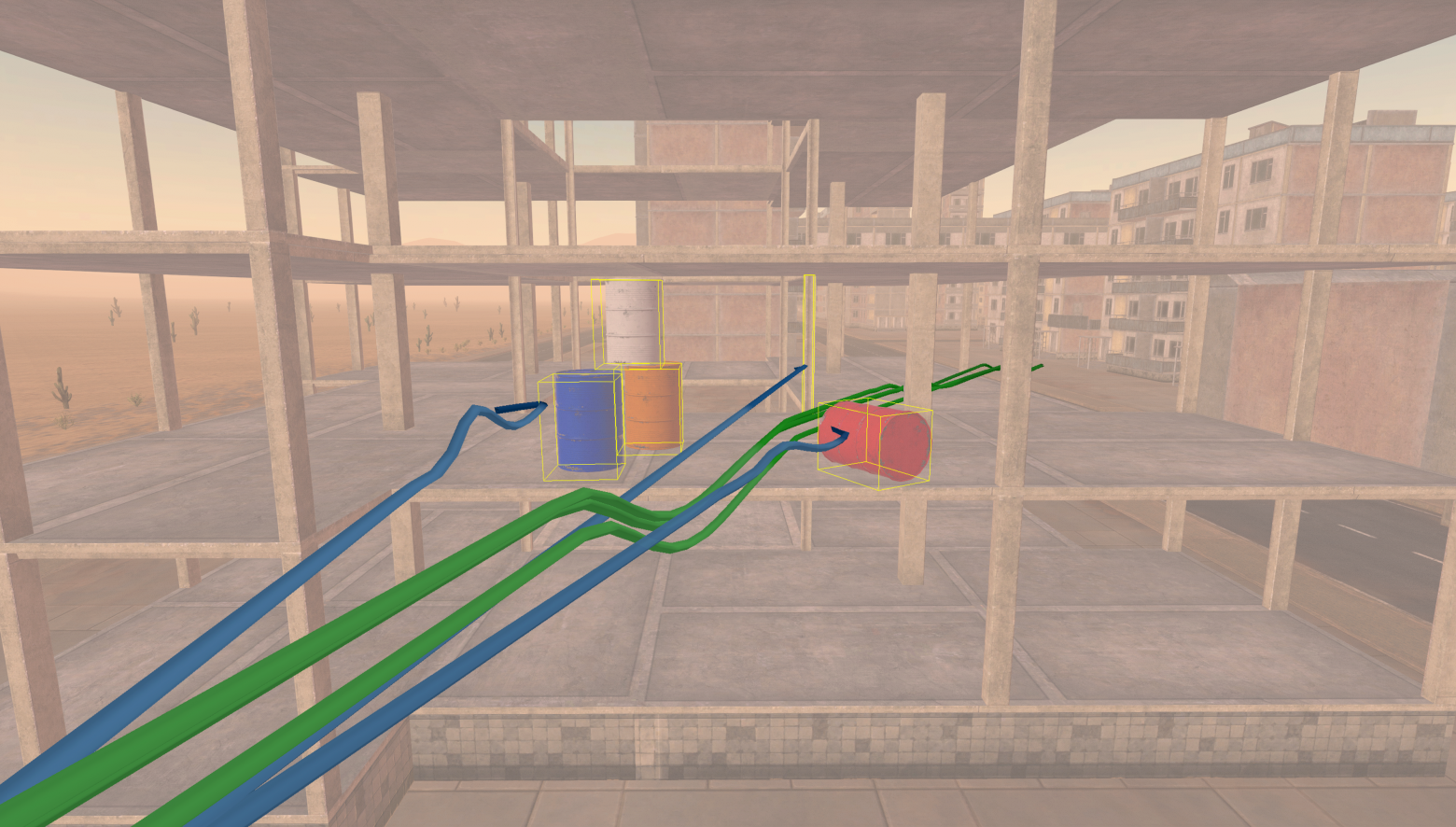

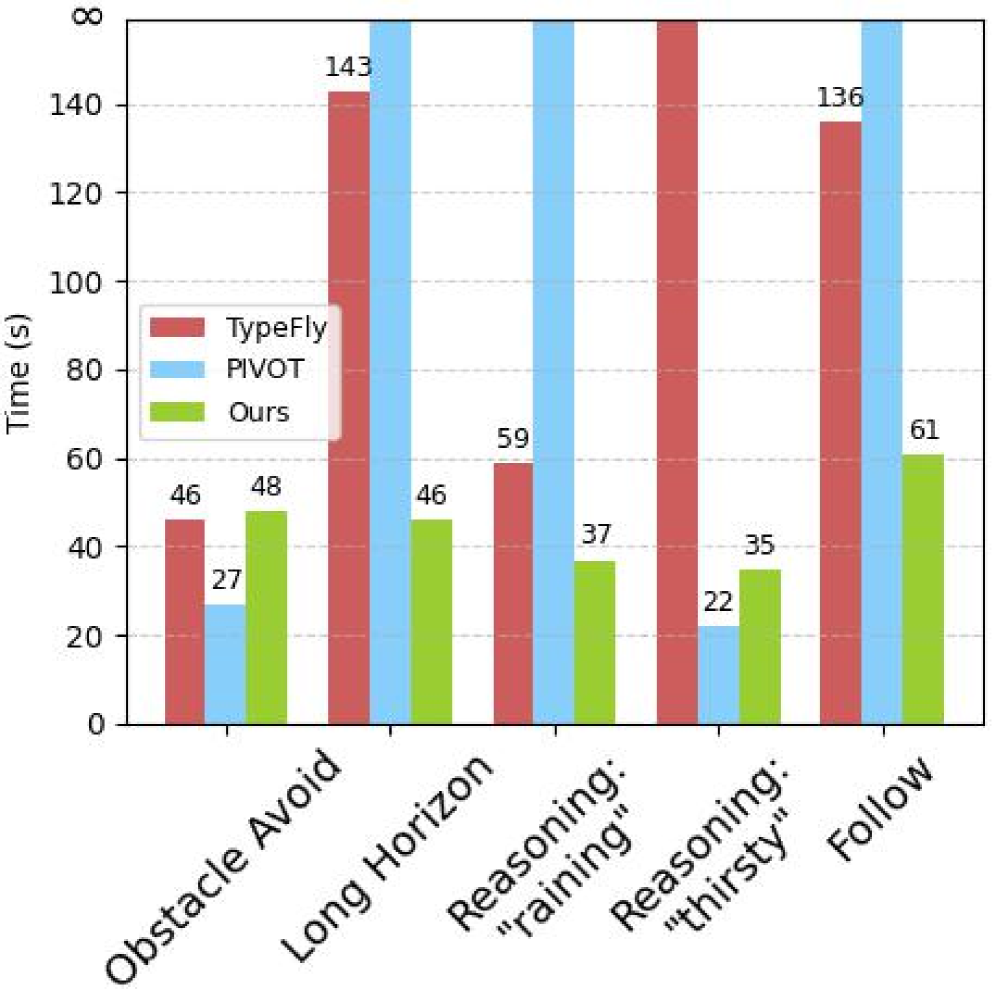

В симуляторе DRL SPF обновил уровень качества: 93.9% успешных завершений против 28.7% у PIVOT и 0.9% у TypeFly. Особенно заметна разница в задачах с препятствиями (92% против 16%), на длинных маршрутах (92% против 28%) и в поиске (92% против 36%). В реальности на DJI Tello EDU — 92.7% успешности, большой отрыв от сильных базовых линий, которые либо ошибались в понимании, либо ломались на физических мелочах. Адаптивный шаг показал себя и по скорости: на трёх реальных сценариях время упало, например, с 61 до 28 секунд без потери надёжности; там, где базовые методы не финишируют вовсе, SPF стабильно приходит к цели.

Почему это сработало

Самое важное — смена языка действий. Вместо слов и чисел в тексте исследователи получили визуально заземлённые точки. Изображение — естественная среда для VLM, а параметры камеры позволяют точно восстановить 3D-команду без сложного обучения. Интегрированная разметка препятствий в той же модели даёт меньше задержек и выше точность, чем отдельный детектор. Наконец, система оказалась модель-агностичной: на разных VLM бэкендах в симуляции SR доходил до 100% (Gemini 2.0 Flash, Gemini 2.5 Pro, GPT‑4.1), держался на уровне 93.3% на Claude 3.7 Sonnet и Llama 4 Maverick и 87% на компактной Gemini 2.0 Flash‑Lite.

Есть и слабые места. VLM может ошибаться в интерпретации и «галлюцинировать» мелкие или дальние цели. Оценка шага — косвенная величина, не настоящая глубина, и иногда даёт неточные дистанции. Реакция [5] на быстро движущиеся препятствия ограничена задержкой VLM. Поведение [6] в поиске определяют эвристики и стиль подсказки, поэтому оптимальность траектории не гарантируется. Но даже с этими оговорками сдвиг от текстовых команд к 2D-привязке выглядит устойчивая и практичная идея.

📜 Полная статья [7]

💾 Код [8]

***

Если вам интересна тема ИИ, [9]подписывайтесь на мой Telegram‑канал [10] — там я регулярно делюсь инсайтами по внедрению ИИ в бизнес, запуску ИИ-стартапов и объясняю, как работают все эти ИИ-чудеса.

Автор: andre_dataist

Источник [11]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/20174

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] подкреплением: http://www.braintools.ru/article/5528

[3] рыскания: https://ru.wikipedia.org/wiki/%D0%A0%D1%8B%D1%81%D0%BA%D0%B0%D0%BD%D0%B8%D0%B5

[4] тангажа: https://ru.wikipedia.org/wiki/%D0%A2%D0%B0%D0%BD%D0%B3%D0%B0%D0%B6

[5] Реакция: http://www.braintools.ru/article/1549

[6] Поведение: http://www.braintools.ru/article/9372

[7] 📜 Полная статья: https://arxiv.org/abs/2509.22653

[8] 💾 Код: https://github.com/Hu-chih-yao/see-point-fly

[9] : https://t.me/+mP35nQPhgXZmZDYy

[10] подписывайтесь на мой Telegram‑канал: https://t.me/+9YLdqg-ciNZiYjNi

[11] Источник: https://habr.com/ru/articles/952550/?utm_source=habrahabr&utm_medium=rss&utm_campaign=952550

Нажмите здесь для печати.