Нейро-дайджест: ключевые события мира AI за 1-ю неделю октября 2025

Привет! Это новый выпуск «Нейро-дайджеста» — коротких и полезных обзоров ключевых событий в мире искусственного интеллекта [1] и технологий.

Меня зовут Вандер [2], и каждую неделю я обозреваю новости о нейросетях и ИИ.

Неделя выдалась насыщенной: куча релизов от Alibaba в LLM и генеративке, Suno обновили модель до версии 5, а в Photoshop появились Flux Kontext и Nano Banana. Ну и вишенка на торте — кто-то встроил ChatGPT прямо в Minecraft.

Всё самое важное — в одном месте. Поехали!

📋 В этом выпуске:

🧠 Модели и LLM

-

Qwen3-Max — уровень GPT-5 от китайцев

-

Qwen3-Omni — мультимодальная модель

-

Новая DeepSeek V3.1 Terminus

-

ChatGPT Pulse — проактивный рисёрч

-

Обновление моделей Gemini

🎨 Генеративные нейросети

-

Обновление модели Qwen-Image-Edit-2509

-

Wan 2.5 — 1080p видео с озвучкой

-

HunyanImage-3.0 — открытая модель от Tencent

-

Обновление Suno V5 и AI DAW Suno Studio

-

Qwen3-TTS —модель для синтеза речи

🔧 AI-инструменты и платформы

-

Бесплатный ИИ-агент от Kimi

-

Flux Kontext и Nano Banana теперь в Photoshop

🧩 AI в обществе и исследованиях

-

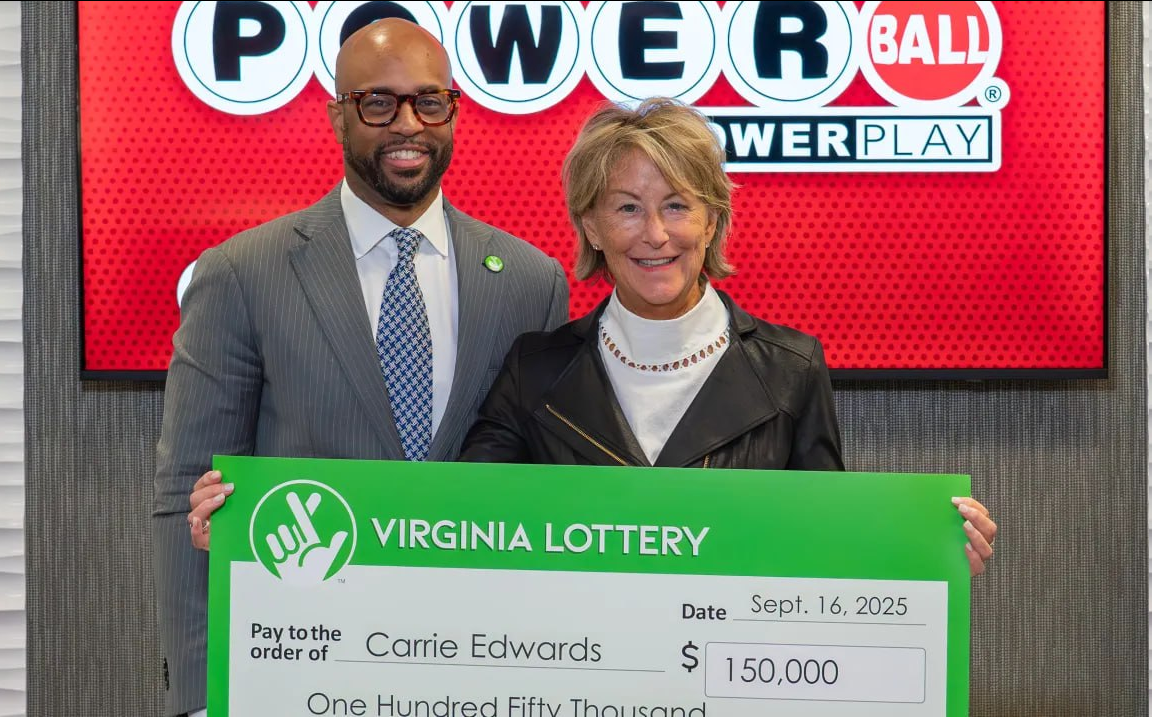

Женщина выиграла $150 000 благодаря GPT

-

Мороженое Magnum будут производить по рецептам ИИ

-

ChatGPT прямо в майнкрафте: LLM на редстоуне

🧠Модели и LLM

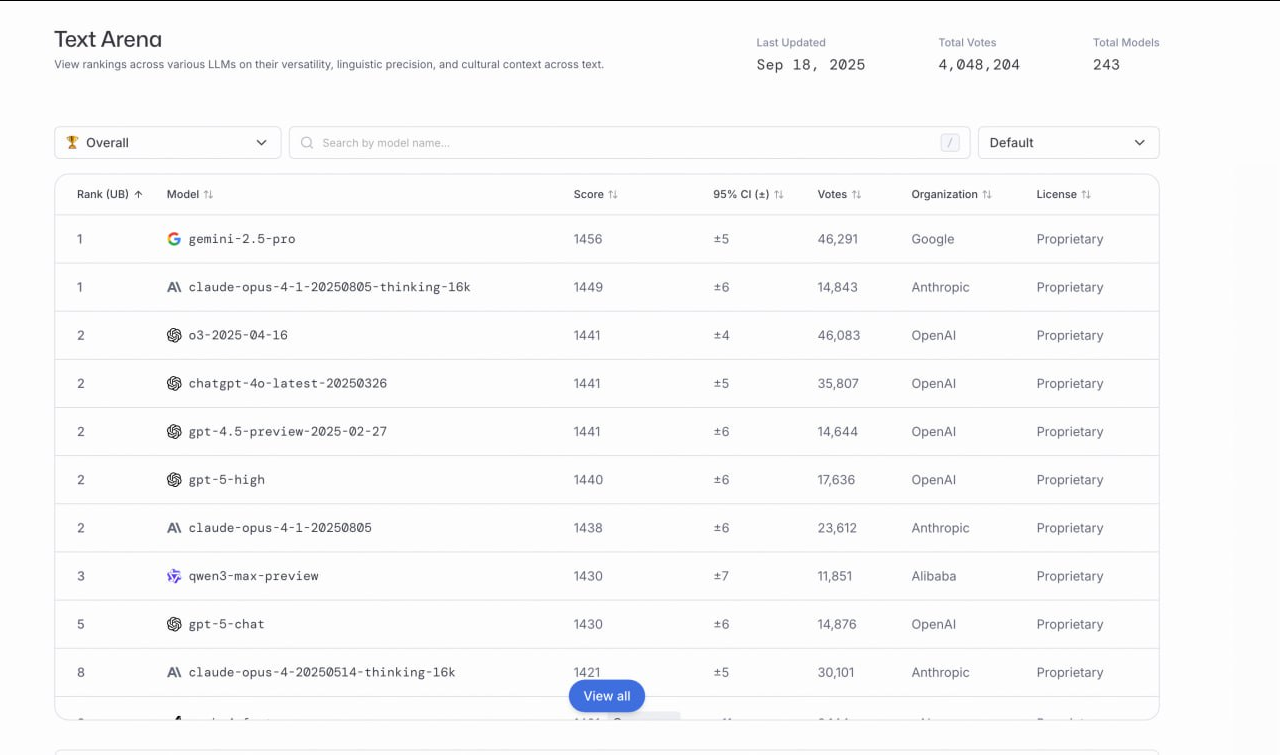

❯ Qwen3-Max — уровень GPT-5 от китайцев

Alibaba представили Qwen3-Max — флагманскую модель, которая по тестам в LMArena догоняет GPT-5 и на русском языке показывает даже более высокие результаты.

У модели есть несколько версий: базовая, Instruct и Thinking.

-

Qwen3-Max-Base обучена на 36 трлн токенов, использует архитектуру MoE и поддерживает контекст до 1 млн токенов.

-

Qwen3-Max-Instruct заняла 3-е место в мировом рейтинге LMArena Text, обогнав GPT-5-Chat и Claude Opus 4.

-

Qwen3-Max-Thinking демонстрирует 100% на олимпиадных задачах AIME и HMMT, работает с интерпретатором кода и параллельными вычислениями.

Протестировать Qwen3-Max уже можно в Qwen Chat, а через Alibaba Cloud доступен API, полностью совместимый с OpenAI.

🔗 Qwen Chat [3] 🔗 API на Alibaba Cloud [4] 🔗 Блог Qwen [5] 🔗 Hugging Face [6]

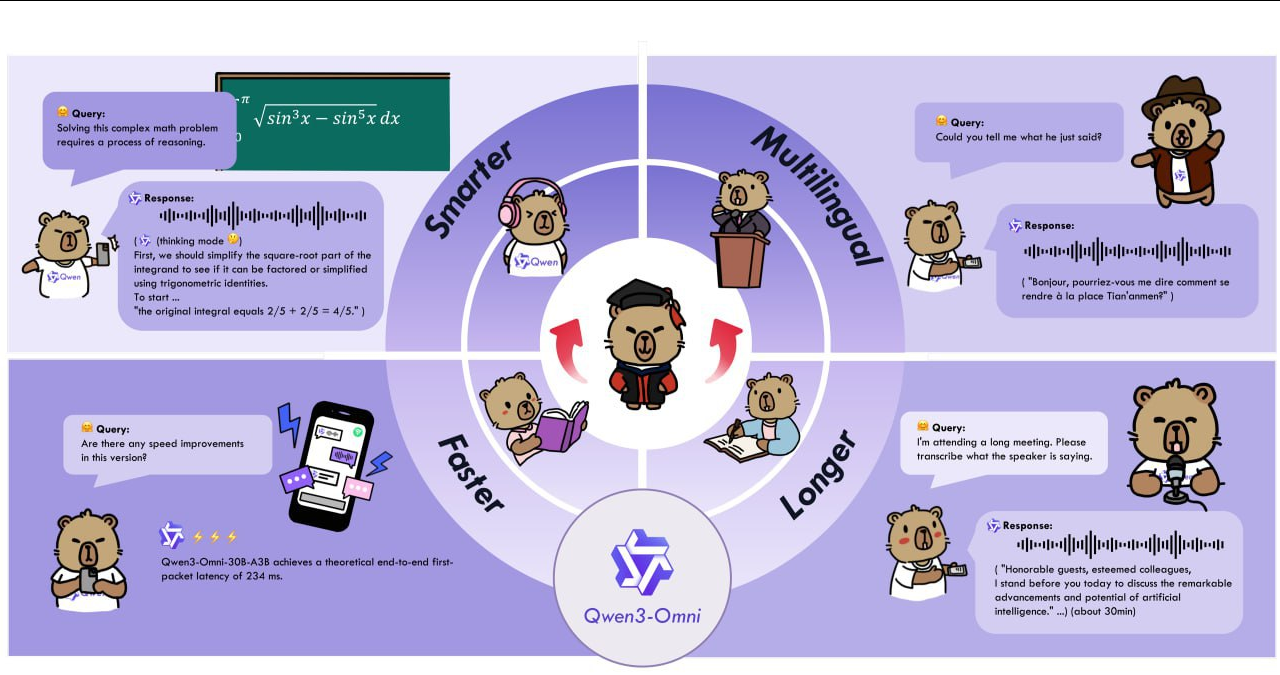

❯ Qwen3-Omni — мультимодальная модель

Alibaba на этой неделе ультанули и представили Qwen3-Omni — первую омнимодальную модель, которая понимает и обрабатывает текст, изображения, аудио и видео напрямую, без промежуточных конвертаций.

В трёх исполнениях:

-

Instruct — понимает все форматы и отвечает текстом или голосом.

-

Thinking — текстовая версия, сильнее в рассуждениях.

-

Captioner — фокусируется на генерации описаний.

Особенности: поддержка 119 языков, включая русский, стриминг текста и речи с задержкой всего 211 мс, работа с аудио длиной до 30 минут и встроенный tool calling. Модель требует от 80 до 160 ГБ видеопамяти, но попробовать её можно бесплатно в Qwen Chat или через демо на Hugging Face.

🔗 Qwen Chat [7] 🔗 Hugging Face [8] 🔗 Презентация [5]

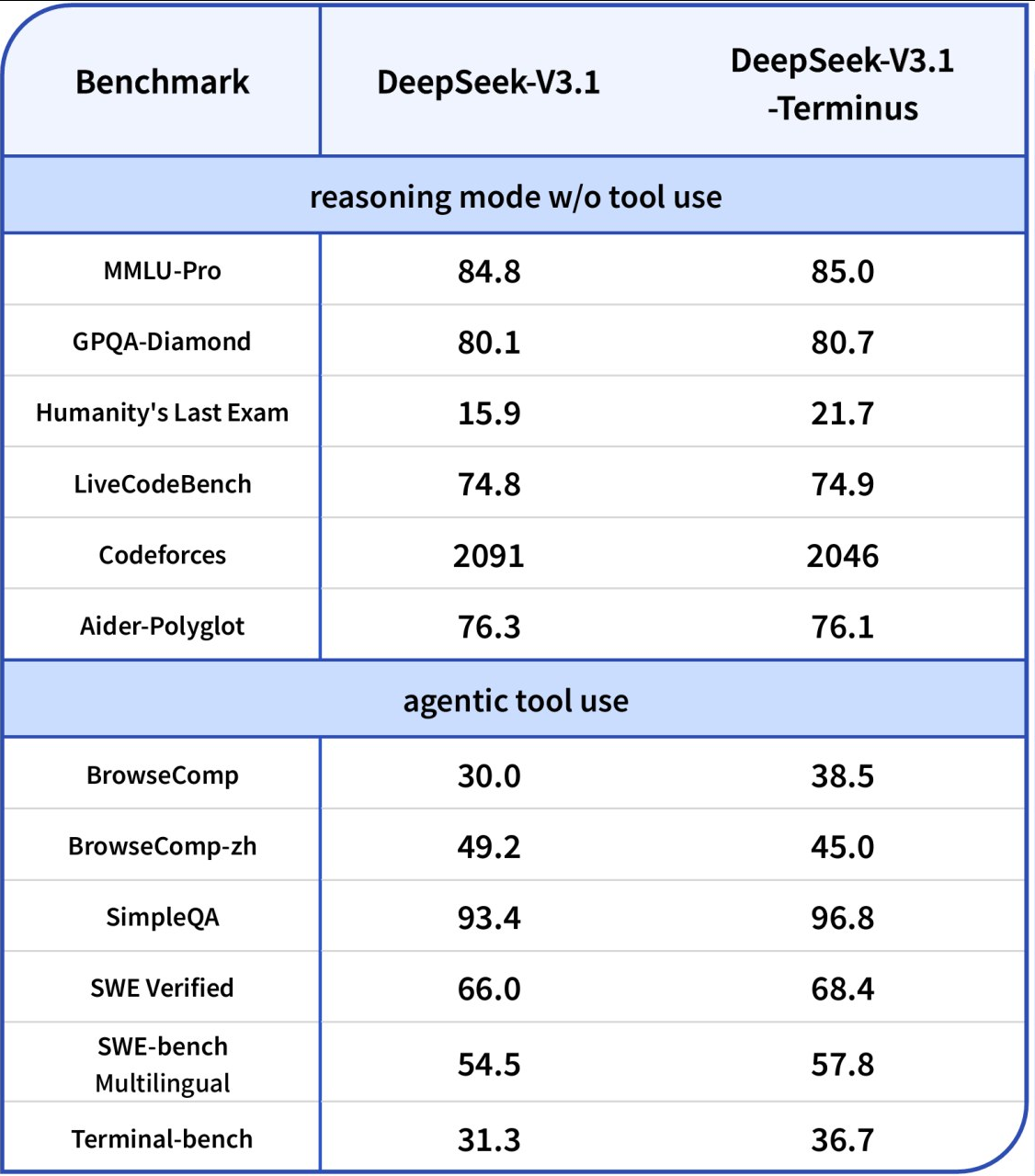

❯ DeepSeek V3.1 Terminus

Команда DeepSeek обновила модель V3.1 и выпустила версию Terminus. Разработчики заявляют, что теперь модель реже срывается на китайский язык и перестала вставлять случайные символы в ответы. Улучшилась работа в агентных сценариях и на специализированных бенчмарках, хотя глобальных изменений по сравнению с базовой V3.1 нет.

Название Terminus намекает, что это финальный релиз линейки V3 — впереди ожидается четвёртая версия, и многие предполагают, что её могут анонсировать к 1 октября, дню образования КНР.

Потестить обновлённую модель можно прямо сейчас в DeepSeek Chat, а веса выложены на Hugging Face.

🔗 DeepSeek Chat [9] 🔗 Hugging Face [10]

❯ ChatGPT Pulse — проактивный ресёрч

OpenAI запустили новую функцию ChatGPT Pulse. Теперь ИИ не ждёт запросов, а сам анализирует недавние чаты, подключённые сервисы и интересы пользователя, чтобы каждое утро выдавать подборку из 5–10 актуальных карточек.

Pulse может предложить план поездки, если в календаре намечен отпуск, напомнить о матчах любимой команды или подобрать свежие исследования по ЗОЖ, если вы интересовались спортом. Система учится на ваших лайках и дизлайках, а также позволяет вручную задавать темы — например, еженедельный план или напоминания о визитах к врачу.

Пока функция доступна только подписчикам Pro ($200/мес) в мобильном приложении ChatGPT, но позже обещают раскатать и на тариф Plus.

🔗 Анонс OpenAI [11]

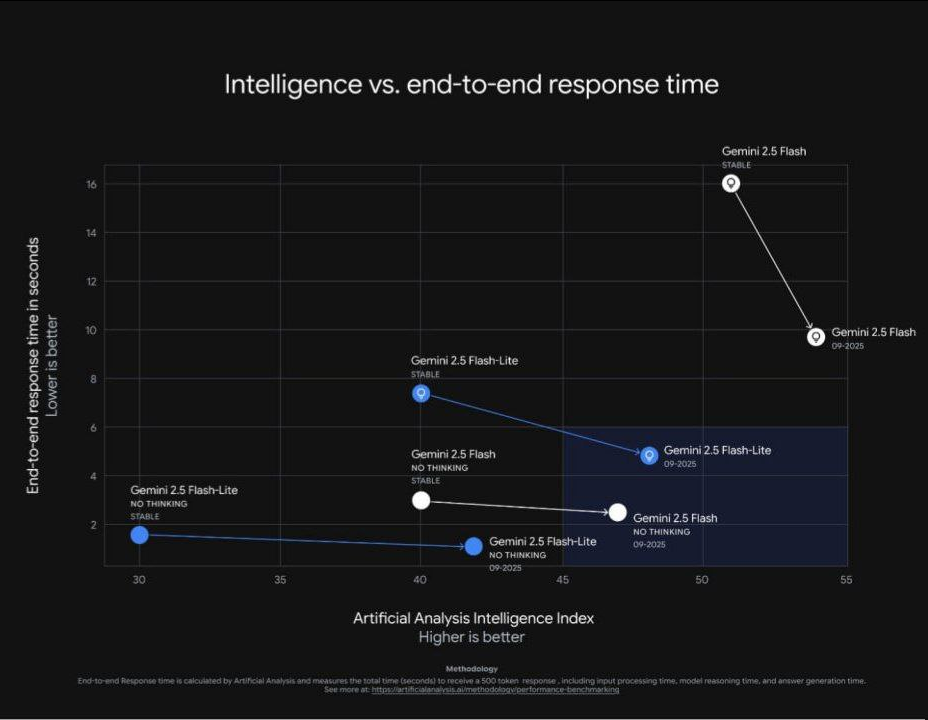

❯ Обновление моделей Gemini

Google обновил линейку Gemini 2.5 Flash и Flash-Lite. Модели стали работать примерно в 1,5 раза быстрее, расходуют на 24–50% меньше токенов на ответ и заметно лучше понимают инструкции. Также улучшена работа с аудио и видео — меньше лишних фраз и ошибок в распознавании.

Основной упор сделан на эффективность: модели стали «умнее» и при этом требуют меньше ресурсов, что важно для разработчиков и интеграторов.

Попробовать обновлённые Gemini можно бесплатно в Google AI Studio.

🔗 Google AI Studio [12] 🔗 Блог Google Developers [13]

🎨 Генеративные нейросети

❯ Обновление модели Qwen-Image-Edit-2509

Alibaba обновили модель Qwen-Image-Edit. Теперь она умеет объединять до трёх изображений в одно и лучше справляется с деталями.

Что улучшили:

-

встроили ControlNet для работы с картами глубины и поз,

-

повысили точность лиц и сохранение идентичности при смене позы или стиля,

-

модель корректно редактирует текст, материалы и шрифты.

Попробовать новую версию можно бесплатно в Qwen Chat и на Hugging Face.

🔗 Qwen Chat [3] 🔗 Hugging Face [14]

❯ Wan 2.5 и обновлённый Wan 2.2 — видео с озвучкой и киношной эстетикой

Свежая Wan 2.5 умеет создавать ролики до 10 секунд в 1080p с озвучкой.

Качество заметно улучшилось по сравнению с предыдущей версией, хотя до уровня Google Veo 3 и Kling 2.5 пока не дотягивает. Цензуры у модели почти нет, а веса закрыты, потестить пока можно только в веб-интерфейсе.

А вот открытую Wan 2.2 параллельно обновили:

-

Mixture-of-Experts архитектура — больше мощности без увеличения затрат

-

Обучена на датасете с метками освещения, композиции и цвета, что даёт «киношную» эстетику и настраиваемый стиль

-

+65% изображений и +83% видео в датасете — лучше понимает сложные движения и динамику

-

версия TI2Vid (5B параметров) выдаёт 720p/24fps и запускается даже на RTX 4090

-

семейство txt2vid, img2vid, speech2vid и animate (14B параметров) уже завезли в ComfyUI.

🔗 Wan 2.5 Demo [15] 🔗 GitHub Wan 2.2 [16] 🔗 Hugging Face Wan 2.2 [17]

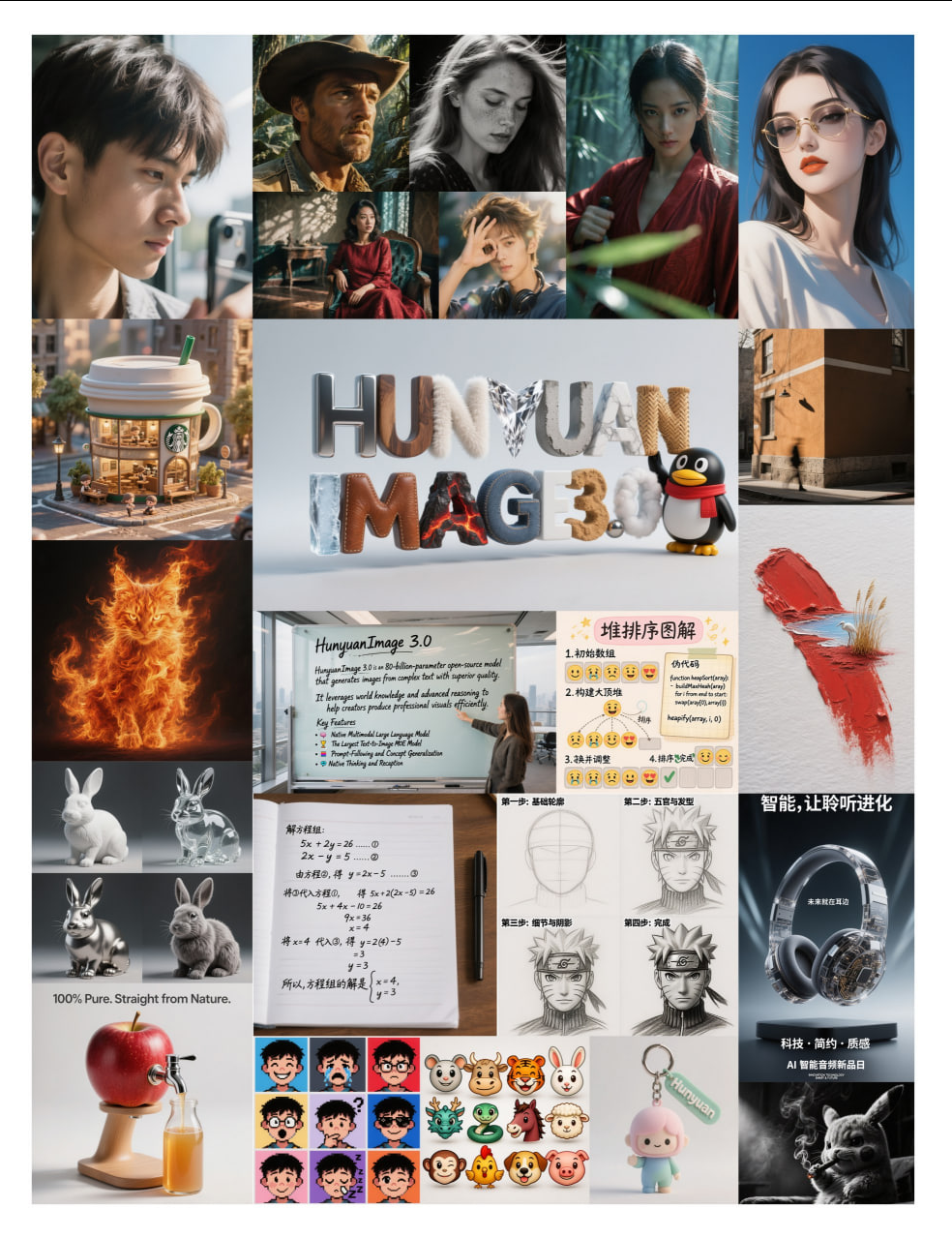

❯ HunyanImage-3.0 — открытая модель от Tencent

Tencent выпустили HunyanImage-3.0 — самую крупную txt2img MoE-модель на сегодня. У неё 80B параметров и 13B активных, поэтому для развёртывания понадобится около 170 ГБ памяти [18].

Модель доступна в открытом доступе и уже выложена на GitHub и Hugging Face. Можно попробовать онлайн-демо на официальном сайте Tencent.

🔗 Демо [19] 🔗 GitHub [20] 🔗 Hugging Face [21]

❯ Suno V5 и AI DAW Suno Studio

Вышла пятая версия Suno — одной из самых популярных нейросетей для генерации музыки. Качество звучания стало выше, вокал чище, а теперь можно генерировать треки даже из собственного вокала, фрагментов видео или фото.

Добавили редактирование нот, инструментов и вокала. Простые жанры вроде попа и техно звучат достойно, а вот сложная электроника пока отстаёт — синты и басы всё ещё «пластиковые».

Вместе с моделью запустили Suno Studio — полноценную браузерную DAW.

В ней можно:

-

экспортировать треки в DAW и конвертировать их в MIDI,

-

генерировать дорожки по отдельности — вокал, ударные, синты,

-

регулировать темп, громкость и питч.

Для продюсеров это мощный инструмент: можно напеть мелодию и превратить её в полноценный трек или использовать Suno Studio как генератор стемов.

🔗 Suno V5 [22] 🔗 Suno Studio [23]

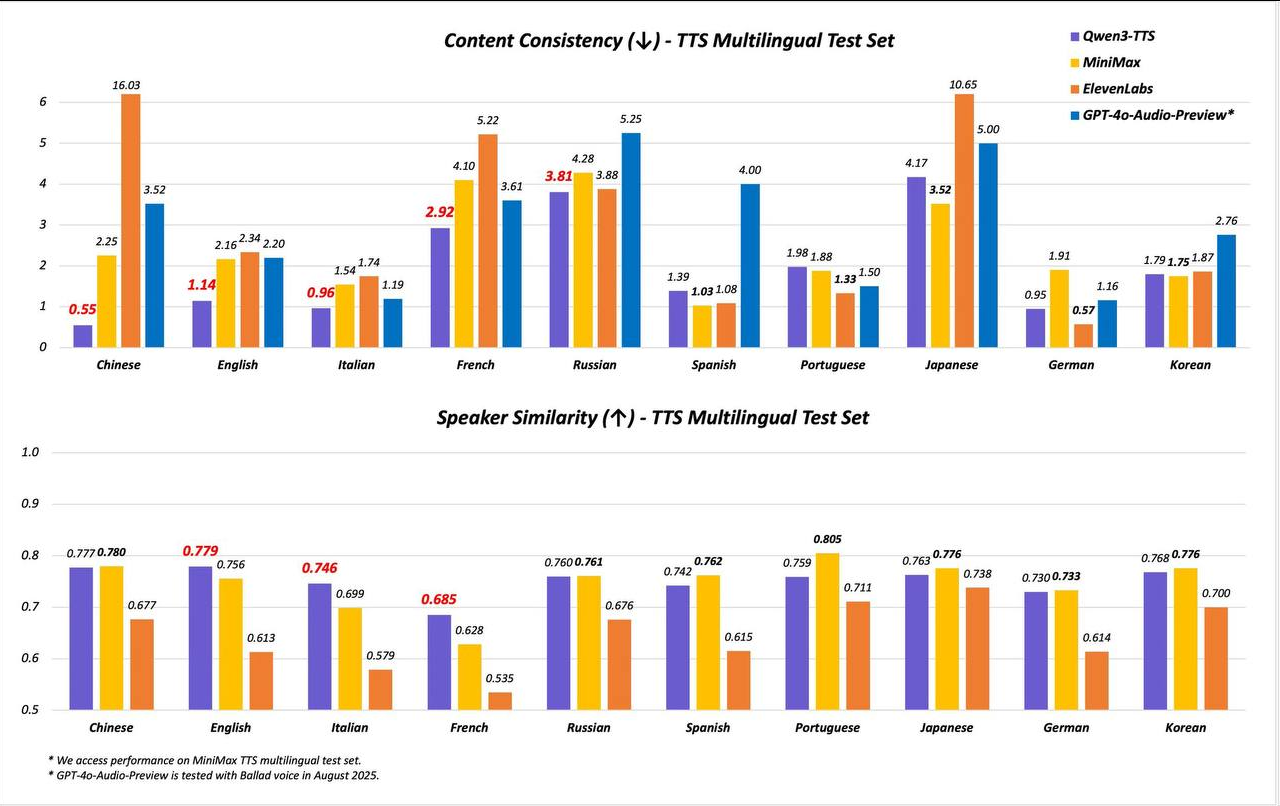

❯ Qwen3-TTS — новая модель для синтеза речи

Alibaba представили Qwen3-TTS — модель, которая уже обходит ElevenLabs и GPT-4o-Audio-Preview по качеству синтеза.

Она поддерживает семнадцать голосов, и каждый из них умеет говорить на десяти языках, включая русский. Задержка генерации минимальна — около 0,1 секунды, а даже под высокой нагрузкой модель работает вдвое быстрее предыдущей версии.

Qwen3-TTS автоматически подстраивает интонацию под стиль текста и делает речь более естественной, чем большинство конкурентов. Это делает её удобной не только для озвучки, но и для интерактивных приложений, где важна быстрая реакция [24] и разнообразие голосов.

🔗 Блог Qwen [25] 🔗 Hugging Face [26]

🔧 AI-инструменты и платформы

❯ Бесплатный ИИ-агент от Kimi

Сервис Kimi запустил нового агента в режиме OK Computer, и он доступен бесплатно.

Агент подключается к удалённому компьютеру и умеет работать с браузером, терминалом и файлами. Можно поручить ему создание сайтов и презентаций, анализ до миллиона строк данных с последующей визуализацией в графиках и дашбордах или даже проведение исследований с оформлением отчётов.

По сути, это инструмент для автономной работы над крупными проектами, который снимает с пользователя рутинные задачи. Попробовать агента можно прямо сейчас на официальном сайте Kimi.

🔗 Kimi [27]

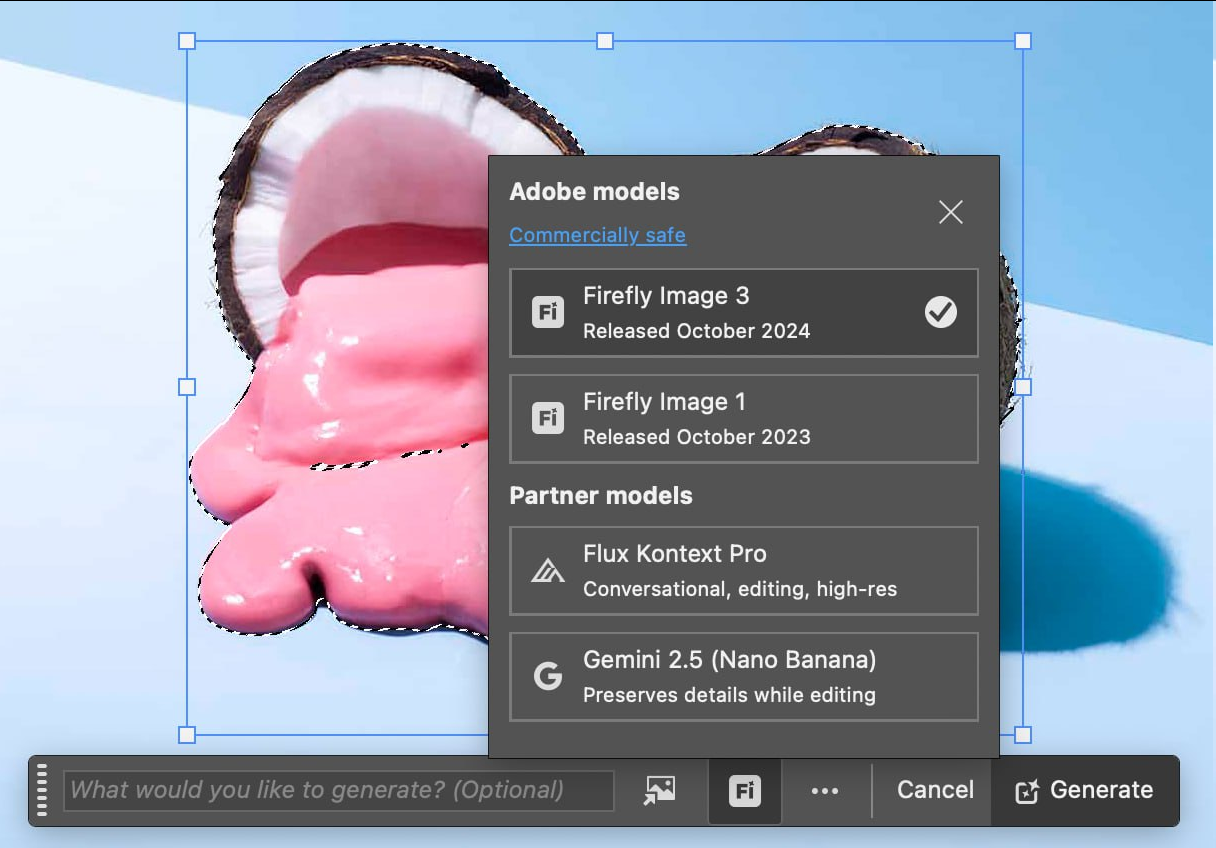

❯ Flux Kontext и Nano Banana теперь в Photoshop

С 25 сентября пользователи Photoshop beta получили доступ к моделям FLUX.1 Kontext Pro и Nano Banana прямо в функции Generative Fill.

Теперь можно выбирать альтернативные ИИ для генерации и доработки изображений.

Модели работают быстрее, а выбор генератора под конкретные задачи позволяет точнее контролировать результат.

Интересно, как это скажется на будущем Firefly.

🔗 Adobe Guide [28] 🔗 BFL AI Blog [29]

🧩 AI в обществе и исследованиях

❯ Женщина выиграла $150 000 благодаря GPT

В США женщина сорвала куш в онлайн-лотерее, использовав комбинацию чисел, которую подсказал ей ChatGPT. Нейросеть угадала 4 из 5 выпавших номеров, и выигрыш составил $150 000.

Необычная история быстро разлетелась по медиа: сама победительница пообещала отдать весь приз на благотворительность, а многие назвали успех «божественным вмешательством».

Хотя вероятность угадывания всё равно оставалась минимальной, кейс показал, что люди готовы доверять ИИ даже в таких сферах.

🔗 New York Post [30]

❯ Magnum будут производить мороженое по рецептам ИИ

Производитель мороженого Magnum разрабатывает новые продукты с помощью ИИ. Компания сотрудничает с чилийским стартапом NotCo, который создаёт системы для анализа рецептуры и подбора ингредиентов.

Нейросети будут использоваться для изменения состава классического мороженого, создания растительных альтернатив и оптимизации производства в условиях роста цен на сырьё.

По словам представителей Magnum, современный потребитель хочет сочетать удовольствие и осознанность — небольшие порции, экологичность и новые вкусы.

Компания NotCo уже помогала Kraft Heinz разрабатывать растительные аналоги майонеза и сыра. Теперь тот же подход используют для мороженого — от снижения сахара и замены красителей до поиска уникальных вкусов, вроде дубайского шоколада.

🔗 Reuters [31]

❯ ChatGPT прямо в Minecraft: LLM на редстоуне

Разработчик под ником sammyuri собрал рабочую копию ChatGPT внутри Minecraft. Проект под названием CraftGPT содержит около 5 млн параметров и полностью функционирует прямо в игре — модель предсказывает следующее слово и поддерживает короткие диалоги.

Правда, контекстное окно всего 64 токена, так что беседа получается короткой.

Но сам факт запуска LLM на редстоуне и командных блоках выглядит как техническое чудо и показывает, насколько гибкой может быть игра как платформа.

🔗 GitHub [33]

❯ Заключение 🌀

На этой неделе китайцы снова в топе: Qwen3-Max подтянулась к GPT-5, а Qwen3-Omni показала настоящий мультимодальный подход. DeepSeek Terminus завершил линейку V3, Google ускорил Gemini, OpenAI добавили ChatGPT Pulse.

В генеративке — апгрейд Wan 2.2 и запуск Wan 2.5 с озвучкой, открытая HunyanImage-3.0 от Tencent и релиз Suno V5 вместе с DAW Suno Studio. Даже Photoshop теперь с альтернативными моделями Flux и Nano Banana.

ИИ всё глубже уходит в реальность: выигрыш в лотерею, новые рецепты Magnum и рабочая LLM прямо в Minecraft напоминают, что у технологий нет границ.

До встречи в следующем выпуске!

Новости, обзоры продуктов и конкурсы от команды [34]Timeweb.Cloud [35] — в нашем Telegram-канале [34] ↩

Автор: Wonderlove

Источник [36]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/20219

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] Вандер: http://t.me/neuroport

[3] Qwen Chat: https://chat.qwen.ai/

[4] API на Alibaba Cloud: https://www.alibabacloud.com/help/en/model-studio/models#c2d5833ae4jmo

[5] Блог Qwen: https://qwen.ai/blog?id=241398b9cd6353de490b0f82806c7848c5d2777d&from=research.latest-advancements-list

[6] Hugging Face: https://huggingface.co/Qwen/Qwen3-Max

[7] Qwen Chat: https://chat.qwen.ai/?models=qwen3-omni-flash

[8] Hugging Face: https://huggingface.co/spaces/Qwen/Qwen3-Omni-Demo

[9] DeepSeek Chat: https://www.deepseek.com/

[10] Hugging Face : https://huggingface.co/deepseek-ai/DeepSeek-V3.1-Terminus

[11] Анонс OpenAI: https://openai.com/index/introducing-chatgpt-pulse/

[12] Google AI Studio: https://aistudio.google.com/prompts/new_chat

[13] Блог Google Developers: https://developers.googleblog.com/en/continuing-to-bring-you-our-latest-models-with-an-improved-gemini-2-5-flash-and-flash-lite-release/

[14] Hugging Face: https://huggingface.co/Qwen/Qwen-Image-Edit-2509

[15] Wan 2.5 Demo: https://create.wan.video/generate/video/image-to-video?model=wan2.5

[16] GitHub Wan 2.2: https://github.com/Wan-Video/Wan2.2?tab=readme-ov-file

[17] Hugging Face Wan 2.2: https://huggingface.co/collections/Wan-AI/wan22-68ac4ae80a8b477e79636fc8

[18] памяти: http://www.braintools.ru/article/4140

[19] Демо: https://hunyuan.tencent.com/image

[20] GitHub: https://github.com/Tencent-Hunyuan/HunyuanImage-3.0

[21] Hugging Face: https://huggingface.co/tencent/HunyuanImage-3.0

[22] Suno V5: https://suno.com/create

[23] Suno Studio: https://suno.com/studio-welcome

[24] быстрая реакция: http://www.braintools.ru/article/1549

[25] Блог Qwen: https://qwen.ai/blog?id=b4264e11fb80b5e37350790121baf0a0f10daf82&from=research.latest-advancements-list

[26] Hugging Face: https://huggingface.co/spaces/Qwen/Qwen3-TTS-Demo

[27] Kimi: https://www.kimi.com/

[28] Adobe Guide: https://helpx.adobe.com/photoshop/using/select-ai-model.html#partner-ai-models

[29] BFL AI Blog: https://bfl.ai/blog/flux1-kontext-now-in-adobe-photoshop-powering-every-pixel

[30] New York Post: https://nypost.com/2025/09/20/lifestyle/woman-wins-150k-lottery-using-chatgpt-and-plans-to-donate-every-penny-to-charity/

[31] Reuters: https://www.reuters.com

[32] vimeo.com: https://vimeo.com/1123744750

[33] GitHub: https://github.com/sammyuri/craftgpt

[34] Новости, обзоры продуктов и конкурсы от команды : https://t.me/timewebru

[35] Timeweb.Cloud: http://Timeweb.Cloud

[36] Источник: https://habr.com/ru/companies/timeweb/articles/952596/?utm_source=habrahabr&utm_medium=rss&utm_campaign=952596

Нажмите здесь для печати.