Учёные представили метод, который ускоряет self-attention до 4.4×

Новая архитектура Adamas предлагает радикальное ускорение механизма внимания [1] до 4.4× быстрее, при сохранении качества даже на длинных контекстах (100k+ токенов).

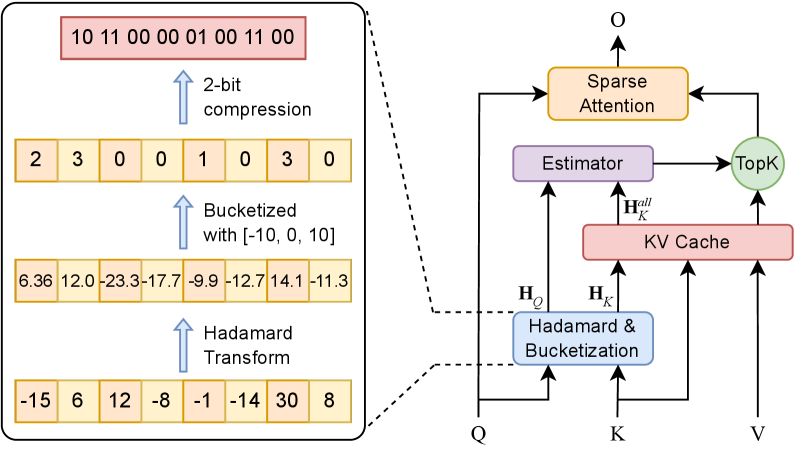

Главная идея — отказаться от сравнения каждого токена со всеми. Вместо этого Adamas динамически выбирает 128 наиболее релевантных токенов для каждого запроса. Чтобы определить релевантность, применяется преобразование Адамара [2]. Оно сглаживает распределение значений и переводит их в 2-битные представления, после чего сходство оценивается с помощью Manhattan-метрики.

Это делает вычисления лёгкими, но точными. В отличие от большинства оптимизаций внимания (Reformer, FlashAttention и т.п.), Adamas не требует переобучения модели. Он вставляется как внешний модуль и совместим с существующими LLM, включая GPT-подобные и Mistral-архитектуры.

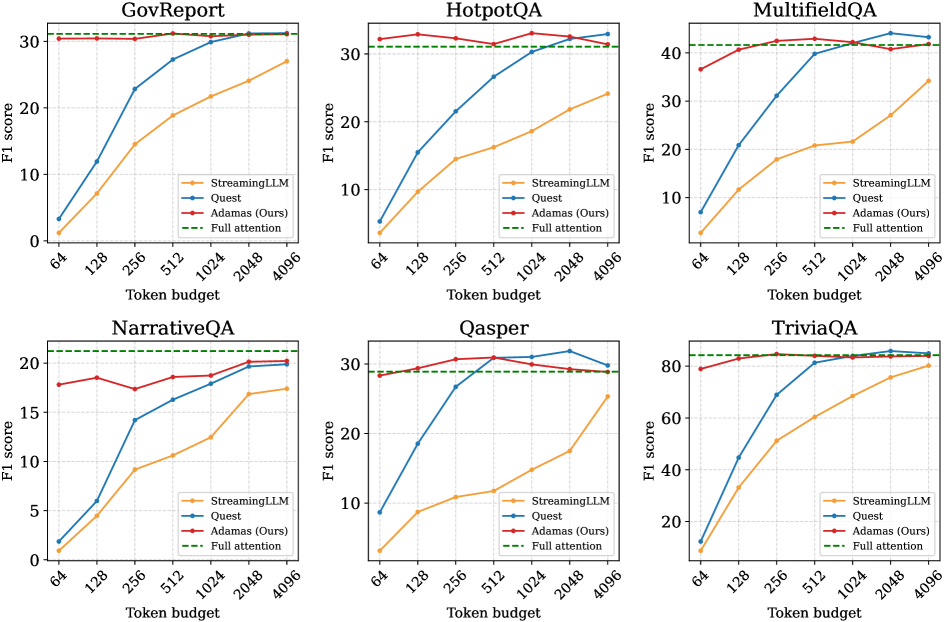

Результаты: ускорение до 4.4× на длинных последовательностях и 1.5× на коротких, с сохранением точности на уровне плотного self-attention. Для разработчиков LLM это означает — в 4 раза быстрее тот же смысл.

Делегируйте часть рутинных задач вместе с BotHub! [3] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [4] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [5]

Автор: cognitronn

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/21105

URLs in this post:

[1] внимания: http://www.braintools.ru/article/7595

[2] преобразование Адамара: https://ru.wikipedia.org/wiki/%D0%9F%D1%80%D0%B5%D0%BE%D0%B1%D1%80%D0%B0%D0%B7%D0%BE%D0%B2%D0%B0%D0%BD%D0%B8%D0%B5_%D0%90%D0%B4%D0%B0%D0%BC%D0%B0%D1%80%D0%B0

[3] BotHub!: https://bothub.chat/?utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_source=contentmarketing&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_medium=habr&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_campaign=news&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_content=SCIENTISTS%20INTRODUCED%20A%20METHOD%20THAT%20SPEEDS%20UP%20SELF-ATTENTION%20BY%204.4%20TIMES

[4] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[5] Источник: https://arxiv.org/abs/2510.18413

[6] Источник: https://habr.com/ru/companies/bothub/news/959936/?utm_source=habrahabr&utm_medium=rss&utm_campaign=959936

Нажмите здесь для печати.