Perplexity научила триллионные ИИ-модели работать без суперкомпьютеров

Perplexity представила научную работу, в которой описала технологию запуска моделей с триллионом параметров на обычных кластерах AWS. Раньше для этого требовались специализированные GPU-сети с поддержкой GPUDirect Async, но инженеры компании нашли способ обойти ограничение.

Они создали собственные ядра параллелизма, где центральный процессор координирует обмен данными между видеокартами. Токены упаковываются и передаются через RDMA-соединения, что позволяет совмещать вычисления и пересылку данных почти без потерь производительности.

Результат впечатляет: тесты показали, что многосерверная система AWS с новой архитектурой работает почти так же быстро, как единый GPU-кластер. Это делает платформу AWS EFA пригодной для инференса гигантских моделей вроде DeepSeek V3 и Kimi K2 без необходимости строить собственные дата-центры.

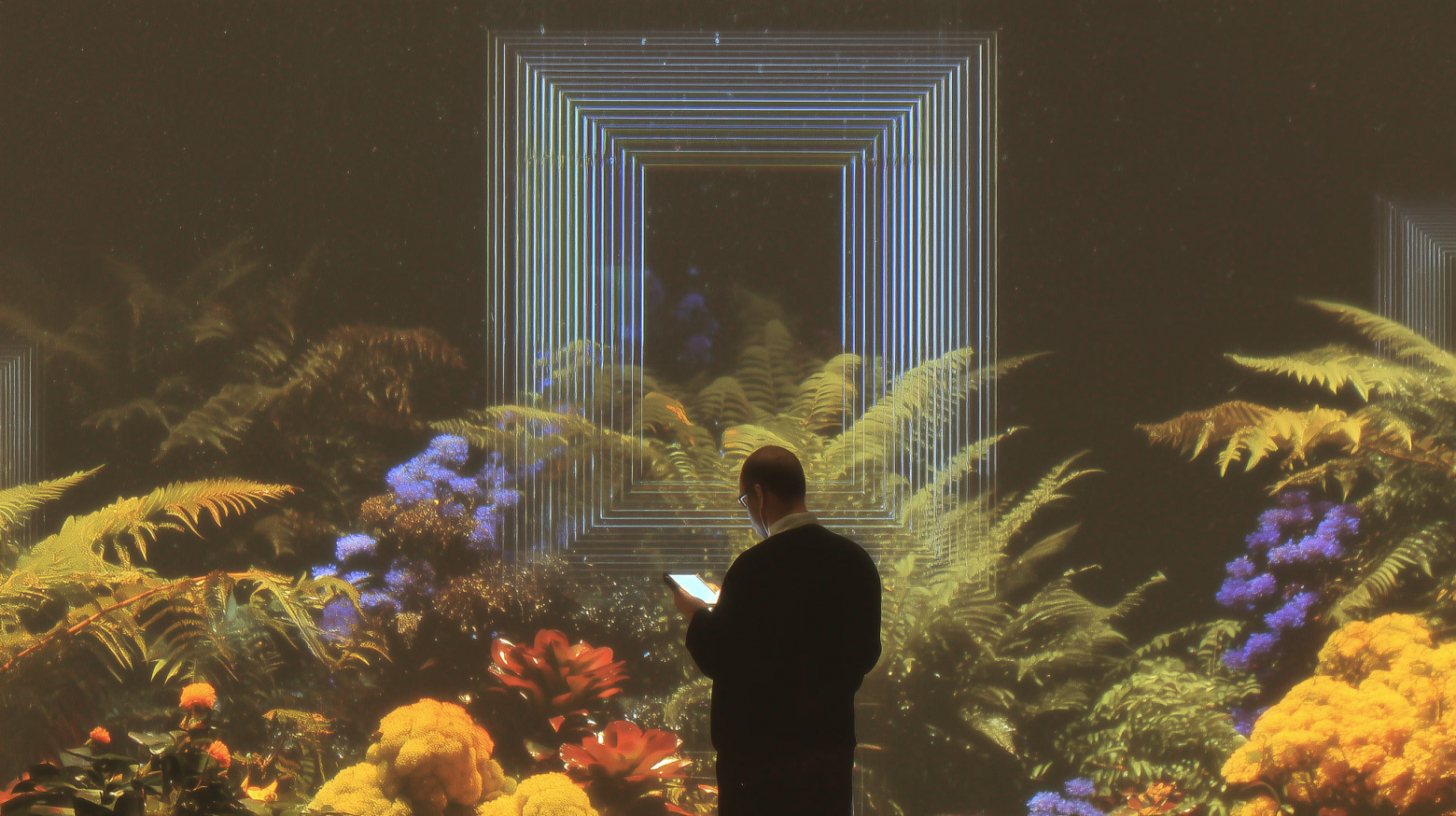

Если раньше тренировать триллионную модель могли только OpenAI или Anthropic, то теперь подобные эксперименты становятся возможны и для небольших лабораторий. По сути, Perplexity открыла дверь в эпоху, где масштаб больше не требует миллиардных инвестиций в инфраструктуру.

Делегируйте часть рутинных задач вместе с BotHub! [1] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [2] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [3]

Автор: cognitronn

Источник [4]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/21626

URLs in this post:

[1] BotHub!: https://bothub.chat/?utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_source=contentmarketing&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_medium=habr&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_campaign=news&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_content=MICROSOFT%20AZURE%20SURPASSED%20THE%20INFERENCE%20BARRIER%20OF%201%20MILLION%20TOKENS%20PER%20SECOND

[2] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[3] Источник: https://research.perplexity.ai/articles/enabling-trillion-parameter-models-on-aws-efa

[4] Источник: https://habr.com/ru/companies/bothub/news/963922/?utm_source=habrahabr&utm_medium=rss&utm_campaign=963922

Нажмите здесь для печати.