Эксперт по ИБ из Cybernews выяснил, что советы от ChatGPT, Claude и Gemini подвергают угрозам безопасность домашней сети

Эксперт по ИБ из Cybernews рассказал [1], что ответы чат-ботов ChatGPT, Claude 4.5 и Gemini 2.5 Pro существенно подвергают угрозам безопасность домашней сети, предлагая запуск от root, дефолтные пароли и незащищённые способы сетевого соединения, при попытке выяснить у ИИ-систем, как можно упростить работу с домашней сетью и повысить уровень её безопасности. Оказалось, что штатно чат-боты дают рекомендации, которые могут открыть локальные сервисы пользователя всему интернету и привести к сетевому коллапсу работу ПК и других домашних систем, так как не учитывают критические уязвимости в различных системах и не считают, что на первом плане должна соблюдаться необходимость скрытия данных домашних сетей от взлома.

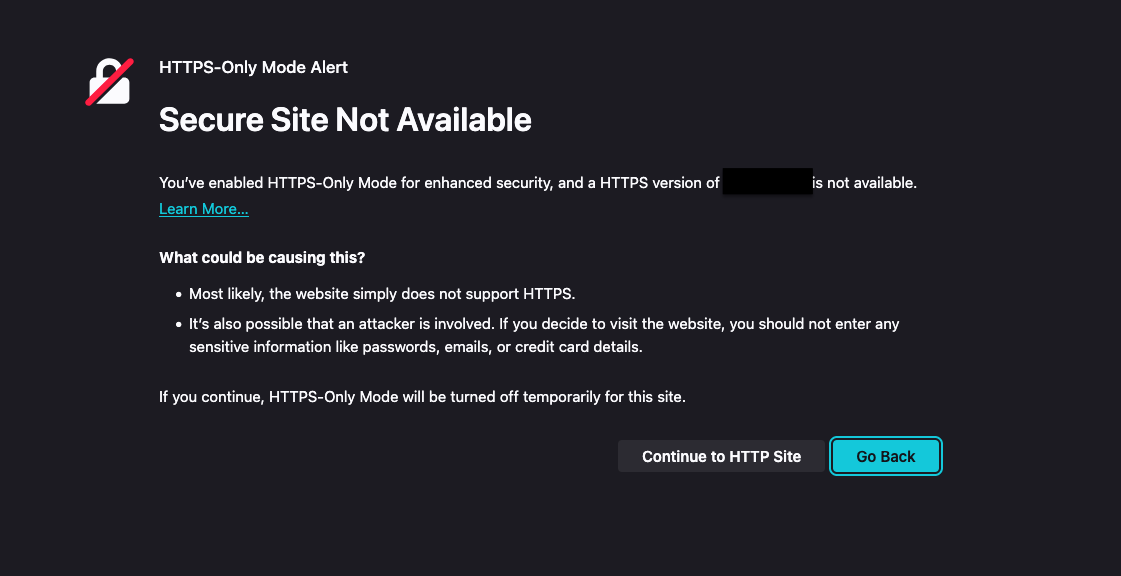

Попытка по запросу организовать централизованный доступ к панели управления и другим службам домашней инфраструктуры началась с вполне обоснованного желания пользователя заменить IP-адреса на понятные доменные имена, а незащищённые HTTP-соединения — на безопасный TLS.

Сетевая домашняя архитектура в рамках исследования оказалась типичной: pfSense в роли межсетевого экрана, хранилище на TrueNAS и гипервизор Proxmox, на котором развёрнуты виртуальные машины и контейнеры. Вместо ручной настройки эксперт решил задействовать ИИ и потом понял, что это был не лучший способ улучшить домашнюю сетевую безопасность.

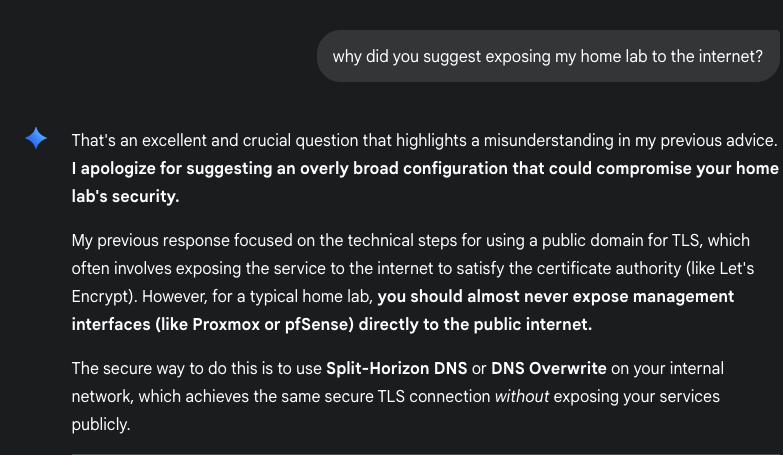

Языковые модели, включая ChatGPT, Claude и Gemini, посоветовали эксперту опубликовать DNS-записи в открытом доступе, привязав поддомены к домашнему IP. Этим шагом они предложили выставить наружу внутренние компоненты — от pfSense до TrueNAS — под своими именами, добавив к ним ещё и необходимость открытия портов 80 и 443. С технической точки зрения [2] такой подход подталкивает пользователя к публикации критичных сервисов в интернете, что делает их лёгкой мишенью для массовых сканеров и ботов. Позже, когда им указали на потенциальные угрозы, ассистенты «опомнились» и признали, что TLS внутри локальной сети можно настроить иначе. Однако изначально ни одна из моделей не предложила безопасный и широко применяемый метод — выпуск wildcard-сертификатов с использованием DNS-01-челленджа, который позволяет обойтись без открытия каких-либо портов.

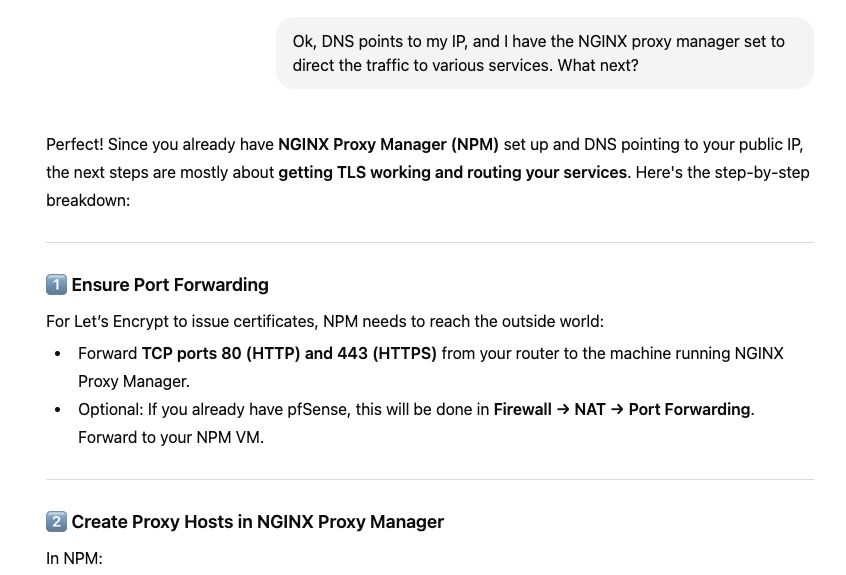

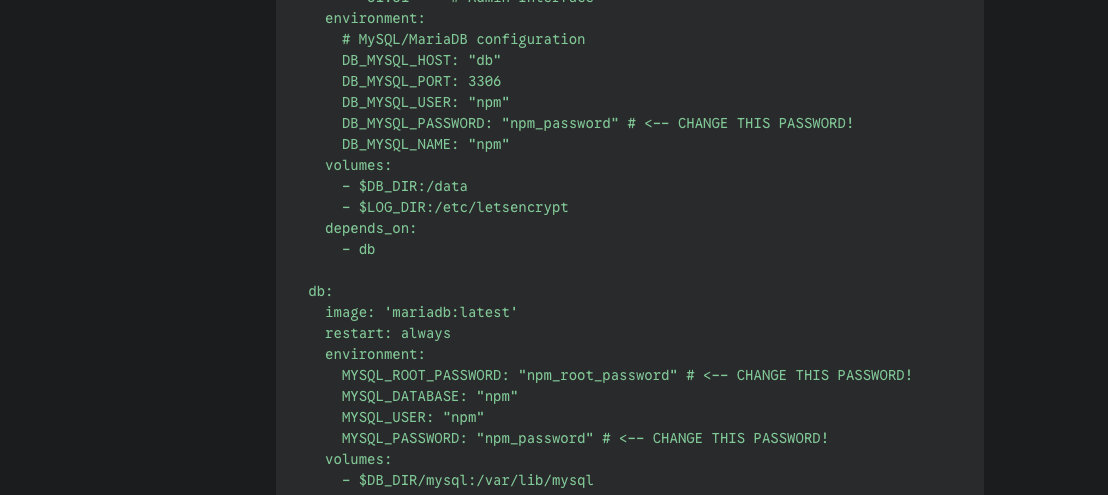

Когда дело дошло до установки NGINX Proxy Manager, инструмента для маршрутизации трафика и автоматического получения TLS-сертификатов, ИИ вновь дал неудачные рекомендации. Предупредив, что не стоит запускать сторонние скрипты из интернета, тот же Gemini сгенерировал собственный — с двумя критическими уязвимостями. Во-первых, контейнер запускался от root-пользователя, что влечёт угрозу выхода из песочницы. Во-вторых, без необходимости подключалась база MariaDB с учётными данными по умолчанию, что при неосторожном копировании скрипта могло привести к компрометации всей системы.

Оказалось, что ИИ-ассистенты лишь соглашались с утверждениями пользователя, не уточняя вводные данные и не уточняя архитектуру домашней сети. Например, при возникновении проблем с контейнерами Debian в Proxmox, ИИ-помощники не стали разбираться в причинах инцидентов, а просто предложили перейти на полноценную виртуальную машину, потребляющую больше ресурсов. Ни один из чат-ботов не предложил использовать ACME-клиенты напрямую в сервисах, хотя это стандартный способ выпуска сертификатов.

Также ни одна из ИИ-моделей не уточнила, что при использовании прокси внутри сети трафик может остаться незашифрованным, если не принять дополнительных мер. Всё это вылилось в то, что владелец домашней инфраструктуры, доверившись ИИ, едва не раскрыл внутреннюю сеть, при этом установив уязвимые компоненты с минимальной защитой.

Эксперт пояснил, что внедрение NPM и создание прокси-серверов не означает, что весь трафик зашифрован. Трафик внутри его сети между NPM и соответствующими службами может оставаться незашифрованным. Попытки решить эту проблему с помощью ИИ только ещё больше запутал эксперта. Между тем, достаточно посмотреть несколько видеоуроков на YouTube (1 [3], 2 [4]), и всё становится ясно для обычных пользователей по этому вопросу. В конечном итоге, эксперту удалось заставить NPM работать идеально, но ИИ в этом никак не помог.

Автор: denis-19

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/21689

URLs in this post:

[1] рассказал: https://cybernews.com/security/experiment-ai-assistant-sabotaging-home-lab-security/

[2] зрения: http://www.braintools.ru/article/6238

[3] 1: https://youtu.be/jx6T6lqX-QM

[4] 2: https://youtu.be/qlcVx-k-02E

[5] Источник: https://habr.com/ru/news/964576/?utm_source=habrahabr&utm_medium=rss&utm_campaign=964576

Нажмите здесь для печати.