CUDA L2 показывает, что ИИ может писать GPU ядра быстрее инженеров NVIDIA

Исследовательская команда DeepReinforce представила систему CUDA L2, которая автоматически генерирует GPU код для матричного умножения и делает это так эффективно, что созданные ею HGEMM ядра обгоняют cuBLAS и cuBLASLt в среднем на 10–30 процентов. Эти библиотеки создаются вручную специалистами NVIDIA и считаются эталоном оптимизации, поэтому такой результат вызвал серьёзный интерес [1] в индустрии.

CUDA L2 полностью меняет привычный подход к оптимизации. Вместо применения фиксированных шаблонов и небольших корректировок параметров, система использует связку большой языковой модели и обучения [2] с подкреплением [3]. LLM пишет CUDA ядро с нуля под конкретный размер матрицы, а цикл RL выполняет сгенерированный код на реальном железе, измеряет скорость и корректность, затем обновляет модель. Процесс повторяется до тех пор, пока LLM не находит максимально производительный вариант. За счёт этого итоговый код не привязан к человеческим шаблонам и свободно меняет глубинные аспекты ядра: стратегию тайлинга, структуру циклов, схему паддинга и даже свизл паттерны.

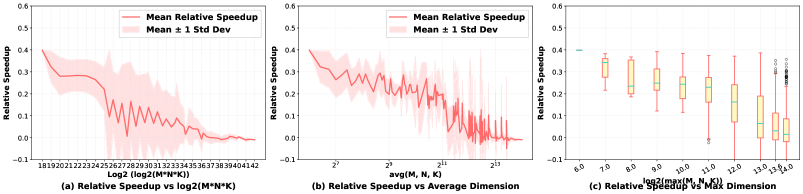

В роли генератора использовалась DeepSeek 671B, прошедшая дополнительное обучение на массиве CUDA ядер и высококачественном коде из PyTorch, ATen, CUTLASS и примеров NVIDIA. Отдельное преимущество состоит в том, что CUDA L2 обрабатывает около тысячи реальных конфигураций матриц, а не несколько типовых размеров, поэтому ускорение распространяется на большее количество практических сценариев.

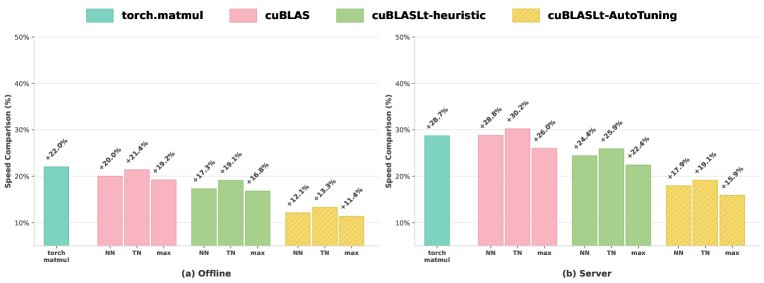

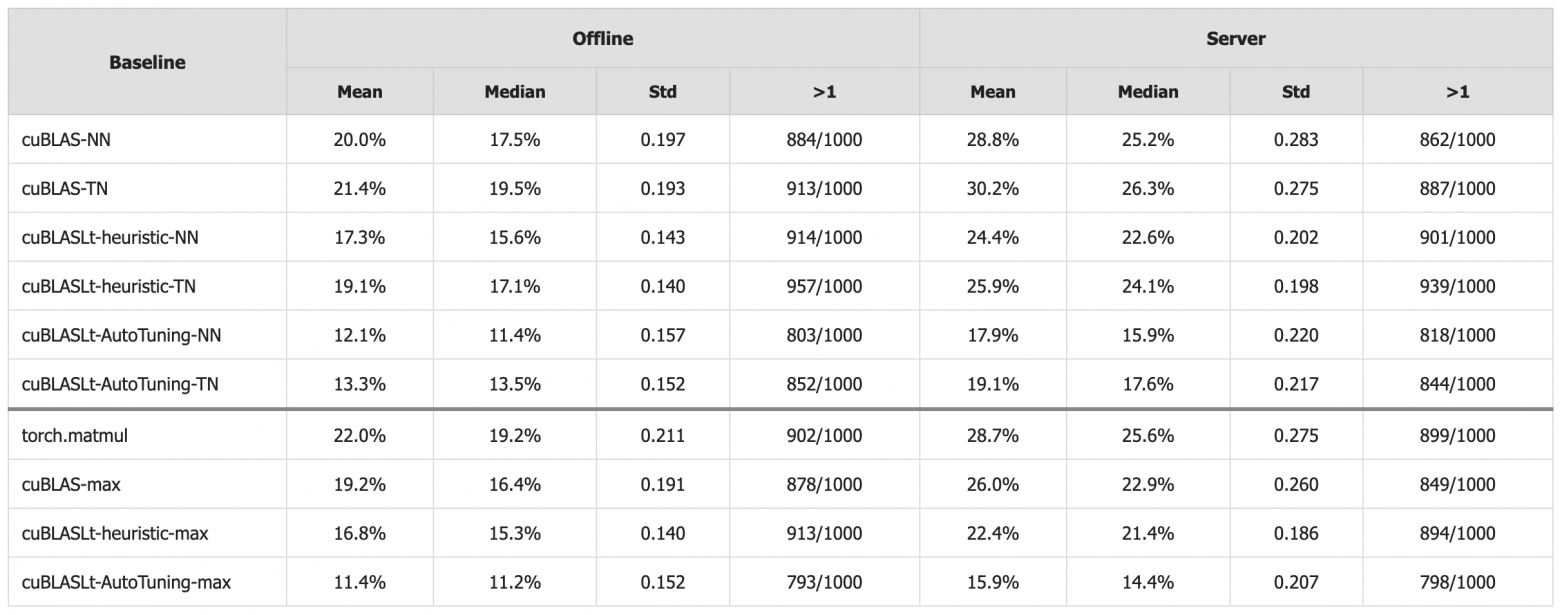

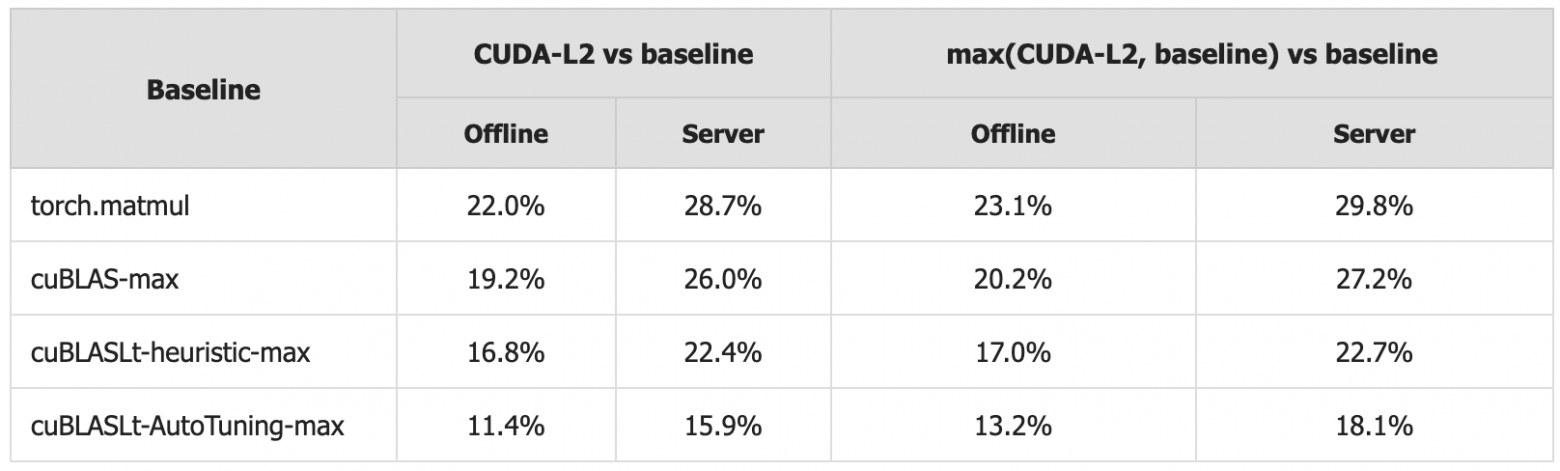

Тесты подтверждают результат. В оффлайн режиме система в среднем на 17–22 процентов быстрее torch.matmul, cuBLAS и cuBLASLt. Даже расширенное автотюнинг решение cuBLASLt AutoTuning уступило примерно на 11 процентов. В серверном сценарии, который лучше отражает реальные условия инференса, ускорение выросло до 24–29 процентов. Для обучающих пайплайнов это означает ощутимое снижение затрат, поскольку HGEMM занимает значительную часть времени в претрейне и файнтюне моделей.

Авторы выкладывают практические результаты, включая набор оптимизированных A100 ядер для тысячи конфигураций. В планах расширение метода на архитектуры Ada Lovelace, Hopper и Blackwell, а также поддержка более плотных конфигураций и 32 битных вариаций HGEMM. В индустрии отмечают, что подход CUDA L2 может стать новым стандартом оптимизации, где языковые модели выступают полноценными инженерами по производительности.

Делегируйте часть рутинных задач вместе с BotHub! [4] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [5] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [6]

Автор: cognitronn

Источник [7]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/22804

URLs in this post:

[1] интерес: http://www.braintools.ru/article/4220

[2] обучения: http://www.braintools.ru/article/5125

[3] подкреплением: http://www.braintools.ru/article/5528

[4] BotHub!: https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=DEEPSEEK-OCR%20+%20LLAMA4%20+%20RAG%20=%20REVOLUTION%20IN%20THE%20WORLD%20OF%20AGENT-BASED%20OCR

[5] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[6] Источник: https://arxiv.org/pdf/2512.02551

[7] Источник: https://habr.com/ru/companies/bothub/news/973854/?utm_source=habrahabr&utm_medium=rss&utm_campaign=973854

Нажмите здесь для печати.