Энтузиаст представил «разговорный ИИ» весом 40 КБ

Энтузиаст выложил [1] на GitHub проект Z80-μLM — языковой модели, которая весит всего 40 КБ. Её можно запускать на 8-битном процессоре Z80.

Z80-μLM — это 2-битная квантованная языковая модель, работающая на процессоре Z80 с 64 КБ ОЗУ. Вся система: вывод, веса, интерфейс чата — помещается в файл .COM размером 40 КБ.

Из-за ограничений автор пошёл на компромиссы: хеширование триграмм (устойчивое к опечаткам, но с нарушением порядка слов), применил 16-битную целочисленную математику [2] и тщательную обработку обучающих данных.

Ключевым моментом стало обучение [3] с учетом квантования, точно моделирующее ограничения кода вывода. Цикл обучения выполняет параллельные проходы с квантованием как чисел с плавающей запятой, так и целых, оценивая модель по тому, насколько хорошо её знания сохраняются после квантования. Веса постепенно смещаются в сторону 2-битной сетки с помощью прямых оценок, при этом штрафы за переполнение соответствуют ограничениям 16-битного Z80. К концу обучения модель адаптируется к своим ограничениям, отметил автор..

По его словам, всего было потрачено несколько долларов на API Claude, чтобы сгенерировать данные для 20 вопросов.

Автор отмечает, что модель можно обучать на Python, а также экспортировать в виде бинарных файлов CP/M .COM.

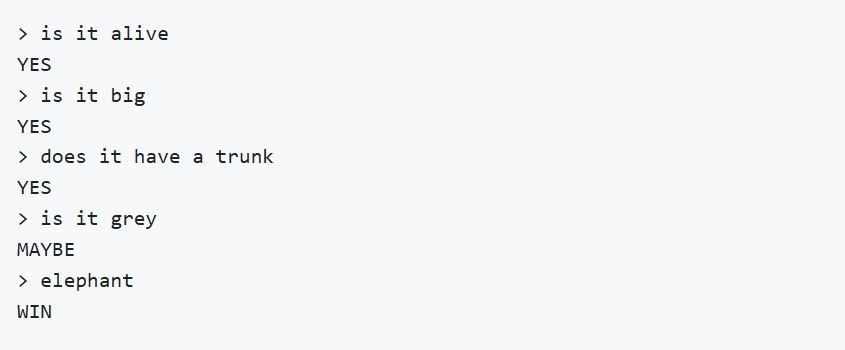

«Она не будет писать вам электронные письма, но её можно обучить играть в упрощённую версию игры “20 вопросов”, и иногда она способна поддерживать иллюзию простых, но лаконичных разговоров с ярко выраженной индивидуальностью», — заключил он.

Автор: maybe_elf

Источник [4]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/23863

URLs in this post:

[1] выложил: https://github.com/HarryR/z80ai

[2] математику: http://www.braintools.ru/article/7620

[3] обучение: http://www.braintools.ru/article/5125

[4] Источник: https://habr.com/ru/news/981780/?utm_source=habrahabr&utm_medium=rss&utm_campaign=981780

Нажмите здесь для печати.