Нейро-дайджест: ключевые события мира AI за 1-ю неделю января 2026

Привет, это новый выпуск «Нейро-дайджеста» — коротких и полезных обзоров ключевых событий в мире искусственного интеллекта [1] и технологий.

Меня зовут Вандер [2], и каждую неделю я обозреваю новости о нейросетях и ИИ.

Неделя выдалась насыщенной: китайцы выкатили MiniMax-M2.1 для кодинга и агентных задач, новая мультимодальная опенсорс LTX-2 и обновлённый Qwen-Image-2512. ИИ для документаций, озвучка текста в браузере и штрафы за нейро-видео.

Всё самое важное — в одном месте. Поехали!

📋 В этом выпуске:

🧠 Модели и LLM

-

Новая модель для кодинга от китайцев

-

Z80-LM — нейросеть, которая весит 40 КБ

🎨 Генеративные нейросети

-

Открытая LTX-2 — синхронные видео и аудио

-

Обновление Qwen-Image 2512

-

FLUX.2 [dev] Turbo — быстрее и дешевле

🔧 AI-инструменты и платформы

-

Documentation AI — ИИ для документаций

-

Озвучка текста в браузере — IMS Toucan

-

Курс по Claude Code от Anthropic

🧩 AI в обществе и исследованиях

-

Штрафы за ИИ-видео

-

ИИ-стримерша — топ Twitch

-

Парень сделал бота, который общается с его девушкой

-

Unitree H2 — железный Брюс Ли

-

Тема выпуска

🧠Модели и LLM

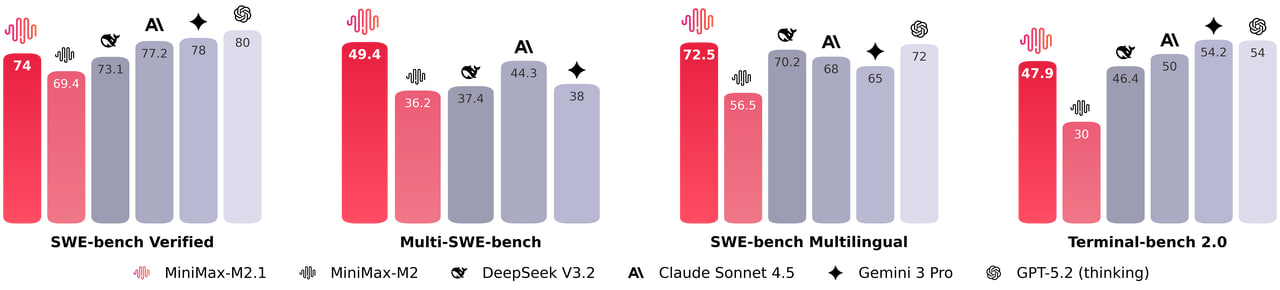

❯ MiniMax-M2.1 — открытая модель для кодинга

Открытая MiniMax-M2.1 заточена под написание кода, долгое планирование и агентные системы. Уверенно кодит приложения с нуля и хорошо показывает себя в Rust, Java и Go.

На бенчмарке Multi-SWE-bench нейронка набрала 49.4% — это выше, чем у Claude Sonnet 4.5. В тестах VIBE на разработку веб-сервисов точность доходит до 91.5%.

Веса и API уже доступны, поддерживает SGLang, vLLM и Transformers. Бесплатно попробовать можно прямо в VS Code через расширение Koda — достаточно войти через GitHub.

🔗 Hugging Face [3] 🔗 Документация API [4] 🔗 Анонс [5]

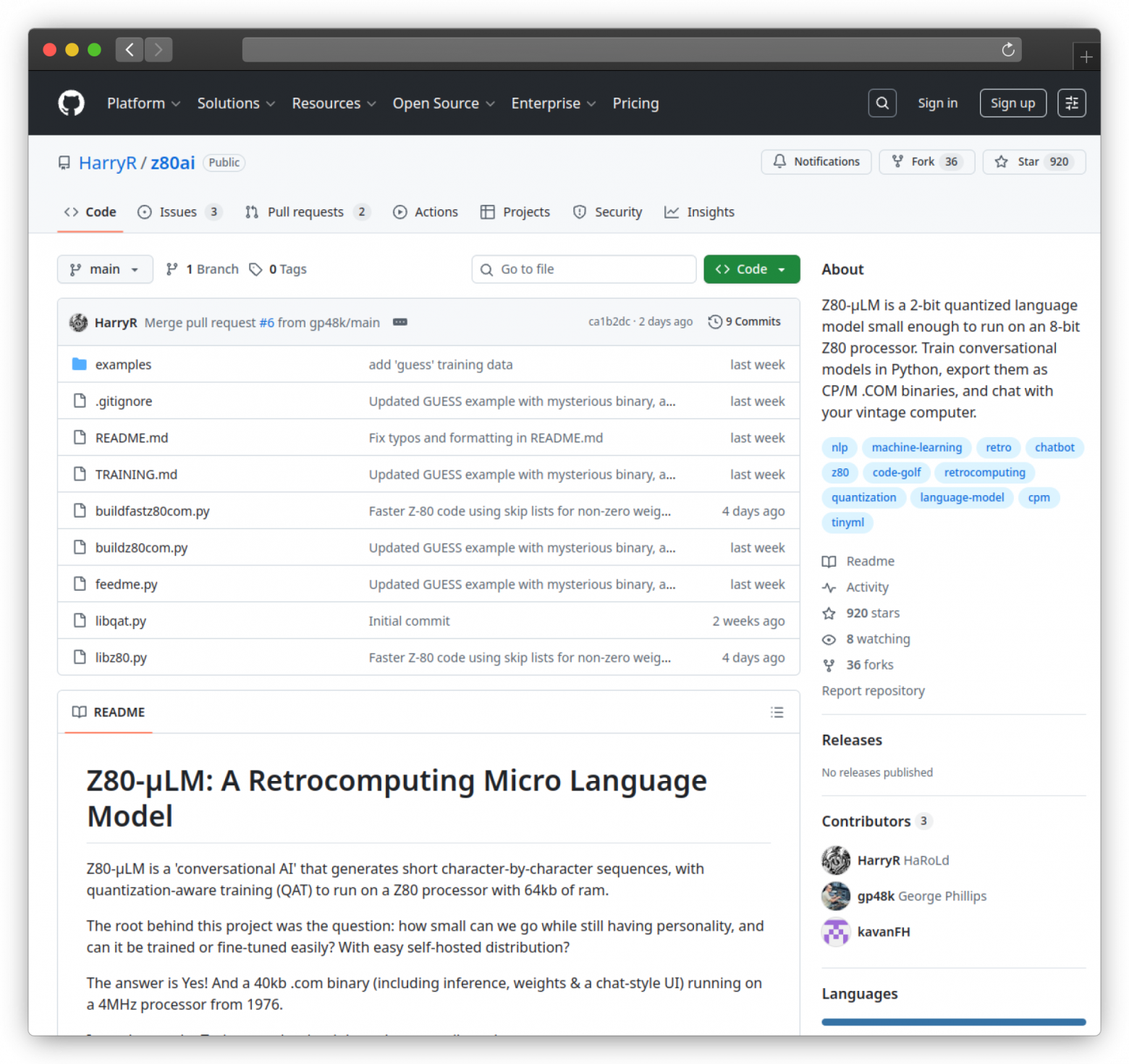

❯ Z80-LM — нейросеть размером 40 КБ

Z80-LM — языковая модель, которая работает на процессоре Z80 с частотой 4 МГц и всего 64 КБ ОЗУ. Весь движок, веса и интерфейс умещаются в 40 КБ исполняемого файла.

Модель генерирует текст символ за символом и не понимает язык в привычном смысле, а реагирует на форму запроса.

Входной текст разбивается на группы по три символа, и каждая группа отправляется в одну из 128 «корзин» для быстрой сортировки и будущего поиска. При этом порядок слов не важен, а опечатки не критичны. Ответы выдаёт в 1–2 слова.

Под капотом — максимальное упрощение, как на старых ПК: все вычисления сведены к использованию всего четырёх чисел (–2, –1, 0, +1), применяется только арифметика с целыми числами без сложных дробных вычислений. Ключевая часть программы написана на базовом языке для старых процессоров Z80.

Два режима:

-

TinyChat — чат-бот с очень краткими и сдержанными ответами.

-

Guess — игра в «угадайку», где модель отвечает только ДА / НЕТ / МОЖЕТ БЫТЬ.

Проект не претендует на интеллект и уж тем более бенчмарки, но это наглядный пример, насколько маленькой может быть LLM, если отбросить всё лишнее — и именно этим он цепляет.

🔗 GitHub [6]

🎨 Генеративные нейросети

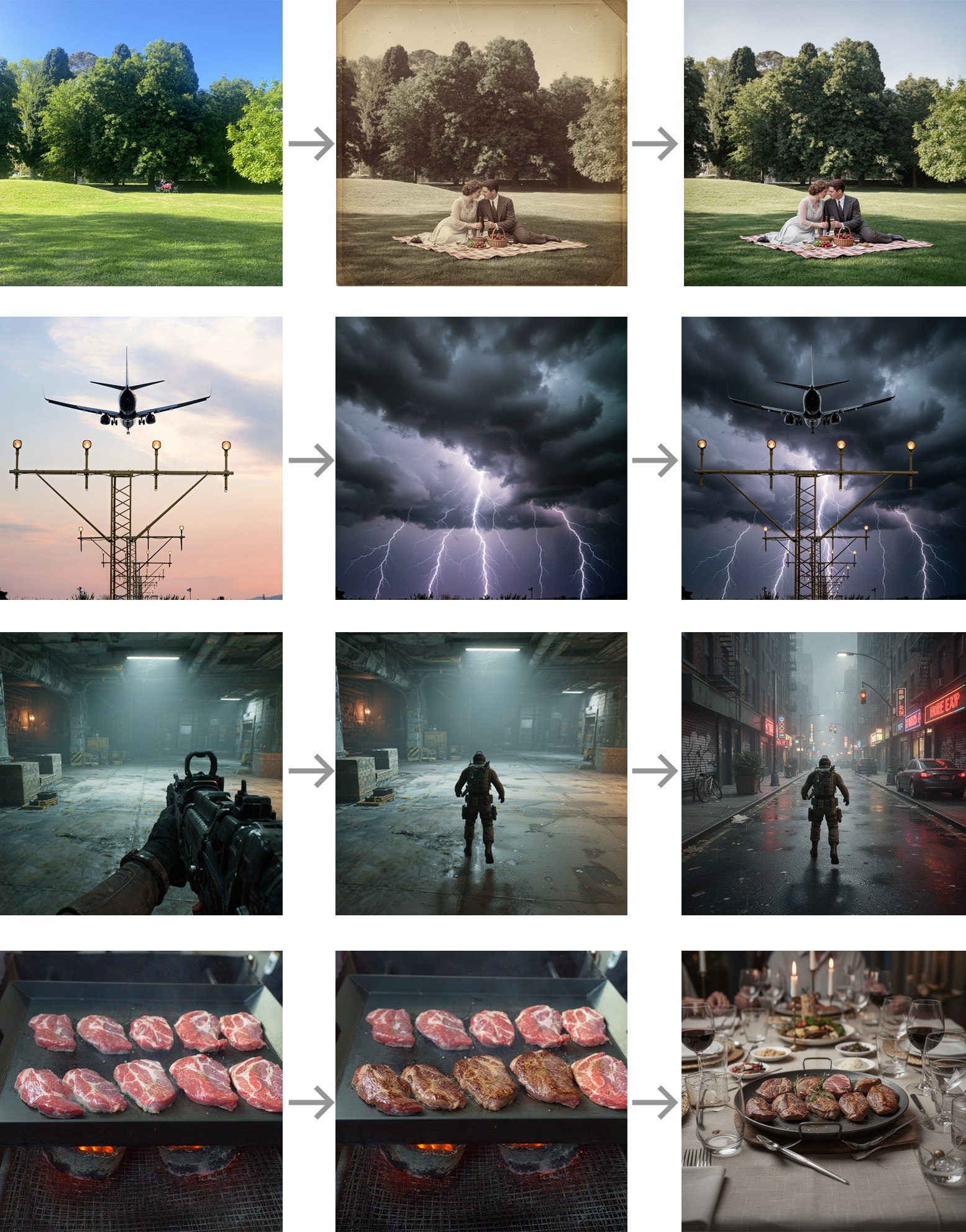

❯ Открытая LTX-2

Компания Lightricks открыла веса LTX-2 — мультимодальной модели для синхронной генерации видео и аудио. Это первая открытая модель, которая умеет генерировать нативное 4K-видео при 50 FPS с диалогами, музыкой и SFX длиной до 20 секунд.

Модель не теряет идентичность персонажей, точно синхронизирует губы и речь и хорошо держит сложные сцены с движениями камеры. Управляется через ключевые кадры, есть LoRA-адаптеры для кастомных стилей и полноценная 3D-логика камеры. Принимает текст, изображения, видео, аудио и карты глубины.

В релизе веса, инференс-пайплайны, код для обучения [7] и документация. Есть основная и дистиллированная версии, оптимизация под экосистему NVIDIA, включая NVFP8 и поддержка ComfyUI.

🔗 Hugging Face [8] 🔗 GitHub [9] 🔗 Техрепорт [10] 🔗 ComfyUI [11] 🔗 Попробовать [12]

❯ Обновление Qwen-Image-2512

Alibaba обновили открытую Qwen-Image. По результатам слепых тестов на AI Arena, сейчас это лидер среди открытых решений.

Главный упор сделали на фотореалистичность лиц, а так же на текст и данные без артефактов. Рисует сложные диаграммы, постеры и презентационные слайды без ошибок в буквах. Понимает детальные промпты с множеством параметров и строго соблюдает заданную композицию.

Потестить можно бесплатно в чате с Qwen. Для запуска в ComfyUI теперь достаточно 14 ГБ видеопамяти — есть подробный гайд и GGUF-веса.

🔗 Демо в Qwen Chat [13] 🔗 Гайд ComfyUI [14] 🔗 Hugging Face [15] 🔗 GGUF [16]

❯ FLUX.2 [dev] Turbo — быстрее и дешевле

На fal.ai [17] появилась FLUX.2 [dev] Turbo — дистиллированный LoRA-адаптер для FLUX.2 [dev], который генерирует изображения всего за 8 шагов инференса вместо привычных 50.

По скорости модель в 6 раз быстрее базовой версии, при этом почти не теряет в качестве. LoRA адаптер мало весит и легко встраивается в существующие FLUX.2-воркфлоу, поддерживая как text-to-image, так и редактирование изображений.

ComfyUI веса, есть плейграунд и API. Модель наследует FLUX [dev] Non-Commercial License и использовать её можно только в некоммерческих проектах.

🔗 Hugging Face [18] 🔗 [19]fal.ai [17] [19]

🔧 AI-инструменты и платформы

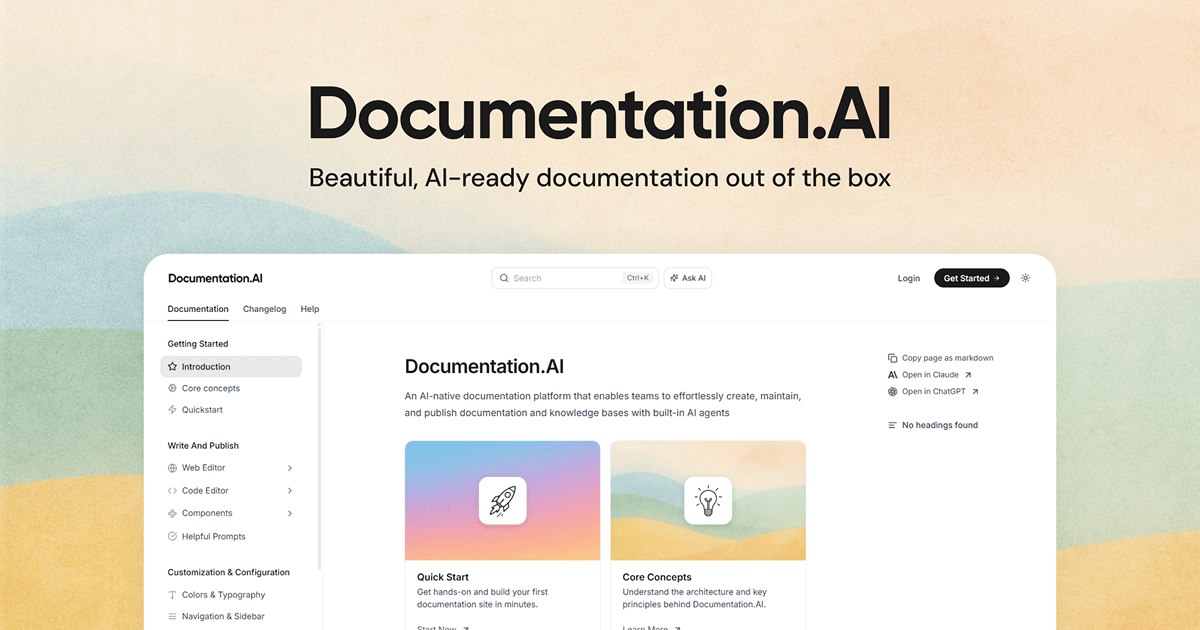

❯ Documentation AI — ИИ для документаций

Documentation AI автоматизирует обновление документации: платформа следит за коммитами в Git и фидбеком из саппорта и сама предлагает правки, если код ушёл вперёд, а доки устарели.

Можно задавать вопросы прямо в документации и получать точные ответы со ссылками на источники. Работать можно через веб-интерфейс или пушить изменения из VS Code и Cursor. Есть тестирование эндпоинтов, копирование готовых кусков кода, тёмная тема и автогенерация llms.txt для поисковых роботов.

Сохраняем, если устали от неактуальных доков и бесконечных тикетов с вопросом «а где это описано».

🔗 Documentation AI [20]

❯ IMS Toucan — озвучка текста в браузере

Появился open-source-сервис IMS Toucan, который позволяет озвучивать текст на любом языке прямо в браузере. Достаточно вставить текст — и система за несколько секунд генерирует речь с естественными интонациями.

Инструмент поддерживает тысячи языков, включая русский, и даёт гибкие настройки: можно менять скорость, интонацию и стиль подачи. IMS Toucan подходит для озвучки видео, курсов, приложений и ботов.

Сервис работает онлайн и локально. Бесплатно.

🔗 GitHub [21]

❯ Бесплатный курс по Claude Code от Anthropic

Anthropic сделали бесплатный курс Claude Code in Action — подробный гайд по работе с ИИ-агентом для разработки.

В курсе показывают, как ускорять рутинные задачи, грамотно управлять контекстом и использовать инструменты Claude Code для работы с файлами, командами и анализом кода.

Отдельный блок посвящён интеграции с GitHub: автоматизация проверок, ревью и типовых задач.

Всего 15 коротких лекций, общая длительность около часа, плюс квизы для закрепления материала. Курс можно пройти за один вечер.

🔗 Claude Code in Action [22]

🧩 AI в обществе и исследованиях

❯ За фейковые ИИ-видео могут оштрафовать

Жителю Приморья грозит штраф до 100 тысяч рублей за вирусный ИИ-ролик, в котором амурский тигр якобы нападает на человека.

Видео разлетелось по местным пабликам, вызвало панику и дошло до Минприроды Приморского края.

В ведомстве заявили, что ролик — фейк: следов хищников не нашли, тигры за пределы ареала не выходили. После этого материалы передали в полицию для установления автора и оценки нарушения как распространения ложной информации.

Аккуратнее с ИИ-слопом в сети!

🔗 Источник [23]

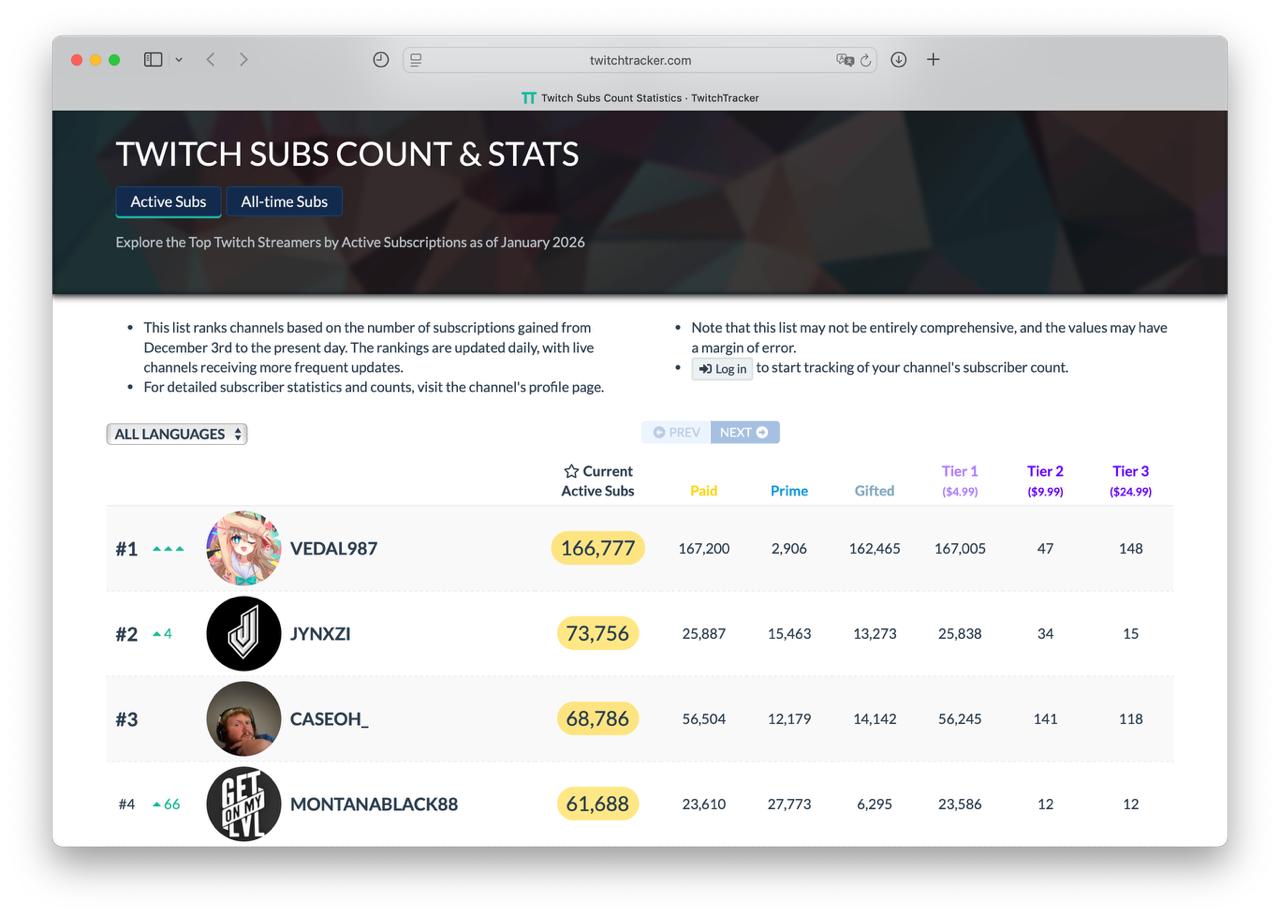

❯ ИИ-стримерша возглавила топ Twitch

ИИ-стримерша Neuro-sama на канале Vedal987 набрала 166 тысяч платных подписчиков, побив рекорд среди остальных активных каналов.

На стримах нейронка играет в Minecraft, оценивает видео и общается с чатом. Проект работает на связке Python, C# и Unity, а голос генерирует Azure TTS.

Только на подписках канал приносит $400 000 в месяц, без учёта рекламы.

Для сравнения, у стримера на втором месте в два раза меньше платных подписчиков.

🔗 Twitch Tracker [24]

❯ Разработчик сделал ИИ-бота, который общается с его девушкой

Парень собрал Telegram-бота, который переписывается с его девушкой вместо него. Агент работает на базе Claude от Anthropic, анализирует настроение собеседницы, ставит реакции [25] и сразу сигналит, если что-то идёт не так.

Бот пишет сообщения от лица автора, ориентируясь на гайды по общению, и может поддерживать диалог 24/7 — когда сам разработчик занят. Проект выложен в опенсорс.

Кейс интересный и показательный. LLM могут брать на себя и социальные роли, помимо работы и рутины.

🔗 GitHub [26]

❯ Unitree H2 — боевой гуманоид

Unitree показали нового гуманоидного робота Unitree H2. Машина ростом около 180 см и весом 70 кг делает ставку на подвижность и силовую динамику — в видео робот уверенно двигается, держит баланс и выглядит заметно агрессивнее прошлых прототипов.

В этот раз без «аватаров» и концептов — просто демонстрация физических возможностей платформы. H2 продолжает линию Unitree на быстрых и манёвренных гуманоидов, которые всё ближе подходят к реальным задачам за пределами лабораторий.

🔗 Reddit [27] 🔗 Unitree в X [28]

❯ Тема недели: 17 лет со дня запуска Bitcoin

На этой неделе 17 лет назад, в тишине серверных комнат, Сатоши Накамото запустил основную сеть Bitcoin и добыл «Генезис-блок», в который вшил заголовок статьи из The Times о спасении банков, который навсегда изменил архитектуру доверия.

Это напоминание нам, что один человек с гениальным алгоритмом способен перевернуть планету сильнее, чем целые корпорации.

Символично, что сегодня, когда нейросети учатся генерировать смыслы, мы всё чаще возвращаемся к идеям блокчейна — единственному способу верифицировать реальность в эпоху бесконечных ИИ-подделок.

❯ Аудиоверсия дайджеста

❯ Заключение

Неделя получилась интересной: новые модели для кода и генеративные инструменты выходят в опенсорс, ИИ-проекты набирают аудиторию, а эксперименты всё чаще выходят за пределы лабораторий.

ИИ развивается системно: меняются технологии, инфраструктура и пользовательские сценарии.

До встречи в следующем выпуске!

Новости, обзоры продуктов и конкурсы от команды [29]Timeweb.Cloud [30] — в нашем Telegram-канале [29] ↩

Автор: Wonderlove

Источник [31]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/24093

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] Вандер: http://t.me/neuroport

[3] Hugging Face: https://huggingface.co/MiniMaxAI/MiniMax-M2.1

[4] Документация API: https://platform.minimax.io/docs/guides/text-generation

[5] Анонс: https://www.minimax.io/news/minimax-m21

[6] GitHub: https://github.com/HarryR/z80ai

[7] обучения: http://www.braintools.ru/article/5125

[8] Hugging Face: https://huggingface.co/Lightricks/LTX-2

[9] GitHub: https://github.com/Lightricks/LTX-2

[10] Техрепорт: https://videos.ltx.io/LTX-2/grants/LTX_2_Technical_Report_compressed.pdf

[11] ComfyUI: https://github.com/Lightricks/ComfyUI-LTXVideo

[12] Попробовать: https://app.ltx.studio/ltx-2-playground/t2v

[13] Демо в Qwen Chat: https://chat.qwen.ai/?inputFeature=t2i

[14] Гайд ComfyUI: https://unsloth.ai/docs/models/qwen-image-2512

[15] Hugging Face: https://huggingface.co/Qwen/Qwen-Image-2512

[16] GGUF: https://huggingface.co/unsloth/Qwen-Image-2512-GGUF/tree/main

[17] fal.ai: http://fal.ai

[18] Hugging Face: https://huggingface.co/fal/FLUX.2-dev-Turbo

[19] : https://fal.ai/models/fal-ai/flux-2/turbo/edit/playground

[20] Documentation AI: https://documentation.ai/

[21] GitHub: https://github.com/0xSojalSec/IMS-Toucan/

[22] Claude Code in Action: https://anthropic.skilljar.com/claude-code-in-action

[23] Источник: https://rg.ru/amp/2026/01/05/reg-dfo/avtoru-fejkovogo-ii-video-s-napadeniem-tigra-v-primore-grozit-krupnyj-shtraf.html

[24] Twitch Tracker: https://twitchtracker.com/subscribers

[25] реакции: http://www.braintools.ru/article/1549

[26] GitHub: https://github.com/arlanrakh/talk-to-girlfriend-ai

[27] Reddit: https://t.me/Reddit/45409

[28] Unitree в X: https://x.com/i/status/1980140278930661501

[29] Новости, обзоры продуктов и конкурсы от команды : https://t.me/timewebru

[30] Timeweb.Cloud: http://Timeweb.Cloud

[31] Источник: https://habr.com/ru/companies/timeweb/articles/983516/?utm_source=habrahabr&utm_medium=rss&utm_campaign=983516

Нажмите здесь для печати.