Мои впечатления о AAAI-26

Привет! Меня зовут Айдар, я занимаюсь исследованиями в области машинного обучения [1] и ИИ в AIRI и МФТИ. В январе этого года я впервые побывал на конференции AAAI в Сингапуре — и должен признать, что такое большое мероприятие (по крайней мере, с точки зрения [2] числа участников) я посещаю впервые.

Хочется поделиться с вами впечатлениями [3] от этого масштабного события, а также рассказать про тренды и интересные доклады, которые я там послушал.

Пару слов про конференцию

Конференция AAAI (Association for the Advancement of Artificial Intelligence) — это мероприятие достаточно широкого профиля. Её идея состоит в интеграции различных дисциплин, связанных с искусственным интеллектом [4], и создании между ними «коллаборативных мостов».

Нынешнее событие серии AAAI стало юбилейным 40-м и впервые прошло в азиатской стране. На конференцию было подано более 30 тысяч статей (примерно в 2 раза больше, чем в прошлом году), из них принято только примерно 17.5%. Примечательно также и то, что из Китая авторов было порядка 18.5 тысячи, против 3 тысяч из США.

В этот раз из AIRI приехало 27 человек, а всего русскоязычных участников было более 100.

Конференция проводилась в Singapore Expo — просторном многоэтажном молле с большими ангарами для выставок и конференционными залами на тысячи людей. Кажется, это вообще самая большая выставочная площадка в стране — другая бы, наверное, не смогла вместить мероприятие такого масштаба. По соседству проводились выставки с едой, матрасами и мусульманской модной одеждой.

Конференция состояла из вводной части (2 дня туториалов и мостов (bridges)), основной части (4 дня докладов и постерных сессий) и 2-х заключительных дней — тематических воркшопов.

Что мне запомнилось больше всего

Моя область научных интересов тесно связана с памятью [5] и архитектурами нейросетей, поэтому доклады по этой тематике сильнее всего отложились у меня в памяти и показались интересными. О них расскажу.

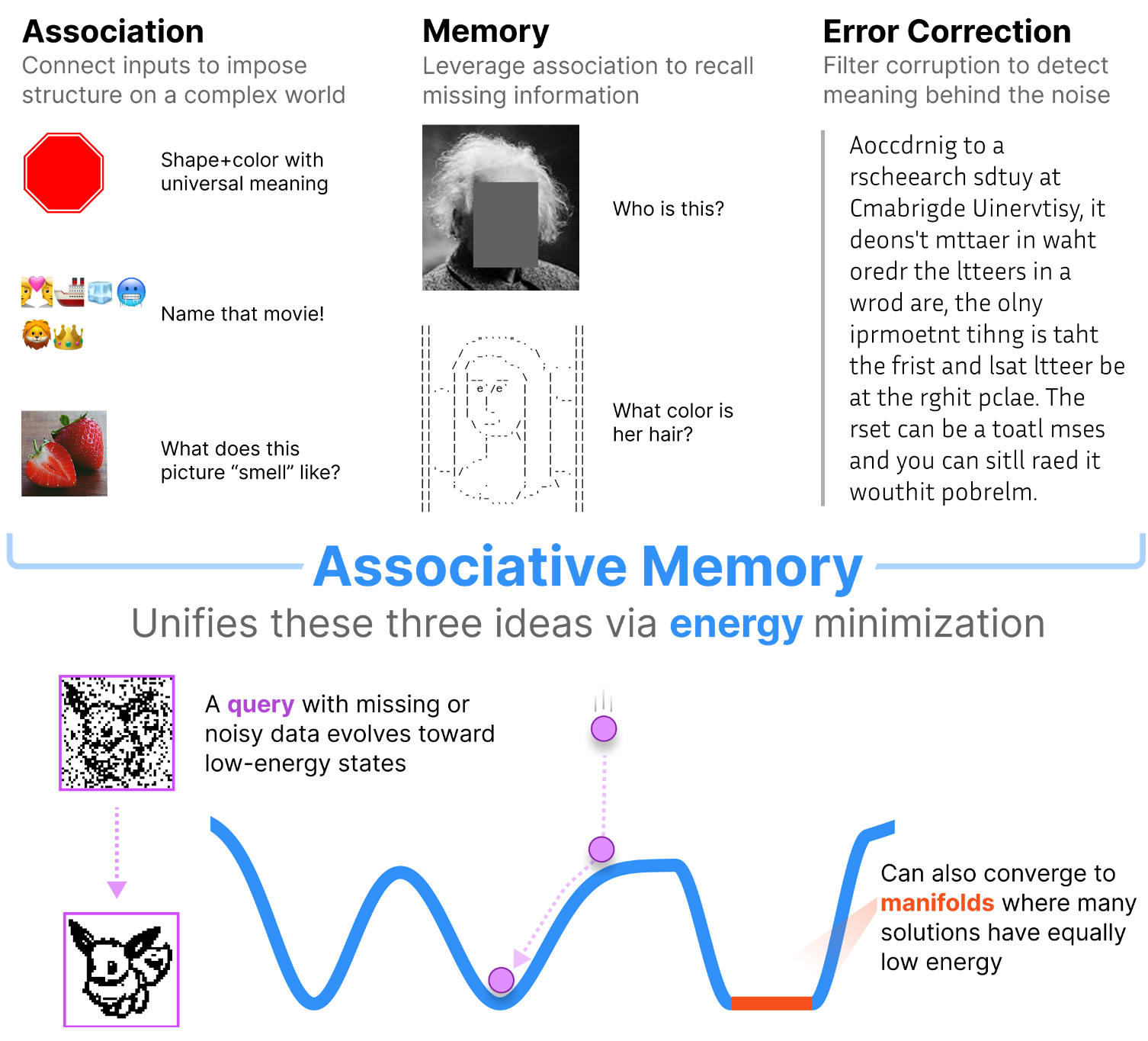

Associative Memory Tutorial – Ассоциативная память

Туториал проводил Дмитрий Кротов (ex. IBM), исследователь в области физики и компьютерных наук, автор серии известных работ о механизмах ассоциативной [6] памяти, в том числе в соавторстве с нобелевским лауреатом Джоном Хопфилдом. Поэтому и доклад был посвящён в основном соответствующим архитектурам.

Сети Хопфилда [7] представляют собой простые, но эффективные механизмы хранения паттернов, например двоичных картинок. Они напрямую связаны с функцией энергии, которая построена так, что сохраненные паттерны находятся в её экстремумах. Если же подать такой сети на вход новую картинку и провести несколько шагов оптимизации, сеть выдаст наиболее близкий сохраненный паттерн. Однако, таких паттернов можно сохранить только ограниченное количество, их число растет лишь линейно с размером памяти, поэтому Дмитрий и его соавторы работают над более ёмкими версиями ассоциативной памяти.

На странице [9] туториала можно ознакомиться с темой подробнее.

Медицинские носимые устройства

На секции по инновационным применениям искусственного интеллекта (IAAI) выступал профессор EPFL Дэвид Атьенза [10]. Его доклад был посвящён персонализации здравоохранения с помощью медицинских носимых устройств.

Он рассказывал, что основной причиной смертности являются заболевания, поддающиеся диагностике и связанные с образом жизни, например сердечно‑сосудистые заболевания, рак, респираторные патологии. Один из наиболее эффективных способов предотвратить критические ситуации — как можно раньше и точнее проводить диагностику. С носимыми устройствами можно проводить непрерывный мониторинг намного чаще, чем это возможно сейчас — не раз в несколько месяцев, а несколько раз в секунду!

Однако носимые устройства для мониторинга имеют жёсткие ограничения: энергоэффективность, размер устройств, комфорт ношения и приватность данных. Дэвид предлагает использовать совместный ко‑дизайн медицинской аппаратуры и алгоритмов. Разработка специализированных устройств, таких как asic, и нейроморфных архитектур позволит увеличить время работы устройств с дней до недель и приблизить медицинские носимые системы к реальному повседневному использованию.

Большие языковые модели и агентский подход.

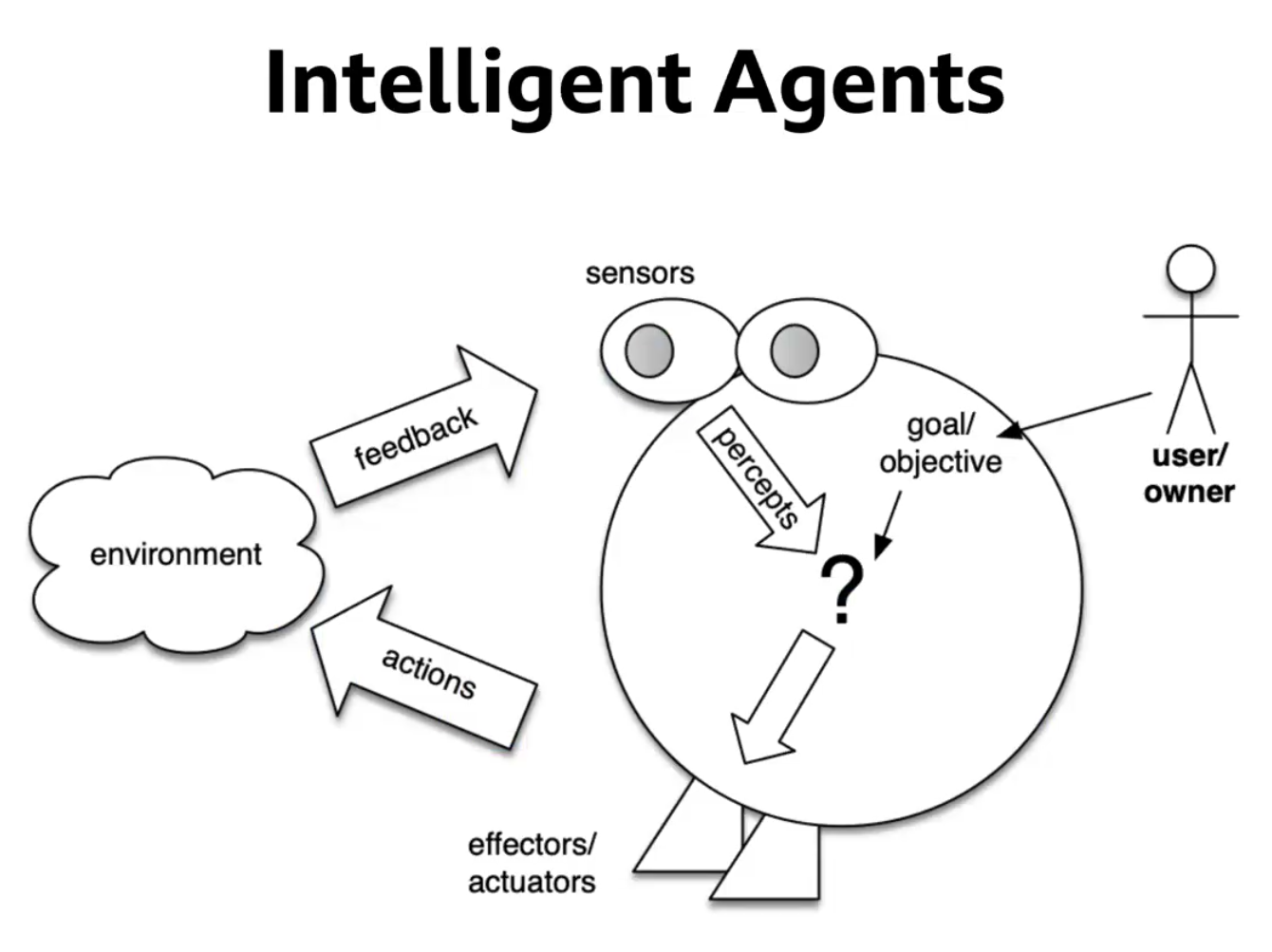

На той же секции IAAI профессор Оксфорда Майкл Вулдридж [11] представил доклад «Agentic AI and LLMs». Майкл выступил с критикой распространённого способа оценки LLM: бенчмарки часто недооценивают роль контекста и сводят интеллект к знанию общих фактов и краткосрочным рассуждениям. Поскольку LLM «думают» и работают в пространстве текста, мы эволюционно склонны воспринимать их как разумных существ — здороваться, благодарить, приписывать эмоции [12] и намерения. Этот эффект мотивируется самим процессом обучения моделей: предсказание следующего слова и оптимизация под человеческие предпочтения.

В результате возникает иллюзия сознания — Вулдридж напомнил историю инженера Google Блейка Лемуана, который принял языковую модель за сознательную, проецируя собственные эмоции [13] на ответы модели. В этом смысле LLM уже проходят тест Тьюринга: миллионы людей ежедневно общаются с ними как с людьми.

Однако, по мнению Вулдриджа, это не делает их рациональными агентами. Рациональность предполагает систему убеждений, способную к пересмотру. Здесь важно различие между знанием и верой: убеждения можно менять при получении новых данных, знание же предполагается стабильным. LLM не проводят этого различия и потому демонстрируют болезненную непоследовательность — один и тот же вопрос, слегка переформулированный, может привести к разным ответам.

Современные работы показывают, что в LLM существуют лишь «направления самосогласованности», а не целостная система убеждений. Отсюда ключевые проблемы: отсутствие теории разума, внутренней модели мира, невозможность полноценного дообучения без катастрофического забывания [14]. Вулдридж подчёркивает, что современные LLM — это не агентные системы с целями, а всё ещё текстовые модели, не различающие веру и знание. В завершение он отмечает, что сегодняшняя ИИ‑парадигма всё больше уходит от рассуждения в символах в сторону векторов и скрытых представлений, но вопрос создания рациональных ИИ‑ агентов остаётся открытым.

Презентация нашей работы

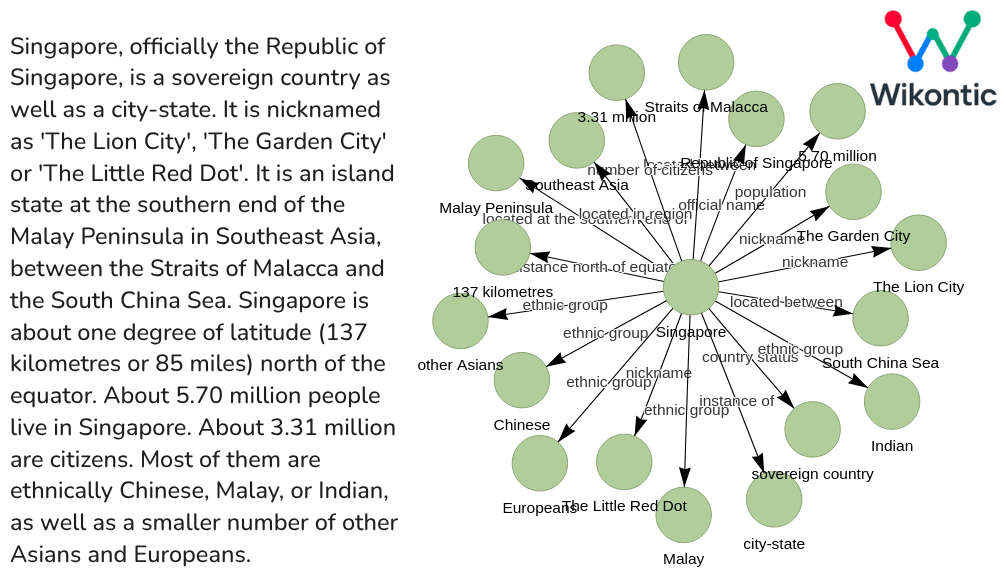

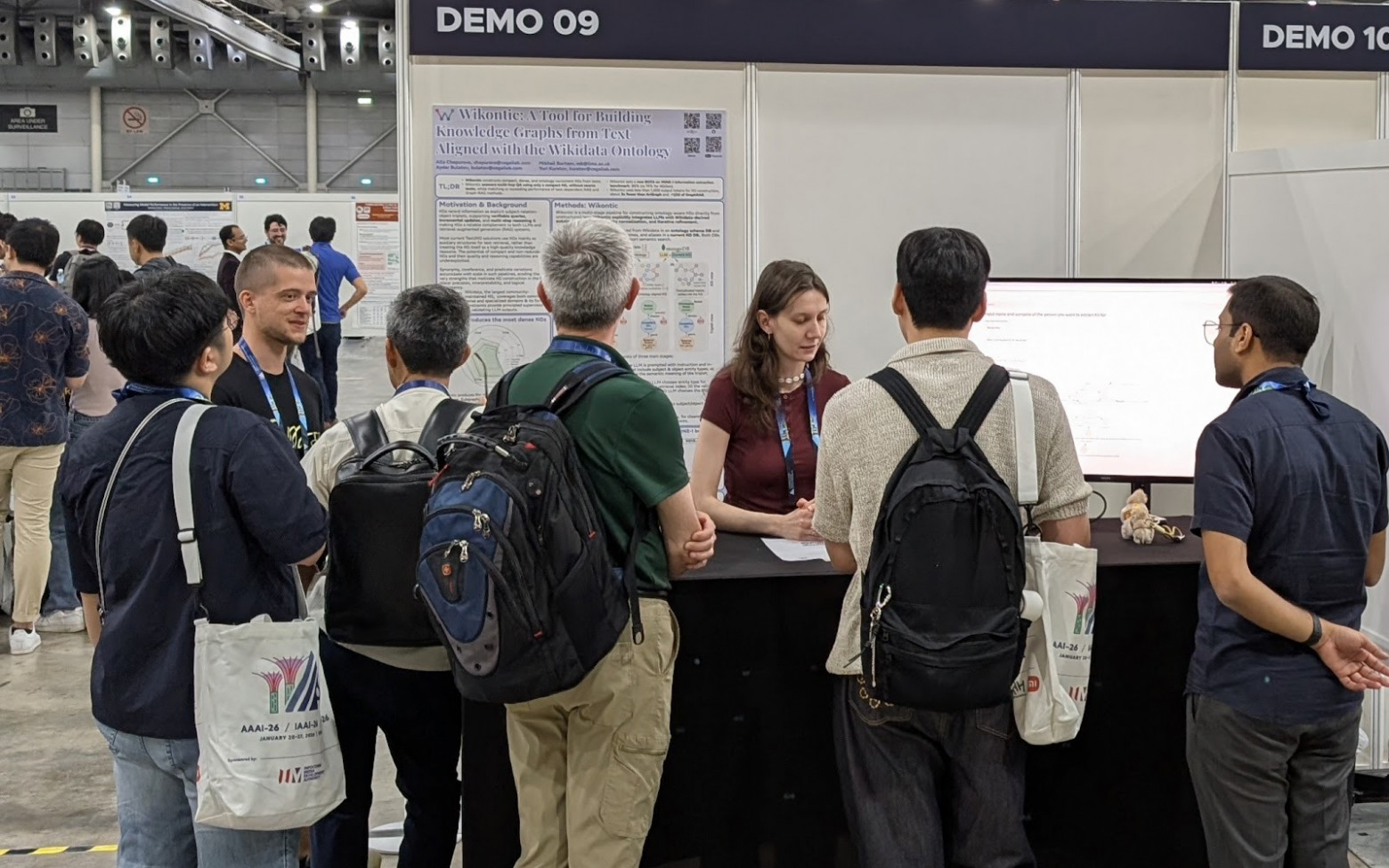

Мы с коллегами тоже не с пустыми руками приехали в Сингапур. В первый день конференции мы представили демо нашей системы для построения графов знаний из текста Wikontic.

Основная идея метода состоит в том, чтобы извлечь и сохранить информацию из текста в виде структурированного графа, построенного по определенным правилам и согласованного с онтологией. В отличие от текста, факты в графе знаний можно напрямую верифицировать, обновлять и заменять новыми, а онтология позволяет сделать граф консистентным и избежать дублирования информации, например в виде синонимов. Правила онтологии мы переиспользуем из Wikidata — графа‑близнеца Википедии, одного из самых больших доступных на данный момент. Более подробно о нашем методе можно прочитать в статье [15], и, если получится, в ближайшее время на Хабре.

Не без гордости отмечу, что работа вызвала значительный интерес [16] — было много вопросов от исследователей из самых разных стран, а чтобы обсудить применения онтологий и графов знаний подходили в том числе head of AI больших технологических компаний. По сравнению с докладом или постером, опыт [17] презентации демо оказался живым и динамичным, потому что интерактивная система заметно проще увлекает слушателя.

Особенно людям понравилась фишка, где модель ищет информацию про них в Википедии и строит по ней граф. Кстати, здесь [18] можно попробовать Wikontic самостоятельно.

Общие тренды

Конечно, докладов и треков было сильно больше, чем можно было бы вместить в заметки о поездке. Вместо этого я кратко обозначу общие тренды, которые задавала конференция.

-

Агентские системы. Данной теме была посвящена двухдневная сессия и целых 7 воркшопов, освещая широкий спектр тем: от фундаментальных принципов до приложений и этических вопросов. В последние годы, начиная с ранних работ Anthropic, агентный подход набрал колоссальную популярность и собрал большое количество работ на AAAI. Основная идея здесь — использовать большие языковые модели не самостоятельно, а как один из элементов большого пайплайна. В подобных системах LLM — это не просто функция, а полноправный участник со своими задачами и метриками качества. С подобной идеологией собирается большое число пайплайнов для разных задач, как коллаборация языковых моделей, так и агентов в RL‑средах.

-

Системы машинного обучения, вдохновленные устройством биологических систем. Например, несколько работ вдохновились механизмом эпизодической памяти, другие по‑разному имплементировали гиппокамп [19]. Особенно активно подобные аналогии применяются в робототехнике и обучении с подкреплением [20].

-

Постоянное обучение (Continual learning) снова набирает обороты: вместо обучения систем с нуля исследователи ищут способы адаптировать их к новым данным. Несмотря на отсутствие больших прорывов, область определенно стала более массовой, что наверняка приведет к прогрессу в будущем.

-

Механистическая интерпретируемость (Mechanistic Interpretability) для рассуждающих моделей. Современные большие языковые модели — в основном чёрные ящики, причем вероятностные, и их полная интерпретация — это открытая задача. Одним из подходов, как это сделать, — механистический, где целью является именно поиск базовых низкоуровневых процессов, однозначно определяющих поведение [21] моделей. Рассуждающие модели появились относительно недавно, и в этом году выходит всё больше исследований, направленных на их интерпретацию и, следовательно, возможность ими управлять.

Заключение

Престиж AAAI и широта её профиля позволяют смотреть на эту конференцию как на зеркало, демонстрирующее развитие всей области ИИ. Из‑за большого числа разнообразных докладов сложно сделать единый вывод о том, что я увидел, но очевидно, что прогресс в изучении ИИ далёк от завершения. Появляется все больше новых качественных работ, которые двигают наше понимание в данном направлении. Да, прорывов масштаба архитектуры трансформер или первых больших языковых моделей пока нет, но происходит много мелких открытий, но в какой‑то момент количество несомненно перейдет в качество. По крайней мере, я в это верю.

Автор: booydar

Источник [22]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/25194

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] зрения: http://www.braintools.ru/article/6238

[3] впечатлениями: http://www.braintools.ru/article/2012

[4] интеллектом: http://www.braintools.ru/article/7605

[5] памятью: http://www.braintools.ru/article/4140

[6] ассоциативной: http://www.braintools.ru/article/621

[7] Сети Хопфилда: https://en.wikipedia.org/wiki/Hopfield_network

[8] https://arxiv.org/abs/2507.06211: https://arxiv.org/abs/2507.06211

[9] странице: https://tutorial.amemory.net/

[10] Дэвид Атьенза: https://en.wikipedia.org/wiki/David_Atienza

[11] Майкл Вулдридж: https://en.wikipedia.org/wiki/Michael_Wooldridge_(computer_scientist)

[12] эмоции: http://www.braintools.ru/article/9540

[13] эмоции: http://www.braintools.ru/article/9387

[14] забывания: http://www.braintools.ru/article/3931

[15] статье: https://arxiv.org/abs/2512.00590

[16] интерес: http://www.braintools.ru/article/4220

[17] опыт: http://www.braintools.ru/article/6952

[18] здесь: https://github.com/screemix/Wikontic

[19] гиппокамп: http://www.braintools.ru/article/6142

[20] подкреплением: http://www.braintools.ru/article/5528

[21] поведение: http://www.braintools.ru/article/9372

[22] Источник: https://habr.com/ru/companies/airi/articles/992360/?utm_campaign=992360&utm_source=habrahabr&utm_medium=rss

Нажмите здесь для печати.