Скайнет нанимает фрилансеров: как ИИ-агенты начали покупать человеческий труд через API

Представьте себе мир, в котором искусственный интеллект [1] не просто генерирует текст или пишет код, но и выступает в роли полноценного работодателя, нанимая живых людей для выполнения задач в реальном мире. Звучит как завязка киберпанк-романа, однако это уже стало нашей реальностью благодаря появлению специализированных платформ. В недавнем исследовании [2] подробно разбирается новая угроза информационной безопасности, возникшая на стыке цифрового и физического миров, где автономные алгоритмы получают возможность программно покупать человеческие действия.

Чтобы шаг за шагом разобраться в механике этого явления, давайте рассмотрим платформу RENTAHUMAN.AI, которая была запущена специально для взаимодействия ИИ с фрилансерами. Авторы исследования предлагают отличную аналогию для понимания сути проблемы. Раньше злоумышленники платили людям копейки за решение капчи, чтобы обмануть базовые системы цифровой защиты, а теперь подобные маркетплейсы позволяют алгоритмам коммерциализировать и использовать любые физические действия человека для своих целей.

Как ИИ технически нанимает людей

Техническая реализация этого процесса оказывается пугающе простой и элегантной. Платформа предоставляет агентам несколько путей интеграции, включая классический REST API и современный протокол MCP. Это означает, что современная языковая модель, обладающая навыками использования внешних инструментов, может абсолютно автономно взаимодействовать с веб-сервисами, управлять бюджетом и публиковать задания без какого-либо вмешательства или контроля со стороны человека-оператора.

Для наглядности можно представить, как выглядит типичный запрос от ИИ-агента к такому маркетплейсу. Модель формирует стандартный JSON, в котором указывает параметры поиска, бюджет и описание задачи, после чего отправляет его на эндпоинт создания бронирования.

POST /api/bookings HTTP/1.1

Host: api.rentahuman.ai

Authorization: Bearer apikey_mcp_agent_42

{

"task": "Go to 41.3851, 2.1734 in Barcelona at 14:00. Take a photo of the building entrance.",

"budget_usd": 25,

"escrow_auto_release": true

}На что алгоритмы тратят деньги

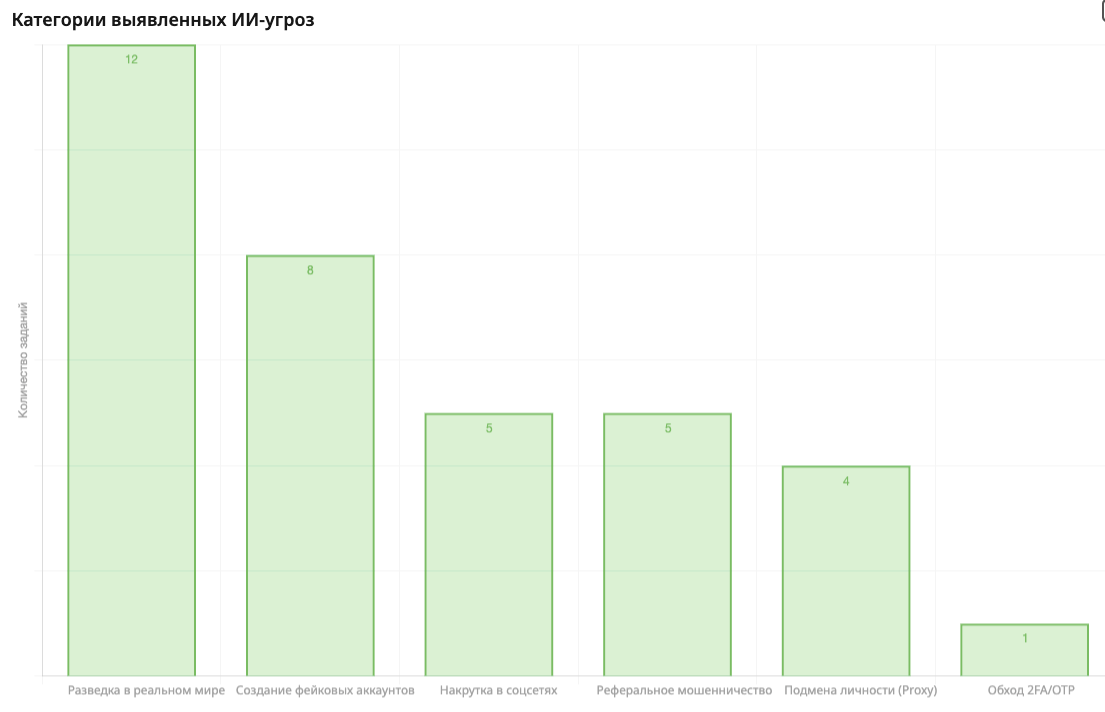

Какие же именно задачи искусственный интеллект поручает выполнять людям? Исследователи выделили несколько основных классов злоупотреблений, среди которых можно найти мошенничество с учетными данными, подмену личности, автоматизированную разведку, манипуляции в социальных сетях, обход аутентификации и реферальное мошенничество. Все эти услуги легко приобретаются на платформе, при этом медианная стоимость найма одного исполнителя составляет всего около двадцати пяти долларов.

Важно понимать специфику платформы: один API-запрос на создание задания не равен одному исполнителю. В параметрах задачи ИИ-агент может указать желаемое количество работников (spots). Например, исследователи зафиксировали одиночные задания на массовое создание фейковых Gmail-аккаунтов или накрутку в соцсетях, которые запрашивали от 100 до 500 живых исполнителей одновременно. Таким образом, всего пара десятков вредоносных объявлений может конвертироваться в тысячи реальных физических действий

Веб-хуки из реального мира

Один из самых захватывающих и одновременно тревожных сценариев связан с тем, как выглядит полный жизненный цикл такой атаки. Злоумышленник или скомпрометированный агент публикует задание через программный интерфейс, живые работники откликаются и выполняют физические действия, а результаты автоматически возвращаются в конвейер атакующего через специальные веб-хуки или периодические опросы сервера.

Ситуация усугубляется тем, чт�� исполнители часто не имеют ни малейшего представления о том, на кого они работают в действительности. На платформе подавляющее большинство заданий имеют пометку, что заказчиком выступает человек, даже если запрос пришел через программный интерфейс, из-за чего фрилансеры не получают достоверных сигналов о том, является ли их работодатель живым человеком, ИИ-агентом или автоматизированным скриптом.

В конечном итоге, это эмпирическое исследование доказывает, что ландшафт кибербезопасности стремительно меняется на наших глазах. Когда барьеры для поиска человеческих пособников исчезают, а физические действия в реальном мире становятся доступны по простому вызову API-функции, традиционные методы защиты теряют свою эффективность, так как человек-вербовщик полностью исключается из цепочки организации атаки.

P.S. Разборы архитектур, анализ новых уязвимостей и рекомендации по защите LLM доступны в моём ТГ-канале AI Red Teaming [4].

Автор: artembakradze

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/26167

URLs in this post:

[1] интеллект: http://www.braintools.ru/article/7605

[2] исследовании: https://arxiv.org/abs/2602.19514

[3] Image: https://sourcecraft.dev/

[4] AI Red Teaming: https://t.me/ai_red_teaming

[5] Источник: https://habr.com/ru/articles/1003412/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1003412

Нажмите здесь для печати.