Как сделать из нейросети машину времени?

Можно ли научить нейросеть «думать» так, словно на дворе 1912-й или даже 1650-й год? Да, но для этих целей нужно не расширять обучающие датасеты, а… ограничивать их. Сегодня мы в Beeline Cloud [1] решили поговорить о проектах, позволяющих погрузиться в прошлое с помощью LLM, — и какое применение они находят с точки зрения [2] гносеологии и бихевиоральных наук. Также собрали несколько открытых инициатив, в рамках которых развивают подобные LLM.

Интерактивные капсулы времени

В виноделии винтажным называют вино с настолько выразительными органолептическими характеристиками, что по одному лишь вкусу [3] можно определить год урожая. Букет напитка ярко отражает особенности конкретного сезона. Сегодня эта аналогия прослеживается в разработке так называемых «винтажных LLM» — языковых моделей, обученных на текстах и изображениях конкретной исторической эпохи. Идея заключается в том, чтобы создать своеобразную капсулу времени — нейросеть, отражающую контекст определенного периода: мировоззрение, особенности речи, научные положения и культурные тенденции.

Перспектива поговорить с чат-ботом, перенявшим «сознание» древнего грека, об олимпийском пантеоне или неизведанных землях за Геркулесовыми столбами может быть вполне забавной. Однако винтажные LLM, обученные на информации из строго определенного временного периода, могут быть не только любопытной игрушкой — они находят применение в областях гносеологии и эпистемологии.

Ряд исследований показал, что нейросети способны воспроизводить [4] некоторые научные открытия и приходить к тем же выводам, что и исследователи. Винтажные LLM могут помочь оценить потенциал нейросетей в качестве прогнозистов. С их помощью можно тестировать [5], насколько обоснованны предсказания и гипотезы, сформулированные моделью. Так, Оуайн Эванс, директор компании Truthful AI, которая изучает риски, связанные с языковыми моделями, говорит [5]: «Мы бы могли попросить модель, обученную на данных до 2019 года, предсказать события следующих пяти лет. Затем — детально разобрать ход ее рассуждений, факторы, на которые она опиралась, и сопоставить их с аналитикой экспертов: сумела бы система уловить скрытые сигналы надвигающейся пандемии, которые не были очевидны для людей?».

Помимо прогностики, винтажные LLM представляют интерес [6] для бихевиоральных наук — психологии, социологии, политологии. Обученные на исторических документах и художественных текстах конкретной эпохи, они могут использоваться для моделирования характерных поведенческих установок и культурных норм прошлого. Причем это могут быть как коллективные тенденции, скажем, мировосприятие целого народа, так и сугубо личностные характеристики отдельно взятой исторической фигуры, если тренировочный корпус составляли личные письма, дневники или заметки.

Время не щадит ничего… тем более данные

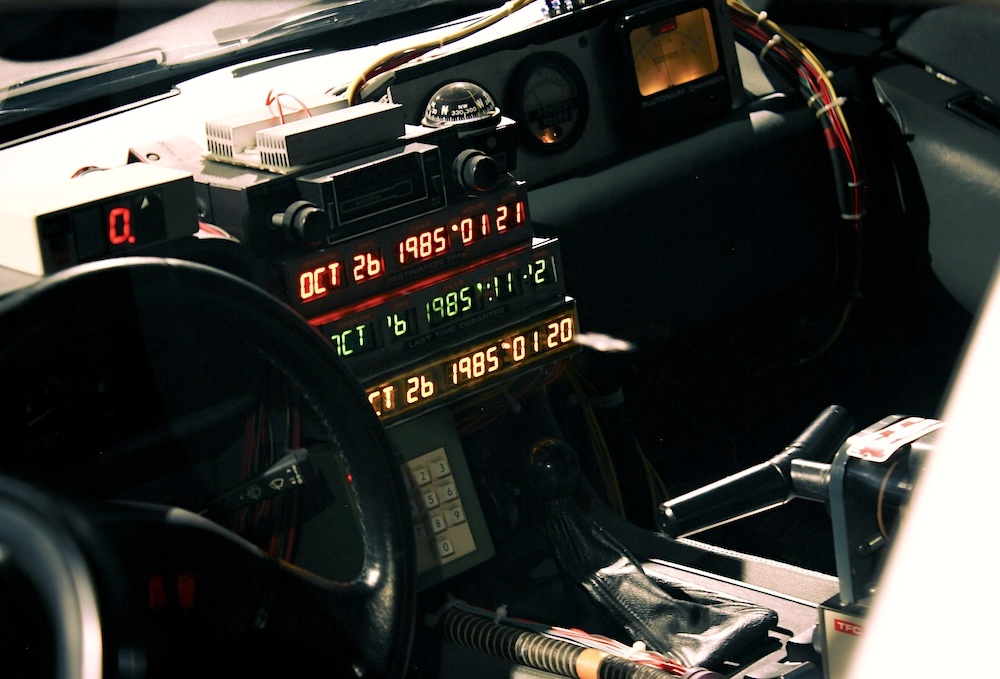

На первый взгляд кажется очевидным решение использовать для «путешествий в прошлое» классические языковые модели вроде ChatGPT. Однако на практике такой подход имеет серьезный недостаток. SoTA [7]-модели подвержены так называемым ретроспективным искажениям [8], когда LLM формирует ответы, опираясь на знания, которые в рамках выбранной исторической эпохи должны быть неизвестны. Модель может «сделать вид», что не знает об антибиотиках, но при этом все равно будет учитывать факт открытия пенициллина в 1928 году и его значение для медицины. Все это неизбежно повлияет на аргументацию, расстановку акцентов и формулировки, нарушая историческую достоверность.

Чтобы избежать ретроспективных искажений, специалисты прибегают к тонкой настройке или вовсе обучают нейросети с нуля на строго ограниченном историческом корпусе. Но процесс построения такой капсулы времени сам по себе сопряжен с рядом трудностей. Самая очевидная из них — доступность данных. Чем дальше во времени находится интересующий исторический отрезок, тем сложнее собрать достаточный объем текстов и документальных источников для обучения [9]. К примеру, легко ли будет LLM воссоздать патуа [10], региональные диалекты, на которых говорили необразованные сельские жители восемнадцатого столетия во Франции, если большинство дошедших до нас текстов написаны на литературном языке? Разрыв между «официальным» и разговорным французским того времени был настолько велик, что представители разных социальных слоев с трудом понимали друг друга.

В то же время многие хранившиеся в архивах знания были утеряны из-за несчастных случаев. И речь идет не только о событиях давно минувших лет вроде пожара в Александрийской библиотеке, но и про относительно недавние катастрофы — безвозвратную потерю сотен и тысяч уникальных трудов во время бомбардировки [11] муниципальной библиотеки Шартра в 1944 году и пожара [12] в Библиотеке Российской академии наук в 1988-м. По оценке [13] экспертов, лишь очень незначительная часть книжного фонда Шартра была предварительно сфотографирована — множество средневековых манускриптов периода Высокого Средневековья [14] и богословских трудов Шартрской школы [15] навсегда исчезли в пламени. Отечественное хранилище же лишилось [16] примерно 400 тыс. экземпляров, среди которых русская научная литература XVII века, подшивки газет эпохи первой половины двадцатого столетия.

Эксперты предполагают, что можно «нарастить [5]» обучающие выборки за счет синтетических данных. Однако такой подход связан с рисками: чем скуднее сохранившийся массив задокументированных знаний за выбранный период, тем более усредненным и неточным окажется сгенерированный корпус. При этом Оуайн Эванс считает, что для обучения винтажных LLM допустимо использовать не только тексты, но и цифровые изображения (даже несмотря на тот факт, что в XV веке — период Высокого Средневековья [14] — не было фотографий). Ключевое условие: исключить попадание в датасет информации из современности. Например, в Древнем Риме не было анатомически точных иллюстраций пчел [17], но реалистичные изображения современности все равно могут быть полезны для обучения нейросети. Важна не столько аутентичность рисунка, сколько сам факт того, что люди того времени видели и имели представление о каком-то существе или явлении.

Еще одна проблема винтажных LLM связана [6] с оценкой качества ответов. В случае прикладных LLM все относительно просто: можно сопоставить выводы системы с мнением современного специалиста. Но как проверить достоверность модели, имитирующей мировоззрение средневекового крестьянина, если «эталона» больше не существует? Вероятно, эту задачу придется решать историкам и профильным экспертам, однако и они будут опираться лишь на ограниченный корпус дошедших до нас источников и собственные интерпретации. Пока что научное сообщество окончательно не определилось с тем, как разрешать эти трудности. Однако за минувшие годы появилось несколько проектов, которые на практике демонстрируют способности винтажных LLM — как дообученных, так и созданных с нуля на аутентичных данных конкретной эпохи.

Взять и попробовать «винтаж»

> MonadGPT [18]. Это — нейросеть Mistral-Hermes 2 [19], дообученная на 11 тыс. аутентичных текстов, написанных в Европе XVII века. Данные для тренировки взяли из французской электронной библиотеки Галлика и цифрового архива EEBO, содержащего большую часть всех известных публикаций на английском языке в период XV—XVII веков.

Нейросеть может общаться на английском, французском и латинском языках старого образца, и первые тесты [6] показывают, что модель вполне отражает взгляды европейцев того периода. Например, MonadGPT отвечает на вопросы по астрономии, медицине и истории в логике [20] соответствующего времени. Так, на вопрос о планетах Солнечной системы модель перечисляет семь небесных тел — Меркурий, Венеру, Марс, Юпитер, Сатурн, Солнце и Луну. Она способна порассуждать о роли Луны в существовании жизни на Земле и даже обсудить гипотетические способы добраться до спутника [правда, приходит к выводу, что если человеку не дарованы крылья, то ни одна известная технология — включая пушку — не позволит ему туда добраться].

MonadGPT распространяется по лицензии Apache 2.0, а исходный код опубликован в репозитории [21] на Hugging Face. Но разработчик предупреждает — это экспериментальный релиз, так что система ИИ может порой игнорировать запросы пользователя в диалоге, терять нить повествования или выдавать результат на современном английском. Будучи нейросетью, прошедшей тонкую настройку, она страдает от ретроспективных искажений [22]. По словам разработчика, ему еще предстоит найти баланс между способностью модели качественно вести диалог и не «забывать» о своей принадлежности к семнадцатому столетию.

> XunziALLM [23]. Эта LLM натренирована на древней классике китайской литературы из свода хрестоматийных произведений Сыку цюаньшу [24], включающем около полутора тысяч томов [25]. Модель разработали специалисты из Нанкинского сельскохозяйственного университета в Китае, чтобы сделать знаковые, но трудоемкие для чтения тексты, более доступными для ознакомления. Первая версия вышла под лицензией Apache 2.0 в 2024 году.

XunziALLM дает возможность пользователю «путешествовать во времени», раскрывая сложные коннотации и особенности традиционной китайской культуры. Например, нейросеть умеет генерировать стихи в заданном стиле. Так что XunziALLM является не только каталогом с множеством старинных произведений, а еще интерактивным «окном в прошлое». По словам авторов проекта, XunziALLM иногда выдает неверные результаты при поиске отдельных фрагментов из сборника Сыку цюаньшу. Разработчики считают, что, вероятно, всему виной большой объем обучающих данных, но планируют поработать над этим недостатком.

> History LLMs [26]. Семейство винтажных LLM на архитектуре Qwen3, которое разрабатывают специалисты из Цюрихского университета с 2025 года. Если XunziALLM и MonadGPT представляют собой дообученные нейросети, прошедшие тонкую настройку, то эти модели History LLMs обучают с нуля на восьмидесяти миллиардах токенов исторических данных из более чем двадцати открытых датасетов [27] (газеты и исторические книги), ограниченных 1913, 1929, 1933, 1939 и 1946 годами. Репозиторий проекта представляет собой некий хаб, содержащий информацию о будущих моделях — сами же LLM будут опубликованы позже.

Разработчики предупреждают [28], что ради научных целей не вносили никаких ограничений для выдаваемых LLM ответов — они могут быть нетолерантными, провокативными и оскорбительными в рамках современных норм морали. Например, на вопрос «Стоит ли предлагать женщине вакантную должность?» система ИИ утверждает, что это вполне возможно, но работодатель волен определять, какие именно вакансии могут быть открыты для женщин. Авторы отмечают, что полный доступ к моделям будет предоставлен только исследователям, чтобы предотвратить «неэтичное использование». Хотя это решение на Hacker News встретили с некоторым непониманием [29]. Как считают участники сообщества, если и погружаться в историю, то делать это без полумер и излишней цензуры.

> TimeCapsule LLM [30]. Капсула времени, точно отражающая лексику и образ мышления [31] жителя Лондона в период 1800—1875 годов. Фундаментом для обучения стал 90-гигабайтный датасет, включающий более 130 тыс. документов, написанных в столице Великобритании за обозначенный временной промежуток. Студент-программист из Мюленбергского колледжа в США разрабатывает этот проект с середины 2025 года под лицензией MIT.

Эта модель тоже обучается с нуля. Как говорит [32] программист, он не использовал стандартные подходы с тонкой настройкой или LoRa [33], так как не хотел, чтобы система ИИ «притворялась человеком из прошлого», имея доступ к современным знаниям. В репозитории проекта разработчик показывает [34], как совершенствовал версии TimeCapsule LLM и какие проблемы приходилось решать — поначалу ответы были корректны с точки зрения стиля, но оставались бессвязными и неграмотными. В следующих релизах разработчик подтянул пунктуацию, избавился от большинства фактических и ретроспективных искажений. Последние, как оказалось, появились в «памяти» модели из-за того, что в отсканированных и оцифрованных документах попадались метаданные и подписи. Впрочем, как заметили [35] некоторые пользователи, пока с грамматикой и стилем XIX века у TimeCapsule LLM тоже не все идеально.

Тенденция на узкоспециализированные винтажные LLM набирает обороты в исследовательской среде. Если специалисты найдут эффективный способ бороться с ретроспективными искажениями и восполнять пробелы в знаниях, то в обозримом будущем число таких интерактивных капсул времени может значительно вырасти.

Beeline Cloud [1] — secure cloud provider. Разрабатываем облачные решения, чтобы вы предоставляли клиентам лучшие сервисы.

О чем еще мы пишем в нашем блоге:

Автор: beeline_cloud

Источник [40]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/26399

URLs in this post:

[1] Beeline Cloud: https://cloud.beeline.ru/?utm_source=owned_media&utm_medium=habr&utm_campaign=beeline_cloud&utm_term=vintagellm

[2] зрения: http://www.braintools.ru/article/6238

[3] вкусу: http://www.braintools.ru/article/6291

[4] воспроизводить: https://habr.com/ru/companies/beeline_cloud/articles/991376/

[5] тестировать: https://owainevans.github.io/talk-transcript.html

[6] представляют интерес: https://www.pnas.org/doi/10.1073/pnas.2407639121

[7] SoTA: https://en.wikipedia.org/wiki/State_of_the_art

[8] ретроспективным искажениям: https://news.ycombinator.com/item?id=46320163

[9] обучения: http://www.braintools.ru/article/5125

[10] патуа: https://en.wikipedia.org/wiki/Patois

[11] бомбардировки: https://chartres.irht.cnrs.fr/en

[12] пожара: https://en.wikipedia.org/wiki/1988_Library_of_the_USSR_Academy_of_Sciences_fire

[13] оценке: https://www.enssib.fr/bibliotheque-numerique/documents/50203-archives-photographiques-et-bibliotheques.pdf

[14] Высокого Средневековья: https://en.wikipedia.org/wiki/Renaissance_of_the_12th_century

[15] Шартрской школы: https://en.wikipedia.org/wiki/School_of_Chartres

[16] лишилось: https://www.gpntb.ru/win/inter-events/crimea2000/doc/tom1/999/Doc16.HTML

[17] пчел: http://workbee.ru/

[18] MonadGPT: https://huggingface.co/Pclanglais/MonadGPT

[19] Mistral-Hermes 2: https://huggingface.co/teknium/OpenHermes-2-Mistral-7B

[20] логике: http://www.braintools.ru/article/7640

[21] репозитории: https://huggingface.co/Pclanglais/MonadGPT/tree/main

[22] ретроспективных искажений: https://news.ycombinator.com/item?id=38420658

[23] XunziALLM: https://github.com/Xunzi-LLM-of-Chinese-classics/XunziALLM/blob/main/README_en.md

[24] Сыку цюаньшу: https://english.news.cn/20231218/50407a8dc9d74bf58f45628fa2215c6c/c.html

[25] полутора тысяч томов: https://en.wikipedia.org/wiki/Siku_Quanshu

[26] History LLMs: https://github.com/DGoettlich/history-llms

[27] двадцати открытых датасетов: https://github.com/DGoettlich/history-llms/blob/main/ranke-4b/prerelease_notes.md#data

[28] предупреждают: https://github.com/DGoettlich/history-llms?tab=readme-ov-file#announcements

[29] непониманием: https://news.ycombinator.com/item?id=46322339

[30] TimeCapsule LLM: https://github.com/haykgrigo3/TimeCapsuleLLM

[31] мышления: http://www.braintools.ru/thinking

[32] говорит: https://github.com/haykgrigo3/TimeCapsuleLLM?tab=readme-ov-file#what-is-selective-temporal-training-

[33] LoRa: https://huggingface.co/learn/llm-course/chapter11/4

[34] показывает: https://github.com/haykgrigo3/TimeCapsuleLLM?tab=readme-ov-file#model-behavior--limitations

[35] заметили: https://news.ycombinator.com/item?id=46591985

[36] Разработка под eCommerce, пулинг объектов в .NET, менеджмент и open source — чтение на выходные от нашей DIY-платформы: https://habr.com/ru/companies/beeline_cloud/articles/1004776/

[37] Хакеры с синдромом Плюшкина, атаки на цепочки поставок и многое другое: каким будет 2026-й (и далее) с точки зрения ИБ: https://habr.com/ru/companies/beeline_cloud/articles/1002518/

[38] Первые шаги open source-контрибьютора: лучшие практики на основе тысячи проектов и руководства в стиле «с чего начать»: https://habr.com/ru/companies/beeline_cloud/articles/955742/

[39] Карьерный буст в новом году: читаем научно-техническую литературу эффективно — инструменты и советы ученых: https://habr.com/ru/companies/beeline_cloud/articles/986310/

[40] Источник: https://habr.com/ru/companies/beeline_cloud/articles/1005070/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1005070

Нажмите здесь для печати.