От Stable Diffusion до тонкой настройки LLM: разбираем новую книгу-практикум

Генеративный ИИ перестал быть магией и стал инструментом. Но чтобы им уверенно пользоваться, нужно понимать, как работают трансформеры и диффузионные модели, и уметь их адаптировать. В этом поможет новая книга [1] – полноценный практикум с кодом от инженеров Hugging Face.

Волна генеративного ИИ. Как ее поймать и оседлать

Волна генеративного ИИ накрыла всех: дизайнеров, разработчиков, маркетологов. Запрос к ChatGPT или Midjourney стал рутиной. Но следующий шаг для профессионала — переход от простого пользования к настоящему инжинирингу: созданию, тонкой настройке (fine-tuning) и интеграции генеративных моделей. Речь уже не о разовых запросах, а о создании кастомизированных языковых моделей, генераторов изображений в уникальном стиле или специализированных конвейеров для автоматизации. Вот здесь и начинается настоящая работа, а на смену облачным сервисам приходят библиотеки, фреймворки и глубокое понимание архитектур.

Книга “Генеративный ИИ на практике: трансформеры и диффузионные модели [1]” задумана авторами как фундаментальный практикум по инженерии генеративного ИИ. Цель — превратить читателя из пассивного пользователя API в разработчика, который понимает внутренние механизмы моделей и способен адаптировать их под свои цели. Книга решает ключевые проблемы пользователей: как перейти от запуска готовых демо в интерфейсе Hugging Face к написанию кода, который обучает, настраивает и комбинирует state-of-the-art архитектуры.

Фокус сделан на двух столпах современного GenAI: трансформерах (двигателе языковых моделей вроде GPT) и диффузионных моделях (основе Stable Diffusion). Материал подаётся через призму экосистемы с открытым исходным кодом: все примеры и проекты построены вокруг ключевых библиотек экосистемы открытого ИИ: transformers, diffusers, accelerate и фреймворка pytorch. Вы не просто прочтёте о внимании (attention) или шумовом расписании — вы будете реализовывать и модифицировать эти компоненты в коде.

Представляем команду авторов

Сила книги — в её создателях, инженерах из самого сердца экосистемы открытого ИИ. Это не теоретики, а практики, которые ежедневно строят инструменты, используемые миллионами разработчиков.

Омар Сансевьеро — ключевая фигура в Hugging Face. Он стоял у истоков продвижения моделей с открытым исходным кодом, включая знаменитые LLAMA. Его уникальный опыт [2] на стыке продуктовой разработки (Google Assistant), исследований (TensorFlow Graphics) и управления сообществом гарантирует, что материал подаётся с пониманием как инженерных тонкостей, так и реальных потребностей [3] разработчиков.

Педро Куэнка — инженер, который реально “поднимал” диффузионные модели в Hugging Face. Его 20-летний бэкграунд в разработке массовых продуктов (таких как легендарное приложение Camera+) обеспечивает бесценный контекст. Он знает, как превратить исследовательскую модель в надёжный, оптимизированный сервис, что отражено в практических главах по развёртыванию и оптимизации.

Аполинарио Пассос — мост между миром машинного обучения [4] и креативных индустрий. Как “инженер по машинному обучению в сфере искусства”, он гарантирует, что темы генерации изображений, стилизации и творческих приложений раскрыты не сухо, а с пониманием нужд художников и дизайнеров. Его главы наполнены практическими советами по контролю над генерацией.

Джонатан Уитакер — исследователь и педагог, создававший вместе с Джереми Ховардом (Fast.AI) один из первых и самых популярных курсов по Stable Diffusion. Его способность объяснять сложные концепции глубокого обучения через код и чёткие аналогии легла в основу методической структуры всей книги.

Таким образом, это не просто сборник глав от разных авторов, а слаженный мастер-класс от команды инсайдеров. Читатель получает доступ к концентрированному опыту людей, которые не только знают, как работает генеративный ИИ, но и активно формируют его открытую экосистему.

Что внутри: от основ до продвинутых тем

Книга структурирована максимально логично [5] и следует принципу «от простого к сложному».

Часть I: Использование открытых моделей.

Здесь закладывается фундамент. Авторы начинают не с абстрактных формул, а с практического применения готовых моделей для генерации текста и изображений. Затем следует глубокое, но понятное погружение в архитектуры:

-

Трансформеры: как работает токенизация, механизм внимания [6] и почему эта архитектура произвела революцию.

-

Автоэнкодеры и CLIP: как модели учатся сжимать, представлять и связывать данные разных модальностей (текст, изображение).

-

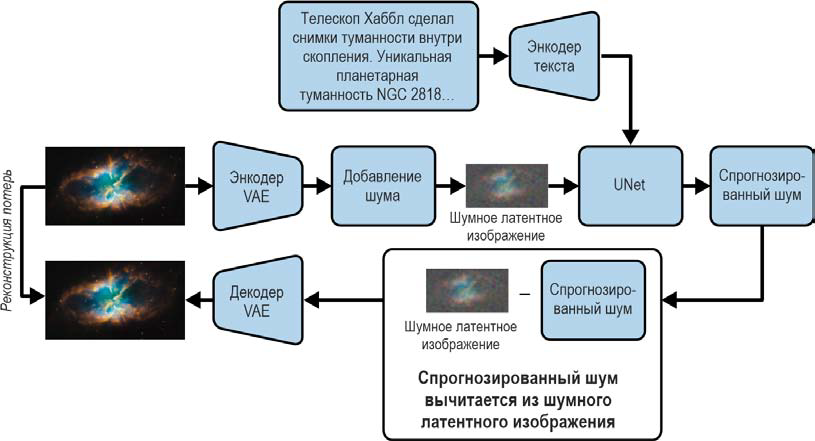

Модели диффузии: детальный разбор принципа итеративного удаления шума — сердце Stable Diffusion и ей подобных.

-

Stable Diffusion: разбор полётов. Как VAE, UNet и текстовый энкодер работают вместе для создания картинки и�� промпта.

Часть II: Перенос обучения для генеративных моделей.

Самая ценная для практика часть.

-

Тонкая настройка языковых моделей: инструктивное обучение (instruction tuning), адаптеры (LoRA, QLoRA), квантование — всё, что нужно, чтобы заставить LLM решать ваши задачи.

-

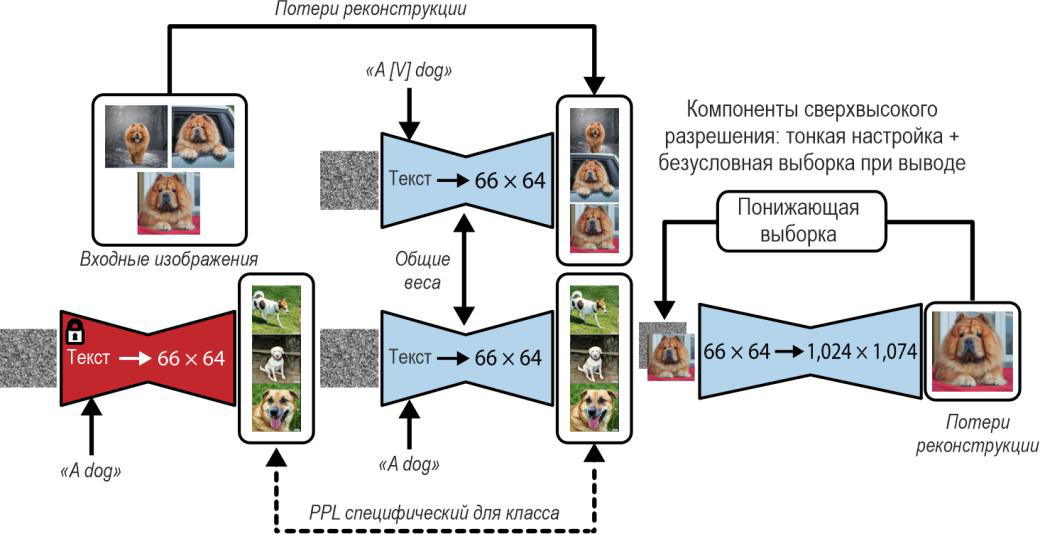

Тонкая настройка Stable Diffusion: DreamBooth, LoRA для диффузионных моделей, обучение на своих изображениях для создания уникального стиля или объекта.

Часть III: Двигаемся дальше.

Взгляд на передний край и креативные применения.

-

Творческие применения: ControlNet для точного контроля композиции, инпантинг, редактирование изображений, перенос стиля.

-

Генерация аудио: от преобразования речи в текст до создания музыки с помощью моделей вроде AudioLM и MusicGen.

-

Быстро развивающиеся направления: мультимодальность, генерация видео, 3D, оптимизация предпочтений (RLHF), смеси экспертов (MoE).

Пример из главы про тонкую настройку Stable Diffusion

Типичным примером того, как книга учит работать с моделями, служит глава 7, целиком посвящённая тонкой настройке Stable Diffusion. Это не обзор возможностей сервисов вроде Midjourney, а пошаговое руководство по превращению общей модели в ваш личный творческий инструмент. Авторы последовательно разбирают три ключевых метода, акцентируя внимание на их практическом применении и компромиссах.

Сначала вы узнаете, как провести полную тонкую настройку (full fine-tuning) модели на большом наборе данных — например, чтобы научить её генерировать изображения в стиле космических снимков телескопа «Хаббл».

В книге подробно разбираются все этапы: подготовка датасета, критически важные гиперпараметры (вроде learning_rate и использование gradient_checkpointing для экономии памяти [7]), и сам п��оцесс обучения. Однако этот мощный метод требует сотен изображений и грозит «катастрофическим забыванием» — модель, научившись генерировать туманности, может разучиться рисовать людей.

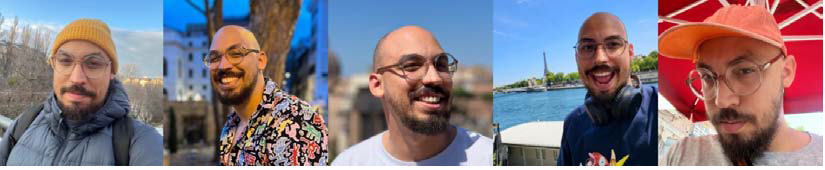

Поэтому далее авторы переходят к более элегантным и популярным в сообществе техникам. DreamBooth позволяет «внедрить» в модель новый объект или стиль, используя всего 3-5 изображений. В книге этот метод демонстрируется на личном примере: модель дообучают на нескольких фотографиях одного из авторов — Аполинарио Пассоса. Вы буквально из первых рук узнаете, как работает «сохранение прежних знаний» (prior preservation loss), чтобы модель, научившись генерировать портреты Аполинарио, не забыла, как выглядят другие люди.

Результаты этого эксперимента представлены на иллюстрациях в книге (например, на рис. 7.5), где один и тот же человек уверенно вписывается моделью в самые разные контексты и сцены.

Наконец, рассматривается метод LoRA (Low-Rank Adaptation), который стал золотым стандартом для кастомизации из-за своего баланса эффективности и компактности. LoRA не трогает гигантские веса исходной модели, а обучает небольшие «адаптеры» — файлы весом в десятки мегабайт вместо гигабайтов. Это позволяет быстро экспериментировать, хранить множество стилей и безопасно делиться результатами.

Таким образом, глава 7 — это готовый инженерный рецепт. Она отвечает на ключевые вопросы практика: «Какой метод выбрать для моей задачи?», «Сколько данных нужно?», «Как не сломать уже выученное моделью?» и, наконец, «Как реализовать это в коде?». Это именно тот переход от абстрактных возможностей к конкретным навыкам, который и обещает вся книга.

В чем польза для читателя

Книга насыщена рабочими листингами на Python с использованием библиотек transformers, diffusers и других инструментов экосистемы Hugging Face. Это готовые рецепты для экспериментов.

Hugging Face — это одно из ключевых мест, где создаётся будущее открытого ИИ. Авторы знают предмет изнутри и щедро делятся своими наработками с читателями. Материал точно сбалансирован. Между строкой «просто импортируйте pipeline» и сложнейшими математическими выкладками есть золотая середина — объяснение интуиции [8] behind the code. Вы поймёте, почему функция принимает такие аргументы, а не просто скопируете код.

В книге рассмотрены не только ставшие классикой BERT и Stable Diffusion 1.5, но и SDXL, подходы к генерации видео (FLUX), и тренды в архитектурах LLM. Каждая глава завершается вопросами для самопроверки и практическими задачами, что делает книгу отличным пособием для самостоятельного изучения или проведения воркшопов.

Целевая аудитория книги

-

Инженеры по машинному обучению и специалисты data science, которым необходимо добавить в свой арсенал навыки работы с генеративными моделями.

-

Разработчики, стремящиеся интегрировать возможности GenAI (чат, генерация контента) в свои продукты.

-

Исследователи и студенты – для получения общей картины практики применения современного генеративного ИИ.

-

Технические руководители, которым требуется перейти от поверхностного понимания к осознанной работе с моделью.

Заключение

«Генеративный ИИ на практике» — это продвинутое руководство от ведущих специалистов Hugging Face, требующее внимательного изучения и работы с кодом. Если вы готовы к этому, книга станет мощным ускорителем. Она систематизирует разрозненные знания из статей, документации и курсов, упаковывая их в продуманную, последовательную и, главное, применимую на практике систему.

Как метко сказано в одной из цитат на обложке: «В этой книге есть всё необходимое для старта в генеративном ИИ: от всеобъемлющих объяснений до продуманных советов и практических упражнений». Сложно не согласиться.

Автор: BHV_publishing

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/26441

URLs in this post:

[1] новая книга: https://bhv.ru/product/generativnyj-ii-na-praktike-transformery-i-diffuzionnye-modeli/?utm_source=habr&utm_medium=article&utm_campaign=bhv_20260302

[2] опыт: http://www.braintools.ru/article/6952

[3] потребностей: http://www.braintools.ru/article/9534

[4] обучения: http://www.braintools.ru/article/5125

[5] логично: http://www.braintools.ru/article/7640

[6] внимания: http://www.braintools.ru/article/7595

[7] памяти: http://www.braintools.ru/article/4140

[8] интуиции: http://www.braintools.ru/article/6929

[9] Источник: https://habr.com/ru/companies/bhv_publishing/articles/1005404/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1005404

Нажмите здесь для печати.