Галлюцинации недели: GPT-5.4, MacBook на M5 Max и 630 строк, которые автоматизируют ML-ресёрч

Очередной флагман от OpenAI с миллионным контекстом, Claude делает code review, Google обновляет свою быструю малютку, новый MacBook для локального инференса. А что Титов?

OpenAI выпустил [1] GPT-5.4 и GPT-5.4 Pro одновременно, что для них нетипично, обычно Pro-версия появляется через пару недель. Это первая модель семейства 5.x, которая объединяет код и интеллектуальные задачи в одном месте. Контекст до 1M токенов, нативный computer use.

Чтобы активировать 1M контекстное окно в Codex, надо прописать в config.toml:

model = "gpt-5.4"

model_context_window = 1000000

model_auto_compact_token_limit = 900000

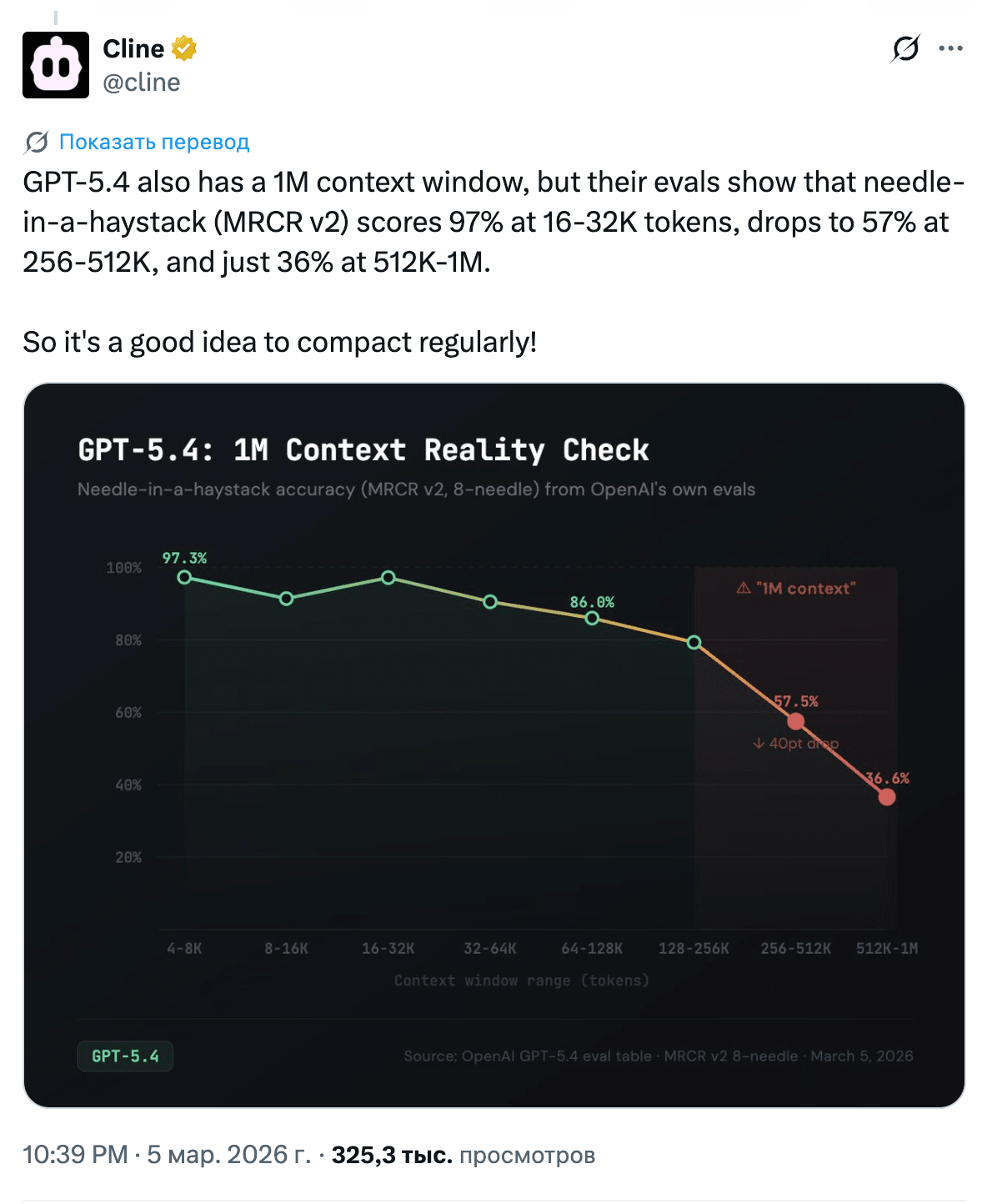

Но есть нюансы. Контекст в миллион токенов не означает миллион полезных токенов: на 16-32K точность ~97%, на 256-512K падает до 57%, а на 512K-1M уже 36% (источник [3]). Плюс к этому, в Codex после 272K потребление увеличится вдвое [4]. То есть реальный потолок так и остаётся где-то в районе 256K.

Я последний месяц 80% кода пишу с помощью 5.3-Codex, и 5.4 ощущается как логичное продолжение. Следование инструкциям заметно подтянули, код читается естественнее. Ожидаю, что в дизайне/фронтенде она стала получше, но я такие задачи поручаю Opus 4.6. В Codex также появился режим /fast, дающий до 1.5x ускорение генерации в обмен на двойное потребление.

Наконец-то выпустили [5] Codex для Windows с нативным sandbox на уровне ОС (ACL, restricted tokens, выделенные пользователи). Поддержка PowerShell, CMD, Git Bash, WSL. Плюс запустили [6] программу Codex for Open Source: мейнтейнерам крупных проектов дают полгода ChatGPT Pro с Codex, доступ к Codex Security и API-кредиты на автоматизацию ревью и релизов. У Anthropic аналогичная программа [7]: 6 месяцев Claude Max 20x для мейнтейнеров репозиториев с 5000+ звёзд или 1M+ скачиваний в NPM.

И бонус: за неделю OpenAI сбросили [8] лимиты в Codex раза 3-4, каждый раз объясняя это найденным багом. В сообществе это уже стало мемом.

Anthropic запустил [9] Claude Code Review, мультиагентную систему, где параллельные агенты ищут проблемы, верифицируют находки и ранжируют по серьёзности. Внутренние метрики: доля PR с осмысленными комментариями выросла с 16% до 54%, при этом менее 1% находок оказались ошибочными. И тут же в треде Anthropic написали [10], что одно ревью стоит примерно $15-25.

Индустрия пришла к консенсусу: проблема генерации кода решена, узкое горлышко теперь в верификации. Двухагентная архитектура “генератор + ревьюер” становится стандартом, как юнит-тесты когда-то.

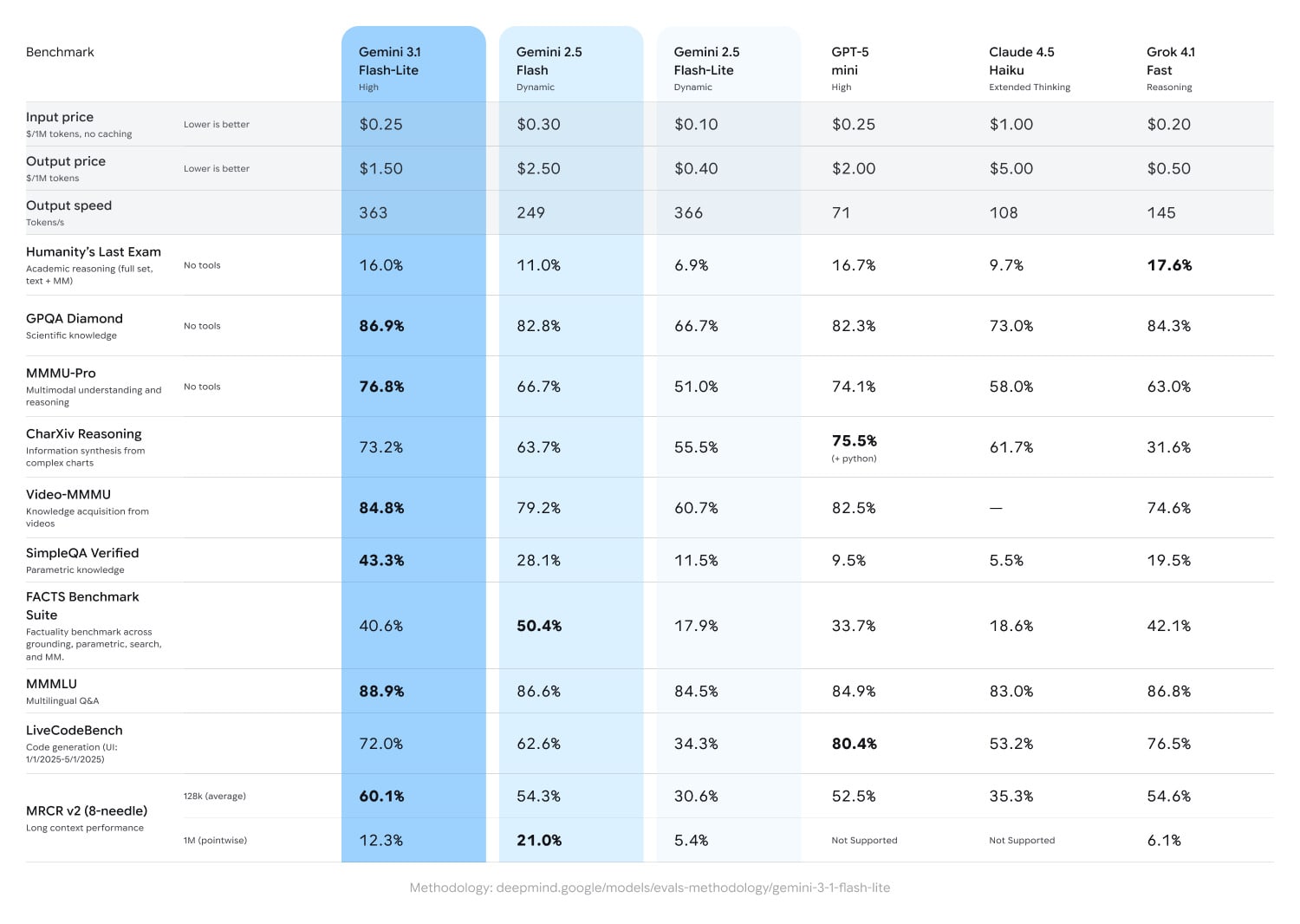

Google выкатил [13] Gemini 3.1 Flash-Lite. Регулируемый thinking level [14], где ты сам выбираешь баланс между интеллектом [15] и скоростью. Заявлено больше 360 tok/sec и миллионный контекст. Да, стало дороже по сравнению с предшественником Gemini 2.5 Flash-Lite: $0.25/$1.50 за миллион токенов. Google не пытается конкурировать с флагманами, в собственных бенчмарках модель сравнивают с GPT-5 mini и Claude Haiku, а не с Opus или GPT-5.4. Это рабочая лошадка для пайплайнов: мультимодальный ввод (текст, картинки, видео, аудио, PDF) на высокой скорости вместо самописных парсеров. Я с удовольствием переключил на новую модель свой суммаризатор и переводчик.

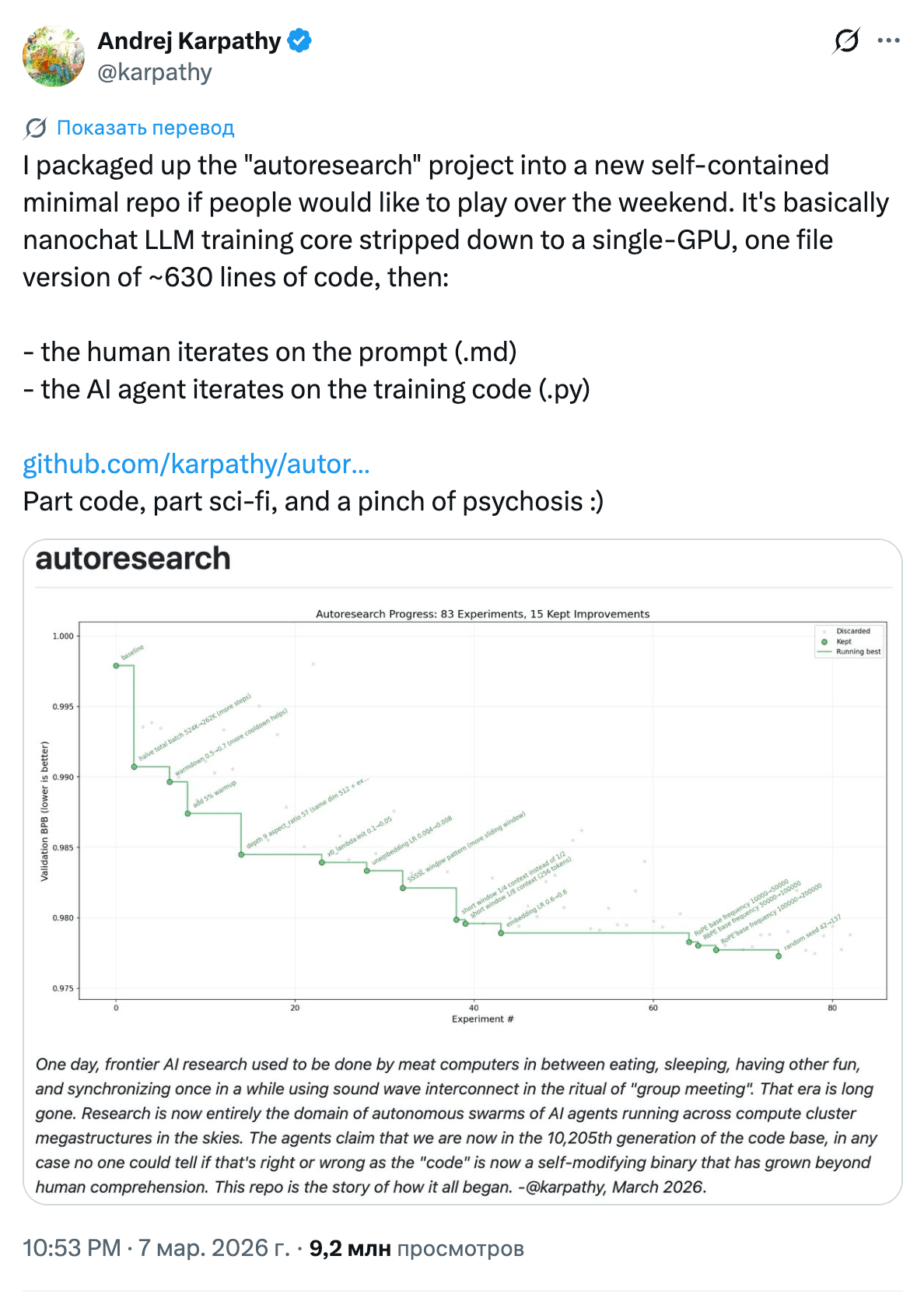

Андрей Карпаты выложил [16] autoresearch, репозиторий [17] на ~630 строк. Идея простая: AI-агент в цикле сам меняет параметры, запускает эксперимент, смотрит на результат и пробует снова, без участия человека. За ~700 таких итераций агент нашёл 20 улучшений, которые сократили время обучения [18] GPT-2 на 11%. И улучшения переносятся на модели побольше. Ещё в декабре 2025-го Yi Tay ввёл в оборот [19] термин vibe training для подобного подхода: ты не смотришь, что агент меняет, просто проверяешь метрики. Autoresearch, по сути, первая рабочая реализация этой идеи.

Применяют autoresearch уже не только для обучения: CEO Shopify адаптировал [20] фреймворк для своего проекта qmd [21], прогнал 37 экспериментов за ночь и получил 19% улучшение на модели 0.8B. Сам Карпаты говорит о следующем шаге: распределённые исследования в стиле SETI@home. Кстати, GPT-5.4 xhigh проигрывает [22] Opus 4.6, который спокойно крутит 118 экспериментов за 12+ часов. Проблема подтверждена [23] автором.

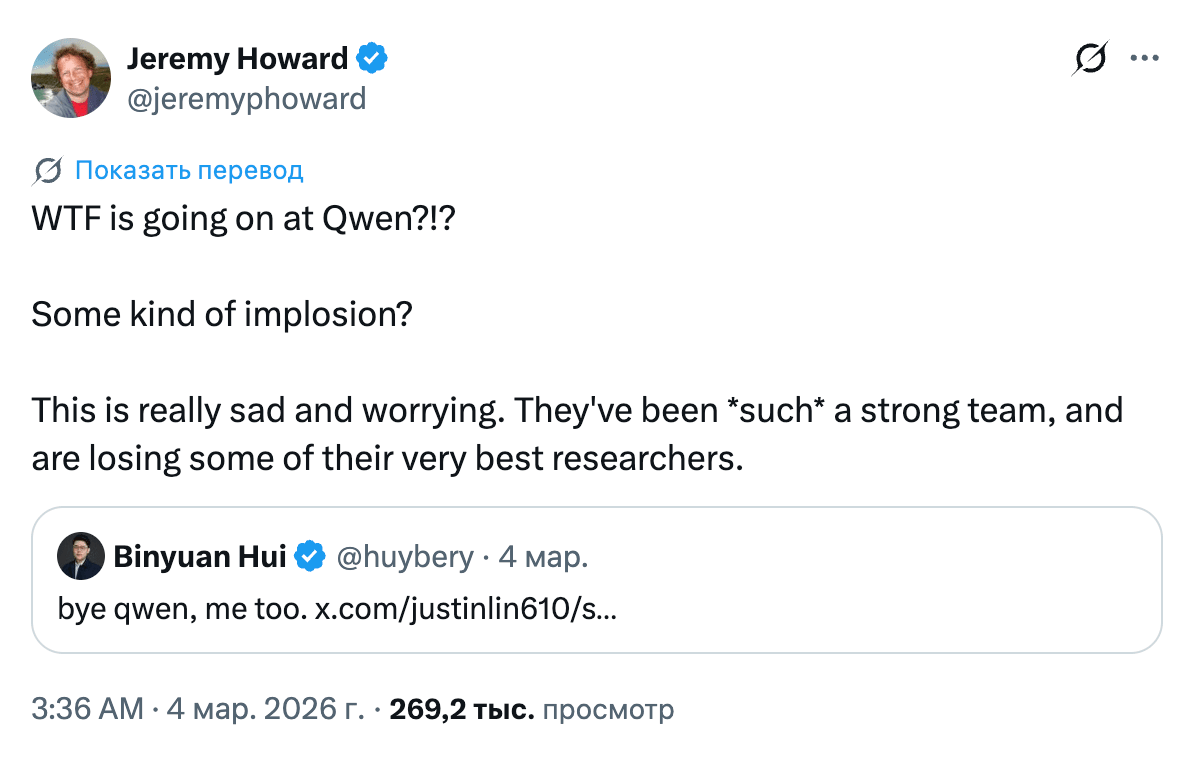

Про модели Qwen 3.5 я рассказывал [24] на прошлой неделе, 9B всё ещё трудится на моей машинке. Но на этой неделе важнее другое: команду покинул [25] технический лидер, а за ним ещё несколько ключевых людей, включая Hui Binyuan (lead Qwen Code), который ушёл в Meta. На замену Alibaba наняла Zhou Hao из Google DeepMind. CEO Alibaba Cloud пообещал [26] продолжить open source стратегию, но когда уходят люди, обещания стоят дешевле кода.

Apple представила [27] новые MacBook на M5 Pro и M5 Max. M5 Pro: до 64GB единой памяти [28], 307GB/s пропускной способности памяти. M5 Max: до 128GB, 614GB/s. SSD до 14.5GB/s (вдвое быстрее M4). Главная цифра для нас: обработка промптов LLM до 4x быстрее M4. Для тех, кто гоняет модели локально, это самое значимое обновление года.

Tri Dao выпустил [29] FlashAttention-4, который достигает скорости attention на уровне matmul на Blackwell. Написан на CuTeDSL (встроенный в Python), компилируется за секунды вместо минут. PyTorch интегрировал [30] FA4 в FlexAttention с ускорением 1.2x-3.2x на вычислительно-ограниченных нагрузках. Ссылка [31] для любителей вчитаться в бумаги.

А vLLM выкатил [32] v0.17 с поддержкой FA4, Qwen3.5 GDN, 5.8x ускорением attention на MI300 благодаря новому Triton-бэкенду, и, что интересно, работой [33] на NVIDIA Jetson без облачных API. Локальный инференс без облака это уже не фантазия.

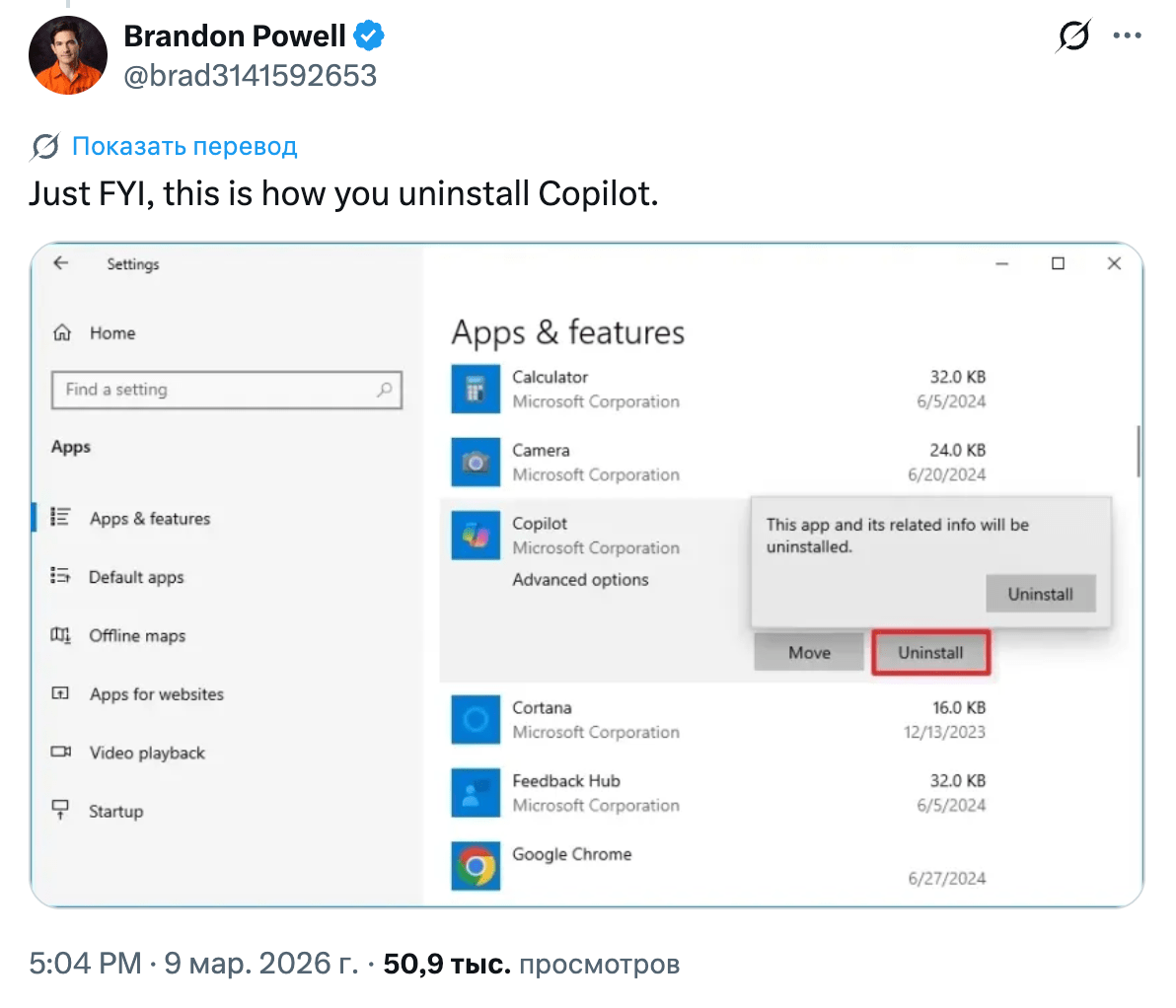

Релиз, который зацепил реакцией [34] сообщества: Microsoft Copilot Cowork [35]. В релизе на сайте написано: “Тесно сотрудничая с Anthropic, мы интегрировали технологию Claude Cowork в Microsoft 365 Copilot”. Так вы же вроде с OpenAI в десна целовались?

В треде с анонсом [36] сразу видно, как пользователи относятся [37] к Copilot.

Арифметика на закуску. На странице Codex [38] видно 5-часовые лимиты GPT-5.4 (недельные OpenAI не раскрывает):

┌─────────┬─────────────────┬───────────┐

│ Вариант │ Лимит сообщений │ Стоимость │

├─────────┼─────────────────┼───────────┤

│ 1× Pro │ 223–1120 │ $200/мес │

├─────────┼─────────────────┼───────────┤

│ 7× Plus │ 231–1176 │ $140/мес │

└─────────┴─────────────────┴───────────┘

Если пользуетесь Codex, можно сэкономить $60. Вот ссылка [39] как это реализовать.

Думайте [40]. И оставайтесь любопытными.

Взгляд инди-хакера на AI и разработку: глубокое погружение в языковые модели, гаджеты и self-hosting через практический опыт [41] в моем телеграм канале [42].

Автор: xonika9

Источник [43]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/26928

URLs in this post:

[1] выпустил: https://openai.com/index/introducing-gpt-5-4/

[2] Image: https://sourcecraft.dev/

[3] источник: https://x.com/cline/status/2029642984351010874

[4] вдвое: https://openai.com/index/introducing-gpt-5-4/#:~:text=usage%20limits%20at-,2x%20the%20normal%20rate,-.

[5] выпустили: https://x.com/OpenAIDevs/status/2029252453246595301

[6] запустили: https://developers.openai.com/codex/community/codex-for-oss

[7] аналогичная программа: https://claude.com/contact-sales/claude-for-oss

[8] сбросили: https://x.com/thsottiaux/status/2031216405266481489

[9] запустил: https://x.com/claudeai/status/2031088171262554195

[10] написали: https://x.com/claudeai/status/2031088175456903667

[11] подхватил: https://x.com/rohanvarma/status/2031113869666693351

[12] добавила: https://x.com/cognition/status/2031139257000075675

[13] выкатил: https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-flash-lite/

[14] thinking level: https://ai.google.dev/gemini-api/docs/thinking#thinking-levels:~:text=control%20thinking%20behavior.-,Thinking,-levels%20(Gemini%203)

[15] интеллектом: http://www.braintools.ru/article/7605

[16] выложил: https://x.com/karpathy/status/2031135152349524125

[17] репозиторий: https://github.com/karpathy/autoresearch

[18] обучения: http://www.braintools.ru/article/5125

[19] ввёл в оборот: https://www.latent.space/p/captaining-imo-gold-deep-think-on

[20] адаптировал: https://x.com/tobi/status/2030771823151853938

[21] qmd: https://github.com/tobi/qmd

[22] проигрывает: https://x.com/Yuchenj_UW/status/2031044694441148709

[23] подтверждена: https://x.com/karpathy/status/2031083551387701698

[24] рассказывал: https://gotacat.dev/blog/weekly-ai-hallucinations-pentagon-anthropic-qwen-3-5-claude-identity-crisis#:~:text=%D0%BB%D0%BE%D0%BA%D0%B0%D0%BB%D1%8C%D0%BD%D1%8B%D0%BC%20%D0%BC%D0%BE%D0%B4%D0%B5%D0%BB%D1%8F%D0%BC.%20Alibaba-,%D0%B2%D1%8B%D0%BF%D1%83%D1%81%D1%82%D0%B8%D0%BB%D0%B0,-Qwen%203.5%2C%20%D0%BF%D0%BE%D0%BB%D0%BD%D1%83%D1%8E

[25] покинул: https://x.com/JustinLin610/status/2028865835373359513

[26] пообещал: https://x.com/poezhao0605/status/2029396117239276013

[27] представила: https://www.apple.com/newsroom/2026/03/apple-introduces-macbook-pro-with-all-new-m5-pro-and-m5-max/

[28] памяти: http://www.braintools.ru/article/4140

[29] выпустил: https://twitter.com/tri_dao/status/2029569881151263082

[30] интегрировал: https://x.com/PyTorch/status/2029617988899381376

[31] Ссылка: https://arxiv.org/abs/2603.05451

[32] выкатил: https://x.com/vllm_project/status/2030178775212671148

[33] работой: https://x.com/vllm_project/status/2030839132512002217

[34] реакцией: http://www.braintools.ru/article/1549

[35] Copilot Cowork: https://www.microsoft.com/en-us/microsoft-365/blog/2026/03/09/copilot-cowork-a-new-way-of-getting-work-done/

[36] треде с анонсом: https://x.com/satyanadella/status/2030992877665583440

[37] относятся: https://x.com/brad3141592653/status/2031008306605506680

[38] странице Codex: https://developers.openai.com/codex/pricing?codex-usage-limits=gpt-5-4#what-are-the-usage-limits-for-my-plan

[39] ссылка: https://github.com/router-for-me/CLIProxyAPI

[40] Думайте: https://res.cloudinary.com/gotacat-dev/image/upload/v1773150989/Gemini_Generated_Image_jjpjoujjpjoujjpj_dc2c963e74.jpg

[41] опыт: http://www.braintools.ru/article/6952

[42] моем телеграм канале: https://t.me/+eOBqt-i-YS4zZTgy

[43] Источник: https://habr.com/ru/news/1008774/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1008774

Нажмите здесь для печати.