Гигантские чипы Cerebras для работы с моделями ИИ

Amazon.com Inc. планирует использовать чипы от стартапа Cerebras Systems Inc. вместе со своими собственными процессорами Trainium.

По словам компаний, такое сочетание позволит лучше использовать программное обеспечение для искусственного интеллекта [1].

Согласно заявлению, опубликованному в пятницу, Amazon Web Services, крупнейший поставщик облачных вычислительных мощностей, во второй половине 2026 года начнёт предлагать новую услугу на основе этого соглашения.

Это партнерство — очередная попытка удовлетворить растущий спрос на вычислительную инфраструктуру для искусственного интеллекта. По словам вице-президента Amazon Web Services Нафеи Бшары, обе компании готовились к этому сотрудничеству несколько лет. По его словам, AWS будет устанавливать столько чипов, сколько потребуется.

Для компании Cerebras, которая планирует провести первичное публичное размещение акций, сотрудничество с Amazon в качестве клиента поможет повысить ее значимость на огромном потенциальном рынке. AWS — первый из гиперскейлеров, крупнейших операторов центров обработки данных, кто согласился использовать решения Cerebras.

Чипы этих двух компаний будут работать вместе в рамках так называемых логических вычислений — процесса запуска программного обеспечения на основе искусственного интеллекта и генерации ответов на поступающие запросы.

В рамках уникальной схемы процессор Trainium 3 от Amazon будет отвечать за предварительную обработку пользовательских запросов.

Затем за дело возьмется Wafer Scale Engine от Cerebras, который сгенерирует ответы.

У такой так называемой дезагрегированной работы обычно есть один недостаток: взаимодействие между различными компонентами замедляет процесс.

В этом случае компании стремятся получить преимущество за счет использования специализированных чипов, которые быстрее справляются с задачами логического вывода.

Улучшения будут особенно заметны в тех областях, где требуется взаимодействие с пользователем, например при создании компьютерного кода, которое выполняется в несколько этапов.

По словам Бшары, несмотря на то, что услуга только с использованием Trainium, скорее всего, будет стоить дешевле, новое комплексное предложение с использованием чипов будет привлекательным «там, где время — деньги».

Генеральный директор Cerebras Эндрю Фельдман заключил контракты с крупнейшими пользователями оборудования для искусственного интеллекта и считает, что это подтверждает эффективность необычной разработки его компании.

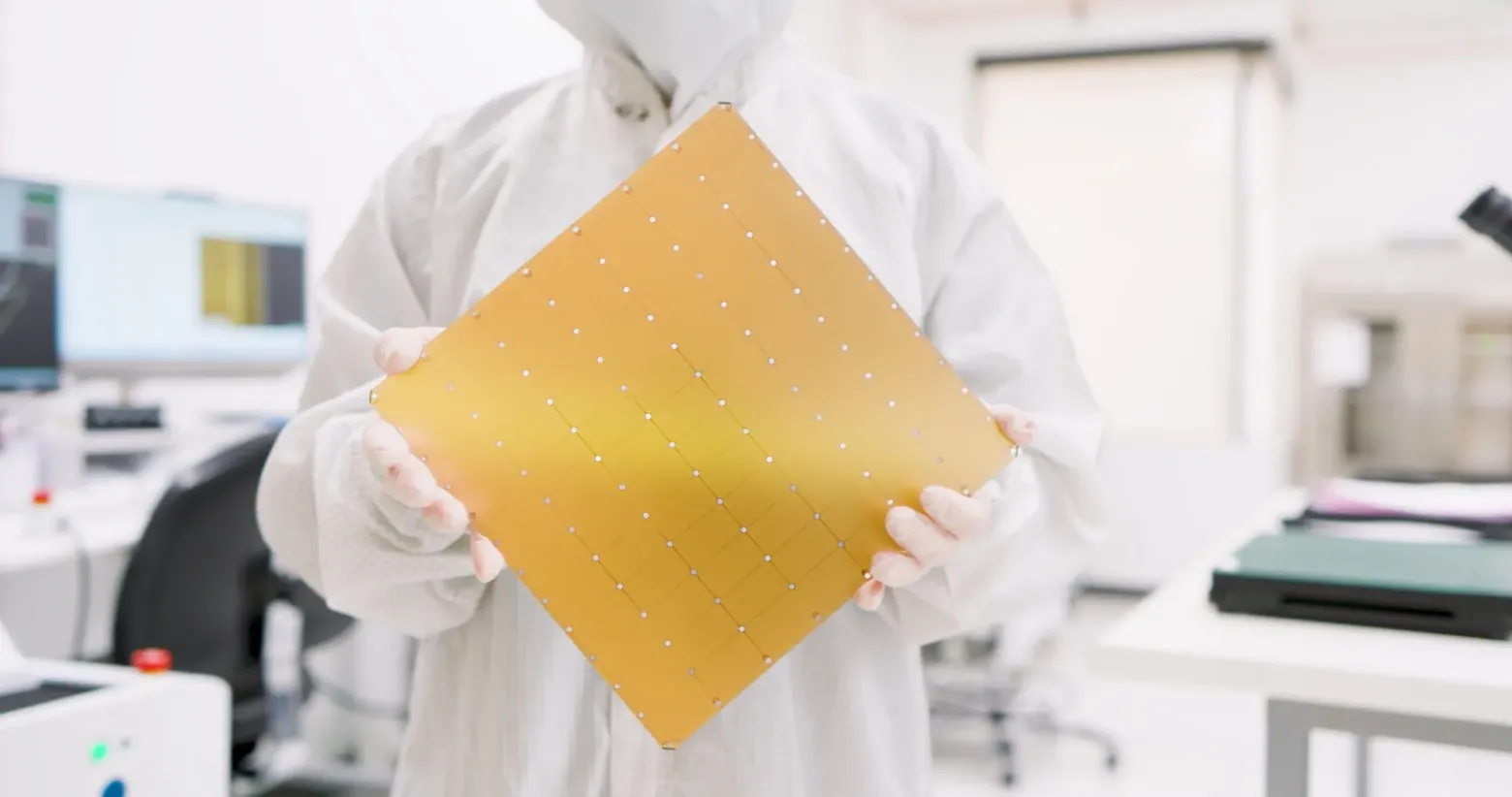

Компания Cerebras разработала уникальный подход к обработке информации с помощью огромных чипов, способных обрабатывать огромные массивы данных за один раз. Компания стремится к широкому внедрению своей технологии, чтобы бросить вызов лидеру рынка Nvidia Corp.

По словам Фельдмана, благодаря анонсу Amazon «самый быстрый логический вывод станет доступен гораздо более широкой аудитории». У Amazon «огромный охват».

OpenAI будет использовать вычислительные мощности Cerebras для ускорения отклика при работе с моделями искусственного интеллекта. Инфраструктура будет создаваться в несколько этапов «до 2028 года» и размещаться на серверах Cerebras, сообщили компании.

«Благодаря этому партнерству ChatGPT станет не только самой мощной, но и самой быстрой платформой искусственного интеллекта в мире», — заявил Грег Брокман, соучредитель и президент OpenAI. Такая скорость поможет реализовать «новые сценарии использования и привлечь к искусственному интеллекту следующий миллиард пользователей», — сказал он.

В октябре компания Advanced Micro Devices Inc. заявила, что в течение нескольких лет будет поставлять для OpenAI графические процессоры потребляемой мощностью 6 гигаватт. Гигаватт — это примерно мощность обычной атомной электростанции.

Компания OpenAI, создатель ChatGPT и других инструментов искусственного интеллекта, также разрабатывает собственный чип совместно с Broadcom Inc.

Согласно заявлению компаний, Cerebras и OpenAI изучали возможность сотрудничества с 2017 года. По словам представителей компаний, недавняя работа Cerebras по поддержке модели GPT-OSS-120B от OpenAI показала, что она работает в 15 раз быстрее, чем «обычное оборудование».

Основатель и генеральный директор компании Cerebras Эндрю Фельдман сказал, что этап логического вывода в искусственном интеллекте — процесс, в ходе которого модели реагируют на запросы, — имеет решающее значение для развития технологии, и именно в этом его продукты особенно хороши.

«Они выбирают новую, отличную от прежней архитектуру, потому что она быстрее и приносит им больше пользы, — сказал Фельдман в интервью. — Эта сделка выводит нас в высшую лигу и делает высокоскоростной логический вывод мейнстримом».

Автор: nikolz

Источник [2]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27100

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] Источник: https://habr.com/ru/news/1010104/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1010104

Нажмите здесь для печати.