Как Amazon обогнала NVIDIA на три дня — и, возможно, изменила будущее ИИ-железа

Через несколько минут после публикации этой статьи NVIDIA представит то, что ещё недавно считалось бы первым в отрасли: разделённое (disaggregated) аппаратное решение для ИИ.

Но Amazon на этот раз оказалась быстрее. Она представила свою версию этого нового форм-фактора за несколько дней до анонса Дженсена Хуанга. Форм-фактора, который, по моему убеждению, меняет парадигму ИИ-оборудования.

Чтобы мой энтузиазм не выглядел голословным, цель этой статьи — объяснить, что это такое, как повлияет на рынки и как с помощью этого понимания можно предсказать аппаратные дорожные карты NVIDIA, AMD и гиперскейлеров, а также логику [1] их решений по цепочкам поставок.

Вот как это работает — и почему открывает новую эру в железе.

Навстречу ИИ, ориентированному на память

Но сначала — новость. Если коротко: Amazon объявила о партнёрстве с Cerebras [2]. Технология Cerebras будет использоваться для фазы декодирования при инференсе, а собственные чипы Amazon Trainium — для фазы предзаполнения (prefill).

Таким образом, они представили первую в истории разделённую специализацию оборудования для инференса — форм-фактор, который уже сейчас выглядит как новый стандарт обслуживания ИИ-инференса.

Впрочем, если вы не такой же фанат ИИ-железа, как я, вы, вероятно, не поняли ничего из сказанного. Я здесь для того, чтобы это исправить.

Больше мозгов, больше времени на раздумья

В мире ИИ все обожают говорить о важности вычислений. Не модель даёт вам преимущество! Модели у всех подряд сейчас практически одинаковые.

Преимущество даёт объём вычислительных ресурсов. Если спросить: как продвигаться вперёд в ИИ? Ответ сводится к одному из двух (или к их комбинации):

-

Больше бюджетов на обучение [3]. Дать моделям больше данных. Модели в итоге становятся крупнее, но суть не в размере — а в объёме данных и вычислений.

-

Больше бюджетов на инференс. Позволить моделям «думать дольше над каждой задачей».

По-человечески: первое — это как иметь мозг [4] побольше и больший жизненный опыт [5] (сравните взрослого и ребёнка). Второе — как иметь больше времени на раздумья.

Всё это транслируется в острую потребность [6] в вычислительных мощностях. Однако слово «вычисления» здесь берёт на себя слишком много. Когда вы фокусируетесь именно на инференсе, расклад начинает решительно смещаться в сторону другого аппаратного компонента: памяти [7].

Узкое место в памяти и самая важная метрика в ИИ-железе

Для автогрессивных больших языковых моделей (LLM) — а это, по сути, все передовые модели сегодня — главный фактор производительности не в том, насколько мощны ваши вычислительные чипы. А в том, насколько быстро они могут перемещать данные из памяти и обратно.

В ИИ, как и в большинстве вычислительных задач, данные хранятся не в самом процессоре, а в отдельных чипах памяти. Чтобы процессоры обработали данные, память должна их «подать». Эта подача не мгновенна и измеряется в байтах в секунду. Держите это в голове — без этого дальше будет непонятно.

На практике во время инференса — а он уже составляет основную долю всех ИИ-вычислений — ускорители работают с существенной «скидкой» по вычислениям. Они слишком мощные для того объёма данных, который могут перемещать.

Это измеряется метрикой, которая называется арифметическая интенсивность (arithmetic intensity, AR). Она показывает, сколько операций с плавающей запятой (FLOP) оборудование теоретически может выполнить на каждый перемещённый байт данных.

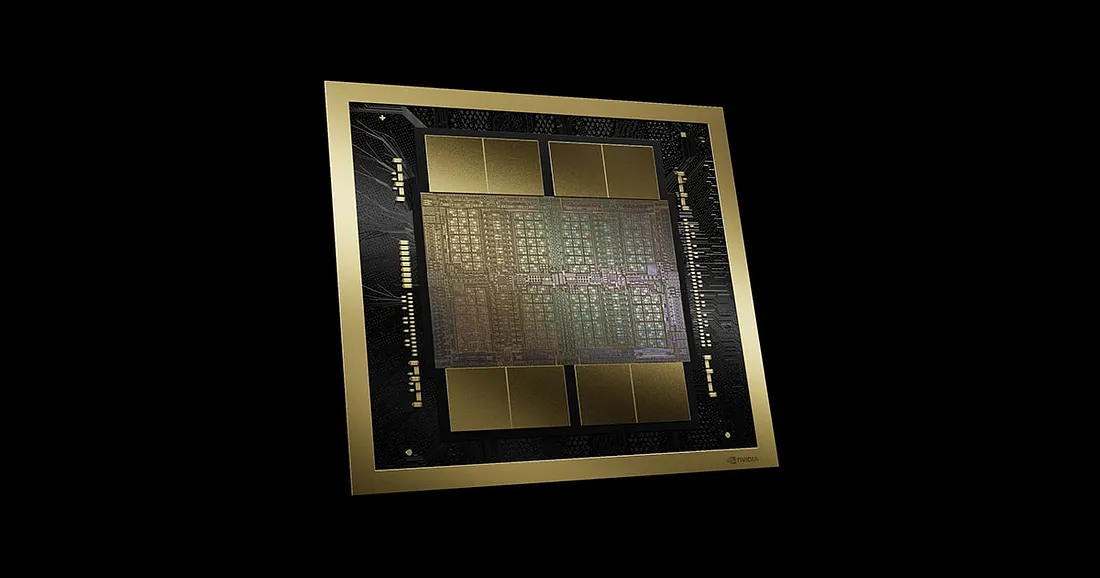

Например, для NVIDIA B300 [8]: 9 петафлопс FP8 на GPU при пропускной способности HBM 8 ТБ/с. Делим: 9 × 10¹⁵ / 8 × 10¹² = примерно 1 125 операций на байт.

AR звучит сложно, но интуитивно всё просто: это мера эффективности работы.

Давайте закрепим аналогией. Представьте, что вы курьер FedEx, и вам нужно доставить 10 посылок. Ваш грузовик вмещает все 10 — загрузи и развези за один рейс. Но каждый раз, когда вы приезжаете на склад, вам выдают только одну посылку.

Результат? Несмотря на то что грузовик мог бы забрать всё разом, неэффективность склада заставляет вас возвращаться снова и снова — хотя грузоподъёмности хватило бы на один заезд.

Именно это происходит с GPU: вычислительные чипы (грузовик) настолько мощнее чипов памяти (склада), что вынуждены работать с огромным недогрузом. А электричество (топливо) при этом потребляется в полном объёме.

Другими словами, GPU работают, но доход на ватт — гораздо ниже, чем мог бы быть.

И пока одни перестраивают аппаратную парадигму, вы уже сейчас ��ожете пользоваться результатами — теми самыми моделями, ради которых это всё строится. Сервисы вроде BotHub дают доступ к ведущим мировым нейросетям — GPT-5.4, Claude 4.6 и другим — в одном интерфейсе. Без необходимости разбираться в SRAM и HBM. Просто инструмент для ваших задач.

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов [9] для первых задач и приступить к работе с нейросетями прямо сейчас!

Две фазы инференса

Все привыкли считать: инференс = упирается в память. Но это не совсем так — зависит от фазы.

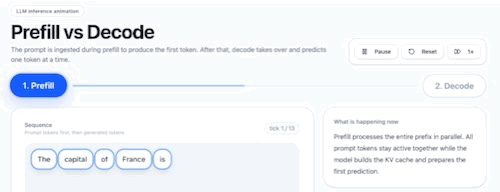

У инференса две фазы, видимые даже пользователю:

Prefill (предзаполнение). Время от нажатия «Отправить» в ChatGPT до появления первого слова ответа. Модель «строит контекст» — обрабатывает весь ваш запрос целиком.

Decode (декодирование). Начинается, когда вы видите, как токены генерируются один за другим. Обычно длится значительно дольше и заканчивается, когда модель завершает ответ.

И вот в чём дело: тезис про «упирается в память» касается в основном декодирования. Prefill, по сути, в память вообще не упирается.

Почему? Во время построения контекста «повторное использование модели» очень высокое — модель обрабатывает большой объём слов (весь ваш контекст) одновременно. Вычислительная нагрузка на байт данных — высокая.

Но к концу prefill происходят две вещи. Во-первых, модель построила кэш для последовательности — так называемый KV-кэш. Контекст создан, и заново его строить не нужно. Во-вторых, с этого момента единственный «новый контекст», который модель увидит, — это ровно один токен: тот, который она только что предсказала.

И вот тут начинается проблема. Хотя каждое следующее слово требует меньше вычислительных усилий, модель всё равно должна сделать предсказание — и для этого задействуется целиком. Весь вес модели перемещается через память каждый раз, но реальной работы на каждый перемещённый байт — всё меньше.

Арифметическая интенсивность рушится. При том же знаменателе (пропускная способность памяти) числитель (полезные вычисления) падает. А ещё появляется KV-кэш, который тоже нужно гонять через память — знаменатель растёт, AR падает ещё ниже.

Возвращаясь к нашей аналогии: у вас грузовик на 100 посылок, а спрос на маршруте упал до 20. Грузовик стал не нужен такого размера — но другого нет.

Мы буквально едем на Ferrari со скоростью 30 километров в час в пробке.

Иерархия памяти

Чтобы понять решение, нужен краткий обзор того, как устроена память внутри ИИ-сервера.

Два типа памяти:

-

SRAM — «на кристалле». Буквально часть чипа, который проектирует NVIDIA и производит TSMC. Наименее ёмкая (меньше ГБ на единицу площади), но самая быстрая: физически ближе к вычислительным схемам и не требует обновления.

-

DRAM — «вне кристалла». Часть корпуса GPU, соединённая с вычислительными кристаллами через кремниевый интерпозер. В ИИ используется HBM DRAM — память с высокой пропускной способностью. Она не «быстрее» обычной DRAM, но имеет значительно более широкую шину — представьте шоссе, где каждая полоса имеет обычное ограничение скорости, но самих полос — огромное количество.

Плюс два типа хранилища: флеш-память (быстрая) и HDD (медленный).

Ключевая идея: если рабочая нагрузка не помещается целиком в быструю SRAM «на кристалле», в дело вступает DRAM — и пропускная способность памяти падает. А для длинных последовательностей кэш «утекает» даже во флеш-память, создавая третье узкое место.

В сухом остатке: производительность ИИ-инференса определяется не столько мощностью вычислительных чипов, сколько эффективностью «танца данных» между разными слоями памяти.

Выход за пределы HBM

И вот мы подходим к главному.

Amazon объявила о создании гетерогенных серверов для инференса, использующих два типа ускорителей: собственные чипы Trainium3 для prefill и Wafer-Scale Engine (WSE) от Cerebras для decode.

Ключ в том, что решения вроде WSE от Cerebras или LPU от Groq (теперь принадлежащей NVIDIA) работают исключительно на SRAM.

Это делает их исключительно эффективными для фазы декодирования, где пропускная способность памяти — решающий фактор. Почему? Вся нагрузка выполняется «на кристалле». HBM нет вообще. Нет и узкого места HBM.

Данные перемещаются с колоссальной скоростью. SRAM на NVIDIA B300 [10] обеспечивает пропускную способность около 37 ТБ/с. HBM3e — 8 ТБ/с. Разница — в разы.

Тут сразу возникает вопрос: почему не использовать SRAM-чипы для всего инференса? Зачем покупать GPU NVIDIA, если Cerebras или Groq настолько лучше?

По двум причинам. Во-первых, они лучше только для decode, но значительно уступают для обучения и prefill, которые вычислительно тяжелее. Во-вторых, это невероятно дорогие решения.

Простой расчёт: чтобы обслужить Kimi K2.5, самую популярную опенсорсную модель, нужно всего 4 GPU NVIDIA. Но для SRAM-решений потребуется 23 вейфера Cerebras (фактически целый кластер) или более 4 000 чипов Groq. И это без учёта кэша, который может быть больше самой модели.

Компромисс: вы жертвуете экономикой ради экстремальной производительности.

Так что предложили Amazon и NVIDIA? Просто: объединить оба мира в одной системе.

-

Prefill выполняется GPU-подобным оборудованием (чипы NVIDIA или Amazon)

-

Decode выполняется SRAM-оборудованием (Cerebras, Groq)

Настоящее чудо разделённого инференса, которое, по моему убеждению, скоро станет нормой — потому что конкурировать с этим буквально нечем.

Что это значит для рынка

NVIDIA сегодня объявит аналогичное решение. С приобретением Groq они представят новый ИИ-сервер, объединяющий GPU NVIDIA для prefill и LPU Groq для decode. Это закроет все разговоры о том, что NVIDIA рискует быть вытесненной специализированным железом. Теперь они тоже специализированы.

Производители DRAM — SK Hynix, Samsung, Micron — могут ощутить давление. Если значительная часть инференса перейдёт на оборудование без HBM, это не лучшая новость для «большой тройки памяти». Хотя DRAM-компании продадут каждый произведённый гигабит в ближайшие годы, акции могут просесть, если инвесторы решат, что Amazon и NVIDIA диверсифицируются от DRAM в пользу SRAM. На деле это не совсем так — DRAM по-прежнему критически нужна и для GPU, и для CPU, и для кэша, — но не каждый инвестор будет вникать в нюансы.

Геополитический аспект. SRAM-чипы используют более старые техпроцессы (5 нм и выше), снижая нагрузку на 3-нанометровые линии. Это геополитически ценно: теоретически можно уменьшить зависимость от Тайваня, используя менее продвинутые чипы, над которыми Тайвань не имеет столь жёсткого контроля.

AMD оказывается в непростом положении. Если тренд на разделённый инференс материализуется — а он материализуется, — AMD стоит задуматься о приобретении Cerebras (хотя те, похоже, готовят IPO) или хотя бы о заключении аналогичного партнёрства. Иначе они рискуют пропустить поезд инференса, и им придётся фокусироваться на обучении и — что, на мой взгляд, важнее — на CPU, где AMD традиционно очень сильна.

Google полагается на масштаб и вертикальную интеграцию. TPU по определению заточены под собственные модели Google, что естественно снижает давление на них в части разделения оборудования. К тому же разделённые серверы инференса по определению будут очень крупными — а масштаб как раз то, в чём Google сияет.

Автор: cognitronn

Источник [11]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27299

URLs in this post:

[1] логику: http://www.braintools.ru/article/7640

[2] Amazon объявила о партнёрстве с Cerebras: https://www.aboutamazon.com/news/aws/aws-cerebras-ai-inference

[3] обучение: http://www.braintools.ru/article/5125

[4] мозг: http://www.braintools.ru/parts-of-the-brain

[5] опыт: http://www.braintools.ru/article/6952

[6] потребность: http://www.braintools.ru/article/9534

[7] памяти: http://www.braintools.ru/article/4140

[8] для NVIDIA B300: https://docs.nvidia.com/dgx/dgxb300-user-guide/introduction-to-dgxb300.html?utm_source=chatgpt.com

[9] По ссылке вы можете получить 300 000 бесплатных токенов: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[10] SRAM на NVIDIA B300: https://arxiv.org/html/2603.05451v1?utm_source=chatgpt.com

[11] Источник: https://habr.com/ru/companies/bothub/articles/1011608/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1011608

Нажмите здесь для печати.