Xiaomi выпускает три модели MiMo: для агентов, роботов и голоса

Xiaomi хочет создавать AI-агенты, которые сами управляют софтом, ходят по браузерам и в итоге будут управлять роботами. Чтобы дойти до этого, внутренняя команда MiMo сразу выпустила три модели.

Флагманская MiMo-V2-Pro [1] построена на Mixture-of-Experts архитектуре (модель разделена на блоки-эксперты, где для каждого запроса активируется только часть). Общее число параметров – свыше триллиона, из которых 42 миллиарда активны на каждый запрос. Это примерно в три раза больше, чем у предшественника MiMo-V2-Flash, вышедшего в декабре 2025 года.

Несмотря на рост масштаба, гибридный attention-механизм (способ модели уделять внимание [2] разным частям входных данных) поддерживает эффективность. Модель справляется с контекстным окном до одного миллиона токенов. Кроме того, она генерирует несколько токенов за раз вместо предсказания по одному слову. Это даёт заметный прирост скорости.

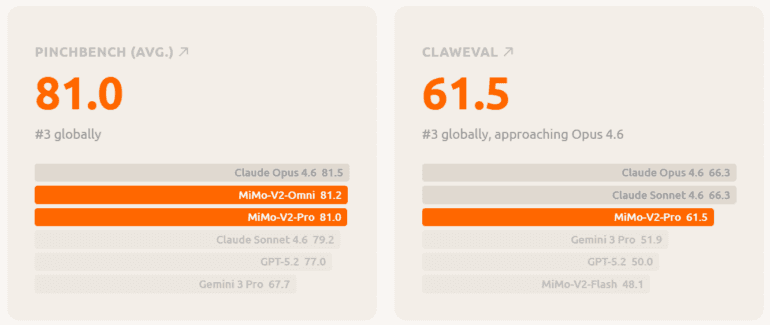

В Artificial Analysis Intelligence Index [1] MiMo-V2-Pro расположилась на седьмой строчке в мире. Это лучшая среди китайских моделей после GLM-5 и MiniMax-M2.7. На кодинговом бенчмарке SWE-bench Verified она набирает 78%, чуть не дотянув до Claude Opus 4.6 (80,8%) и практически вплотную к Claude Sonnet 4.6 (79,6%). На агентском бенчмарке ClawEval модель набирает 81 балл, почти равняясь Claude Opus 4.6 с его 81,5, тогда как GPT-5.2 остаётся на 77.

Xiaomi сильно демпингует против Anthropic

Xiaomi атакует конкурентов ценой. Согласно странице платформы [3], MiMo-V2-Pro стоит $1 за миллион входных токенов и $3 за миллион выходных при длине контекста до 256 000 токенов. Для сравнения: Claude Sonnet 4.6 стоит $3 или $15, а Claude Opus 4.6 — $5 или $25. Кроме того, Xiaomi пока полностью отменяет плату за запись в кэш.

Модель доступна через публичный API. К запуску Xiaomi привлекла пять агентских фреймворков: OpenClaw, OpenCode, KiloCode, Blackbox и Cline. Разработчики со всего мира получают бесплатный доступ к API на одну неделю.

MiMo-V2-Omni: видит, слышит и действует в одной модели

MiMo-V2-Omni [4] объединяет image-, video- и audio-энкодеры (модули для обработки изображений, видео и аудио) в единую backbone-сеть (базовую сеть, обрабатывающую все типы данных вместе). Модель воспринимает входящие данные и действует на их основе. Она нативно поддерживает структурированные tool calls (вызовы внешних инструментов в стандартном формате), выполняет функции и самостоятельно навигируется по пользовательским интерфейсам.

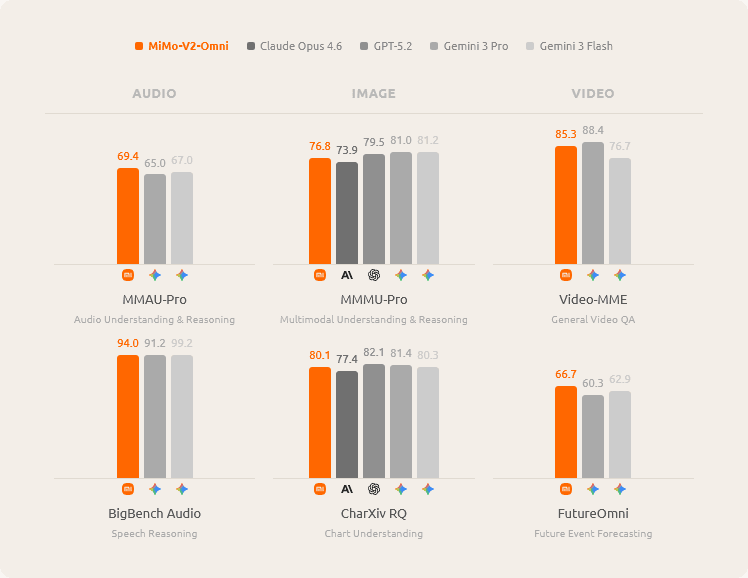

Xiaomi заявляет, что MiMo-V2-Omni обходит Gemini 3 Pro по аудио и способна непрерывно записывать более десяти часов. На изображениях (MMMU-Pro: 76,8) она обходит Claude Opus 4.6 (73,9). Но агентские бенчмарки показывают иную картину: на ClawEval модель набирает лишь 54,8 — заметно позади Claude Opus 4.6 (66,3) и GPT-5.2 (59,6). Зато на веб-навигационном бенчмарке MM-BrowserComp она обошла и Gemini 3 Pro, и GPT-5.2.

Для демонстрации Xiaomi скормила модели записи с видеорегистратора. Модель в реальном времени помечала пешеходов, встречные машины и заторы как потенциальные опасности. В другом сценарии MiMo-V2-Omni сама открыла браузер, нашла отзывы о товаре на Xiaohongshu, сравнила цены на JD.com [5], поторговалась за скидку через чат поддержки и оформила покупку.

Отдельный демо показал, как модель создаёт мультимедийный контент, дебажит его код и публикует результат в TikTok через браузер – всё без участия человека. Во всех случаях MiMo-V2-Omni принимает решения, а open-source фреймворк OpenClaw выполняет фактические клики и файловые операции.

MiMo-V2-TTS: эмоциональная речь по описанию на естественном языке

По словам Xiaomi, модель синтеза речи MiMo-V2-TTS [6] обучена на более чем 100 миллионах часов аудио. Она разбирает речь на несколько параллельных слоёв дискретных единиц (базовых звуковых элементов). Это даёт более тонкий контроль над звучанием, ритмом и эмоциями [7], чем стандартные TTS-системы.

Ключевое отличие: вместо выбора эмоции [8] из выпадающего списка пользователь описывает нужный голос обычным языком. «Сонный, только что проснулся, слегка хриплый» звучит иначе, чем «злой, но старающийся сдержаться». Модель также генерирует паралингвистические звуки — кашель, паузы-запинки, вздохи и смех — как часть вывода, а не склеивает аудиоклипы постфактум.

По заявлению Xiaomi, MiMo-V2-TTS — единственный коммерчески доступный TTS API, который нативно обрабатывает и речь, и пение в одной модели. Она считывает типографские сигналы вроде заглавных букв или повторяющихся символов как указания на акцент и ритм. Так что «ЭТО ВАЖНО» звучит с настоящим ударом, а не просто громче. Даже без стилевых инструкций модель подхватывает нужную интонацию прямо из текста.

Конкурентные бенчмарки, но Xiaomi ещё есть куда расти

Одновременный выпуск трёх специализированных моделей — чёткий сигнал: Xiaomi строит full-stack платформу для AI-агентов. Бенчмарки показывают, что в некоторых областях модели идут ноздря в ноздрю с Anthropic и OpenAI, а в других пока отстают. В частности, по общим агентским задачам MiMo-V2-Pro ещё предстоит поработать, чтобы догнать Claude Opus 4.6 [9].

Дальше команда MiMo берётся за долгосрочное планирование на масштабе часов и дней, реалтайм-стриминг, координированные multi-agent системы (несколько агентов, работающих вместе) и робототехнику. «Мы верим, что путь к общему интеллекту [10] лежит через реальный мир», — пишет команда [4]. «Модель, которая только читает текст, живёт в библиотеке. Модель, которая видит, слышит, рассуждает и действует, живёт в мире.»

Загадка «Hunter Alpha» — это был не Deepseek

До официального анонса Xiaomi MiMo-V2-Pro появилась анонимно [11] на API-платформе OpenRouter [11] под кодовым именем «Hunter Alpha». Xiaomi говорит, что использование стабильно росло: модель несколько дней подряд возглавляла дневной рейтинг и накрутила в общей сложности свыше триллиона токенов. Самый популярный сценарий — кодинг.

Многие пользователи гадали, что Hunter Alpha на самом деле Deepseek V4. Но Deepseek ещё далеко — по данным, выход следующей крупной модели отложен из-за растущего размера.

Другие китайские AI-лаборатории тоже не сидят сложа руки. Zhipu AI недавно выпустила GLM-5 — open-source модель на 744 миллиарда параметров, нацеленную на конкуренцию с Claude Opus 4.5 и GPT-5.2 по кодингу и агентским задачам. Moonshot AI с моделью Kimi K2.5 идёт другим путём — через рои (группы) параллельно работающих агентов, а Alibaba расширяет линейку Qwen 3.5.

Делегируйте часть рутинных задач вместе с BotHub [12]! Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [13] вы можете получить 300 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [14]

Автор: mefdayy

Источник [15]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27601

URLs in this post:

[1] MiMo-V2-Pro: https://mimo.xiaomi.com/mimo-v2-pro

[2] внимание: http://www.braintools.ru/article/7595

[3] странице платформы: https://platform.xiaomimimo.com/

[4] MiMo-V2-Omni: https://mimo.xiaomi.com/mimo-v2-omni

[5] JD.com: http://JD.com

[6] модель синтеза речи MiMo-V2-TTS: https://mimo.xiaomi.com/mimo-v2-tts

[7] эмоциями: http://www.braintools.ru/article/9540

[8] эмоции: http://www.braintools.ru/article/9387

[9] Claude Opus 4.6: https://the-decoder.de/anthropics-neues-ki-modell-opus-4-6-soll-besser-informationen-in-grossen-datenmengen-finden/

[10] интеллекту: http://www.braintools.ru/article/7605

[11] появилась анонимно: https://openrouter.ai/openrouter/hunter-alpha

[12] BotHub: https://bothub.chat/?utm%5C_source=contentmarketing&utm%5C_medium=habr&utm%5C_campaign=news&utm%5C_content%20=XIAOMI_RELEASES_THREE_MI_MO_MODELS:_FOR_AGENTS,_ROBOTS,_AND_VOICE

[13] По ссылке: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[14] Источник: https://the-decoder.com/xiaomi-launches-three-mimo-ai-models-to-power-agents-robots-and-voice/

[15] Источник: https://habr.com/ru/companies/bothub/news/1013902/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1013902

Нажмите здесь для печати.