Как установить DeepSeek на сервере: практическое руководство

Рано или поздно наступает момент, когда понимаете: без LLM, работающей только на вас, дальше жить нельзя. Публичные модели, даже в платных подписках, — это всегда риск. Сомнения в том, не сливает ли какой-нибудь OpenAI или Alibaba вашу переписку, никуда не деваются, а внезапные «извините, этот сервис недоступен в вашем регионе» или жесткая цензура окончательно все портят.

В этой статье попытаемся решить проблему – рассмотрим, как запустить DeepSeek на своем облачном сервере [1], сколько ей нужно памяти [2] и какие конфиги прописать, чтобы все запустилось с первого раза.

Что такое DeepSeek

Начну с обязательной справки, без этого никак:

DeepSeek — это семейство больших языковых моделей (англ. Large Language Model, LLM), разработанных китайской компанией DeepSeek. Код и модели DeepSeek распространяются открыто под лицензиями, разрешающими как некоммерческое, так и коммерческое использование.

Открытость моделей и исходного кода предоставляет пользователям возможность выбора между конфиденциальностью и удобством:

-

Онлайн-версия. Доступна по адресу chat.deepseek.com [4]. Это основная и самая большая модель, требующая высокой вычислительной мощности. Очень удобна для конечного пользователя, потому что ответ генерирует быстро и не требует настройки. Однако данные из чата в обезличенном виде могут быть использованы для обучения [5] следующих моделей. Это неприемлемо для компаний, которые хотят сохранить свои корпоративные секреты.

-

Локальная версия. Требует настройки и выделенного сервера. Но все данные, передаваемые в языковую модель и сгенерированные ответы доступны только вам.

Для запуска локальной версии DeepSeek нужен мощный сервер. Но насколько мощный? Ответ на этот вопрос зависит от ваших ожиданий от большой языковой модели, а также терпения и бюджета.

Каждая большая языковая модель имеет метрику «количество параметров». Если упрощать, то чем больше параметров — тем умнее модель и тем больше ресурсов нужно, чтобы она работала.

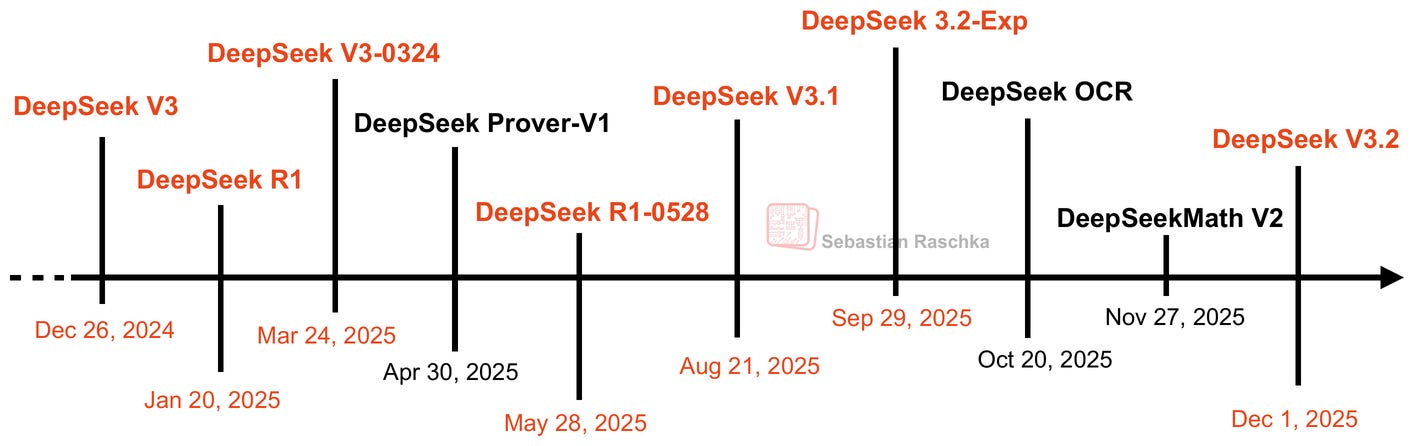

Полная модель DeepSeek-V3.2 содержит 685 млрд параметров. Идеальный сервер для запуска такой модели состоит из 16 связанных между собой видеокарт NVIDIA A100 по 80 ГБ VRAM каждая, а также более 768 ГБ оперативной памяти. Это очень дорогой сервер, который избыточен для домашнего использования.

Для домашнего использования предлагаются дистиллированные модели: более компактные модели, которые обучаются от большой модели. Так, для размышляющей DeekSeek R1 официально существуют дистиллированные модели от 1,5 [6] до 70 [7] млрд параметров. Для запуска модели на семь млрд параметров подходит видеокарта для современных игр, например, 30-ая серия RTX.

Дистиллированные модели могут запускаться на процессоре, а также на разных видеокартах и специальных ускорителях. Оригинальные модели DeepSeek адаптированы для видеокарт NVIDIA с поддержкой технологии CUDA, а с недавнего времени — и для ИИ-ускорителей (NPU) Huawei Ascend.

Для примера будем использовать сервер с видеокартой NVIDIA A5000 — серверным аналогом RTX 3080.

Арендуйте GPU за 1 рубль!

Выберите нужную конфигурацию в панели управления Selectel. *

Подробнее → [8]

Заказываем сервер

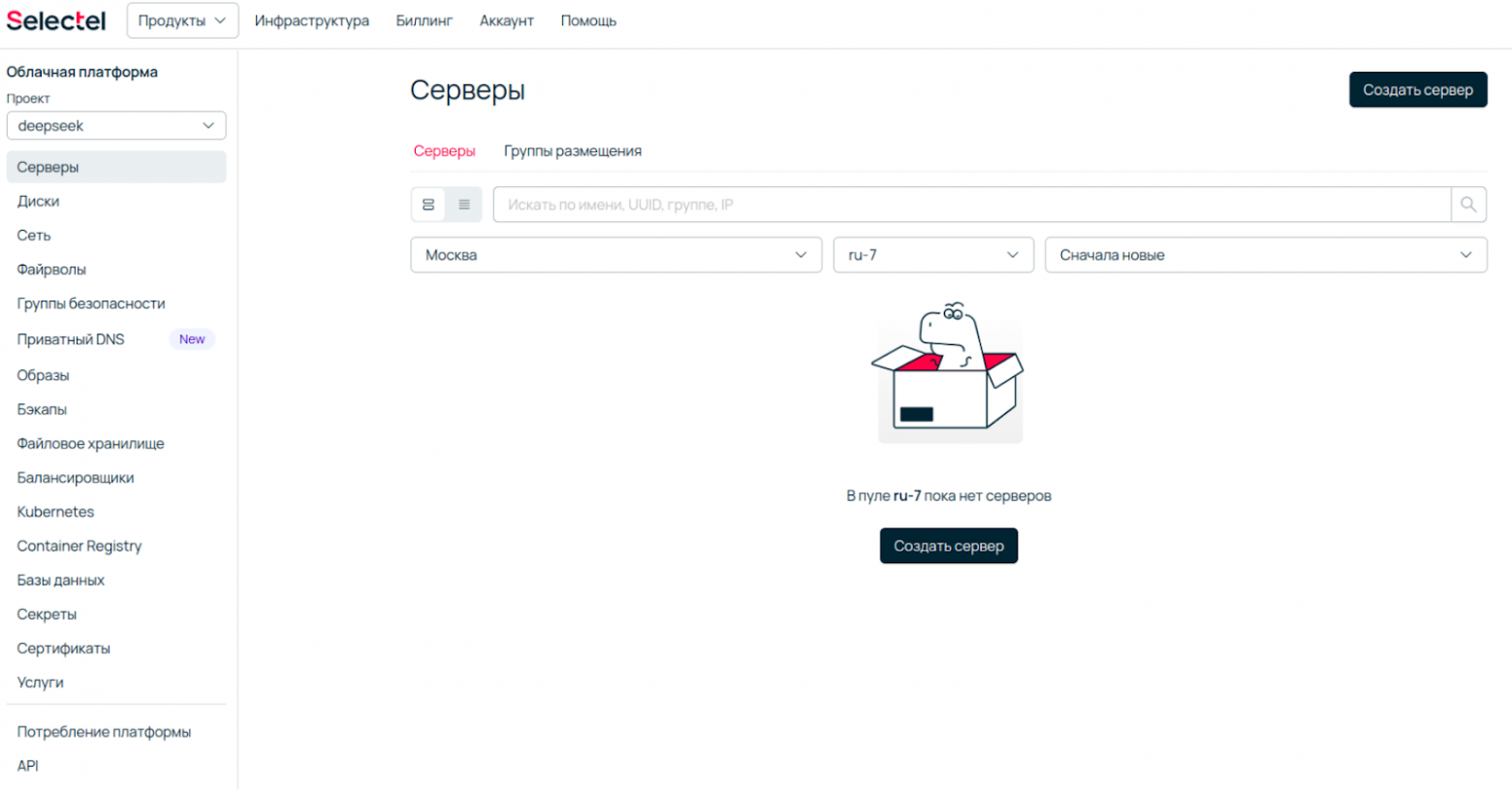

Для запуска локального DeepSeek воспользуемся облачной платформой Selectel [1]. Облачная платформа позволяет удобно масштабировать виртуальный сервер в случае, если нужно больше ресурсов.

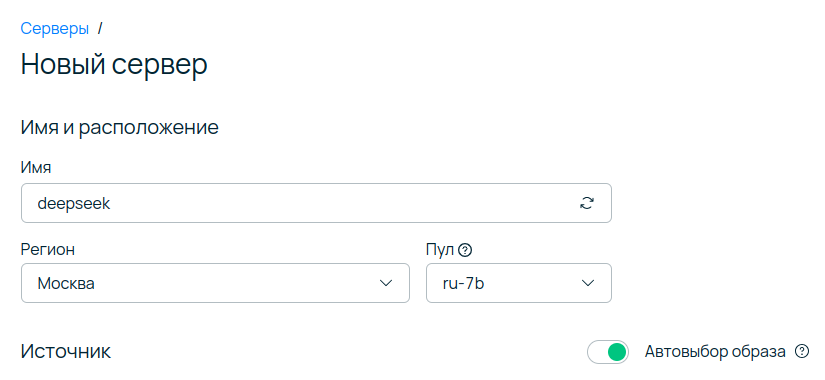

Открываем панель управления [9], выбираем Продукты → Облачные вычисления. Странице серверов нажимаем Создать сервер.

Даем говорящее имя серверу, выбираем регион «Москва» и пул «ru-7», потому что там большой выбор видеокарт, доступных в облачной платформе [1].

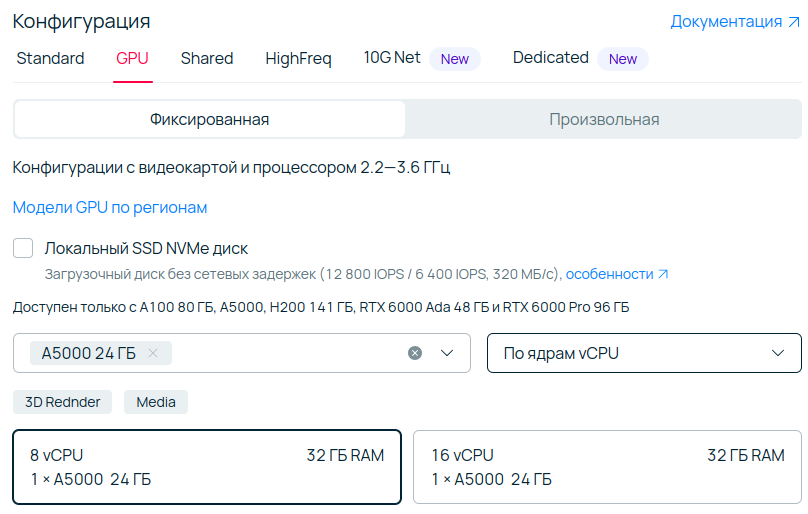

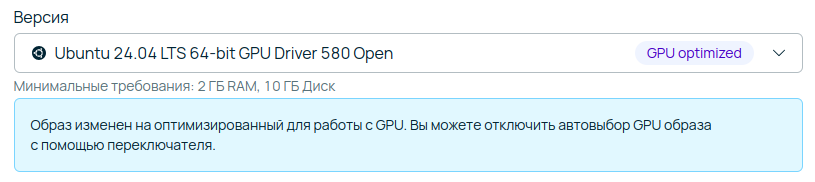

Затем выбираем GPU-конфигурацию и в фильтре по видеокартам выбираем желаемую видеокарту, в нашем случае — A5000. Благодаря автовыбору образа на виртуальную машину будет установлена Ubuntu с драйверами для видеокарты.

Автовыбор выберет образ с драйверами для видеокарты. Нас устраивает выбор. Добавляем SSH-ключ, выбираем настройки сети и дисков. Рекомендую использовать SSD для быстрой загрузки моделей в память.

Создаем сервер и через пару минут он становится доступен. Проверяем подключение по SSH и наличие видеокарты.

$ ssh root@256.324.434.242

root@deepseek:~# nvidia-smi

Sat Mar 14 15:27:46 2026

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 580.126.09 Driver Version: 580.126.09 CUDA Version: 13.0 |

+-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA RTX A5000 Off | 00000000:00:06.0 Off | 0 |

| 30% 33C P2 57W / 230W | 0MiB / 23028MiB | 19% Default |

| | | N/A |

+-----------------------------------------+------------------------+----------------------+

+-----------------------------------------------------------------------------------------+

| Processes: |

| GPU GI CI PID Type Process name GPU Memory |

| ID ID Usage |

|=========================================================================================|

| No running processes found |

+-----------------------------------------------------------------------------------------+Теперь у нас есть сервер, готовый для экспериментов. Осталось поставить большую языковую модель. Как это можно сделать? Есть несколько путей.

Установка DeepSeek

Если вы хотите поиграть с локальной языковой моделью, то вам стоит обратить внимание [10] на решения, которые автоматически скачивают модели и предоставляют удобные веб-интерфейсы для взаимодействия. Если же вы хотите использовать большую языковую модель в своем проекте без лишних зависимостей, то придется выполнить на пару команд больше.

Вне зависимости от выбранного вами способа будет нелишним знать, что все опубликованные модели хранятся на сайте HuggingFace [11]. Если вы хотите скачать модель и использовать ее в своем Python-коде, то, наверняка вы знаете про huggingface-hub [12] и знаете, что делать.

Если же вы в первый раз работаете с большими языковыми моделями, то лучше обратиться к инструменту, который сделает большинство работы за вас.

Harbor [13] — это менеджер, который позволяет управлять моделями и сервисами, которые используют эти модели. Для работы Harbor нужны Docker и git.

Устанавливаем git:

apt update

apt install gitУстанавливаем Docker.

# Устанавливаем

curl https://get.docker.com/ | sh

# Устанавливаем поддержку GPU в Docker

# Скачиваем ключ для репозитория

curl -fsSL https://nvidia.github.io/libnvidia-container/gpgkey | sudo gpg --dearmor -o /usr/share/keyrings/nvidia-container-toolkit-keyring.gpg

# Добавляем репозиторий

echo deb [signed-by=/usr/share/keyrings/nvidia-container-toolkit-keyring.gpg] https://nvidia.github.io/libnvidia-container/stable/deb/$(ARCH) / > /etc/apt/sources.list.d/nvidia-container-toolkit.list

# Обновляем индекс и устанавливаем

apt update

apt install nvidia-container-toolkit

# Обязательно перезагружаем Docker

systemctl restart dockerЗатем устанавливаем Harbor:

curl https://raw.githubusercontent.com/av/harbor/refs/heads/main/install.sh | bashПосле установки перезайдите на сервер — это необходимо, чтобы команда harbor стала доступна.

Обратите внимание, что для лаконичности инструкции используются команды, которые скачивают неизвестный скрипт и выполняют его с правами суперпользователя. Это небезопасно, так как скрипт может быть изменен и содержать вредоносный контент.

Такой подход допустим для краткосрочных проектов на чистом сервере, однако в продуктовой среде рекомендуется устанавливать ПО вручную из доверенных источников.

Проверяем успешность установки:

root@deepseek:~# harbor doctor

16:32:35 [INFO] Running Harbor Doctor...

16:32:35 [INFO] ✔ Docker is installed

16:32:35 [INFO] ✔ Docker can be called without sudo

16:32:35 [INFO] ✔ Docker daemon is running

16:32:35 [INFO] ✔ Docker Compose (v2) is installed

16:32:36 [INFO] ✔ Docker Compose (v2) version is newer than 2.23.1

16:32:36 [INFO] ✔ Harbor home: /root/.harbor

16:32:36 [INFO] ✔ Default profile exists and is readable

16:32:36 [INFO] ✔ Current profile (.env) exists and is readable

16:32:36 [INFO] ✔ CLI is linked

16:32:36 [INFO] ✔ NVIDIA GPU is available

16:32:36 [INFO] ✔ NVIDIA Container Toolkit is installed

16:32:36 [WARN] ✘ ROCm in not installed. AMD GPU support may not work.

16:32:36 [INFO] Harbor Doctor checks completed successfully.Докер присутствует, графический ускоритель определяется и доступен в контейнерах. Значит, можно продолжать.

Скачиваем думающую модель deepseek-r1 на восемь млрд параметров. Возможные значения количества параметров можно найти в репозитории ollama [14].

harbor ollama pull deepseek-r1:8bПосле завершения загрузки запускаем сервисы.

# harbor up ollama webui

19:08:03 [INFO] Starting services: ollama webui

[+] up 21/21

✔ Image ghcr.io/open-webui/open-webui:main Pulled 88.6s

✔ Container harbor.webui Healthy 41.3s

✔ Container harbor.ollama Healthy 27.3s

✔ Container harbor.ollama-init Healthy 8.8s

19:10:15 [INFO] ollama - http://localhost:33821

19:10:15 [INFO] webui - http://localhost:33801Обратите внимание на вывод webui — это адрес, по которому доступен веб-интерфейс в виде чата. Также доступен ollama-совместимый API [15] для прямого взаимодействия с моделью. Во имя безопасности оба порта доступны только на локальном интерфейсе.

Есть два решения:

-

установить обратный прокси, подключить домен и настроить SSL;

-

прокинуть порты через SSH.

Воспользуемся вторым вариантом, так как это быстрее и не дает доступа всему интернету к нашему серверу.

ssh -N -L 33801:127.0.0.1:33801 root@256.324.434.242

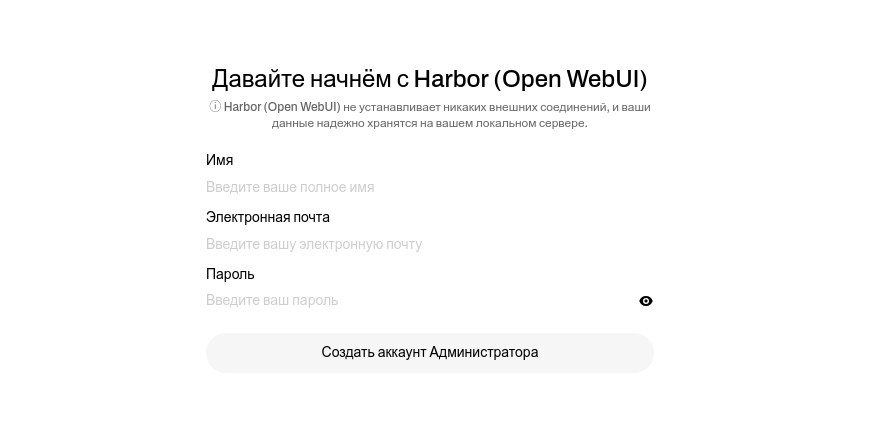

Теперь открываем в браузере http://localhost:33801 [16] и видим веб-интерфейс, который предлагает зарегистрироваться. Данные сохраняются локально, так что можете использовать любые данные.

Если вы планируете сделать веб-интерфейс доступным из интернета, то используйте надежный пароль!

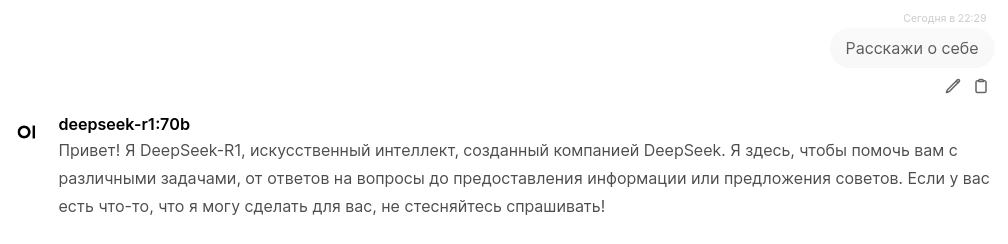

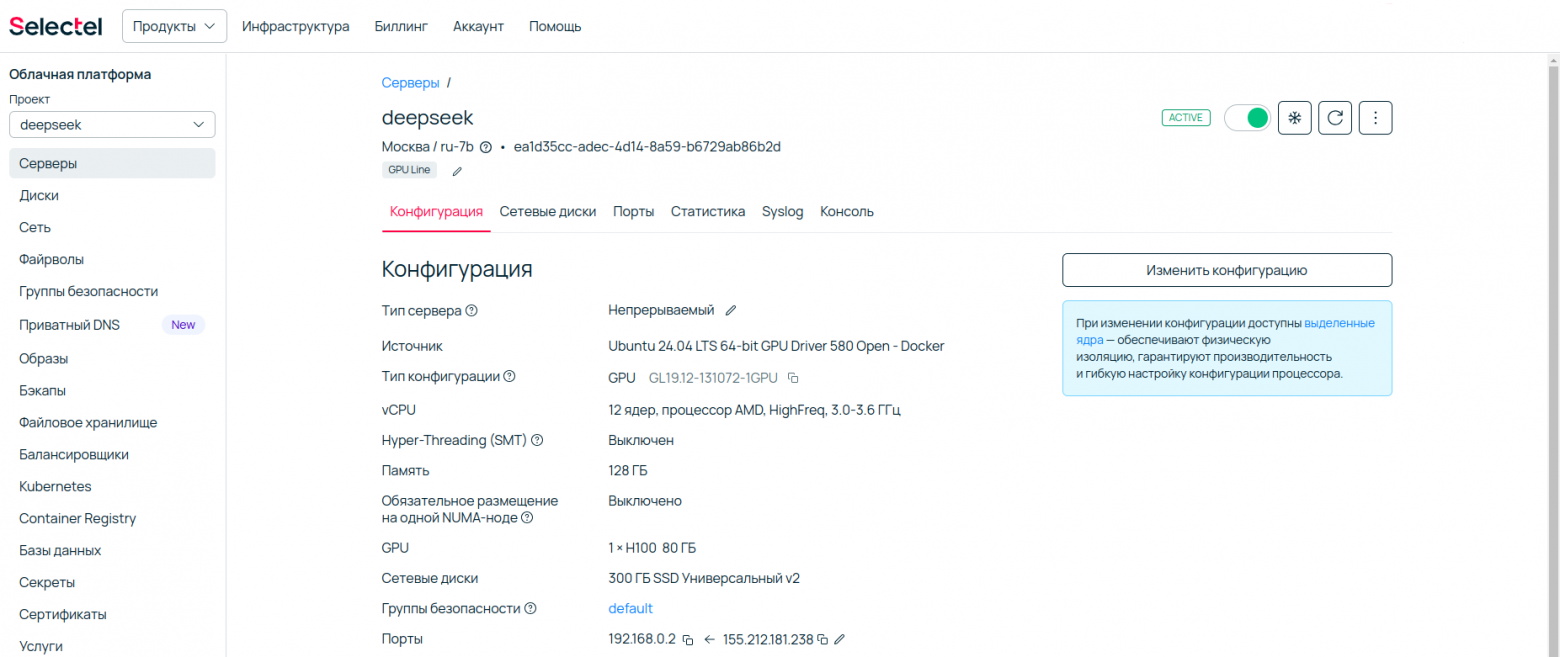

После регистрации выбираем модель и можем с ней общаться. Так как DeekSeek-R1 — это размышляющая модель, то генерация ответа занимает некоторое время. Скорость ответа так же зависит от выбранного графического ускорителя. К счастью, облачная платформа позволяет легко изменить конфигурацию сервера.

Расширение

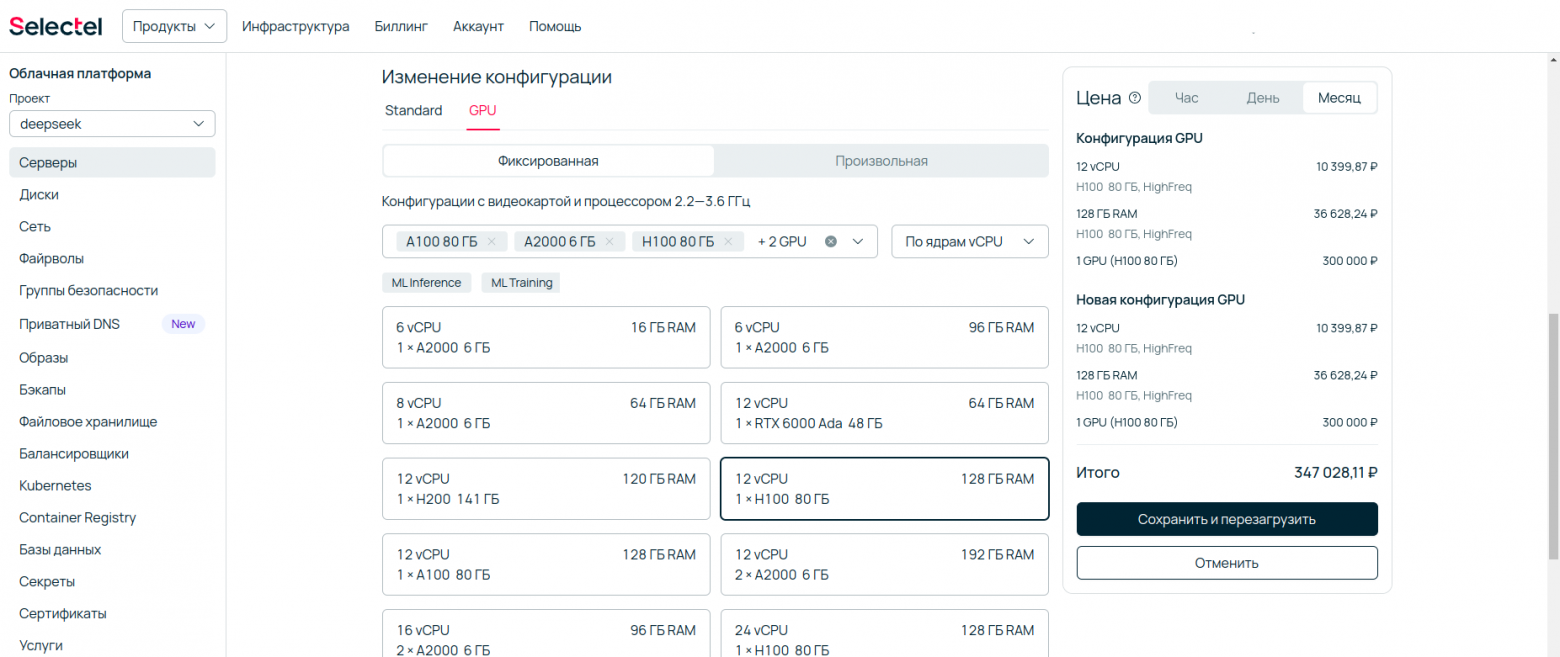

Если вам хочется ускорить получение ответов или, наоборот, сократить расходы, то это легко сделать.

Откройте карточку сервера и нажмите Изменить конфигурацию.

Выберите подходящую конфигурацию и нажмите Сохранить и перезагрузить. Как следует из текста кнопки — сервер будет перезагружен. После перезагрузки вы можете проверить новую видеокарту.

root@deepseek:~# nvidia-smi

Sun Mar 15 18:15:02 2026

+-----------------------------------------------------------------------------------------+

| NVIDIA-SMI 580.126.09 Driver Version: 580.126.09 CUDA Version: 13.0 |

+-----------------------------------------+------------------------+----------------------+

| GPU Name Persistence-M | Bus-Id Disp.A | Volatile Uncorr. ECC |

| Fan Temp Perf Pwr:Usage/Cap | Memory-Usage | GPU-Util Compute M. |

| | | MIG M. |

|=========================================+========================+======================|

| 0 NVIDIA H100 PCIe Off | 00000000:00:06.0 Off | 0 |

| N/A 72C P0 344W / 350W | 51141MiB / 81559MiB | 100% Default |

| | | Disabled |

+-----------------------------------------+------------------------+----------------------+

+-----------------------------------------------------------------------------------------+

| Processes: |

| GPU GI CI PID Type Process name GPU Memory |

| ID ID Usage |

|=========================================================================================|

| 0 N/A N/A 885252 C /usr/bin/ollama 51132MiB |

+-----------------------------------------------------------------------------------------+В моих экспериментах я выяснил, что для модели 8B нужно 12 ГБ VRAM, 32B — 28 ГБ, а для 70B — 51 ГБ VRAM. Полная модель, увы, не под силу одной видеокарте.

Заключение

Развернуть большую языковую модель — это несложный процесс. Главная проблема тут не в софте, а в железе. Если видеопамяти мало, то пытаться впихнуть невпихуемое нет смысла — получите один токен в минуту и кучу нервов.

Для большинства задач по кодингу и текстам версии 8B или 14B хватает за глаза. Лучше взять модель полегче, зато она будет отвечать мгновенно, чем гнаться за топовыми параметрами на неподходящем железе. А для каких рабочих задач вы используете локальные модели? Делитесь своим мнением в комментах.

Автор: TrexSelectel

Источник [17]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27626

URLs in this post:

[1] на своем облачном сервере: https://selectel.ru/services/cloud/?utm_source=habr.com&utm_medium=referral&utm_campaign=cloud_article_deepseekinstall_240326_content

[2] памяти: http://www.braintools.ru/article/4140

[3] Источник: https://habr.com/ru/articles/973954/

[4] chat.deepseek.com: http://chat.deepseek.com

[5] обучения: http://www.braintools.ru/article/5125

[6] 1,5: https://huggingface.co/deepseek-ai/DeepSeek-R1-Distill-Qwen-7B

[7] 70: https://huggingface.co/deepseek-ai/DeepSeek-R1-Distill-Llama-70B

[8] Подробнее →: https://selectel.ru/services/dedicated/?tab=configuratorGpu&c=385%3A1&simpleRamMode=true&utm_source=habr.com&utm_medium=referral&utm_campaign=dedicated_article_widget_240326_deepseekinstall_i089_02_ord

[9] панель управления: http://my.selectel.ru//?utm_source=habr.com&utm_medium=referral&utm_campaign=myselectel_article_deepseekinstall_240326_content

[10] внимание: http://www.braintools.ru/article/7595

[11] HuggingFace: https://huggingface.co/deepseek-ai

[12] huggingface-hub: https://github.com/huggingface/huggingface_hub

[13] Harbor: https://github.com/av/harbor

[14] ollama: https://ollama.com/library/deepseek-r1

[15] ollama-совместимый API: https://ollama.com/

[16] http://localhost:33801: http://localhost:33801

[17] Источник: https://habr.com/ru/companies/selectel/articles/1014132/?utm_campaign=1014132&utm_source=habrahabr&utm_medium=rss

Нажмите здесь для печати.