Вышел бенчмарк ARC-AGI-3: люди набирают 100%, GPT-5.4 — 0,26%

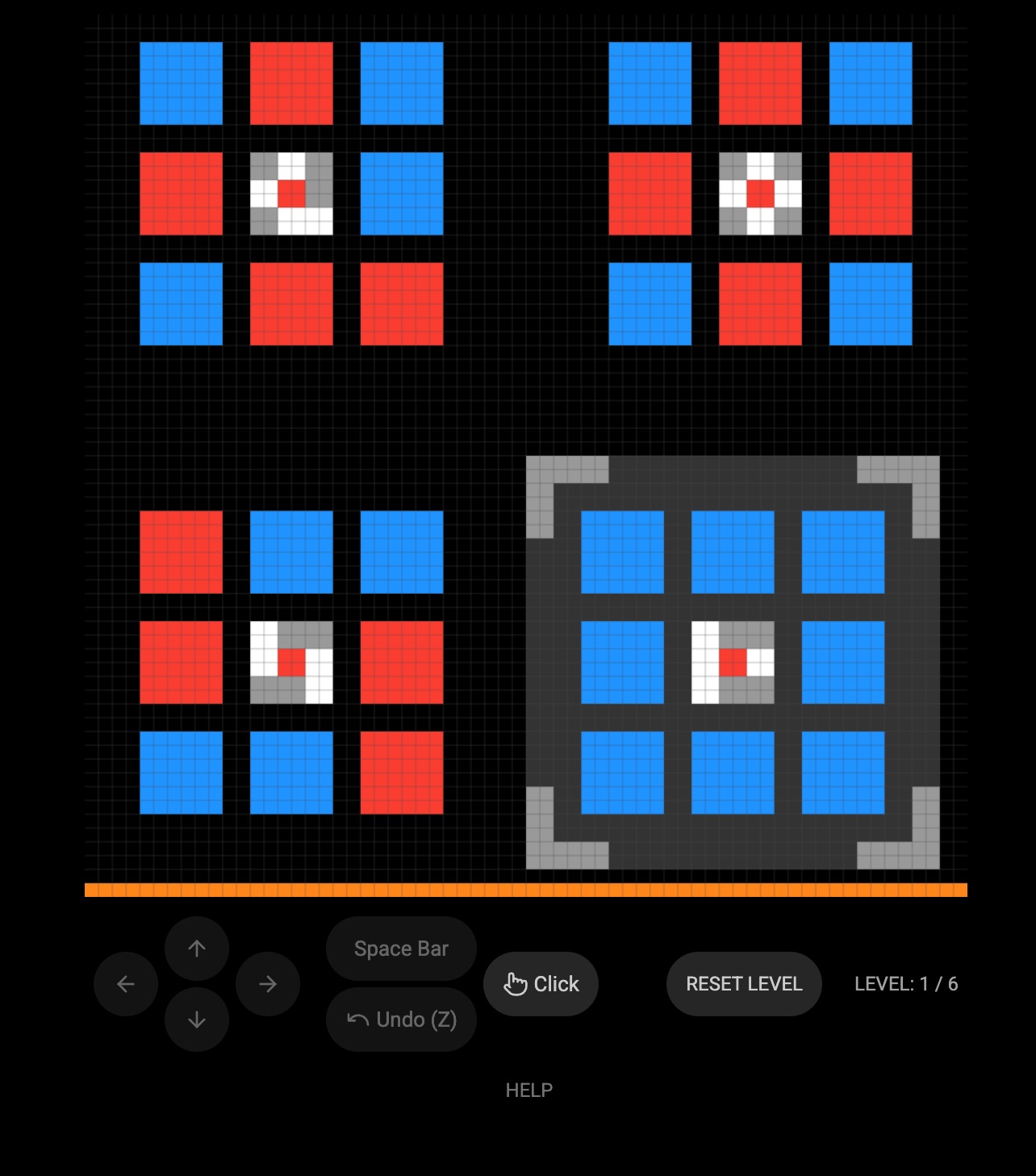

ARC Prize Foundation опубликовала [1] технический отчет о третьей версии бенчмарка ARC-AGI — теста на общий интеллект [2], созданного Франсуа Шолле, автором фреймворка Keras. В отличие от предыдущих версий, где модели угадывали правила по статичным парам “вход — выход” на цветных сетках, ARC-AGI-3 — это 135 интерактивных пошаговых сред, по сути мини-игр на сетке 64×64. Агент должен сам исследовать среду, понять ее механики и догадаться о цели: никаких инструкций ему не дают.

Бенчмарк измеряет четыре компонента агентного интеллекта: исследование, построение модели мира, самостоятельное целеполагание и планирование. Ключевая метрика — RHAE — считает не просто факт решения, а эффективность в действиях по сравнению с людьми. Формула квадратичная: если человек прошел уровень за 10 действий, а ИИ за 100, модель получает не 10%, а 1%. Каждую среду калибровали на живых людях — 486 участников проходили тестирование в Сан-Франциско трижды в неделю. Среда попадала в бенчмарк, только если минимум двое из десяти тестировщиков проходили ее полностью с первой попытки.

Результаты передовых моделей на полуприватном наборе: Gemini 3.1 Pro Preview — 0,37%, GPT-5.4 (High) — 0,26%, Opus 4.6 (Max) — 0,25%, Grok-4.20 — 0,00%. Люди при этом решают 100% сред, медианное время — 7,4 минуты. Авторы подчеркивают: причина перехода к интерактивному формату — компрометация предыдущих версий. В отчете приводится пример: Gemini 3 в цепочке рассуждений использует правильный маппинг чисел на цвета из ARC-AGI, хотя в промпте об этом ни слова. Это значит, что данные бенчмарка представлены в обучающих выборках моделей.

Самое спорное решение — официальный лидерборд учитывает только ИИ, работающие без “харнесса”, то есть программных инструментов, помогающих ему решить задачу. Модели получают единый минимальный промпт: “Вы играете в игру. Ваша цель — выиграть”. Для харнесс-решений, впрочем, предусмотрено отдельное состязание, в котором может принять участие коммьюнити.

Авторы обосновывают это так: с харнессом Duke тот же Opus 4.6 набирает 97,1% на одной среде и 0% на другой — харнесс не обобщается и измеряет не интеллект модели, а инженерное усилие. Людей в тестовом центре тоже никто не инструктирует — значит, условия должны быть сопоставимы. Тезис создателя бенчмарка Франсуа Шолле: настоящий AGI не должен нуждаться во внешних подпорках, чтобы разобраться в незнакомой задаче — точно так же, как не нуждается в них человек.

P.S. Поддержать меня можно подпиской на канал “сбежавшая нейросеть [3]“, где я рассказываю про ИИ с творческой стороны.

Автор: runaway_llm

Источник [4]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27725

URLs in this post:

[1] опубликовала: https://arxiv.org/abs/2503.XXXXX

[2] интеллект: http://www.braintools.ru/article/7605

[3] сбежавшая нейросеть: https://escaped-ai.ru/tg/

[4] Источник: https://habr.com/ru/news/1015044/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1015044

Нажмите здесь для печати.