Как Google сделал то, что не удавалось никому за всю историю смартфонов

Siri запустили в 2011-м

Пятнадцать лет назад. Вдумайтесь.

Пятнадцать лет Apple владела самым массовым голосовым ассистентом в истории человечества — больше миллиарда устройств, в каждом кармане, на каждом запястье — и эта штука до сих пор спотыкается, когда просишь её одновременно поставить таймер и отправить сообщение. А за это время ChatGPT взлетел от нуля до двухсот миллионов пользователей за какие-то два года. Claude стал настольным инструментом для любого, кто хоть раз открывал терминал. А гугловский Gemini тихой сапой превратился в самое мощное семейство моделей, о котором за пределами ИИ-тусовки толком никто и не слышал.

Что-то пошло не так. Капитально не так. И в этом месяце обе компании — и Apple, и Google — фактически в этом расписались, сделав ходы, которые переворачивают всё представление о том, как ИИ работает на вашем телефоне.

Пять лет печального «прогресса» Apple

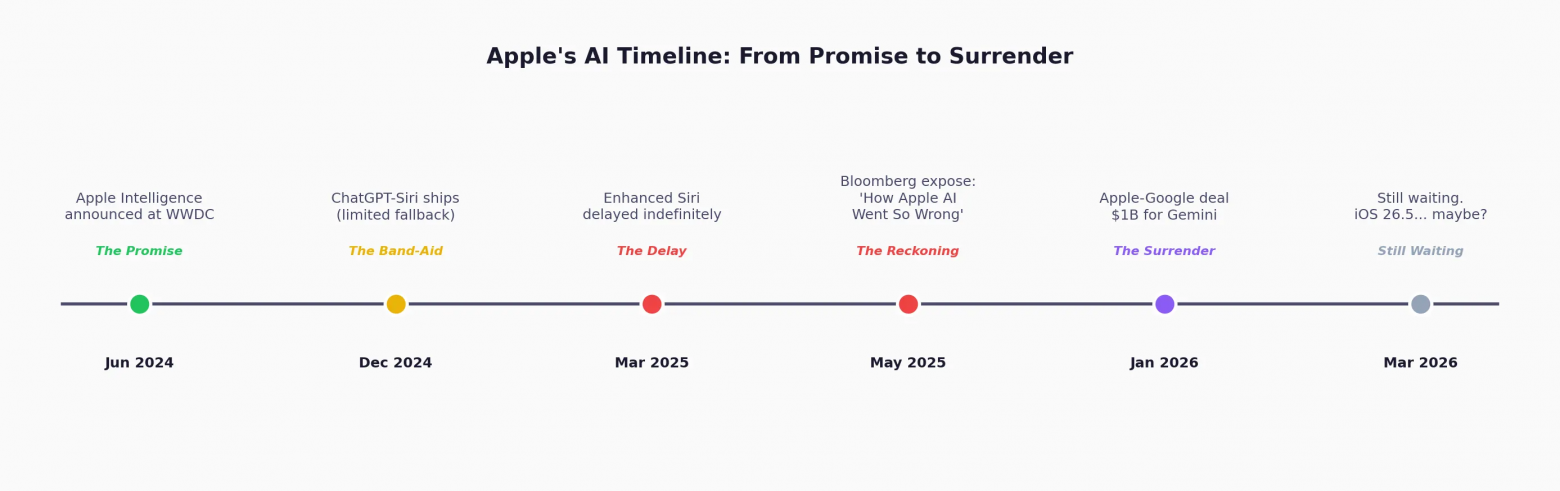

Смотрите, в чём штука: сделка Apple с Google на Gemini кажется абсурдной — пока не осознаёшь, насколько оглушительно Apple провалилась с ИИ в одиночку. Хронология — как сводка с фронта.

Июнь 2024

Apple с помпой представляет Apple Intelligence на WWDC. Гвоздь программы — демо, где Siri отвечает на вопрос «когда прилетает мамин рейс?», на лету подтягивая данные из Почты, Календаря и Сообщений. Зал ревёт от восторга.

Декабрь 2024

Выкатывают интеграцию с ChatGPT. Звучит громко, а по факту — пластырь на открытом переломе. Когда Siri не тянет вопрос, она вежливо интересуется: «Может, пусть ChatGPT попробует?» Это не интеграция. Это медицинская сортировка на поле боя.

Март 2025

Apple признаёт: улучшенная Siri откладывается на неопределённый срок. Внутри компании руководство называет ситуацию «уродством» и «позором». Тестировщики жалуются, что ИИ теряет нить разговора буквально через пару реплик. Часть команды ИИ-подразделения Apple считает, что всё придётся переписывать с чистого листа.

Май 2025

Bloomberg выпускает материал: «Как Apple Intelligence и Siri AI пошли ко дну». Суть проблемы: архитектура Siri, доставшаяся в наследство от покупки Siri Inc. в 2010 году, фундаментально несовместима с современным рассуждением на базе больших языковых моделей. Пятнадцать лет технического долга — как пятнадцать слоёв старых обоев, под которыми стена уже сгнила.

Январь 2026

Apple объявляет о сделке с Google. Многолетнее партнёрство. Gemini ляжет в основу следующего поколения базовых моделей Apple. Ценник? По слухам — миллиард долларов.

Март 2026

А мы всё ещё ждём.

Нет, ну вы вдумайтесь! Apple — компания, у которой на счетах лежит 160 миллиардов долларов кэшем — не смогла построить то, что независимо друг от друга сделали французский стартап (Mistral), китайская лаборатория (DeepSeek) и бывшая некоммерческая организация, ставшая коммерческой (OpenAI). Провал Siri — это не вопрос денег. Это вопрос архитектуры. И Apple наконец это признала — единственным способом, который у неё остался: выписала Google чек.

Анатомия сделки: кто что забрал со стола

Структура сделки Gemini–Siri — как рентгеновский снимок: сразу видно, что у кого болит и что кому дорого.

Apple забрала себе пользовательский опыт [1], приватность и контроль над данными. Gemini крутится на серверах Apple Private Cloud Compute — не на гугловской инфраструктуре. Ваши сообщения, календарь, геолокация, история приложений — всё это остаётся за забором Apple. Google это не видит. Вообще.

Google получил свой мозг [2] внутри полутора миллиардов устройств Apple. Каждый запрос к Siri, где нужно хоть немного подумать, теперь идёт через Gemini. Каждый разработчик, который пишет что-то под Apple Intelligence, по сути пишет под модель Google — хочет он того или нет. При этом сделка неэксклюзивная: Apple сохранила интеграцию с OpenAI, и GPT-5 придёт с iOS 26.

Но погодите. Эта «неэксклюзивность» — не совсем то, чем кажется. Теперь у Apple есть Gemini для нативного интеллекта [3] — контекстные действия, персональное планирование, работа с вашими данными — и ChatGPT как разговорная подстраховка. Две фронтирные модели за фасадом одного ассистента. Расклад прозрачен: Gemini делает дело, ChatGPT отвечает на вопросы из серии «объясни квантовую механику на пальцах».

Google стал «Intel Inside» мобильного ИИ. Не потому, что победил Apple в открытом бою, а потому, что стал деталью, которую Apple не сумела изготовить сама.

Чтобы не проигрывать алгоритмам в скорости, используйте современные инструменты. Хотите узнать, как ИИ справляется с написанием антикризисных стратегий, саммаризацией медиаполя или генерацией контента под разные фреймы? BotHub объединяет мощности ведущих нейросетей (включая последние версии GPT и Claude) в одном окне.

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов [4] для первых задач и приступить к работе с нейросетями прямо сейчас!

Android AppFunctions: протокол MCP приходит на три миллиарда устройств

Теперь — обратная сторона Луны.

Пока Apple выписывала чеки, Google тихо выкатывал инфраструктуру. Android AppFunctions — это, пожалуй, самое важное, что произошло с мобильным ИИ за последние годы. И почти никто об этом не говорит. Потому что Google, как всегда, дал этому максимально скучное название.

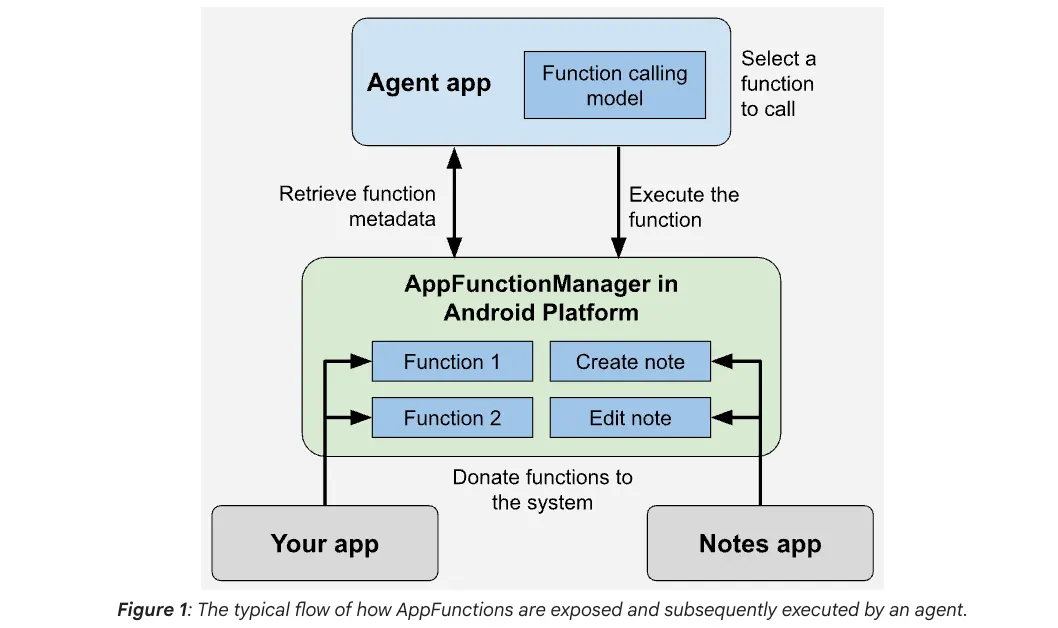

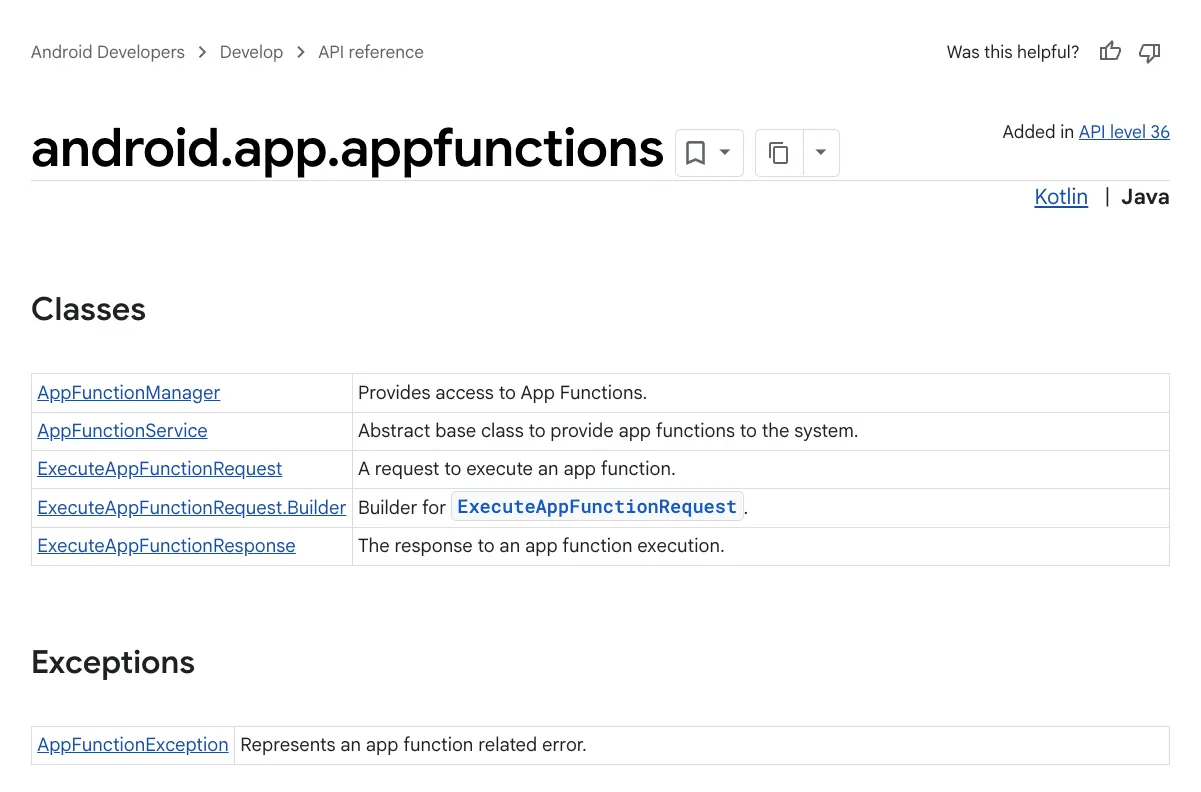

А теперь — что это на самом деле. Model Context Protocol (MCP) от Anthropic стандартизировал способ, которым ИИ-модели находят и вызывают внешние инструменты в облаке. AppFunctions делает ровно то же самое, только прямо на вашем телефоне. Разработчик с помощью библиотеки AppFunctions Jetpack создаёт самоописывающиеся функции: вот что я умею, вот какие параметры принимаю, вот что возвращаю. Gemini находит эти функции на лету и вызывает их через обычную человеческую речь.

Не шорткаты. Не зашитые голосовые команды.

Полноценный вызов инструментов. На устройстве. Голосом.

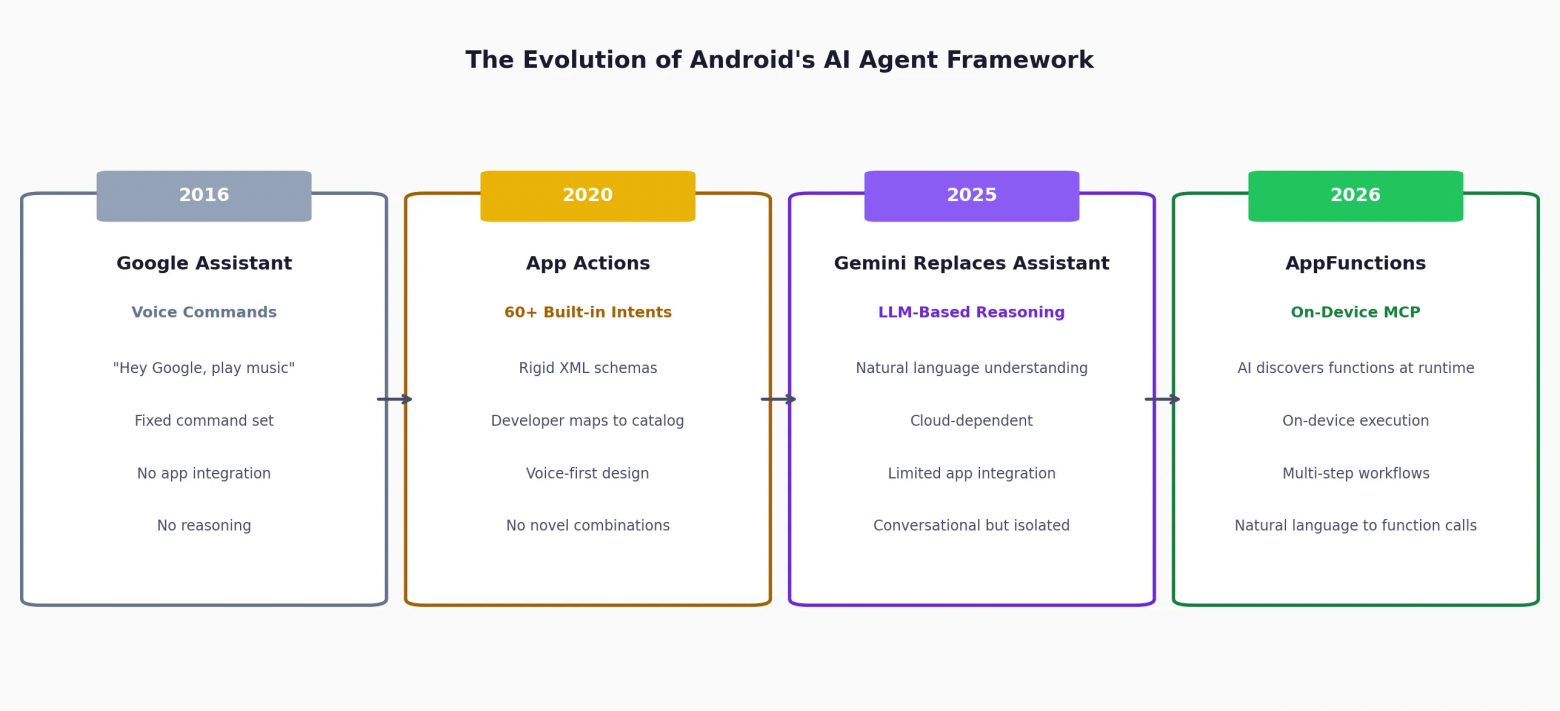

Эволюция [5] говорит сама за себя:

App Actions (2020) — разработчику нужно было привязать свои функции к готовому каталогу интентов от Google. Штук шестьдесят заранее прописанных шаблонов с жёсткими XML-схемами. ИИ не умел комбинировать, импровизировать, адаптироваться к неожиданному контексту.

AppFunctions — совсем другая история. ИИ читает описания функций, сам понимает параметры из контекста и на лету собирает многошаговые сценарии. Разница — как между голосовым меню банка («нажмите один для баланса, два для оператора») и живым разговором с толковым помощником.

И всё это уже работает. Uber, Lyft, DoorDash, Grubhub, Uber Eats, McDonald’s, Starbucks — подключены. Instacart на подходе. В Корее — Baedal Minjok и Kakao T. Новенький Galaxy S26 или Pixel 10 может заказать вам обед, вызвать такси и найти прошлогоднее фото с отпуска — а вы ни разу не откроете ни одного приложения.

И ещё один козырь в рукаве: фреймворк UI-автоматизации, где Gemini буквально смотрит на ваш экран и тыкает кнопки за вас — для тех приложений, которые ещё не подключились к AppFunctions. Костыльно? Безусловно. Зато Gemini работает вообще со всеми приложениями, а не только с теми, кто добровольно записался.

Apple App Intents против Google AppFunctions: одна война — разное оружие

Apple тоже не сидит сложа руки. App Intents, представленные на WWDC 2022, позволяют iOS-приложениям открывать свои возможности для Siri, Spotlight, Быстрых команд, виджетов, а теперь и для Apple Intelligence. С iOS 18.4 App Intents работают с Siri напрямую.

А вот разница в философии — показательна.

Apple смотрит на ИИ как на одного из многих потребителей. Один и тот же App Intent обслуживает и Siri, и виджет, и подсказку в Spotlight, и кнопку в Пункте управления. Широкий охват. Много контекстов. Написал один раз — работает везде.

Google смотрит на ИИ как на главного и единственного клиента. AppFunctions существуют специально для того, чтобы Gemini мог их вызвать. Весь фреймворк заточен под обнаружение через ИИ, привязку параметров на естественном языке и многоходовое агентное выполнение.

Ни тот, ни другой подход не ошибочен. Но у Google — более крутая кривая входа и более мощный выхлоп для агентных сценариев. У Apple — больше отдачи от каждой интеграции по всей операционной системе.

Точка схождения — одна: обе платформы строят мир, в котором ИИ-ассистент станет главным интерфейсом к вашим приложениям. А привычные «тапнуть и свайпнуть» — запасным выходом.

Google играет за обе команды. Больше так не умеет никто.

Давайте зафиксируем. Google обеспечивает мозг внутри Siri через сделку с Gemini. Google обеспечивает агентный фреймворк на Android через AppFunctions. Google одновременно крутит ИИ-движок на обеих мобильных платформах.

Вы это серьёзно?

За всю историю смартфонной дуополии ни одна компания не была ядром интеллекта обеих экосистем разом. Microsoft пыталась построить третью платформу — и с треском провалилась. Apple никогда не лицензировала свои технологии для Android. Google раздавал Android бесплатно, но так и не пробрался в мозг iPhone.

До этого момента.

Каждый запрос Siri, где нужно по-настоящему думать, — проходит через Gemini. Каждый вызов AppFunctions на Android — через Gemini. Каждый разработчик, который делает контекстно-зависимые фичи для любой из двух платформ, — работает на модель Google. Знает он об этом или нет.

Это структурное преимущество, которое растёт как снежный ком. Gemini становится лучше — обе платформы становятся лучше. Разработчики пишут больше App Intents и AppFunctions — агентные возможности Gemini обогащаются с обеих сторон. Google превратился в инфраструктурный слой, от которого все зависят и с которым никто не конкурирует напрямую.

Час расплаты для разработчиков

А вот и практический вывод, от которого каждому разработчику мобильных приложений стоит хорошенько понервничать.

Если ИИ-агенты станут основным способом, которым люди пользуются приложениями на телефоне — а обе платформы ставят именно на это, — то приложения без интеграции с AppFunctions или App Intents просто растворятся в воздухе.

Сегодня: «Закажи мне кофе»

→ открываешь приложение Starbucks → тыкаешь шесть экранов → платишь.

Завтра: «Закажи как обычно»

→ Gemini дёргает AppFunction Starbucks → подтверждает → готово.

Приложение ни разу не открылось.

Приложение, которое агент может позвать, — живёт. Которое не может — умирает тихой смертью. Это ровно та же история, что с поисковиками в нулевых: если Google не мог проиндексировать ваш сайт — вас просто не существовало. Теперь, если Gemini не может вызвать функции вашего приложения, — та же участь. Вы иконка на экране, на которую больше никто не смотрит.

Окно возможностей — маленькое. Оба фреймворка ещё молодые. Те, кто интегрируется сейчас, подойдут к моменту, когда агенты начнут жонглировать сложными мультиприложенческими сценариями, с отполированными, обкатанными решениями. Все остальные будут судорожно догонять, когда поезд уже ушёл.

Простите, но арифметика элементарная. Интегрируйся — или превратись в иконку, на которую никто не нажимает.

Эра чат-ботов достигла потолка. Просто вы не заметили.

Чат-бот в браузерной вкладке — зашёл на сайт, набрал вопрос, скопировал ответ, вставил куда надо — достиг своего пика в 2025 году. Мы уже переходим к следующей главе.

Нет, он не умрёт завтра. Но следующая эра уже едет к вам в кармане Galaxy S26 и тихо дозревает в бетах iOS 26.5. ИИ, который живёт внутри вашей операционной системы, знает ваши приложения и действует от вашего имени. Не место, куда вы заходите. Агент, который уже рядом.

Apple пришла к этому, признав, что мозг ей самой не по зубам. Google пришёл к этому, превратив открытый протокол в нативную возможность операционной системы — и заодно продав этот самый мозг своему главному конкуренту.

Телефоном теперь рулят агенты. А моя единственная надежда — что наконец-то не придётся объяснять маме, как сделать скриншот. Она просто попросит. И вот это, друзья, — единственный луч света во всём этом ИИ-облаке.

Автор: cognitronn

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27811

URLs in this post:

[1] опыт: http://www.braintools.ru/article/6952

[2] мозг: http://www.braintools.ru/parts-of-the-brain

[3] интеллекта: http://www.braintools.ru/article/7605

[4] По ссылке вы можете получить 300 000 бесплатных токенов: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[5] Эволюция: http://www.braintools.ru/article/7702

[6] Источник: https://habr.com/ru/companies/bothub/articles/1015706/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1015706

Нажмите здесь для печати.