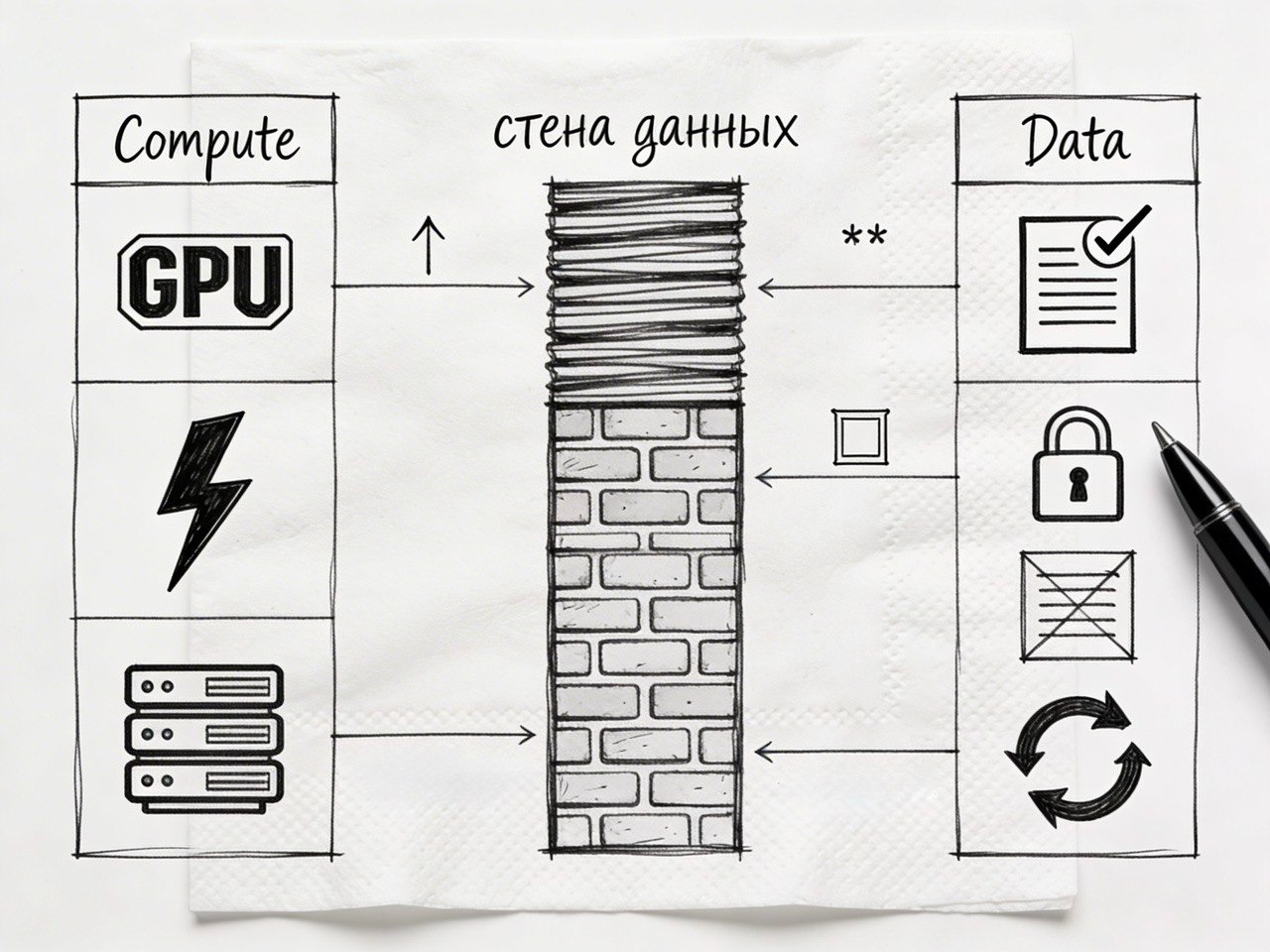

Стена данных: почему ИИ упирается не в GPU, а в реальность

Если вы когда-нибудь задумывались, почему огромные GPU-кластеры перестали быть главным драйвером прогресса в развитии ИИ, а контракты на данные подписываются за десятки миллионов долларов — эта статья для вас.

Об авторе: Антон Пчелинцев, эксперт онлайн-магистратур Центра «Пуск» МФТИ в области Data Science, разработки и управления ИТ-продуктами [1]. Магистр бизнес-информатики и соавтор курса «Экономика для технологических предпринимателей». Занимается проектами в телекоме, ИТ, ИИ, интересуется биоинформатикой и биотехнологиями, увлекается изучением квантовых систем. Принимал участие в международных ИТ-стартапах (закрытие венчурных раундов с крупнейшими технологическими гигантами). Считает себя технологическим предпринимателем (не инвестором), который вот-вот набьет все шишки и наконец-то сделает что-то полезное. Собственное портфолио проектов: инерциальная авионика, ИИ-системы управления компанией, интеллектуальные системы производства спортивной обуви.

Представьте, что вы строите ракету (Can i dream to be like Elon Musk?). В какой-то момент выясняется, что проблема не в двигателе (GPU), а в топливе (данных). Двигатели можно докупить, оптимизировать, распараллелить. А вот топливо, то есть высококачественные человеческие данные, внезапно оказывается не бесконечным. Это ощущение уже стало рыночной реальностью: контент начинают покупать и лицензировать как стратегический ресурс, а не парсить из интернета по-тихому.

Можно подумать: «Не так все страшно!», но вот что думает крупный бизнес, основанный на Big Data:

● Илья Суцкевер (соучредитель OpenAI) публично предсказал плато развития ИИ из-за дефицита данных.

● Google заключил контракт с Reddit за $60 млн в год на лицензирование данных.

● Илон Маск закрыл API Twitter, чтобы данные использовал только Grok.

А еще FTC (Федеральная торговая комиссия) начала расследование практик лицензирования данных.

В этой статье разберем, что такое стена данных, почему она появилась именно сейчас и почему следующий виток развития ИИ все чаще смотрит не в сторону еще больших GPU-кластеров, а в сторону реальности — наблюдений окружающего мира, датчиков и физических процессов.

Что такое стена данных и почему она вообще возникла

Упрощенно, стена данных (data wall) — это момент, когда масштабирование моделей начинает упираться в дефицит качественных обучающих данных, особенно человеческого происхождения. К таким данным можно отнести:

● связные тексты (книги, статьи, диалоги);

● качественные инструкции и решения задач;

● код и инженерные артефакты (в хорошем смысле);

● экспертные материалы, где меньше шума и больше смысла.

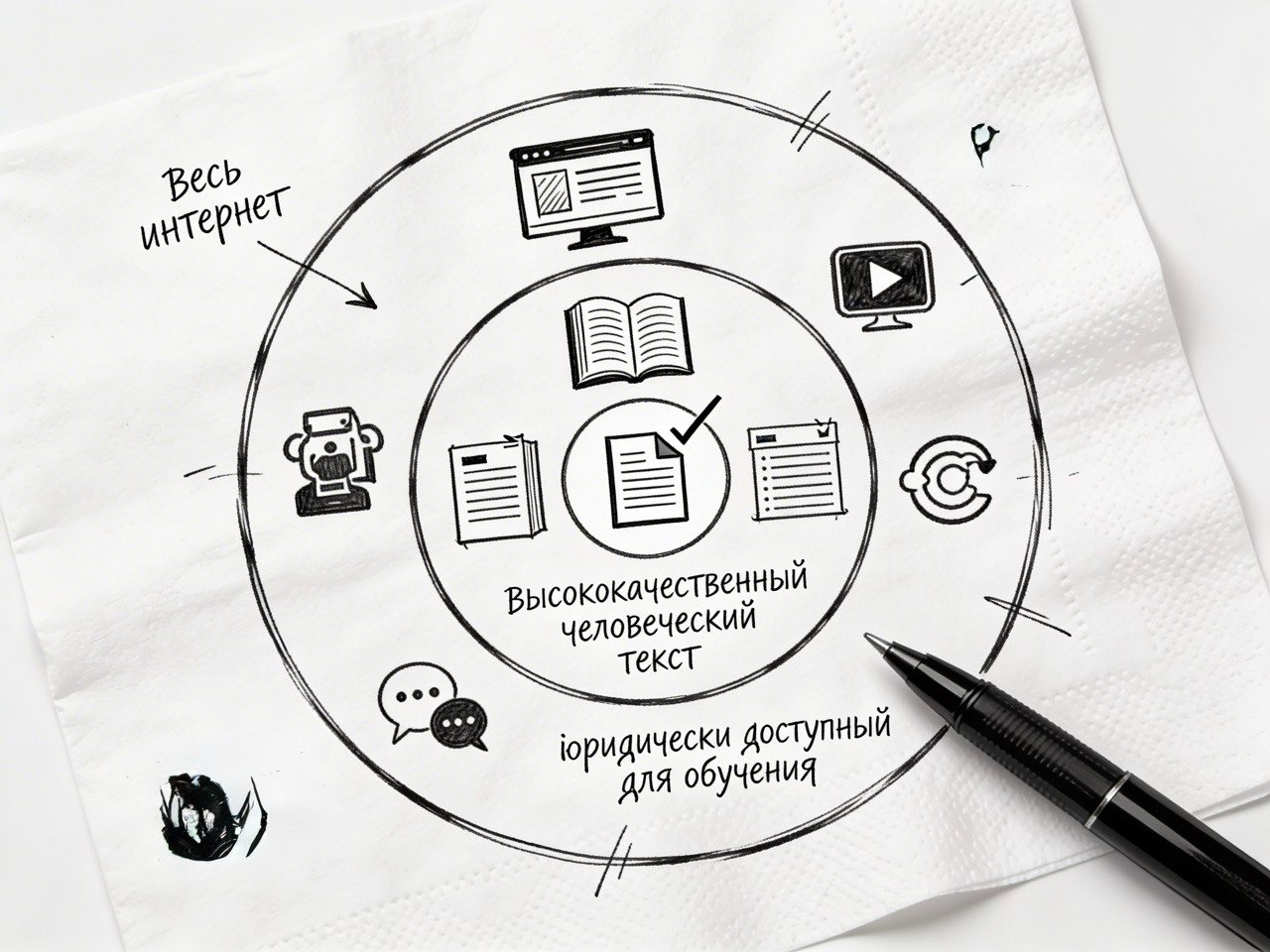

Интернет большой, но полезный интернет — существенно меньше. Большая часть контента в сети повторяется, переписывается, содержит мусор, SEO и спам, а теперь еще и все чаще является… генерацией других моделей.

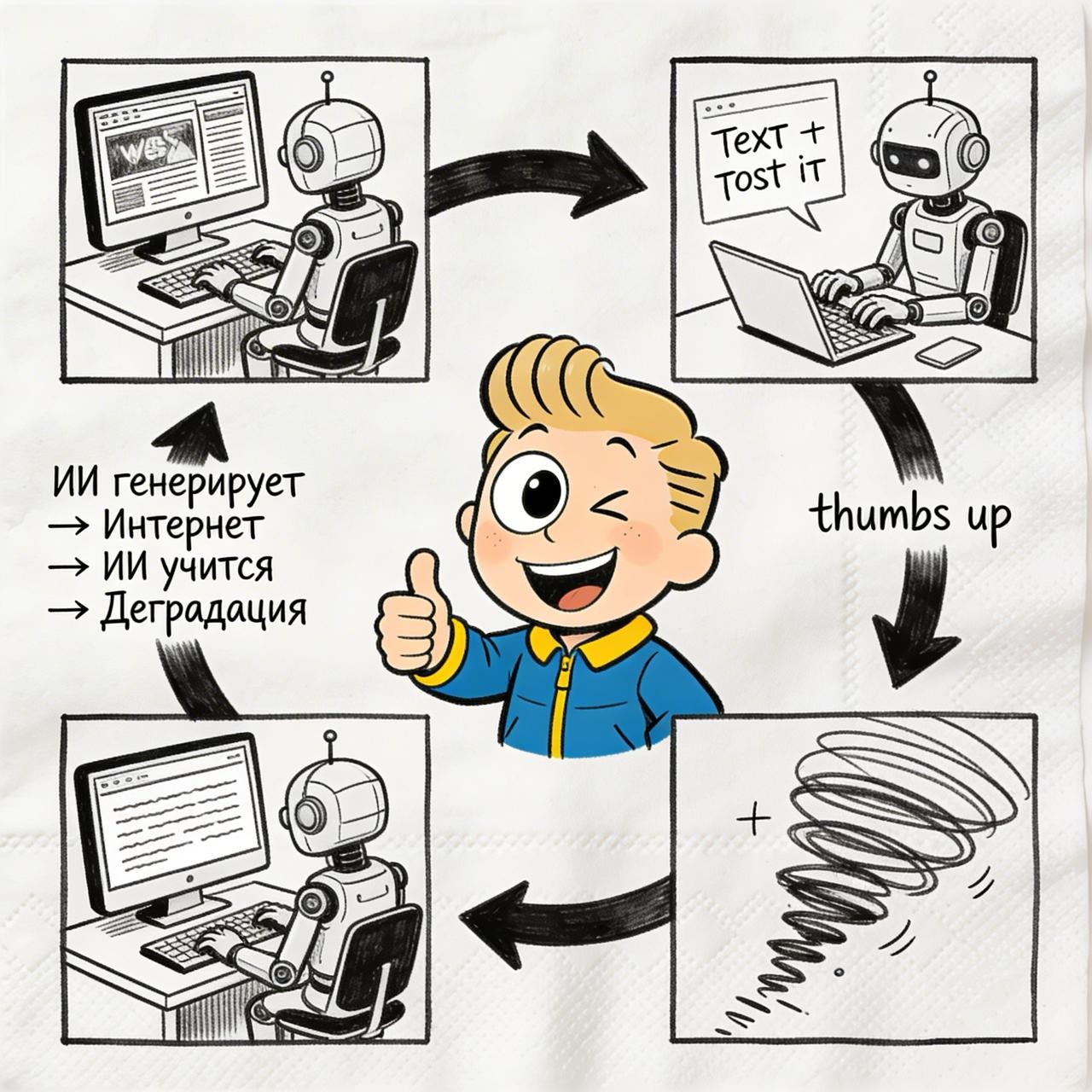

Получается интересный эффект: мы научили ИИ читать интернет, а интернет начал писать ИИ. Еще не смешно? Тогда вперед!

«Но ведь данных много, мы же живем в эпоху Big Data!»

Да, данных очень много. Но LLM (и большие, и малые) любят, когда не просто «много», а когда «много хорошего». Это примерно как питание: калорий вокруг полно, но если жить на чипсах, организм быстро объяснит разницу между «много» и «качественно».

С данными так же:

● низкокачественные данные добавляют шум и могут ухудшать поведение [2] модели;

● высококачественные данные дают рост умения думать, точности, устойчивости, полезности.

Почему GPU не спасают в одиночку

Индустрия привыкла к простой магии: больше параметров + больше вычислений = лучше результат. Это работало впечатляюще долго, но у любого масштабирования есть ресурсная база. И если вычисления — это вопрос денег, энергии, инфраструктуры, то данные — вопрос другого толка:

● доступа (юридического и технического);

● права на использование;

● уникальности;

● качества и очистки;

● обновляемости (данные устаревают);

● и, внезапно, геополитики/суверенитета.

Доступ к лучшим массивам данных все чаще оказывается привязан к владельцам платформ, инфраструктур и государственным/корпоративным системам наблюдений.

Почему человеческий текст стал дефицитом

Причина 1. Интернет — не бесконечный учебник

Лучшая часть публичного текста уже давно «объедена»: книги, энциклопедии, популярные медиа, форумы, публичные git-репозитории и т. д. Дальше остается либо идти глубже в закрытые источники, либо платить за лицензии, либо пытаться «размножать» смысл синтетикой — а там свои риски.

Причина 2. Данные становятся закрытыми не из-за жадности, а из-за логики рынка

Если текст и контент действительно усиливают модель, они становятся активом, а активы, сюрприз-сюрприз:

● защищают,

● продают,

● лицензируют,

● ограничивают доступ.

Это не конец интернета, а взросление рынка ИИ. Примерно как когда музыка ушла из пиратских mp3 в стриминги: не потому что люди разлюбили музыку, а потому что появилась экономика доступа.

Причина 3. Много данных уже «заражено» синтетикой

Чем больше моделей в мире, тем больше их текста в сети. И тем выше риск, что мы начинаем учить новые модели на генерациях старых. Это и есть дорожка к деградации распределения — вплоть до model collapse. Если не держать якорь реальности, модели постепенно теряют способность к генерации редких, но важных событий и начинают вырождаться.

Что индустрия делает прямо сейчас (и почему это симптом стены данных)

У индустрии есть несколько типовых реакций [3]:

● Лицензирование. Договориться с правообладателями, платформами, медиа, базами знаний. Это легально, масштабируемо, но дорого и ограничено.

● Синтетические данные. Генерировать инструкции, примеры, учебники, дистиллировать знания из сильных моделей в более дешевые. Это мощно, но есть пределы и риски (обсудим отдельно).

● Сдвиг в сторону реальных данных мира. Там, где разметка приходит из будущего, а природа сама создает новые наблюдения: погода, космос, дистанционное зондирование, физика частиц, индустриальные сенсоры, медицина и т. д.

И вот третий пункт — наш главный поворот сюжета.

Почему реальность — новый источник данных (и почему это не замена интернет-текста)

Важно не перепутать: данные природы не заменят интернет-текст для «болталок» и широкого гуманитарного общения. Но они идеально подходят:

● для доменных foundation-моделей (погода/климат, космос, ДЗЗ, физика);

● мультимодальных world models (модели мира: время, пространство, сенсоры);

● инструментов и агентов, где язык — это интерфейс к моделям наблюдений (tool-use, RAG, адаптеры).

То есть LLM остается говорящей оболочкой, но мозгом [4] предсказания реальности становятся модели наблюдений.

Если упростить, то LLM — это харизматичный переводчик, а физический мир — это строгий преподаватель, который проверяет домашку каждый день.

«Не верю!» — кричал Станиславский! А вы спросите Яндекс про цепи Маркова или посмотрите Youtube-канал Veritasium — вас ждет сюрприз.

Почему наблюдения мира ценны именно как антисинтетика

У наблюдений есть свойства, которые сложно имитировать синтетикой.

Они содержат хвосты распределения. Редкие события — то, что в среднем не должно происходить часто, но происходит. А иногда именно там спрятана новая физика, новые режимы, неожиданные комбинации факторов. Синтетика на длинной дистанции склонна усреднять и сглаживать редкости. Реальность — наоборот, периодически подкидывает сюжеты уровня «так не бывает, но вот опять».

Они самообновляемые. Погода завтра — метка для прогноза сегодня. Космические события происходят независимо от наших датасетов. Земля меняется каждый день, спутники это видят. Это почти бесконечная лента обновления.

Они проверяемы. С текстом можно спорить («автор ошибся», «источник сомнительный»). С наблюдениями спорить сложно: если датчик корректно откалиброван, то «так было». Можно спорить об интерпретации, но не о факте наблюдения.

Главный вывод статьи (и зачем это вам, дорогие читатели)

Стена данных — это не апокалипсис ИИ. Это смена эпохи:

● Раньше: кто больше скормит интернет-текста — тот и молодец.

● Сейчас: кто сумеет добыть, упаковать, легально использовать качественные данные — тот и создаст преимущество.

● Дальше: кто научит ИИ работать с реальностью, а не только с текстом, тот получит новые классы продуктов.

Это особенно интересно молодым инженерам и исследователям, потому что появляется пространство для новых профессий и проектов. Например:

● инженеры данных наблюдений (observation data engineers);

● архитекторы пайплайнов от сигнала к датасету;

● создатели бенчмарков реального мира;

● разработчики доменных foundation-моделей.

И да, это звучит как научная фантастика, но она уже начинает быть прикладной.

В следующей статье разберем синтетику: почему она реально работает, где ее границы и почему индустрии все равно нужен якорь — реальная часть данных.

Автор: mipt_digital

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/27985

URLs in this post:

[1] Центра «Пуск» МФТИ в области Data Science, разработки и управления ИТ-продуктами: https://mipt.online/masters?utm_source=habr

[2] поведение: http://www.braintools.ru/article/9372

[3] реакций: http://www.braintools.ru/article/1549

[4] мозгом: http://www.braintools.ru/parts-of-the-brain

[5] Источник: https://habr.com/ru/articles/1016998/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1016998

Нажмите здесь для печати.