Топ локальных нейросетей 2026: полный суверенитет без интернета

Я долгое время была в отношениях с облачными нейросетями. Это было удобно, даже комфортно. Открыла браузер, написала промпт и через пару секунд получила ответ. Но в последнее время отношения начали давать трещину.

Интернет стал неотъемлемой частью нашей жизни, но в 2026 году мир переживает непростые времена. Ситуация крайне нестабильна, и это вызывает у каждого чувство неуверенности. Возникает закономерный вопрос: а можно ли как-то подстраховаться? Чтобы нейросеть всегда была под рукой, даже когда провайдер решил устроить себе выходной или на телефон пришло очередное оповещение о беспилотной опасности.

Оказалось, что можно. И не просто можно, а вполне себе комфортно.

К 2026 году локальные нейросети доросли до того состояния, когда их действительно имеет смысл использовать. Не как хобби для гиков с тремя видеокартами в башне, а как рабочий инструмент. Они всё ещё требуют некоторых технических знаний (куда без них). Но порог входа заметно снизился.

В этой статье я собрала шесть инструментов, которые работают полностью без интернета. Ну, почти полностью – устанавливать их придётся онлайн, но после этого можно смело отключать Wi-Fi и наслаждаться цифровым суверенитетом.

Приятного прочтения!

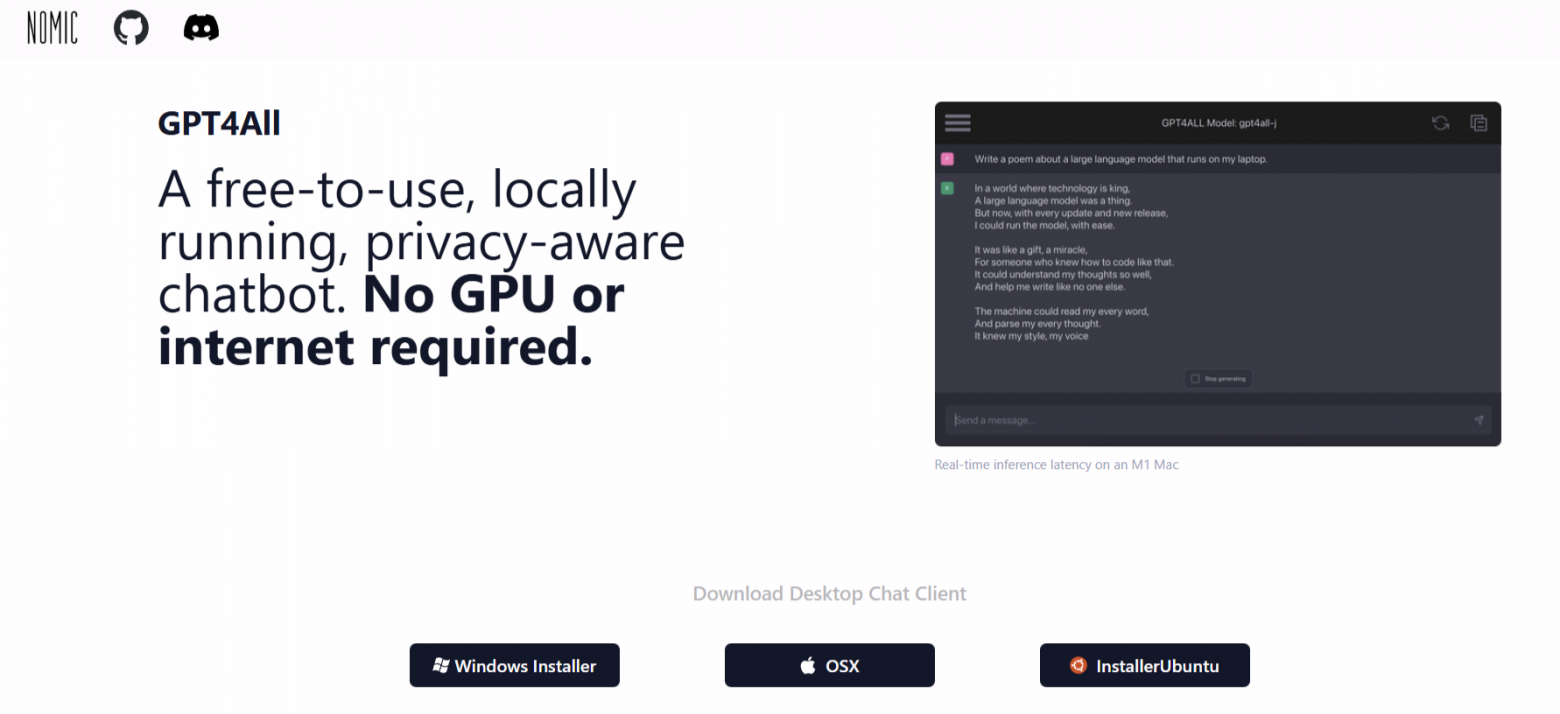

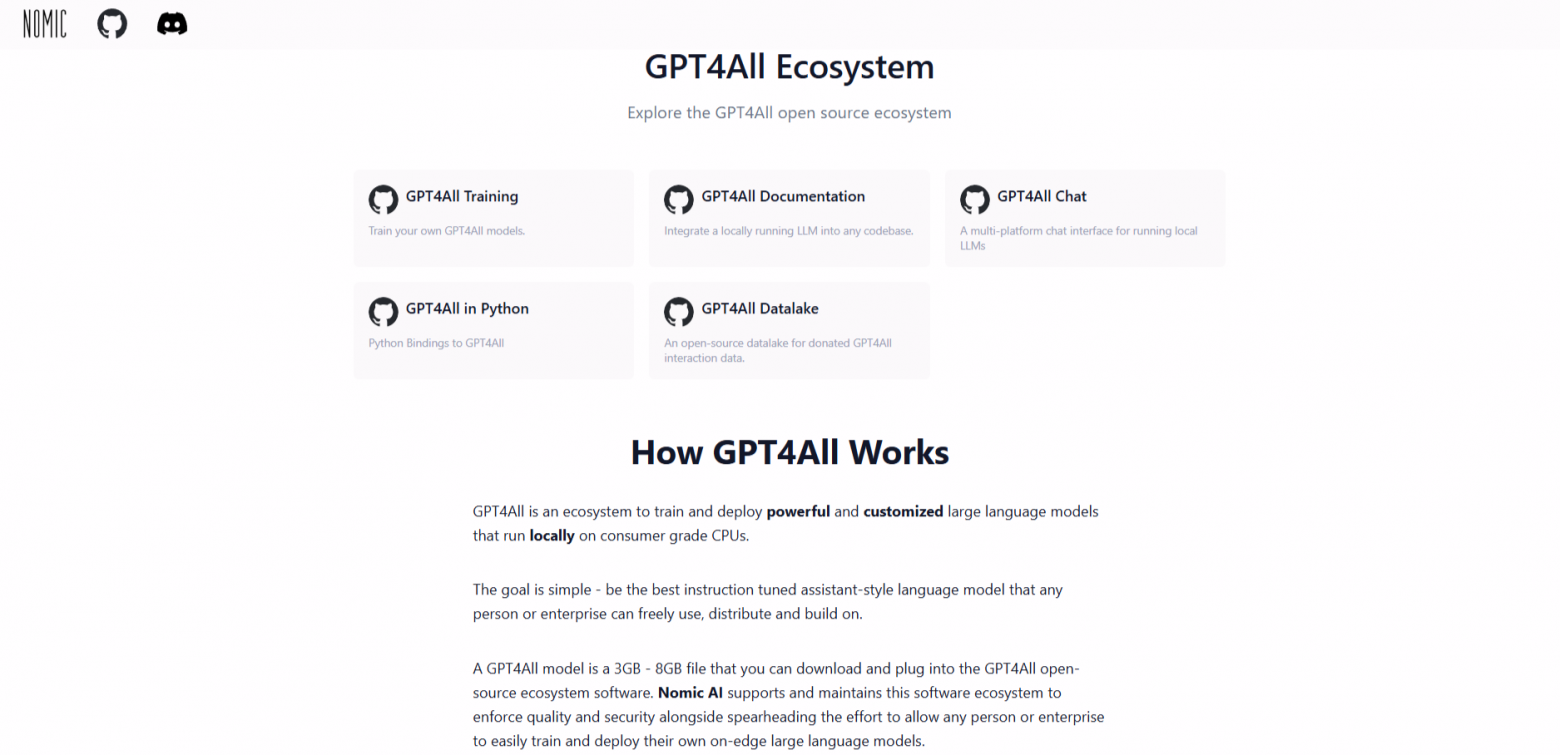

1. GPT4All

Начну с самого дружелюбного к новичкам инструмента. GPT4All [1]– это десктопное приложение, которое вы скачиваете, устанавливаете и запускаете. Без танцев с терминалом, без сборки из исходников. После установки и загрузки модели вы можете работать полностью офлайн.

Установщик занимает около 300-00 МБ, а само приложение после установки весит примерно 1 ГБ. Дальше вы выбираете модель из списка – они уже подготовлены и оптимизированы. Кликаете «Download», ждёте пару минут и начинаете чат.

GPT4All умеет работать с вашими локальными документами через функцию LocalDocs. Вы просто указываете папку с файлами (PDF, Word, текст), и нейросеть отвечает на вопросы по их содержанию. Всё локально, никакой облачной обработки и отправки данных в интернет.

Технические детали

-

Работает на CPU – видеокарта не обязательна

-

Поддерживает Windows, macOS, Linux

-

Модели в формате GGUF (стандарт для локального запуска на базе llama.cpp)

-

Потребление RAM: от 4 до 16 ГБ в зависимости от модели

-

Полностью офлайн после установки

-

Скорость на CPU: 15-20 токенов/сек – значительно быстрее многих конкурентов (например, Ollama на том же железе даёт 8-12)

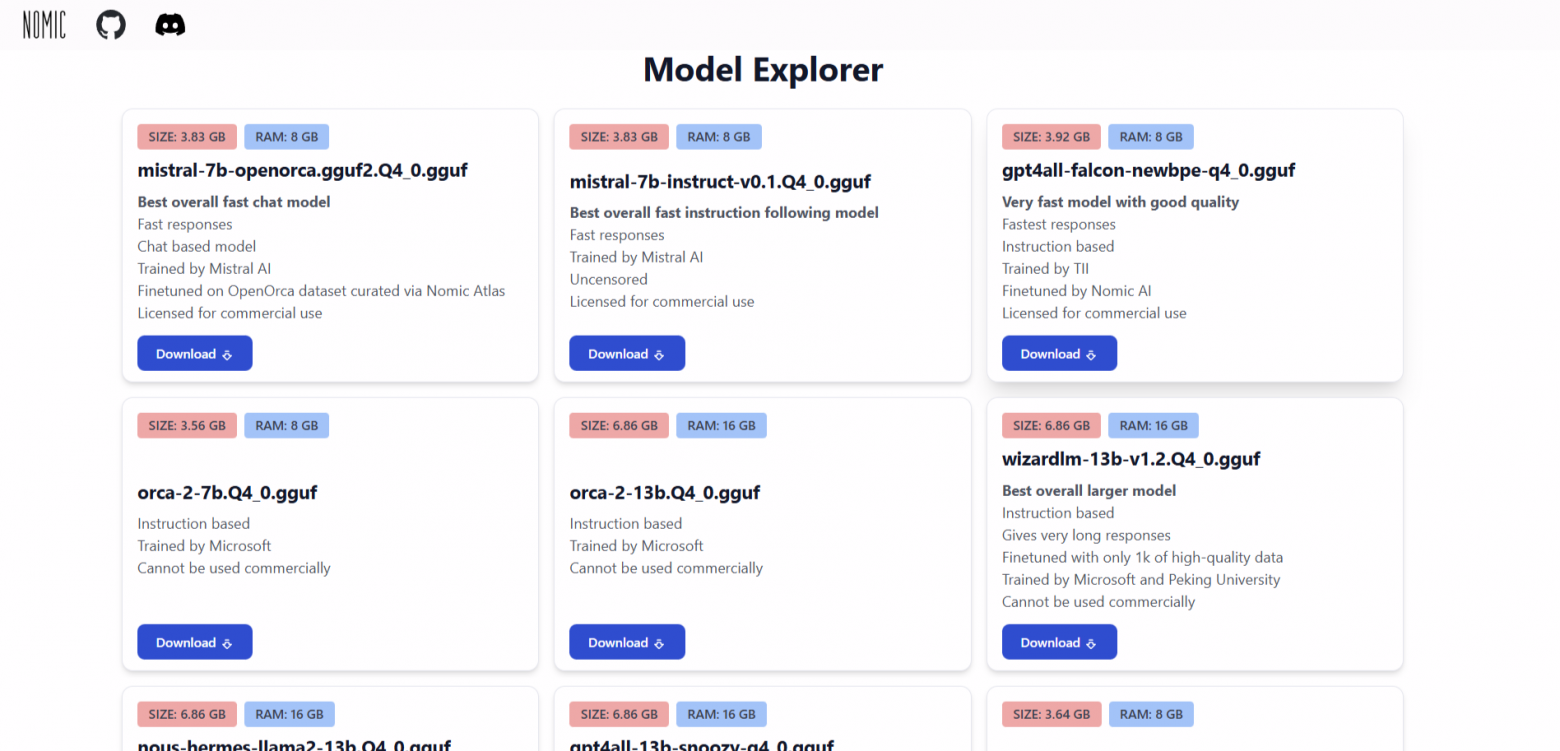

Какую модель выбрать в 2026 году

В GPT4All есть несколько актуальных опций:

-

Phi-3-mini-4k-instruct (3.8B) – для слабых машин. Весит 2,18 ГБ, требует 4 ГБ ОЗУ. Скорость отличная, качество базовое, но для простых задач хватает.

-

Orca-mini-3B – ещё один лёгкий вариант. 1,98 ГБ, 4 ГБ ОЗУ. Ответы посредственные, но на старом железе тянет.

-

Nous-Hermes-2-Mistral-7B-DPO – хороший баланс скорости и качества. 4,11 ГБ, требует 8 ГБ ОЗУ.

-

Meta-Llama-3-8B-Instruct – помощнее, но и требовательнее. 4,66 ГБ, нужно 8-16 ГБ ОЗУ.

-

GPT4All-13B-snoozy – для мощных машин. 7,37 ГБ, требует 16 ГБ ОЗУ.

Если у вас 8 ГБ ОЗУ и ноутбук без дискретной видеокарты – берите Mistral-7B или Llama-3-8B. Для совсем слабых машин (4 ГБ ОЗУ) – Phi-3-mini.

Представьте ситуацию: вы решили перейти на локальные нейросети, но понятия не имеете, какая из сотен моделей на Hugging Face вам нужна. BotHub [2]позволяет протестировать разные модели через единый интерфейс, не тратя часы на установку и настройку. Понравилась конкретная модель? Отлично, теперь вы знаете, какую качать и запускать локально. А по ссылке [3] сервис дарит 300 000 капсов для первых задач новым пользователям, можно начать работать прямо сейчас!

Минусы, о которых стоит знать

-

Качество ответов заметно ниже, чем у ChatGPT-4o, Claude 3.5 или DeepSeek-V3. Это плата за локальность и работу на CPU.

-

Приложение иногда подвисает на длинных контекстах (я замечала проблемы на объёмах существенно больше 4-5 тысяч токенов, точная цифра зависит от модели и ОЗУ).

-

Русский язык поддерживается, но модель явно тренировали в основном на английском. Базовые запросы поймёт, но сложные формулировки могут запутать.

-

Телеметрия опциональна, но по умолчанию включена. Её можно отключить в настройках приложения, если хотите полной приватности.

Для кого это

Для тех, кто хочет попробовать локальные нейросети без головной боли [4]. Установил за 5-10 минут и готов к работе. Не для сложных инженерных задач или глубокой аналитики, но для базовых консультаций, переписывания текстов, ответов на вопросы по своим документам и простого кода – вполне.

Вердикт. GPT4All – идеальный вход в мир локального ИИ для обычного пользователя с ноутбуком. С ним не нужно разбираться в терминалах, драйверах и CUDA. А с появлением поддержки LocalDocs он становится ещё и полноценным офлайн-помощником по вашим файлам.

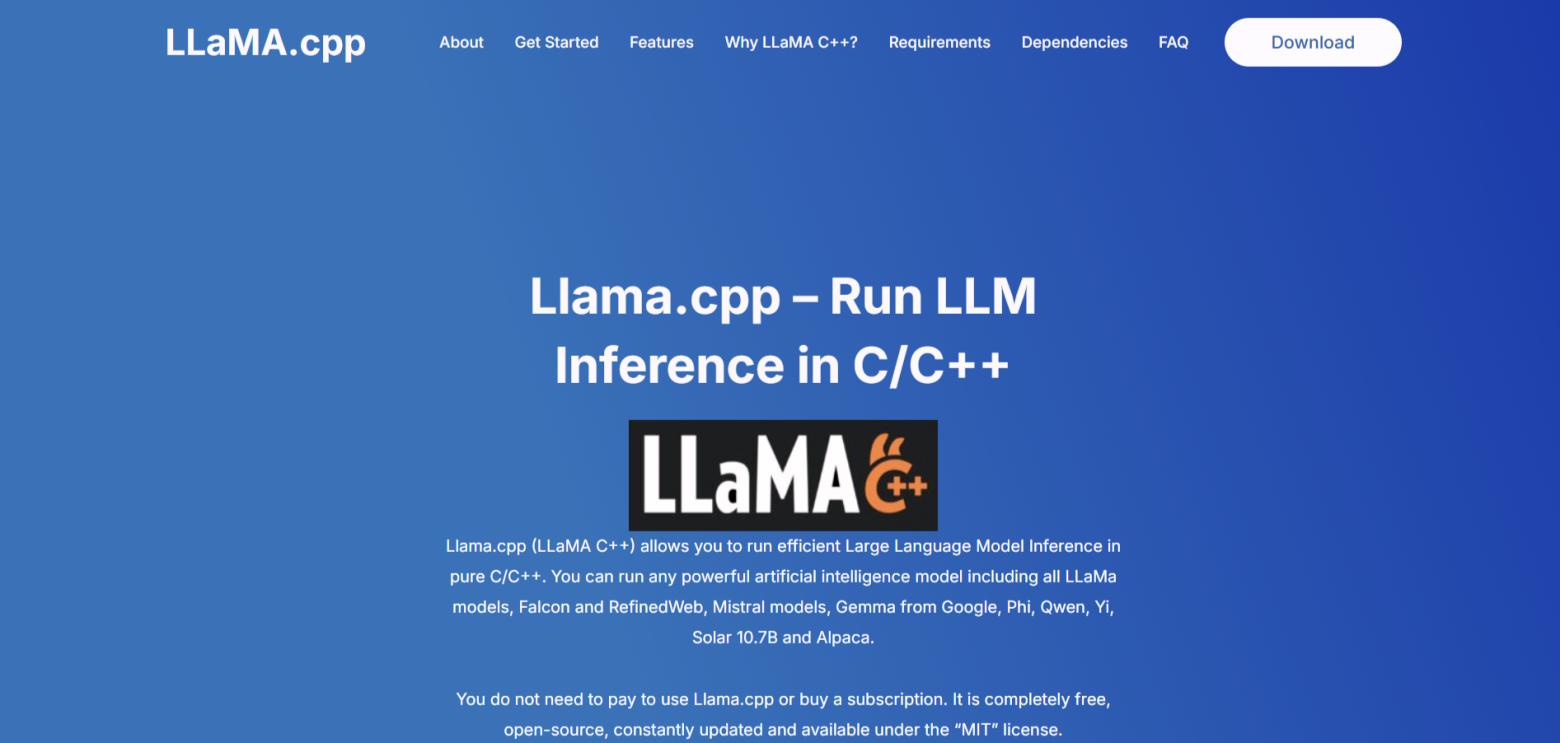

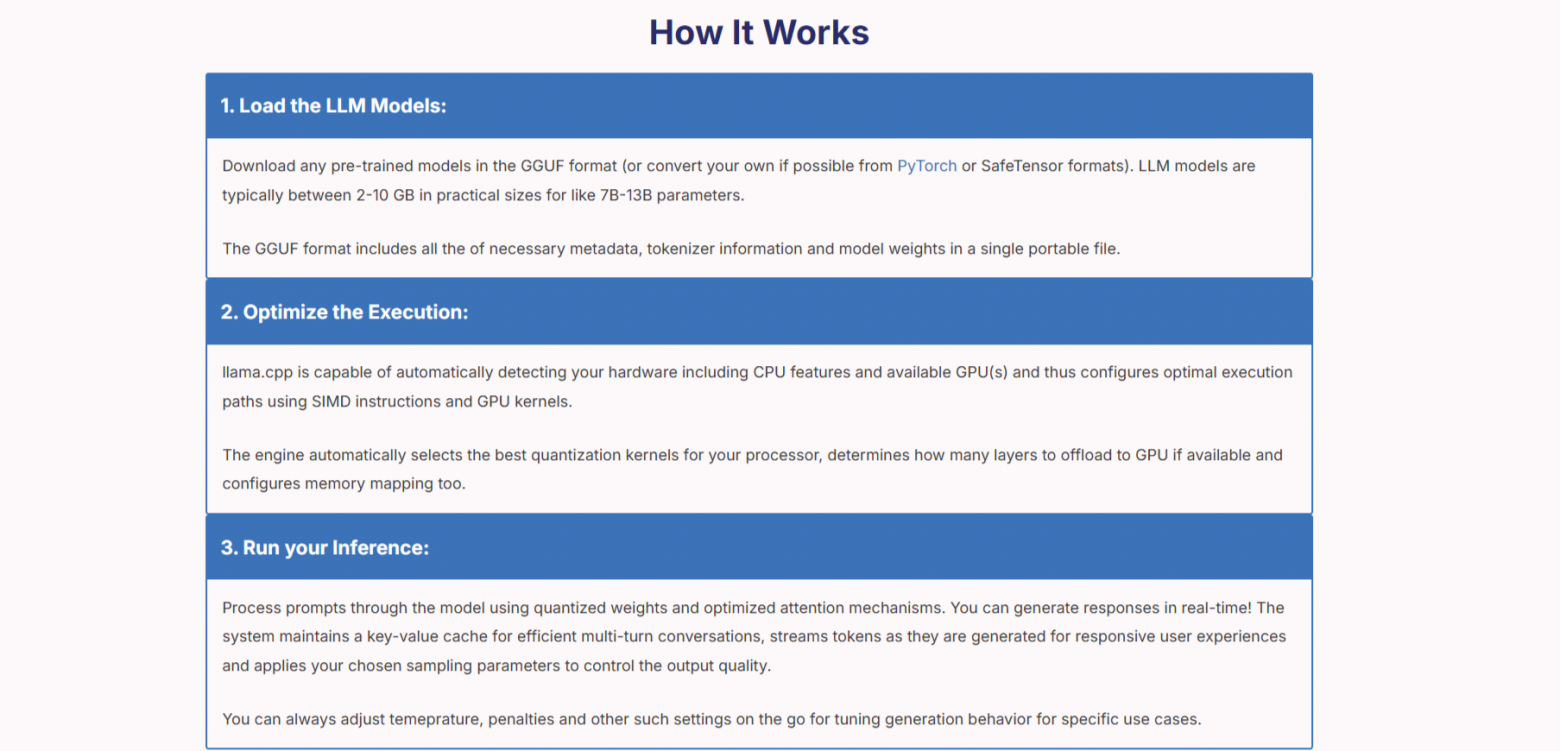

2. Llama.cpp

Llama.cpp [5]– это библиотека на C++, которая умеет запускать большие языковые модели на обычном процессоре без видеокарты, без 32 гигабайт RAM. Создал её болгарский разработчик Георгий Герганов, и этот инструмент буквально перевернул мир локальных ИИ в 2023 году. К 2026 он оброс сотнями форков и улучшений.

До Llama.cpp попытка запустить модель на CPU была пыткой. Медленно, неэффективно, требовало тонны памяти [6]. Автор придумал формат GGUF и 4-битную квантизацию, которая сокращает размер модели в 3-4 раза с минимальной потерей качества. Простое объяснение: вместо того чтобы хранить числа с высокой точностью, вы их округляете. И работает это почти так же хорошо.

Как это выглядит на практике

Устанавливаете Llama.cpp через терминал:

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp

makeКачаете модель в формате GGUF (например, с Hugging Face). Запускаете:

./main -m model.Q4_K_M.gguf -p "Привет, как дела?" -n 100Получаете ответ.

Цифры и факты

Протестируем на среднестатистическом ноутбуке 2024 года (Intel Core i5, 16 ГБ RAM, без дискретной видеокарты):

|

Модель |

Размер (Q4_K_M) |

RAM |

Скорость (токен/сек) на ноутбуке Core i5 2024 |

|---|---|---|---|

|

Phi-3 mini 3.8B |

2.2 ГБ |

4-5 ГБ |

20-30 |

|

Mistral 7B |

4.1 ГБ |

8 ГБ |

10-15 |

|

Llama 3 8B |

4.7 ГБ |

9-10 ГБ |

8-12 |

|

Qwen 2.5 14B |

8 ГБ |

14 ГБ |

4-6 |

Данные для типичного ноутбука 2024 года без дискретной видеокарты. На мощных серверных CPU (Intel Xeon) скорости могут быть в 3-5 раз выше.

Скорость 10 токенов в секунду – это примерно 460 слов в минуту (1 токен это примерно 0.75 слова в среднем по-русски, но для английских текстов 1.3 токена на слово). Человек читает со скоростью 200-250 слов в минуту. То есть модель отвечает примерно в 2 раза быстрее, чем вы успеваете прочитать.

Плюсы

-

Экономия на видеокартах. Хороший CPU дешевле и доступнее

-

Огромный выбор моделей. Почти все современные модели выходят с GGUF-версией

-

Возможность запускать на сервере без GPU. Экономия в дата-центрах

-

Совместимость с Raspberry Pi. Да, модель можно запустить на одноплатном компьютере. Но с оговоркой: TinyLlama (1.1B) выдаст около 14 токен/сек, а полноценная Gemma 3 12B – уже всего около 1.5 токен/сек. Для серьёзных моделей Pi 5 всё ещё слабоват, но сам факт, что они вообще запускаются, впечатляет

Минусы

-

Терминал. Не все готовы с ним работать. Хотя есть GUI-обёртки типа LM Studio и GPT4All (внутри которых как раз Llama.cpp)

-

Ручная настройка. Нужно подбирать параметры (температуру, top_k, контекст) под свои задачи

-

Нет мультимодальности. Чистый текст, никаких картинок

Для кого это

Для технических специалистов, которые хотят встроить локальную нейросеть в свой проект. Для тех, у кого старый ноутбук без дискретной видеокарты. Для параноиков, которые не доверяют готовым приложениям и хотят собирать всё из исходников.

3. Stable Diffusion WebUI (Forge)

Текст – это хорошо, но давайте честно, большинство людей хотят картинки. И желательно такие, которые не заблокирует цензура облачных сервисов. Тут на сцену выходит Stable Diffusion.

Stable Diffusion WebUI [7] – это модель для генерации изображений по текстовому описанию. В облачных версиях (Midjourney, Kandinsky) вы отправляете промпт на сервер, он генерирует, вы получаете результат. Всё красиво, но нужен интернет, есть цензура (попробуйте сгенерировать что-то чуть более взрослое или политически неудобное), вы платите за каждый запрос (или сидите в очереди бесплатных генераций), ваши картинки уходят на сервер, с ними могут делать что угодно. Локальная версия решает все эти проблемы.

Что такое Forge и почему не оригинал

Stable Diffusion WebUI Forge – это платформа на основе классического WebUI от Automatic1111 (базируется на Gradio), которая сделана для ускорения инференса, оптимизации управления ресурсами видеокарты и упрощения разработки расширений. Автор – lllyasviel (тот самый разработчик, который создал ControlNet). Название Forge вдохновлено Minecraft Forge – проект задуман как кузница для WebUI.

Главное отличие от оригинала: Forge переписывает всю логику [8] управления памятью и добавляет Unet Patcher — механизм, который позволяет расширениям (например, FreeU, SVD, Zero123, PhotoMaker) работать без конфликтов друг с другом и без танцев с бубном.

Что Forge даёт по сравнению с оригинальным WebUI

По данным из официального README, вот точные цифры ускорения и экономии памяти (для SDXL на 1024px):

|

Ваша видеокарта |

Ускорение (it/s) |

Снижение пика VRAM |

Во сколько раз больше разрешение (без OOM) |

|---|---|---|---|

|

8 ГБ VRAM (обычная) |

+30-45% |

700 МБ – 1,3 ГБ |

в 2-3 раза |

|

6 ГБ VRAM (слабая) |

+60-75% |

800 МБ – 1,5 ГБ |

в 3 раза |

|

24 ГБ VRAM (RTX 4090) |

+3-6% |

1 – 1,4 ГБ |

в 1,6 раза |

Дополнительно:

-

Максимальный batch size (количество изображений за раз) вырастает в 4-6 раз для 6-8 ГБ карт.

-

При использовании ControlNet для SDXL максимальное количество одновременных ControlNet увеличивается в 2 раза, а скорость генерации с ControlNet ускоряется на 30-45%.

-

Без всяких дополнительных флагов Forge запускает SDXL на 4 ГБ VRAM и SD1.5 на 2 ГБ VRAM.

Как установить (официальная инструкция из README)

Способ 1. Через Git (рекомендуется для тех, кто хочет переиспользовать свои модели и расширения из старого WebUI):

git clone https://github.com/lllyasviel/stable-diffusion-webui-forge.git

cd stable-diffusion-webui-forgeЗатем запустите update.bat (Windows) или ./webui.sh [9] (Linux/macOS). Это важно, ведь без запуска update.bat вы можете использовать старую версию с незафикшенными багами.

После обновления запустите run.bat. Откроется браузер с адресом http://localhost:7860 [10].

Способ 2. Установочный пакет в один клик (для новичков):

-

Скачайте архив с Git и Python внутри (ссылка в репозитории)

-

Распакуйте в папку (путь без русских букв)

-

Запустите

update.bat, затемrun.bat

Важное отличие от оригинального WebUI. Forge удалил все старые CMD-флаги – medvram, lowvram, medvram-sdxl, precision full, no half, no half vae, attention_xxx, upcast unet и другие. Они больше не нужны и ничего не делают. Forge сам решает, как загружать модели.

Если вы всё же хотите вмешаться, есть несколько флагов для особых случаев, используйте на свой страх [11] и риск:

-

--always-offload-from-vram– выгружает модели из VRAM чаще, медленнее, но безопаснее (полезно, если работаете с несколькими программами сразу) -

--cuda-malloc– ускоряет на миллисекунды, но может крашить программу -

--cuda-stream– ускоряет на 15-25% на RTX 3060/4050 с 6 ГБ, но на старых картах (GTX 1080/2060) вызывает чёрные изображения или OOM -

--pin-shared-memory– работает только с--cuda-stream, даёт ещё +20% скорости на 30xx/40xx с малым VRAM, но на GTX 1060/1050 гарантированно крашит программу

Forge настоятельно не рекомендует использовать флаги, если вы не уверены, что они вам нужны.

Чего нет в Forge

-

Русский язык в промптах. Модель не понимает кириллицу. Промпты нужно писать латиницей. (Есть отдельные русскоязычные модели, но они менее качественные.)

-

Автоматическая цензура. Её нет, вы сами отвечаете за то, что генерируете.

-

Потребление диска. Одна модель SDXL весит 6–7 ГБ, ControlNet к ней – по 1-2 ГБ на тип, полный набор легко займёт 100+ ГБ. Это не баг, это особенность локальной работы.

-

Сложность настройки. Сотни параметров влияют на результат. Но вы всегда можете вернуться к стандартному WebUI-интерфейсу, который Forge не меняет (авторы обещают, что никогда не будут добавлять ненужные субъективные изменения в интерфейс).

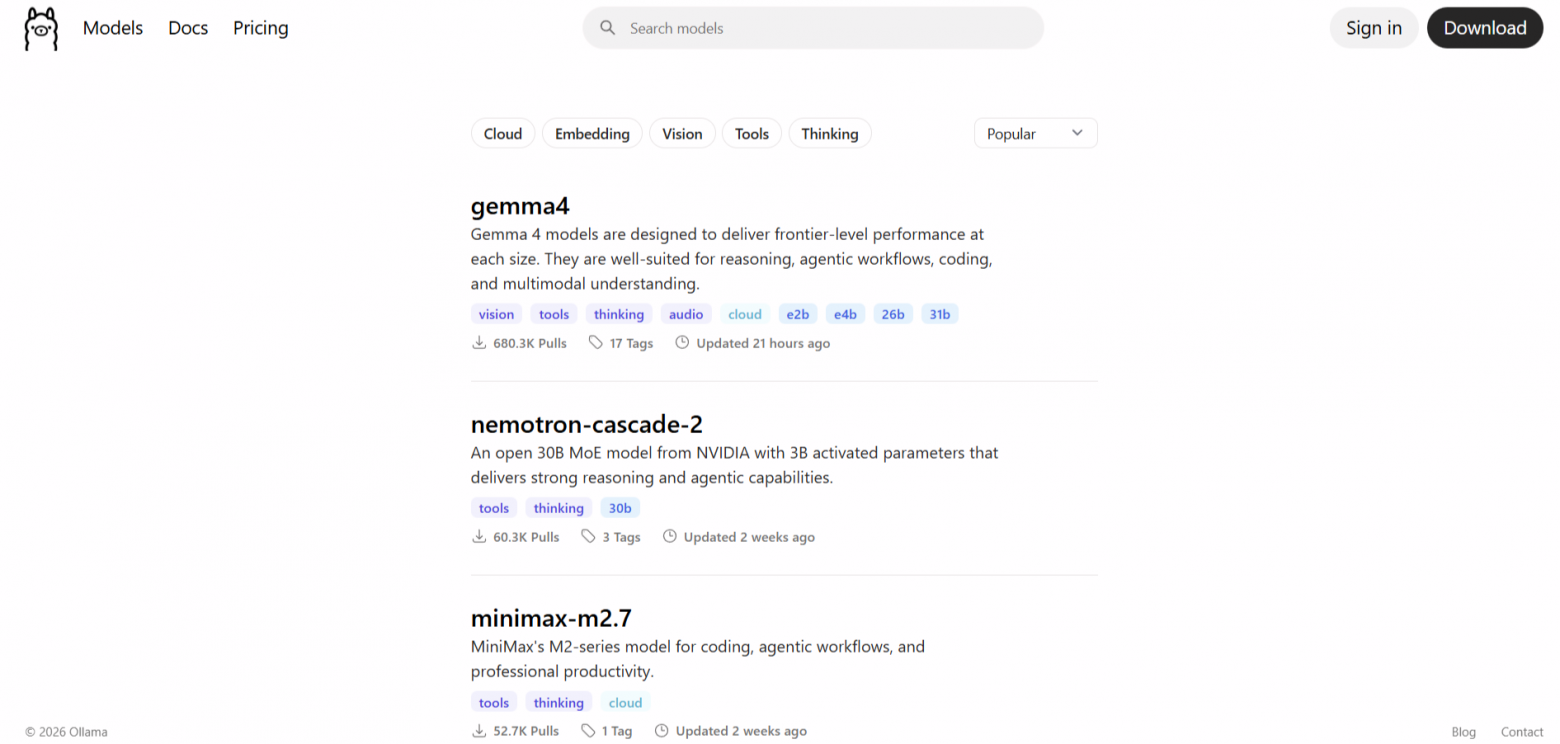

4. Ollama

Ollama [12]– это программа, которая скачивает модели из интернета (один раз, при установке), запускает их на вашем компьютере, отдаёт доступ через HTTP API, как настоящий облачный сервис, и даёт консольный чат для быстрых тестов. Установили, написали ollama run llama3, задали вопрос, получили ответ. Настолько просто, насколько это вообще возможно в мире локальных нейросетей.

Как это работает

После установки на Windows, macOS или Linux вы открываете терминал и пишете ollama pull mistral. Ollama скачивает готовую GGUF-модель из своего реестра и сохраняет в локальное хранилище. Квантизация уже выбрана за вас, если нужна кастомная, тогда используйте Modelfile. Дальше вы запускаете ollama run mistral, и открывается интерактивный чат прямо в терминале. Никакого дополнительного софта.

А если вы разработчик, то можете обращаться к модели через API. Отправляете curl-запрос на http://localhost:11434/api/generate [13] с JSON-телом, где указываете модель и промпт, и получаете ответ в том же формате, что и от OpenAI. Разница только в адресе.

Какие модели доступны

Ollama поддерживает сотни моделей. Вот актуальный топ на 2026 год:

|

Модель |

Размер (Q4) |

RAM |

Особенность |

|---|---|---|---|

|

gemma4:e2b |

1.2 ГБ |

2-3 ГБ |

Самый лёгкий, эффективный 2B |

|

gemma4:e4b |

2.5 ГБ |

4-5 ГБ |

Баланс скорости и качества |

|

llama3.1:8b |

4.7 ГБ |

8-10 ГБ |

Золотой стандарт, общий |

|

gemma4:26b (MoE) |

15 ГБ |

16 ГБ |

4B активных параметров, как 8B по скорости |

|

qwen3-coder:8b |

5 ГБ |

8-10 ГБ |

Для программирования |

|

glm-4.7-flash |

5 ГБ |

8-10 ГБ |

Для кодинга с контекстом 64K |

|

gemma4:31b (dense) |

18 ГБ |

20+ ГБ |

Уровень GPT-4o mini |

|

llama3.1:70b |

42 ГБ |

48+ ГБ |

Нужен мощный сервер |

Все модели работают полностью офлайн после скачивания.

Почему Ollama, а не Llama.cpp напрямую

Llama.cpp – это движок. Ollama – это готовый продукт на его основе. Ollama берёт на себя управление версиями моделей, автоматическую квантизацию (выбор точности под ваше железо), запуск модели в фоне как сервиса и простой API без настройки. Вы теряете возможность тонкой настройки, но приобретаете простоту. Для 95% задач этого достаточно.

Что ещё умеет Ollama

Начиная с версии v0.20.0, Ollama поддерживает аудио, вы можете выполнить ollama transcribe gemma4 и получить текст из аудиофайла. А команда ollama launch claude одной строкой поднимает Claude Code с локальной моделью – никаких переменных окружения.

Вы можете создать свой собственный образ модели через Modelfile: указать базовую модель, системный промпт, температуру и даже встроить примеры ответов. Это сохраняется в файл, которым можно поделиться с коллегой.

Мультимодальные модели (например, Gemma 4 или Qwen3.5-35B) умеют работать с изображениями. Вы передаёте путь к картинке вместе с промптом, и модель описывает, что на ней происходит.

Ollama может превращать текст в вектор – числовой отпечаток, который нужен для поиска по документам или кластеризации. Популярные эмбеддеры: all-minilm, nomic-embed-text, mxbai-embed-large, bge-m3.

Минусы

-

Если что-то пошло не так, сложно лезть под капот. Ollama скрывает детали запуска Llama.cpp.

-

Модели хранятся в

~/.ollamaи могут занять 50+ ГБ, если вы любите скачивать всё подряд -

Не получится выкрутить параметры, которые есть в чистом Llama.cpp

-

Нет встроенного веб-интерфейса, только терминал и API. Для чата с картинками нужен отдельный фронтенд (например, Open WebUI)

-

Не для продакшена. Ollama не поддерживает непрерывную пакетную обработку и многопользовательскую балансировку.

-

Ограниченная многопользовательность. Если вам нужно обслуживать десятки запросов в секунду, смотрите в сторону vLLM или TensorRT-LLM.

5. LM Studio

LM Studio – это десктопное приложение с графическим интерфейсом, которое позволяет скачивать, запускать и общаться с локальными моделями в несколько кликов. Вы открываете программу, выбираете модель из списка, нажимаете скачать, ждёте пару минут и начинаете чат.

Приложение есть для Windows, macOS и Linux. На Mac с M-чипами оно работает особенно шустро благодаря встроенной поддержке Metal.

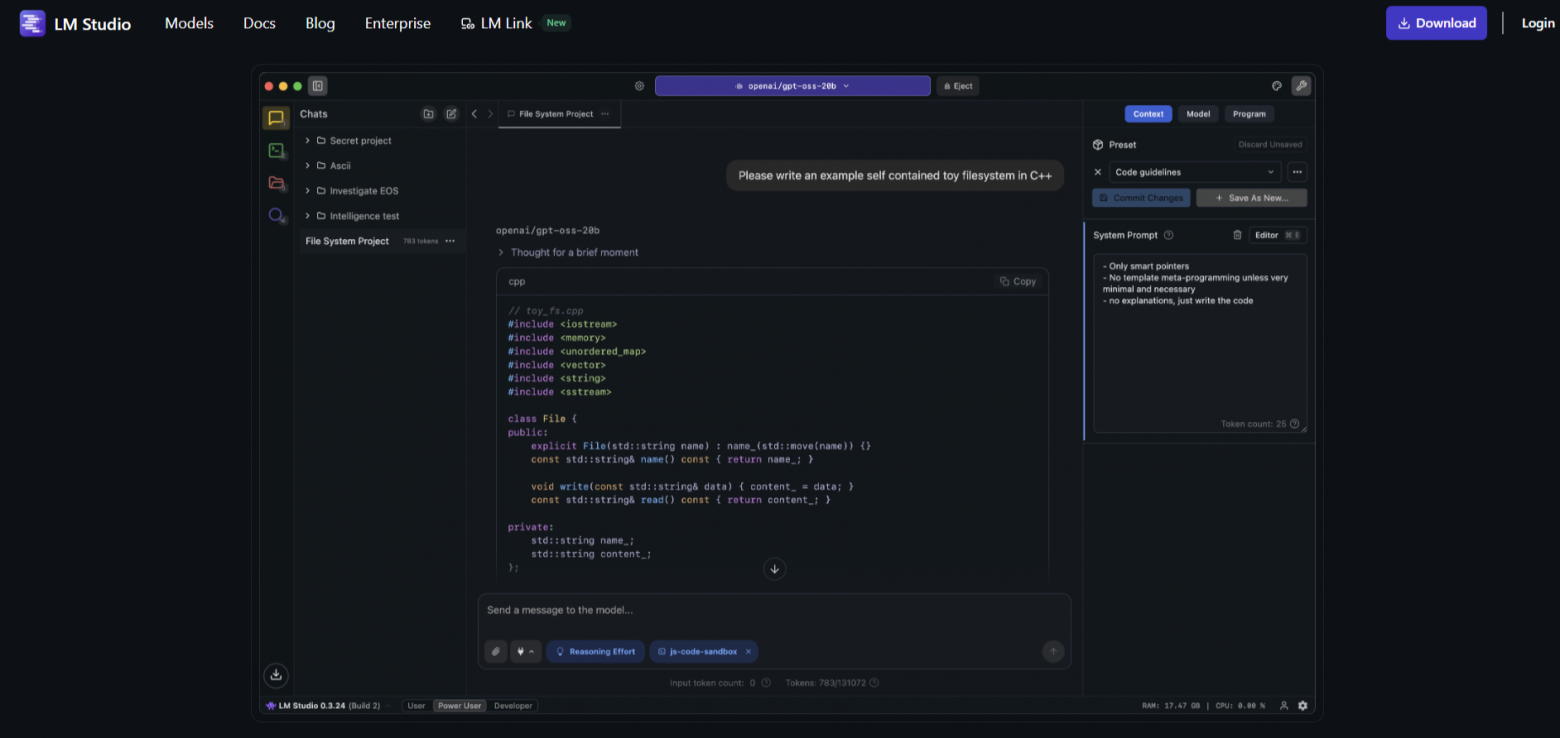

Как это выглядит на практике

После установки вы попадаете на главный экран, где есть поиск моделей. LM Studio подтягивает каталог с Hugging Face прямо в приложение – вы видите названия моделей, их размер, формат (GGUF), автора и количество скачиваний. Нашли нужную – нажали скачать. Модель сохраняется на диск.

Когда загрузка закончена, вы переходите на вкладку Chat. Выбираете модель из выпадающего списка, настраиваете параметры (температуру, контекст, количество токенов) ползунками (никаких текстовых конфигов) и начинаете диалог. Модель отвечает в красивом пузырьковом интерфейсе, как в любом современном мессенджере.

Что можно настраивать

Несмотря на простоту, LM Studio не прячет важные настройки. Вы можете указать, сколько слоёв модели загружать на видеокарту (если она есть), а сколько оставить на процессоре. Выбрать количество потоков для CPU. Включить или выключить GPU-ускорение. Сменить движок инференса (под капотом всё тот же Llama.cpp). Всё это – через галочки и выпадающие списки, без редактирования текстовых файлов.

Для продвинутых пользователей есть вкладка Developer (раньше называлась Server). LM Studio может запустить локальный API, совместимый с OpenAI и Anthropic, прямо из интерфейса. Вы нажимаете кнопку Start Server, и любое приложение на вашем компьютере может обращаться к модели через http://localhost:1234 [14]. Например, вы можете подключить к нему Continue в VS Code или SillyTavern для ролевых игр. Доступны три типа эндпоинтов:

-

Нативный:

http://localhost:1234/api/v1/chat[15] -

OpenAI-совместимый:

http://localhost:1234/v1/chat/completions[16] -

Anthropic-совместимый:

http://localhost:1234/v1/messages[17]

Плюсы

-

Интерфейс. Это главное преимущество LM Studio. Вы не пугаете новичков чёрным экраном терминала. Всё интуитивно понятно: скачать, загрузить, спросить.

-

Поиск моделей встроен прямо в приложение. Не нужно открывать браузер, искать на Hugging Face, разбираться в типах файлов. LM Studio показывает только совместимые модели и сразу говорит, сколько места они займут.

-

Встроенный сервер API превращает LM Studio в замену Ollama для тех, кто не хочет работать с терминалом. Нажали кнопку – получили эндпоинт.

-

LM Studio показывает технические метрики в реальном времени. Вы видите, насколько быстро генерирует модель, сколько памяти ест, где узкое место. Это помогает подбирать настройки под своё железо без угадывания.

-

LM Studio получил поддержку JIT (Just-In-Time) загрузки и TTL (Time-To-Live). Если вы обращаетесь к модели через API, она загружается автоматически при первом запросе. Если к ней нет обращений в течение заданного времени (по умолчанию 60 минут), она выгружается сама.

Минусы

-

LM Studio потребляет заметно больше оперативной памяти, чем чистый Llama.cpp или Ollama. Графический интерфейс и встроенный браузер для каталога моделей висят в фоне и жрут свои 300-500 мегабайт сверху. На машинах с 8 ГБ это критично.

-

Приложение закрытое. Исходный код LM Studio не опубликован. Вы доверяете разработчикам, что они не встроили телеметрию или что похуже. При этом разработчики заявляют, что «LM Studio не собирает данные и не отслеживает ваши действия». Для коммерческого использования требуется отдельная лицензия.

-

Некоторые продвинутые возможности Llama.cpp в LM Studio не вынесены в интерфейс. Например, специфические сэмплеры или нестандартные форматы кэша. Если вам нужно что-то необычное, придётся возвращаться к терминалу.

-

Управление памятью требует понимания. LM Studio умеет автоматически выгружать модели, но только если они загружены через API (JIT-загрузка с TTL). Для моделей, загруженных вручную через интерфейс, их нужно выгружать вручную кнопкой Unload – иначе они остаются в памяти. Кроме того, само приложение LM Studio потребляет 500-600 МБ видеопамяти (VRAM) на старте из-за Electron-фреймворка.

LM Studio позволяет подключать внешние инструменты для расширения функций модели: поиск в интернете, выполнение кода, доступ к файловой системе. Одна интеграция уже встроена – песочница для JavaScript/TypeScript (Deno). Минус: нет каталога интеграций, всё нужно настраивать вручную через редактирование mcp.json.

Подводим итог

Локальные нейросети не заменят ChatGPT-5.4 или Claude-Opus-4.6 в сложных рассуждениях. Модели на 7-8 миллиардов параметров отвечают медленнее, иногда галлюцинируют и хуже понимают русский язык. Для серьёзной работы с текстом на русском вам понадобятся модели типа Qwen или Gemma, а они требуют 16+ ГБ RAM.

Генерация изображений на CPU – это вообще мазохизм. Одна картинка за 2-10 минут убивает любой творческий порыв. Если у вас нет видеокарты с 6+ ГБ VRAM, локальная генерация картинок станет испытанием терпения.

Однако, есть и другая сторона медали. Вам не нужен доступ к облачным серверам, не нужны подписки за $20 в месяц, не нужно мириться с цензурой и беспокоиться, куда утекают ваши данные. Всё, что требуется, это компьютер, немного свободного места на диске и один вечер на настройку.

Локальные нейросети – это не замена облачным сервисам. Это альтернатива для тех, кому важны приватность, суверенитет данных и свобода от внешних ограничений. Для повседневных задач, где не нужен ИИ уровня ассистента-миллиардера, локальных моделей более чем достаточно.

Начните с GPT4All или Ollama, установка займёт 10 минут. Удивитесь, как много может делать нейросеть на вашем собственном ноутбуке без единого запроса в интернет. А когда привыкнете, то переходите к Llama.cpp и сборке собственных моделей.

Спасибо за прочтение и удачи!

Автор: mefdayy

Источник [18]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/28303

URLs in this post:

[1] GPT4All : https://gpt4all.io/index.html?ref=dataphoenix.info

[2] BotHub : https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=TOP_LOCAL_NEURAL_NETWORKS_2026:_FULL_SOVEREIGNTY_WITHOUT_INTERNET

[3] по ссылке: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[4] боли: http://www.braintools.ru/article/9901

[5] Llama.cpp : https://llama-cpp.com/

[6] памяти: http://www.braintools.ru/article/4140

[7] Stable Diffusion WebUI: https://huggingface.co/spaces/fluxdev/stable-diffusion-webui-forge/blob/main/README.md

[8] логику: http://www.braintools.ru/article/7640

[9] webui.sh: http://webui.sh

[10] http://localhost:7860: http://localhost:7860

[11] страх: http://www.braintools.ru/article/6134

[12] Ollama : https://ollama.com/

[13] http://localhost:11434/api/generate: http://localhost:11434/api/generate

[14] http://localhost:1234: http://localhost:1234

[15] http://localhost:1234/api/v1/chat: http://localhost:1234/api/v1/chat

[16] http://localhost:1234/v1/chat/completions: http://localhost:1234/v1/chat/completions

[17] http://localhost:1234/v1/messages: http://localhost:1234/v1/messages

[18] Источник: https://habr.com/ru/companies/bothub/articles/1019314/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1019314

Нажмите здесь для печати.