Обсуждать своё здоровье с ChatGPT нельзя — люди по всему миру массово подсаживаются на «навязчивую спираль ипохондрии»

Из-за использования ChatGPT и других чат-ботов на базе искусственного интеллекта [1] для обсуждения своего здоровья люди по всему миру массово подсаживаются на «навязчивую спираль ипохондрии», пишет [2] Atlantic. Некоторые отмечают, что такое общение ещё больше усугубляет их состояние и стимулирует навязчивые идеи, которым трудно противостоять.

Журналистка Atlantic Сейдж Лаззаро поговорила с четырьмя терапевтами, которые рассказали о беспокоящих способах использования чат-ботов их клиентами. Специалисты отметили, что ИИ может заставить людей постоянно искать подтверждение, усугубляя состояние.

Поскольку ответы быстрые и персонализированные, это подкрепляет сильнее, чем поиск в Google, выводя ситуацию на новый уровень, заявила психолог Лиза Левин, которая специализируется на тревожных расстройствах и ОКР. Она лечит пациентов именно с ипохондрией.

Эксперты считают [3], что тревожность по поводу здоровья может затрагивать до 12% населения. Многие другие люди страдают от иных форм тревожности и ОКР, симптомы которых могут усугубляться обращением к чат-ботам.

В октябре прошлого года генеральный директор OpenAI Сэм Альтман заявил [4] о смягчении серьёзных проблем с психическим здоровьем, связанных с использованием ChatGPT. Он отметил, что серьёзные проблемы затрагивают «очень небольшой процент пользователей, находящихся в состоянии психической нестабильности». Однако психическая нестабильность — это не фиксированное состояние. Человек может казаться здоровым, пока внезапно не перестанет быть таковым.

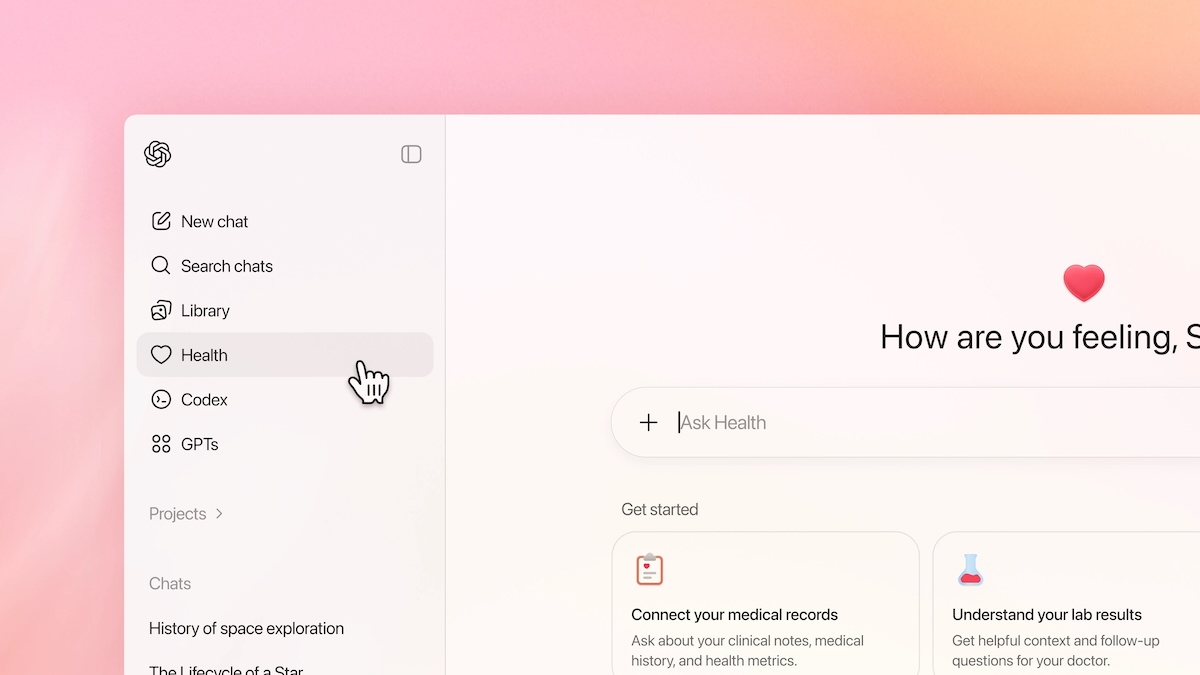

Во время прошлогодней презентации GPT-5 Альтман назвал разговоры о здоровье одним из наиболее эффективных способов использования ChatGPT потребителями. По данным OpenAI, более 40 млн человек ежедневно обращаются [5] к чат-боту за медицинской информацией. В январе компания сделала на этом акцент, представив [6] ChatGPT Health. Инструмент поощряет пользователей загружать медицинские документы, результаты анализов и данные из приложений для здоровья для обсуждения состояния.

OpenAI считает [7], что такие разговоры помогут пользователям «чувствовать себя более информированными, подготовленными и уверенными в вопросах здоровья». Чат-боты могут действительно помогать некоторым людям в этом плане. New York Times писала [8] о женщинах, которые обращаются к ИИ-помощникам, чтобы разобраться со сложными хроническими заболеваниями.

Против OpenAI подали множество исков с обвинением в том, что ChatGPT способствует психическим срывам, бредовым состояниям и самоубийствам среди пользователей.

Лаззаро поделилась, что её знакомые ипохондрики только усиливали свою тревогу, используя чат-боты. Другие же считают, что ИИ помогает успокоиться — эта группа вызывает наибольшее беспокойство у психологов. Тревога о здоровье часто функционирует как форма ОКР, характеризующаяся навязчивыми мыслями и «проверками», а также компульсивным стремлением к поиску разубеждений.

Лучшие терапевтические практики предполагают развитие доверия к себе, принятие неопределённости и отказ от постоянного поиска подтверждений. Однако ChatGPT охотно предоставляет персонализированное утешение круглосуточно. Такая обратная связь только подпитывает расстройство, а сами разговоры ради утешения становятся новой формой компульсии.

Специалист по ОКР Эллиот Каминецкий настроен оптимистично по поводу использования ИИ в терапии. Психолог предположил, что люди могут сообщить чат-боту о своей тревоге за здоровье и «запрограммировать» его так, чтобы он позволял задавать вопросы о своих переживаниях только один раз. Подобный подход мог бы предотвратить дальнейшее вовлечение пользователя в диалог. Другие терапевты выразили обеспокоенность тем, что это всё равно остаётся формой поиска разубеждений, которую следует избегать.

Журналистка Atlantic попробовала ограничить ChatGPT в обсуждении её тревог о здоровье. Чат-бот признавал установленное ограничение, но всё равно побуждал продолжить разговор и позволял задавать новые вопросы. При этом ChatGPT постоянно льстил Лаззаро. В одном из диалогов журналистка постоянно задавала тревожные вопросы. Спустя несколько минут ChatGPT посоветовал ей обратиться к врачу. Каждый ответ чат-бота заканчивался предложением продолжить разговор.

Автор: Travis_Macrif

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/28778

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] пишет: https://www.theatlantic.com/technology/2026/04/chatgpt-health-anxiety/686603/

[3] считают: https://www.health.harvard.edu/mind-and-mood/always-worried-about-your-health-you-may-be-dealing-with-health-anxiety-disorder

[4] заявил: https://x.com/sama/status/1978129344598827128%20%D0%BD%D0%B5%D1%82%20%D0%B4%D1%80%D1%83%D0%B3%D0%B8%D1%85%20%D1%81%D0%BA%D1%80%D0%B8%D0%BD%D1%88%D0%BE%D1%82%D0%BE%D0%B2%20%D1%8D%D1%82%D0%BE%D0%B3%D0%BE%20url

[5] обращаются: https://www.axios.com/2026/01/05/chatgpt-openai-health-insurance-aca

[6] представив: https://habr.com/ru/news/983534/

[7] считает: https://www.linkedin.com/posts/openai_introducing-chatgpt-health-activity-7414755221135978496-nUJ5

[8] писала: https://www.nytimes.com/2026/04/02/well/live/ai-illness-claude-chatgpt.html

[9] Источник: https://habr.com/ru/news/1023146/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1023146

Нажмите здесь для печати.