Мы отдали управление роботами OpenClaw. Что из этого вышло

Началась новая эра – эра автономных агентов. Пользователь пишет запрос на естественном языке, и агент сразу решает поставленную задачу. Или не сразу. Но в таком случае он самостоятельно ищет способ получить недостающие навыки для выполнения запроса.

Меня зовут Сергей, я занимаюсь исследованиями в MWS и руковожу небольшой, но классной командой инженеров-исследователей. Пока одни с помощью ИИ-агентов ищут способы разгрузить рутину, мы в MWS смотрим дальше и видим больше. А что, если дать ИИ-агенту не только «руки», чтобы бродить по сети и нажимать кнопки в интерфейсе, но и «тело»?

OpenClaw может физически взаимодействовать с реальным миром даже с помощью устройств «без мозгов». В этом материале разберём, как максимально просто развернуть такую систему самостоятельно. За помощь в подготовке спасибо Артёму @Artem_Lykov [1] из центра R&D TechGov, который отвечает за направление Physical AI в MWS, и стажёру Дмитрию Ярчуку.

OpenClaw: в чём суть

Когда, казалось, все уже подустали от новостей про ИИ, новые LLM перестали вызывать ажиотаж и не создавали ощущения революционных изменений, в ноябре 2025 года open-source-проект OpenClaw встряхнул индустрию.

Разработчик Питер Штайнбергер создал оркестрационный слой, позволяющий ИИ автономно использовать компьютер. OpenClaw получает инструкции через мессенджер, разбивает их на процессы, выполняет сложные межприкладные задачи и сохраняет контекст.

При этом ИИ-агент может работать с любой LLM. Подробнее можно прочитать на сайте [2] проекта.

История красивая, но есть нюанс.

Если установить OpenClaw на свой ноутбук, инструмент получает полный доступ к системе. Это большая дыра в безопасности. Гораздо надёжнее взять для такого дела виртуальную инфраструктуру в изолированной среде.

Сказано – сделано. Вместо того чтобы мучиться с Docker, собирать окружение вручную или часами штудировать документацию, теперь достаточно использовать готовый образ https://storage.mwsapis.ru/vm-template/images/openclaw-ubuntu-2404.qcow2 OpenClaw в MWS Cloud Platform [3] и подключить к нему модель из MWS GPT Model Hub [4].

Инструкция по развёртыванию

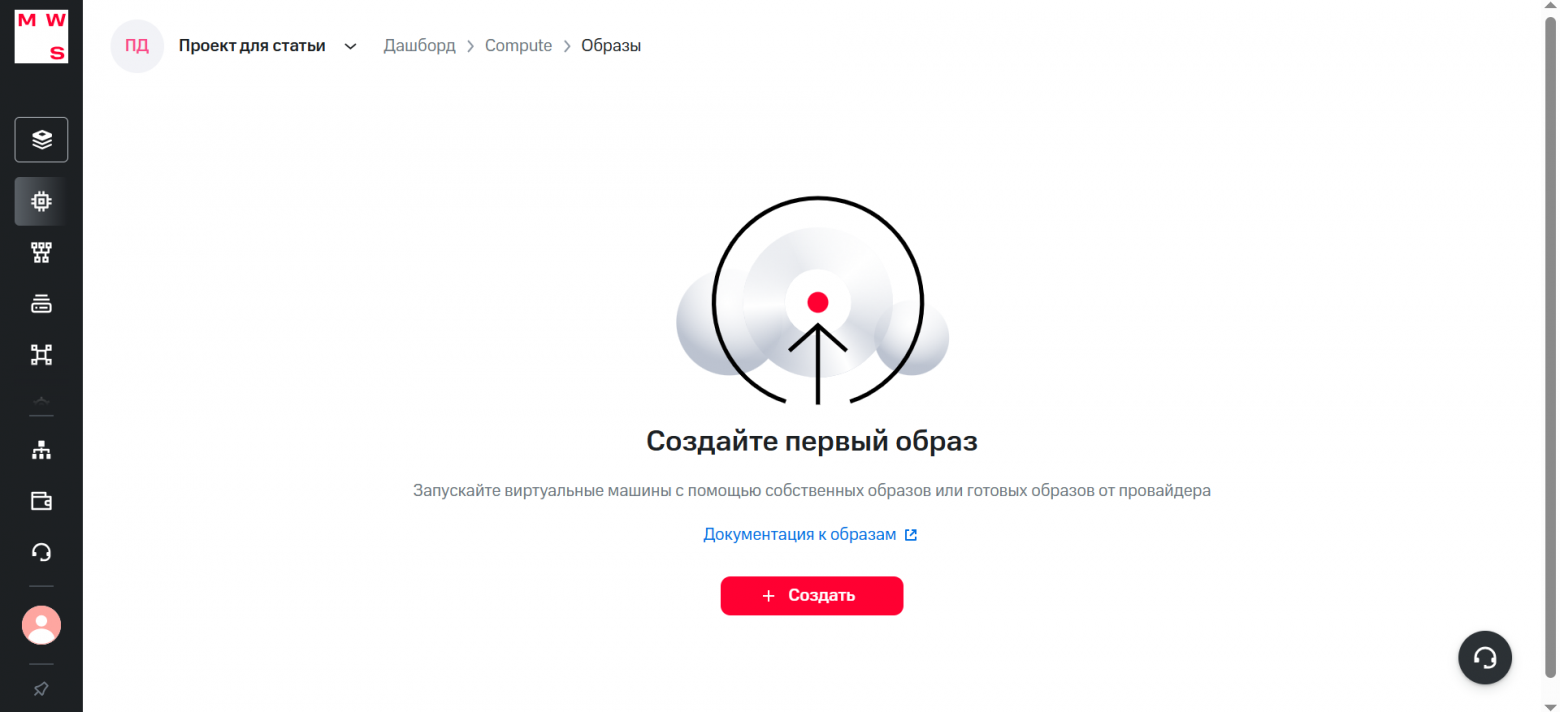

Заходим в консоль [5], авторизуемся или регистрируемся, идём в раздел Compute и находим вкладку Образы.

Нажимаем кнопку «Создать».

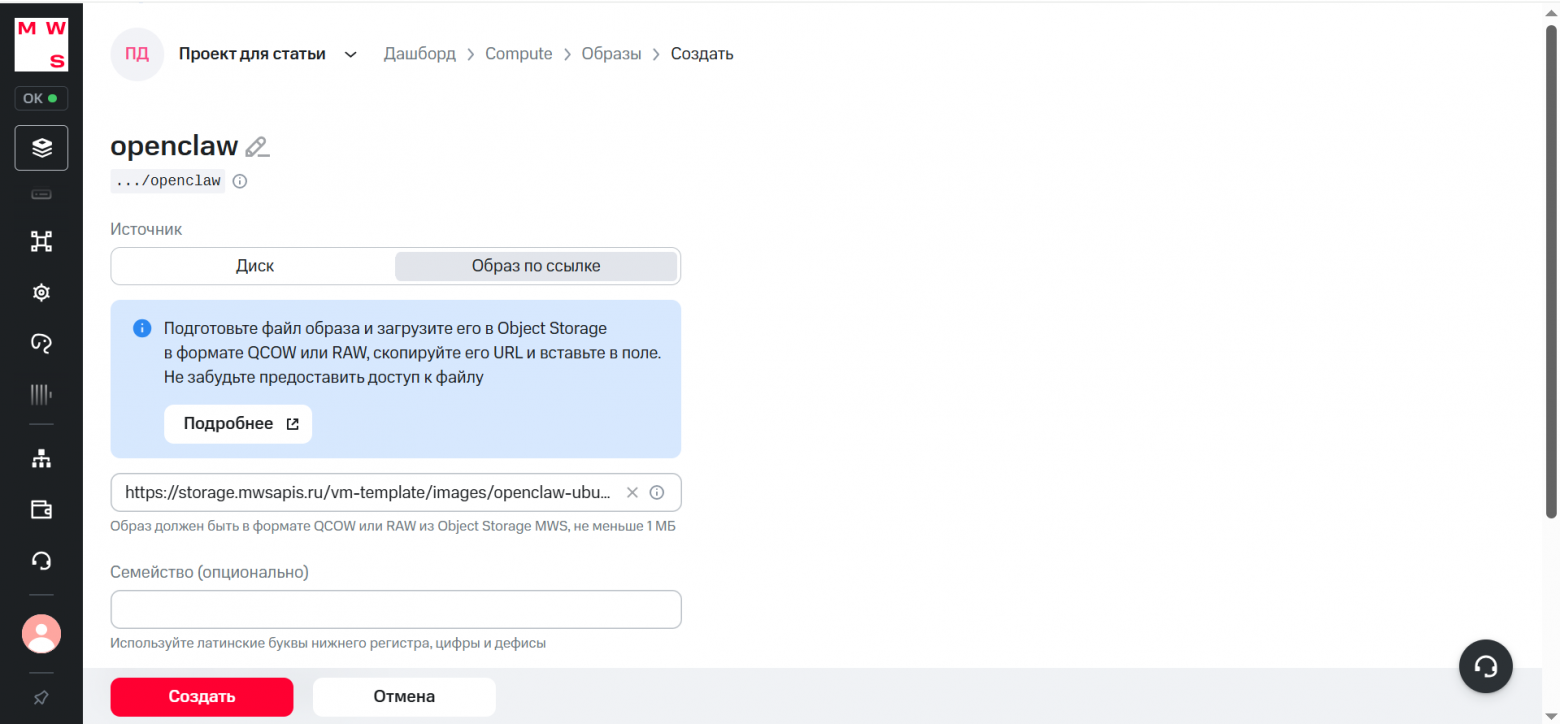

Выбираем тип источника Образ по ссылке. Берём готовый образ по ссылке https://storage.mwsapis.ru/vm-template/images/openclaw-ubuntu-2404.qcow2 из объектного хранилища и добавляем URL в соответствующее поле. Нажимаем «Cоздать».

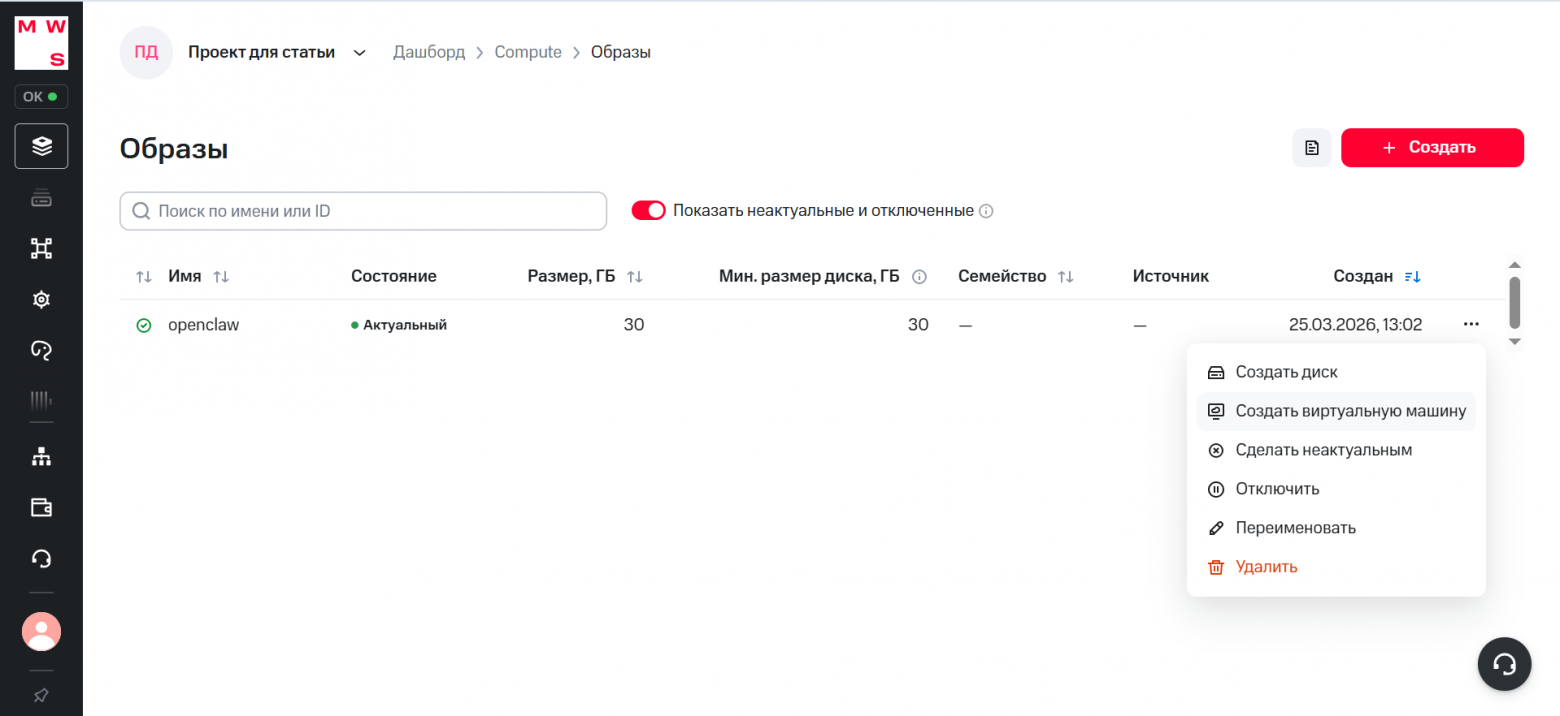

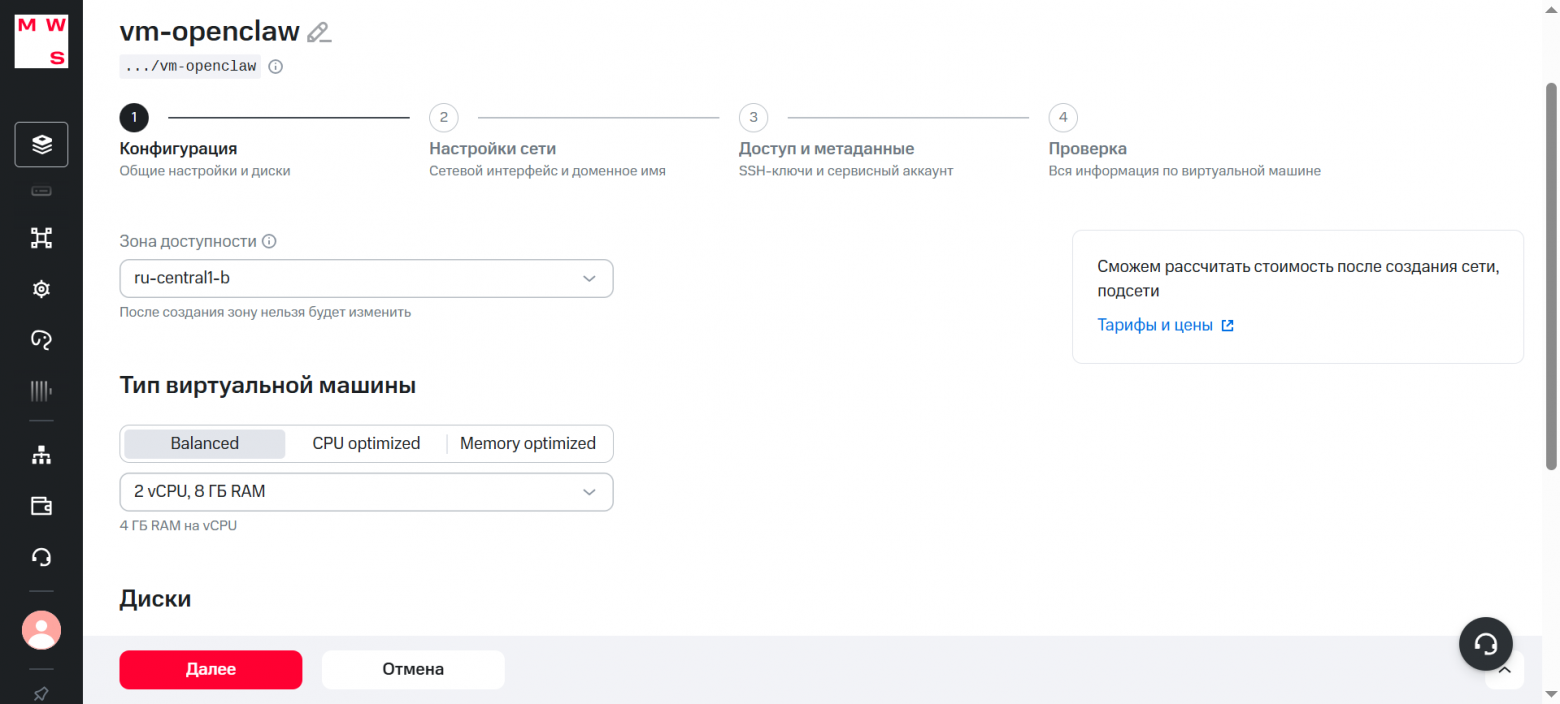

Возвращаемся в раздел Compute → Образы. Нажимаем три точки и выбираем Создать виртуальную машину.

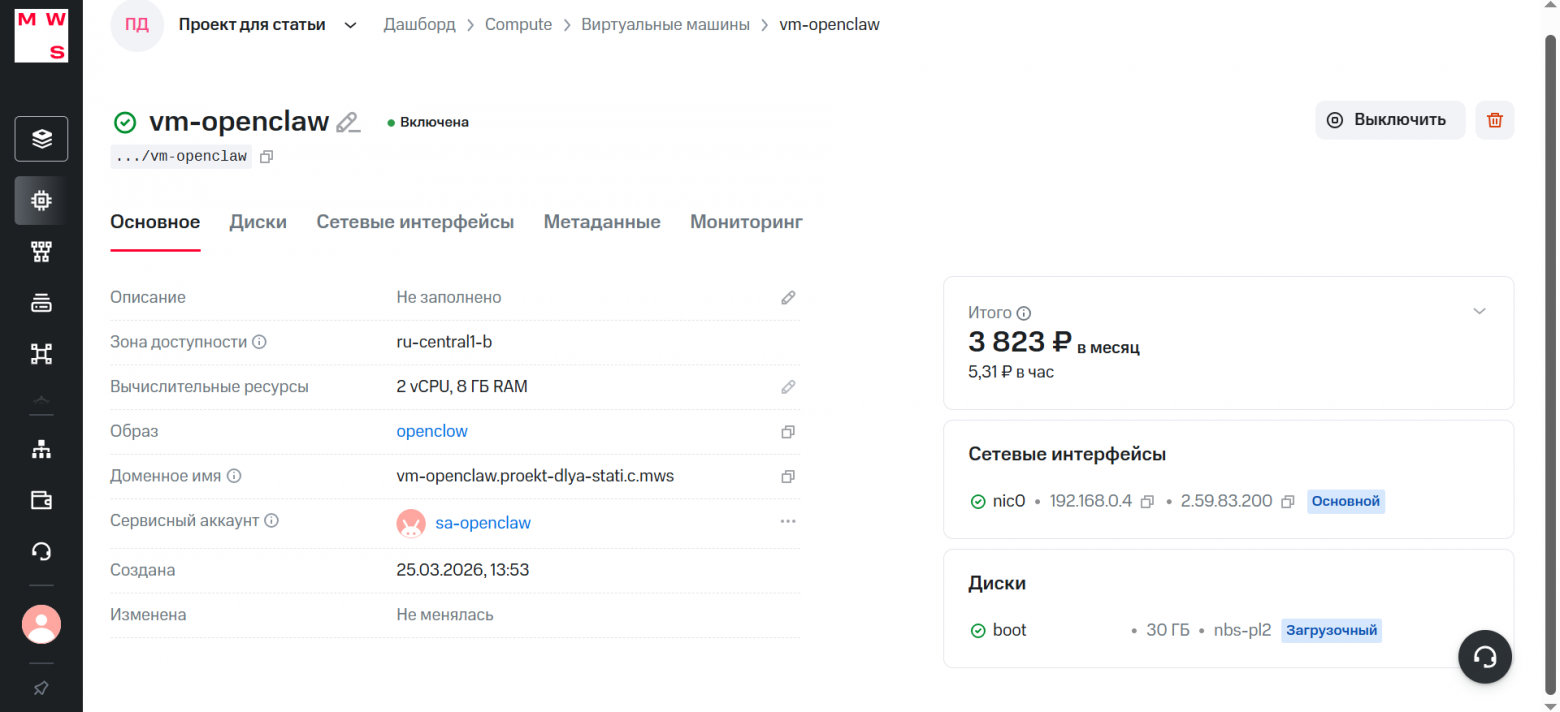

Для наших задач вполне достаточно машины с 2 ядрами vCPU и 8 ГБ RAM.

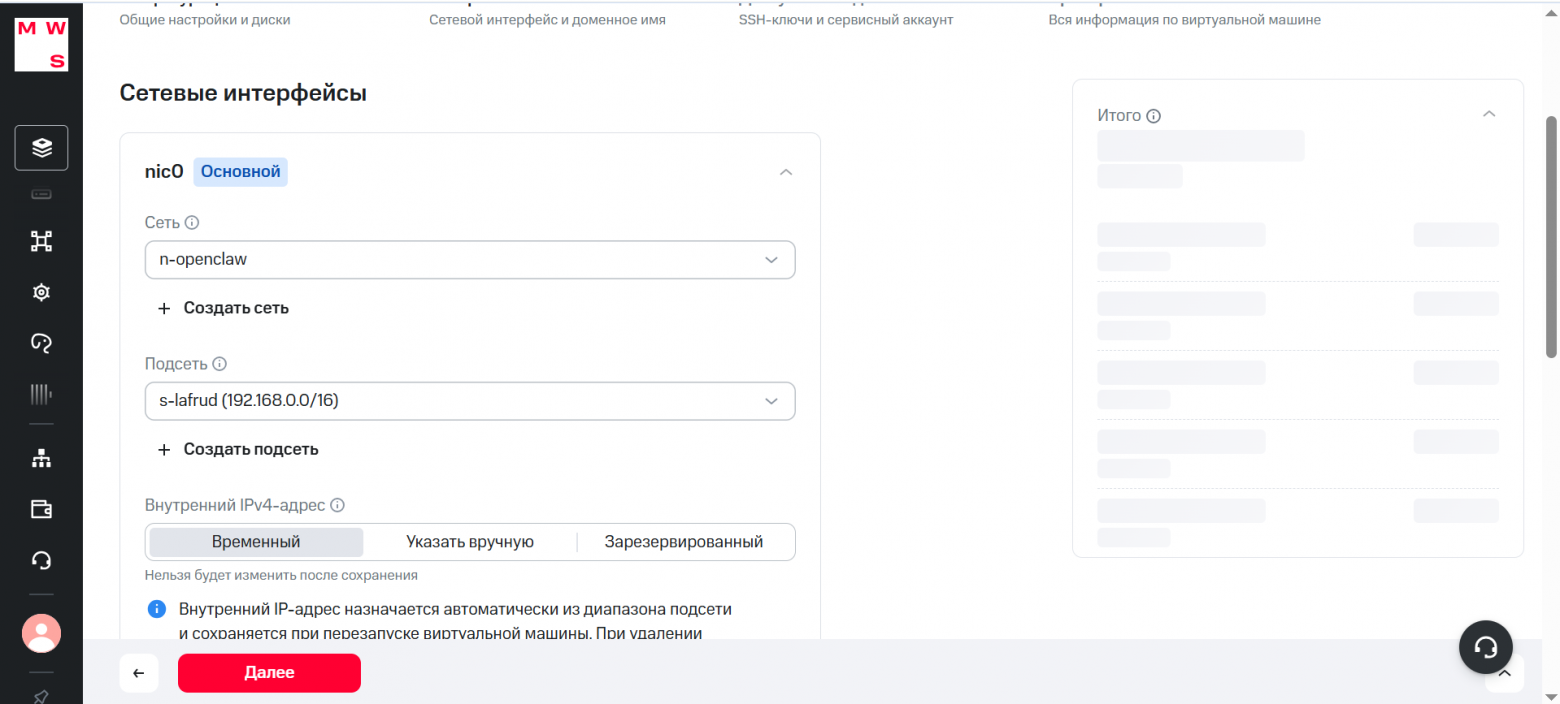

Нажимаем «Далее» и переходим к настройке сети.

Затем создаём SSH-ключ для доступа к серверу и идём дальше.

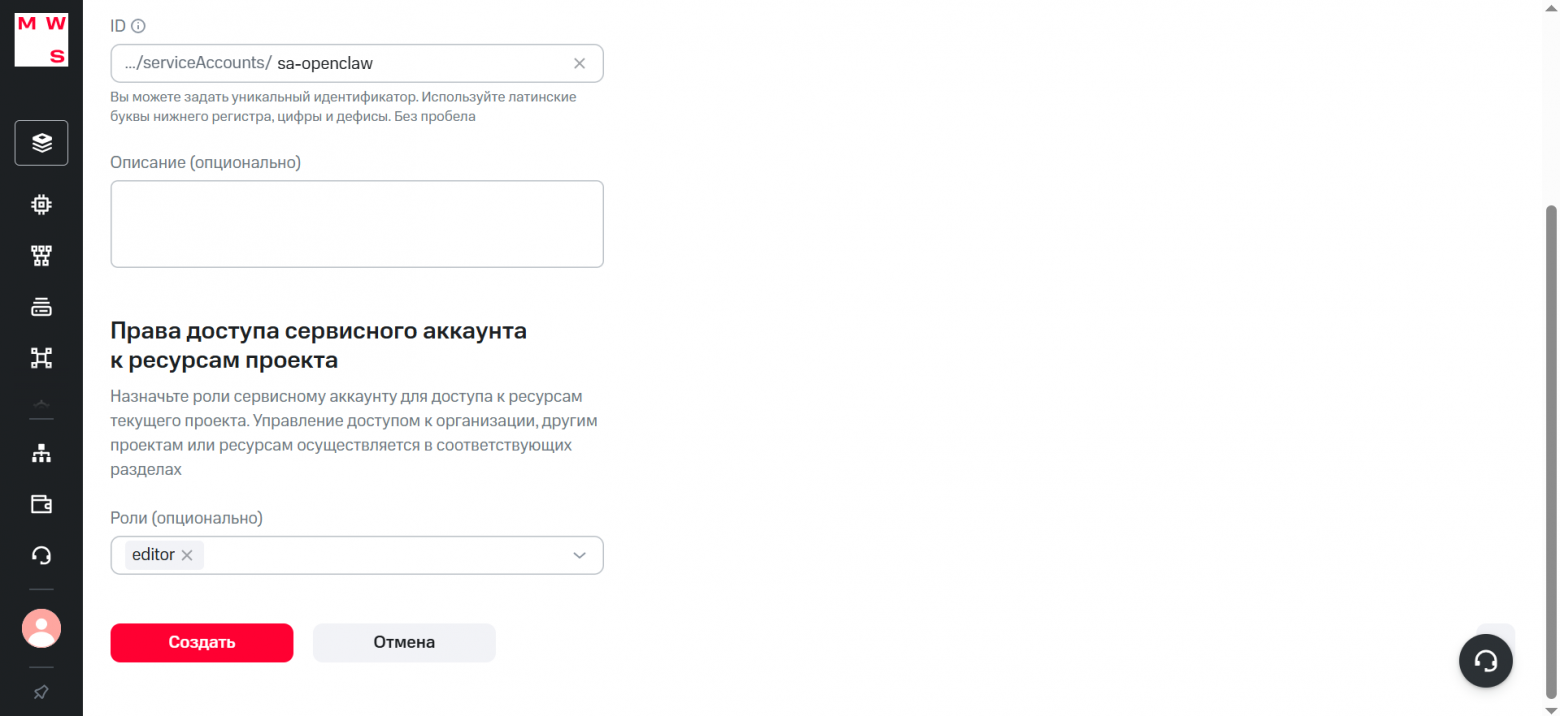

Чтобы ВМ могла работать с ресурсами облака, на следующем шаге добавляем сервисный аккаунт.

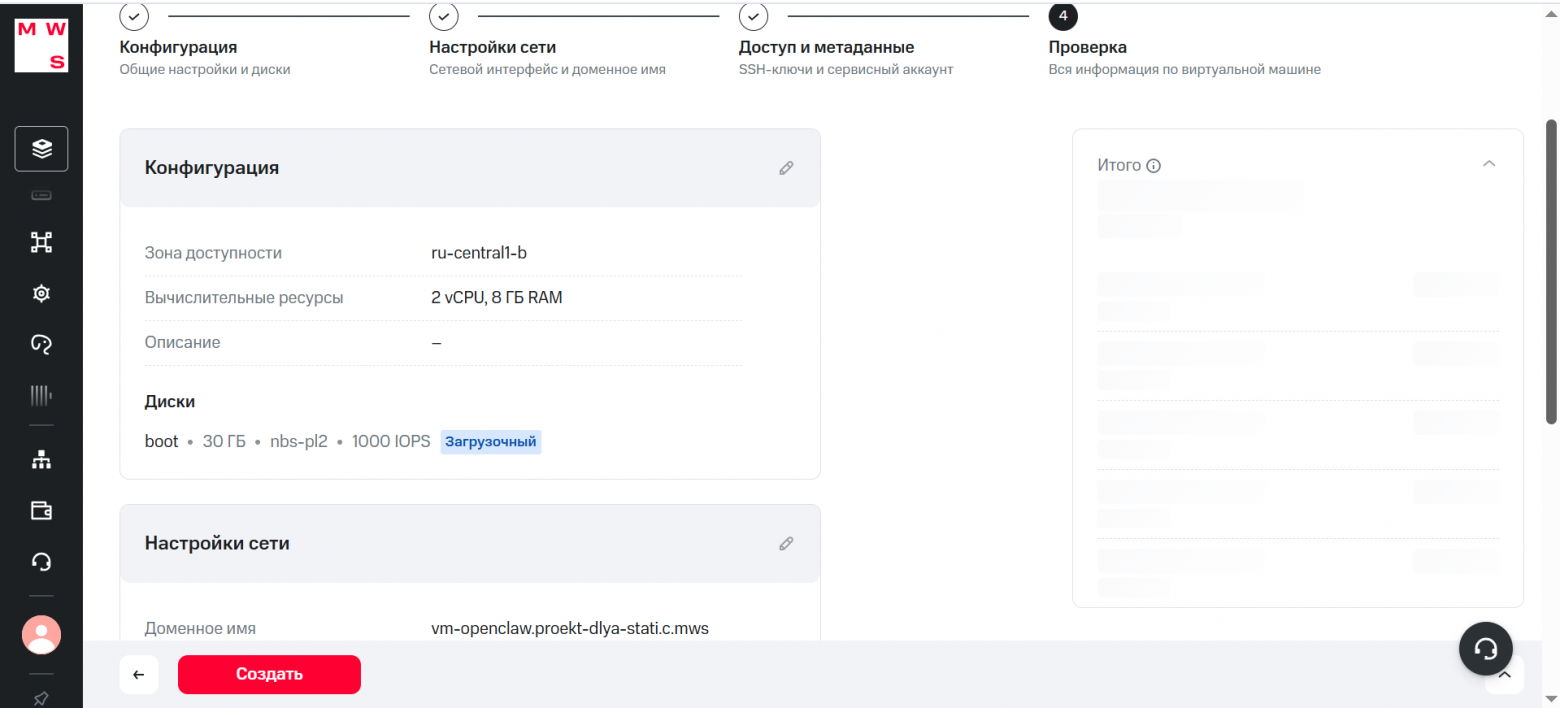

Проверяем, что всё указали корректно, и нажимаем «Создать».

Теперь нам нужно организовать доступ к LLM по API.

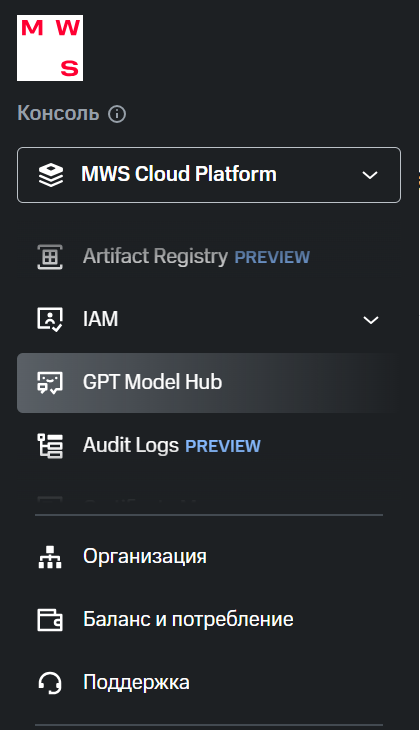

В консоли перейдём к сервису MWS GPT Model Hub. Сервис позволяет за несколько минут подключать LLM к своим продуктам и системам без управления инфраструктурой моделей (подробнее читайте здесь [4]). При первом запуске нажмите кнопку Активировать.

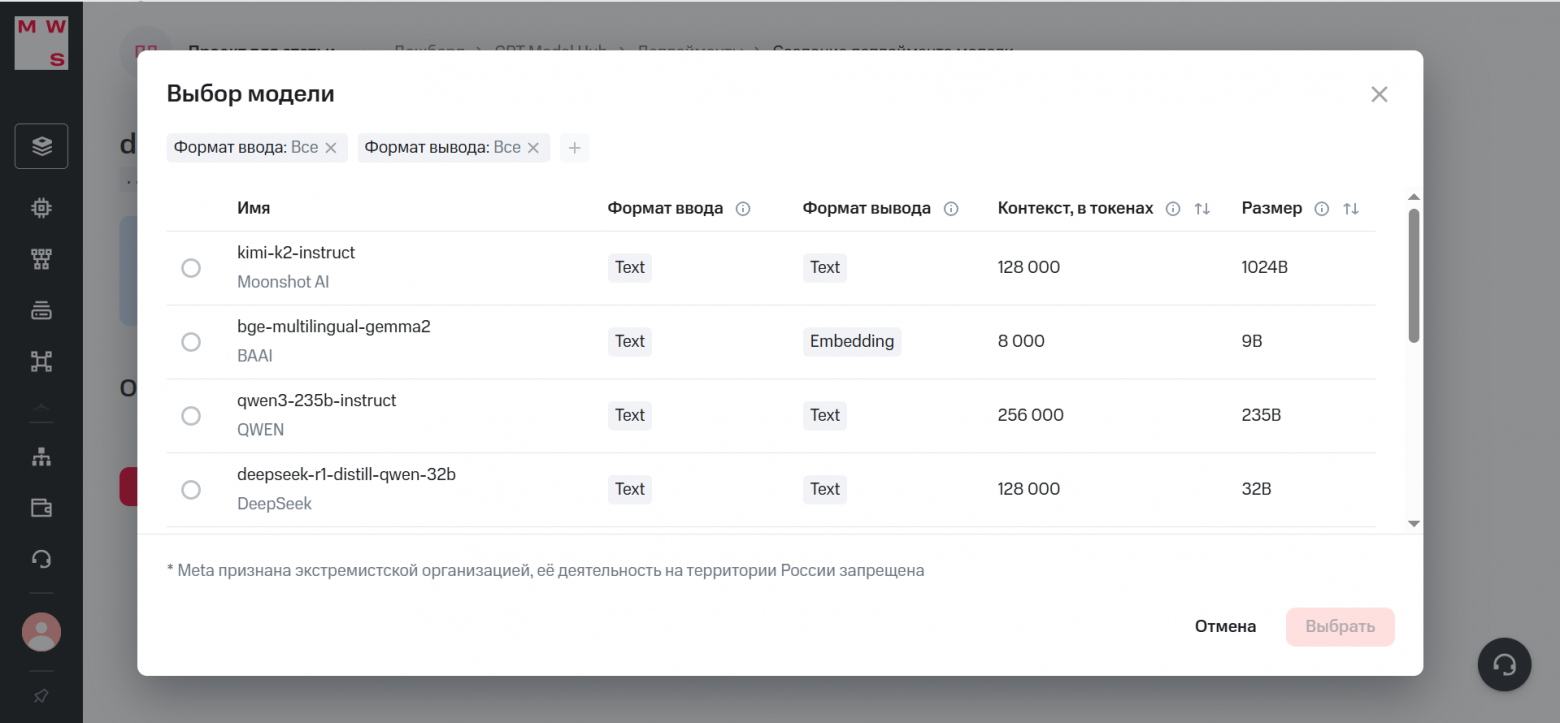

Нажимаем кнопку «Выбрать» и переходим к списку доступных моделей.

Выбираем модель и нажимаем «Создать». На следующем шаге нам предложат Создать сервисный аккаунт. Ссылка активна, переходим по ней.

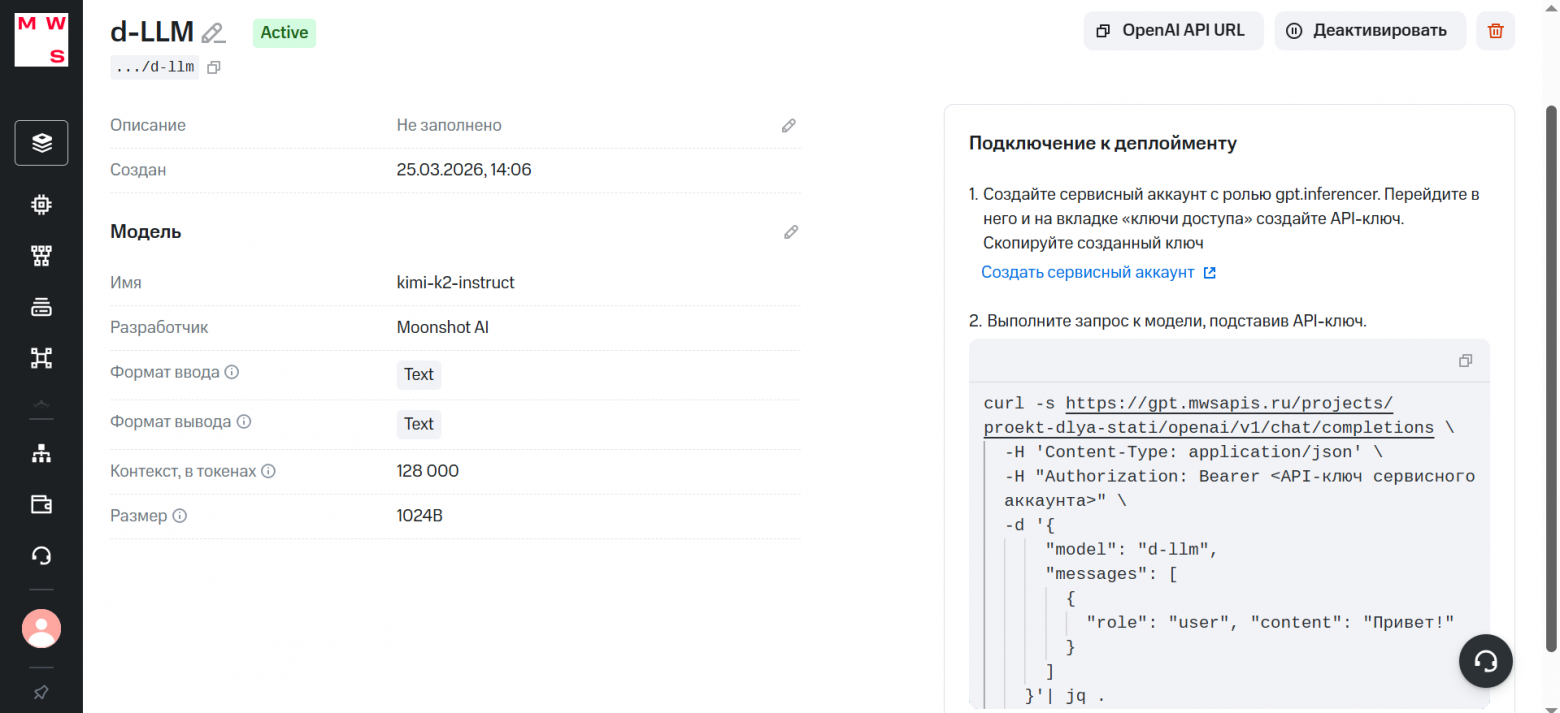

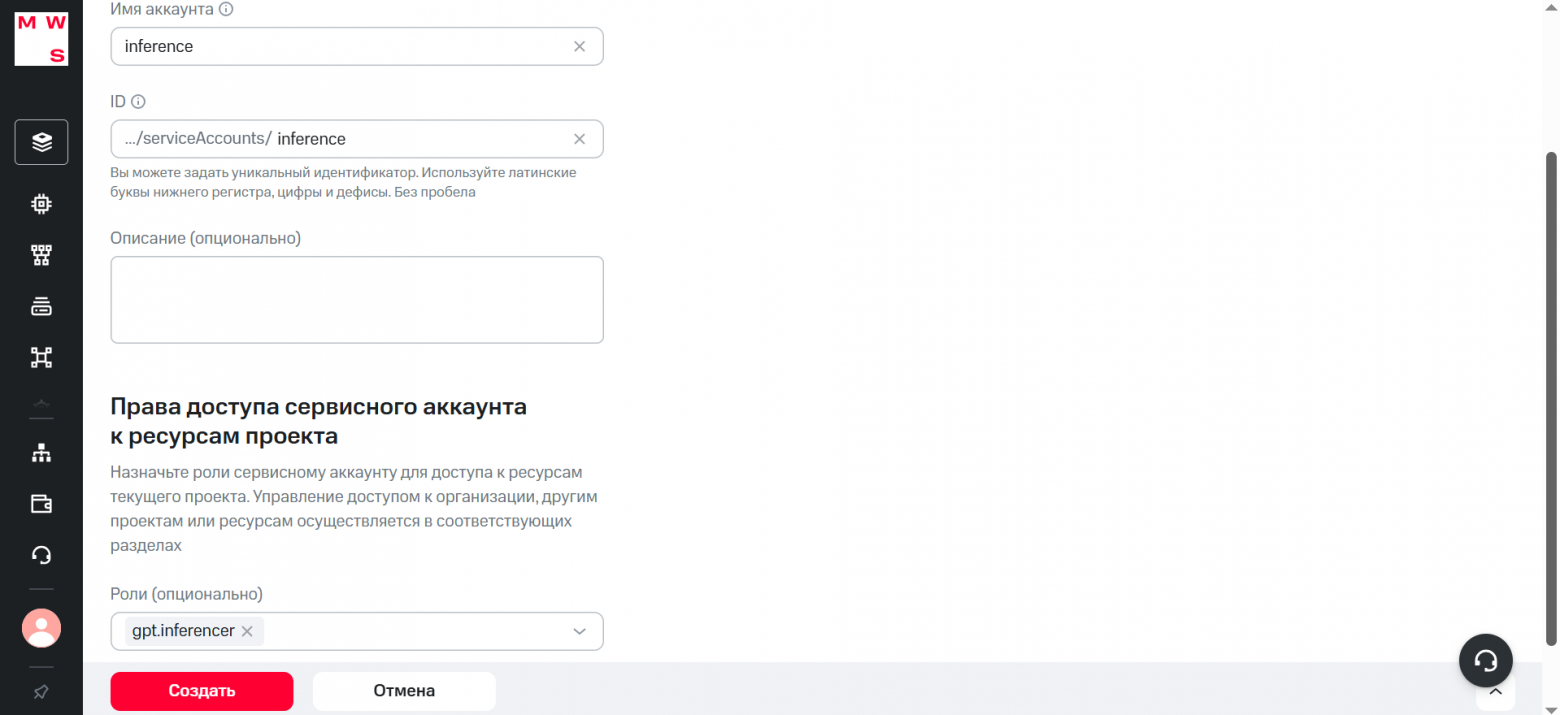

Создаём сервисный аккаунт с ролью gpt.inferencer. Так мы сможем выполнять запросы к модели и просматривать информацию о деплойментах.

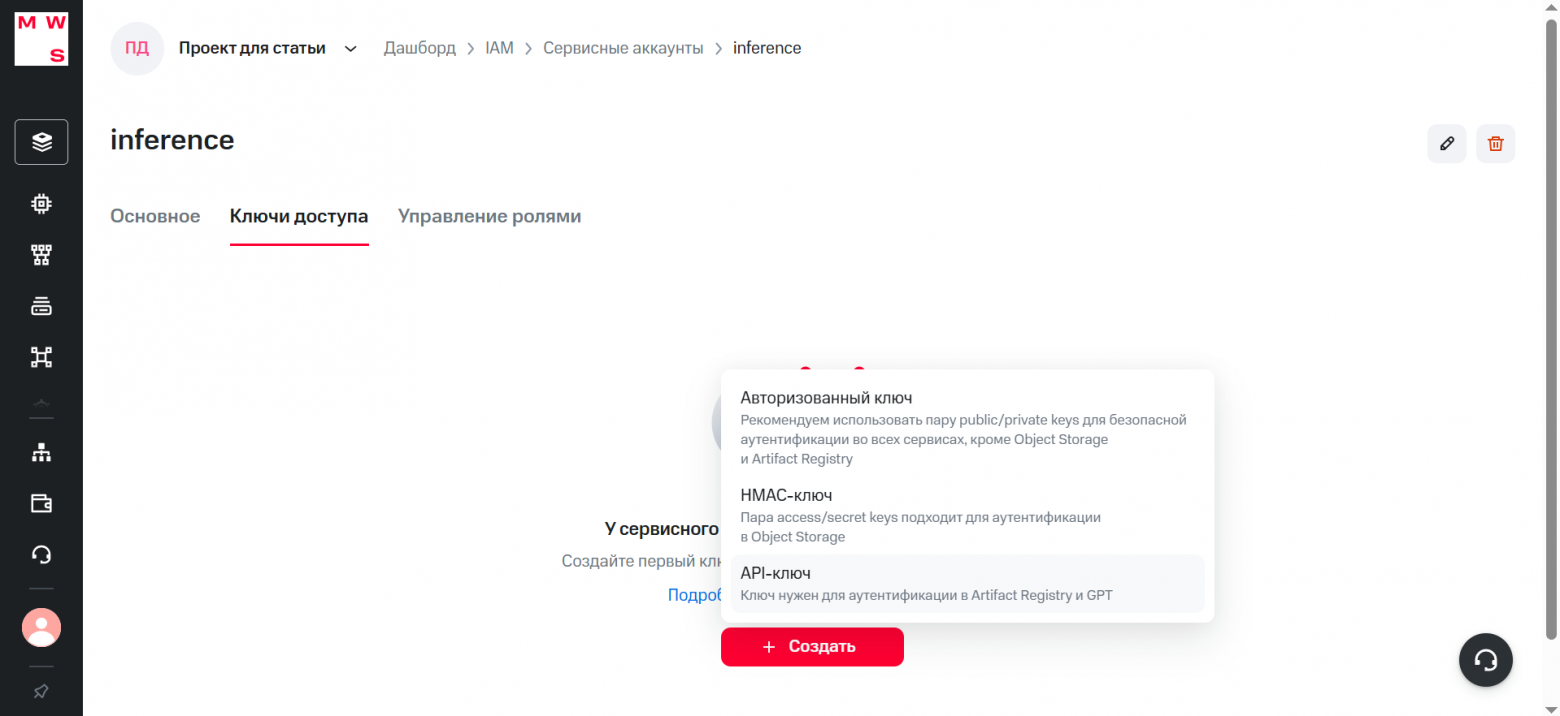

Переходим в сервисный аккаунт (IAM → Сервисные аккаунты → inference (пример)) и на вкладке «Ключи доступа» нажимаем «Создать», после чего выбираем вариант API-ключ.

OpenClaw позволяет подключать любой совместимый с OpenAI API. Для работы с нашим OpenAI API используется базовый URL https://gpt.mwsapis.ru/projects/<имя проекта>/openai/v1.

Вкалывают роботы, а не человек

Теперь, когда OpenClaw стал простым и безопасным, найдём ему применение.

В сети есть множество примеров в духе «OpenClaw, задеплой в прод вечером в пятницу 13-е». Но у нас в MWS под рукой оказался не самый умный робот Unitree G1, который умеет ходить, держать баланс, реагировать [6] на окружение и… собственно всё.

Команда MWS активно развивает VLA (Vision-Language-Action) модели, объединяющие зрение [7], язык, рассуждения и процессы совершения действий для прямого влияния на физический мир. Но от этого направления роботехники никто не ждёт быстрых результатов.

Сейчас гуманоидный робот управляется просто через физический пульт. Мы задались вопросом: а что, если дать управление с помощью этого пульта агенту на базе OpenClaw? Получится из железяки нечто похожее на искусственный интеллект [8]?

Мы обошлись без MCP-серверов и сложных промптов с цепочками рассуждений. Просто сделали программную прослойку, которая преобразует команды от OpenClaw в сигналы, понятные пульту. Код для управления роботом G1 через API можно посмотреть здесь [9].

Причём тут не требуется какое-то специализированное устройство. По тому же принципу можно подключить радиопульт, который управляет, например, игрушечной собакой.

Видеопоток с камеры робота передаётся в OpenClaw, а дальше мультимодальная модель kimi-2.5 интерпретирует происходящее: распознаёт объекты, оценивает ситуацию, определяет целесообразность действий.

«После этого Страшила почувствовал себя умным, стал рассудительным и вскоре был признан самым мудрым правителем Изумрудного города».

Как физически работает агент

Заключение

OpenClaw может работать не только с цифровыми сервисами – отправлять почту, совершать покупки и управлять файлами на компьютере. С минимальными усилиями ИИ-агент способен взаимодействовать и с физическими устройствами. Достаточно подключить API управления и видеопоток с камер, после чего система сможет интерпретировать происходящее и отправлять команды. Это не заменяет полноценную разработку VLA-систем, но открывает широкие возможности для быстрого создания прикладных сценариев, прототипирования и демонстрации технологий. Главное – теперь этот путь доступен любому разработчику с доступом к облачной платформе [3] и базовым пониманием API.

Кроме того, теперь можно подключать LLM к своим продуктам по клику как любой другой облачный сервис. До 15 июля мы снизили цены [4] в два раза на все модели.

Если у вас остались вопросы, посмотрите следующие материал из базы знаний:

-

Как загружать образ [10]

-

Как создавать ВМ [11]

Или оставьте комментарий к статье.

Автор: Snkurban

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/28899

URLs in this post:

[1] @Artem_Lykov: https://www.braintools.ru/users/Artem_Lykov

[2] сайте: https://openclaw.ai/

[3] MWS Cloud Platform: https://mws.ru/cloud-platform/?utm_source=habr.com&utm_medium=owned_media_openclawcloud&utm_content=article&utm_term=openclawcloud

[4] MWS GPT Model Hub: https://mws.ru/cloud-platform/model-hub/?utm_source=habr.com&utm_medium=owned_media_openclawgpt&utm_content=article&utm_term=openclawgpt

[5] консоль: https://console.mws.ru/?utm_source=habr.com&utm_medium=owned_media_openclawconsole&utm_content=article&utm_term=openclawconsole

[6] реагировать: http://www.braintools.ru/article/1549

[7] зрение: http://www.braintools.ru/article/6238

[8] интеллект: http://www.braintools.ru/article/7605

[9] здесь: https://github.com/MWS-Physical-AI/API-robot-control

[10] Как загружать образ: https://mws.ru/docs/cloud-platform/compute/general/images-upload.html#upload-to-compute/?utm_source=habr.com&utm_medium=owned_media_openclawbd&utm_content=article&utm_term=openclawbd

[11] Как создавать ВМ: https://mws.ru/docs/cloud-platform/compute/general/vm-create.html

[12] Как использовать GPT ModelHub: https://mws.ru/docs/cloud-platform/gpt/general/quickstart-gpt.html

[13] Источник: https://habr.com/ru/companies/ru_mts/articles/1018580/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1018580

Нажмите здесь для печати.