Нейросети для генерации музыки: ТОП-4 лучшие нейросети для песен, саундтреков и озвучки текста

Музыкальные нейросети в 2026 году уже неудобно обсуждать как один класс инструментов. Под одним названием сейчас скрываются очень разные системы:

-

одни нейросети создают песни [1] с вокалом по текстовому запросу;

-

другие лучше подходят для инструменталов, вариаций и каверов;

-

третьи вообще не пишут музыку, а решают соседнюю задачу — озвучивают текст, реплики и черновые голосовые партии.

Из-за этого вопрос «какая нейросеть лучше» почти всегда поставлен слишком широко. На практике важнее другое: что именно нужно сделать — демо песни, фон для ролика, музыкальный скетч, озвучку текста, тест аранжировки или рабочий API для продукта.

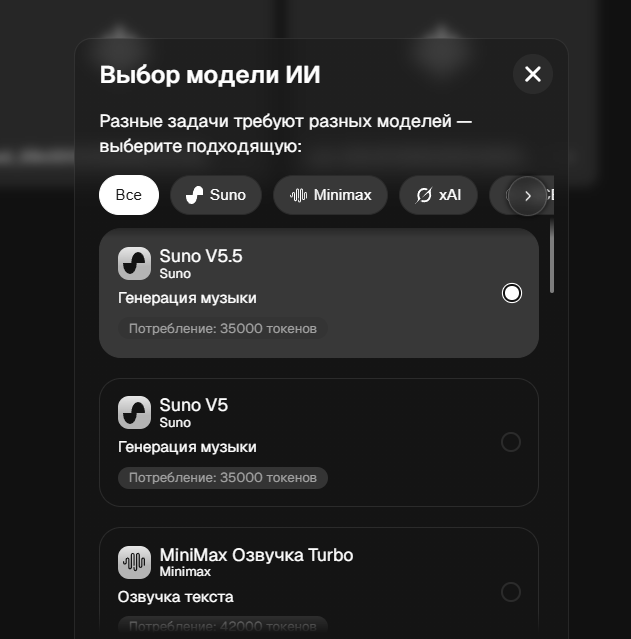

Лучшие ИИ для создания песен

-

Suno [2] — универсальный генератор песен с вокалом и аранжировкой. Создаёт полноценные треки по текстовому промту: куплеты, припевы, стили, жанры. Отличается качественным вокалом и продакшн‑уровнем звучания.

-

MiniMax [3] — лёгкая и быстрая музыкальная модель, хорошо подходящая для коротких мелодий, джинглов и фоновых треков. Делает простые, но чистые композиции, удобна для массового контента и интеграций.

-

ACE‑Step v1.5 Base [1] — продвинутая модель для генерации инструментальной музыки и саунд‑дизайна. Отличается вариативностью, сложными структурами и хорошей работой с ритмическими паттернами. Подходит для продюсеров и тех, кто работает со звуковыми концептами.

-

xAI Text‑to‑Speech [1] — модель для генерации вокала и голосовых партий. Не создаёт музыку сама по себе, но идеально дополняет другие музыкальные ИИ: озвучивает тексты, создаёт вокальные линии, имитирует стили исполнения.

Зачем вообще сравнивать музыкальные нейросети в 2026 году

Ещё недавно генерация музыки нейросетью выглядела как эффектное демо: написал пару строк, получил трек, удивился и пошёл дальше. В 2026 году ситуация другая. Эти инструменты всё чаще используют в прикладных задачах:

-

для черновиков песен;

-

для саундтреков в видео и играх;

-

для быстрой озвучки контента;

-

для музыкальных прототипов в продуктах;

-

для тестирования идей до ручной доработки в DAW.

Главное изменение не в том, что модели стали «умнее», а в том, что они начали закрывать разные этапы аудиопроизводства. Где-то нужен цельный результат за один проход. Где-то — управляемый генератор по API. Где-то — open-source модель, которую можно развернуть локально. А где-то — просто нормальный TTS, чтобы быстро озвучить текст без записи диктора.

Поэтому сравнивать их имеет смысл не по общему ощущению, а по вполне рабочим критериям.

На что смотреть при выборе

Качество генерации

Базовый вопрос: получается ли на выходе материал, с которым можно работать дальше. Для песенных моделей это значит:

-

внятная структура;

-

связная мелодия;

-

терпимый вокал;

-

отсутствие развала на середине трека.

Для инструментальных моделей важны другие вещи:

-

плотность аранжировки;

-

чистота звучания;

-

естественная динамика;

-

отсутствие ощущения бесконечной петли.

Контроль и вариативность

Хорошая музыкальная модель — это не только «умеет сделать красиво», но и «умеет сделать по-разному». Иначе после нескольких генераций начинает повторяться один и тот же шаблон.

Полезно смотреть, умеет ли система:

-

работать с текстом песни;

-

делать инструментал без вокала;

-

перестраивать материал по референсу;

-

генерировать несколько разных версий одной идеи;

-

удерживать длину и форму.

Работа с вокалом и речью

Вокал до сих пор остаётся самым сложным участком. Многие системы нормально собирают музыкальный фон, но хуже справляются с:

-

длинными фразами;

-

дикцией;

-

акцентами;

-

естественной подачей.

Если задача связана не с песней, а с озвучкой текста, стоит вообще смотреть не на music-модели, а на отдельные TTS-решения.

API, стоимость, лицензии

Для теста можно не думать о тарифах. Для реальной работы — уже нельзя.

Обычно имеет значение:

-

есть ли API;

-

понятна ли стоимость;

-

можно ли использовать результат коммерчески;

-

насколько удобно встроить модель в существующий процесс.

Нейросеть Suno

Нейросеть Suno [2] — один из самых заметных сервисов для генерации песен по текстовому описанию. Его обычно вспоминают первым, когда нужна не просто музыка, а именно готовый песенный скетч: с вокалом, настроением, жанром и более-менее понятной структурой.

Сильная сторона Suno в том, что это уже не только генерация «по промпту». Вокруг модели выстроен сервисный слой: редактирование, работа со stem-ами, загрузка своего аудио, добавление новых вокальных или инструментальных элементов. То есть это инструмент не только для первого результата, но и для последующей доработки.

Для обычного пользователя Suno удобен тем, что снижает порог входа. Не нужно собирать пайплайн из нескольких сервисов: написал идею, получил трек, потом при необходимости доработал его внутри той же среды.

Сильные стороны

У Suno хорошо получается то, что многим и нужно от музыкальной нейросети: быстро собрать песню из идеи. Когда задача звучит как «мне нужен трек с вокалом и настроением уже сейчас», сервис попадает в правильный сценарий.

Что у него особенно полезно:

-

быстрый старт без сложной подготовки;

-

акцент на песни, а не только на инструменталы;

-

возможность работать со stem-ами;

-

удобство для тех, кто мыслит текстом и образом, а не MIDI и аранжировкой.

Suno хорош для ситуаций, где важна скорость перебора. Например, нужно не одну песню, а пять вариантов одной идеи с разным настроением — для ролика, презентации, концепта или демо.

Слабые стороны

Главное ограничение Suno — высокий уровень абстракции. Он помогает быстро дойти до результата, но не всегда даёт тот уровень детального контроля, который нужен продюсеру или аранжировщику.

На что стоит обратить внимание [5]:

-

часть решений система принимает за пользователя;

-

при сложных задачах всё равно нужна ручная доработка;

-

возможна стилистическая усреднённость;

-

коммерческое использование зависит от тарифного режима.

То есть Suno удобен как быстрый генератор песенного черновика, но не всегда как финальная среда для точной музыкальной работы.

Кому подходит

Suno обычно хорошо заходит таким пользователям:

-

музыкантам, которым нужен быстрый черновик песни;

-

контент-мейкерам, которым нужен трек под ролик;

-

редакциям и маркетинговым командам, где музыку делают не профильные саунд-продюсеры;

-

небольшим студиям, которым важно быстро тестировать идеи.

Если нужен простой интерфейс и быстрый понятный результат, Suno остаётся одной из самых практичных точек входа.

Примеры задач

-

Собрать несколько версий поп-трека для короткого рекламного ролика.

-

Быстро превратить текст и идею в песенное демо.

-

Сгенерировать трек, а потом вытащить отдельные stem-дорожки для монтажа и доработки.

Нейросеть MiniMax

Нейросеть MiniMax [3] интересен прежде всего не как «ещё один генератор музыки», а как музыкальная модель с API-логикой. Это важно: сервис ориентирован не только на пользователя, который кликает в веб-интерфейсе, но и на команды, которые хотят встроить генерацию музыки в свои продукты и процессы.

У MiniMax есть сценарии text-to-music и cover-режимы, где можно работать не только с описанием с нуля, но и с референсным аудио. Это уже ближе к прикладной продюсерской задаче: не сочинить всё заново, а перестроить, адаптировать, получить новую версию на основе исходника.

За счёт этого MiniMax выглядит сильнее там, где музыка — не разовая генерация, а часть более широкой системы.

Сильные стороны

Основной плюс MiniMax — интеграционность. Если вам важен не только результат, но и возможность автоматизировать процесс, API становится серьёзным аргументом.

Что у MiniMax особенно полезно:

-

API для музыкальной генерации;

-

работа с lyrics и инструментальными режимами;

-

возможность использовать референс или cover-сценарий;

-

более удобная роль в продуктовом пайплайне.

Это хороший вариант, когда нужно не просто «сделать музыку», а встроить генерацию в приложение, сервис, платформу с пользовательским контентом или внутренний рабочий контур.

Слабые стороны

MiniMax выглядит чуть менее дружелюбно для пользователя, который хочет получить музыку без лишней технической рамки. Его сила — в программируемости, а не в самой мягкой посадке для новичка.

Ограничения в таком случае типичные:

-

выше ценность для разработчиков, чем для массового пользователя;

-

качество результата сильнее зависит от правильной постановки задачи;

-

в сложных песенных кейсах всё равно может понадобиться внешняя доработка;

-

тарифы и лимиты приходится считать уже как часть продукта, а не просто как подписку.

Иначе говоря, это хороший мотор, но не всегда самый простой инструмент «на один клик».

Кому подходит

MiniMax логичнее всего рассматривать для таких задач:

-

разработчики аудиосервисов;

-

продуктовые команды;

-

саунд-дизайнеры, которым важны вариации и работа с референсом;

-

контент-платформы, где генерация музыки должна быть автоматизирована.

Для одиночного автора он тоже может пригодиться, но его сильная сторона всё же раскрывается тогда, когда музыка — часть повторяемого процесса.

Примеры задач

-

Встроить генерацию фоновой музыки в приложение через API.

-

Взять исходный трек и сделать несколько stylistic cover-вариантов.

-

Генерировать разные музыкальные версии под одну и ту же сцену или ролик в автоматическом режиме.

Нейросеть ACE-Step v1.5 Base

Модель ACE-Step v1.5 Base [1] — заметный open-source проект в музыкальной генерации. В отличие от закрытых сервисов, он интересен тем, что его можно использовать как локальную, настраиваемую основу для собственных решений.

Такие модели важны не только качеством генерации, но и архитектурной свободой. Если команда не хочет строить рабочий процесс вокруг внешнего SaaS, open-source становится вполне рациональным выбором.

ACE-Step примечателен тем, что его обсуждают не только как text-to-music модель, но и как основу для более широких операций с аудио: cover-сценариев, фрагментарной доработки, экспериментов с модификацией музыкального материала.

Сильные стороны

Главный плюс ACE-Step — открытость. Это сразу меняет сценарии применения.

Что даёт open-source подход:

-

можно развернуть модель локально;

-

проще встроить в собственный стек;

-

нет жёсткой привязки к внешнему интерфейсу;

-

можно строить поверх модели свой сервисный слой.

Для студий, исследовательских команд и технических стартапов это очень сильная позиция. Не потому что open-source автоматически лучше, а потому что он даёт контроль там, где закрытые платформы предлагают только готовый продукт по своим правилам.

Слабые стороны

Open-source почти всегда означает одно и то же: больше свободы, но и больше самостоятельной работы. И ACE-Step здесь не исключение.

Практические ограничения выглядят так:

-

нужен технический ресурс на развёртывание и поддержку;

-

пользовательский опыт [6] надо либо терпеть, либо собирать самостоятельно;

-

между «модель работает» и «это удобно использовать в продакшене» есть большая дистанция;

-

вопросы лицензирования и использования всё равно нужно разбирать отдельно, даже если код открыт.

То есть для конечного пользователя без технической команды это далеко не всегда самый удобный путь.

Кому подходит

ACE-Step разумно рассматривать, если вы:

-

разработчик, который строит продукт вокруг генерации музыки;

-

исследовательская команда;

-

саунд-дизайнер с техническим стеком;

-

студия, которой нужен локальный контроль и независимость от внешних платформ.

Если задача — просто быстро сделать трек, это не самый очевидный вариант. Если задача — управлять инструментом на уровне инфраструктуры, тогда наоборот.

Примеры задач

-

Поднять локальный движок генерации музыки внутри своей студии.

-

Построить собственный интерфейс поверх open-source модели.

-

Использовать модель для экспериментов с cover-сценариями и музыкальными трансформациями.

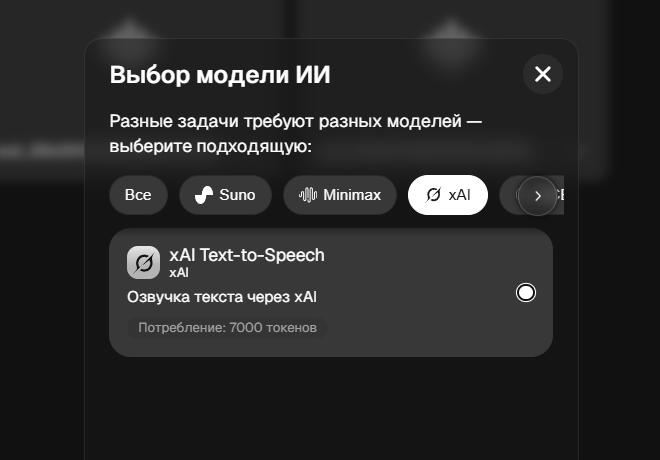

xAI Text-to-Speech

Модель xAI Text-to-Speech [1] не пишет музыку в обычном смысле, но в этом обзоре он на своём месте. Причина простая: в реальных аудиопроектах часто нужна не только музыка, но и озвучка — дикторский текст, голосовые вставки, реплики персонажей, narrated-слои, черновой voiceover.

Именно такие задачи и закрывает TTS. Это уже не про песню как композицию, а про речевой слой рядом с музыкой.

Поэтому xAI TTS стоит рассматривать не как конкурента Suno или MiniMax, а как соседний инструмент в том же аудиопайплайне.

Сильные стороны

У xAI TTS чёткая специализация: качественно озвучивать текст. И в этом смысле узкая направленность — скорее плюс, чем минус.

Где он особенно уместен:

-

озвучка статей, сценариев, инструкций;

-

voiceover для видео;

-

реплики для игр и приложений;

-

временные голосовые дорожки до записи живого актёра;

-

тестирование речевого интерфейса в продукте.

Когда нужна речь, а не песня, отдельная TTS-модель обычно полезнее, чем музыкальный генератор, который пытается делать всё сразу.

Слабые стороны

Ограничение здесь одно, но принципиальное: это не музыкальная модель. Она не заменяет генератор песен, не строит полноценную композицию и не решает задачу вокала в музыкальном смысле.

Из этого следуют понятные выводы:

-

xAI TTS не стоит выбирать, если нужен трек с мелодией и аранжировкой;

-

expressive speech — это не то же самое, что пение;

-

в музыкальных задачах он работает скорее как дополнительный модуль.

То есть это хороший инструмент рядом с музыкой, но не вместо неё.

Кому подходит

xAI Text-to-Speech полезен для:

-

разработчиков голосовых приложений;

-

авторов видео и подкастов;

-

команд e-learning и медиа;

-

саунд-дизайнеров, которым нужен речевой слой;

-

продуктов с голосовыми персонажами или репликами.

Если задача связана с озвучкой текста, а не с написанием песни, это уже более точное попадание в цель, чем музыкальные генераторы.

Примеры задач

-

Озвучить текст статьи или сценария ролика без записи диктора.

-

Добавить речевые вставки поверх музыкального фона.

-

Сделать временные реплики персонажей для игры или приложения.

FAQ

Можно ли сейчас делать коммерческую музыку нейросетями?

Да, но только если внимательно смотреть на лицензии и условия конкретного сервиса. У разных платформ правила отличаются, особенно между бесплатными и платными тарифами.

Что выбрать для песни с вокалом?

Если нужен быстрый результат без сложной настройки, логичнее смотреть в сторону инструментов уровня Suno. Если важнее интеграция и API-сценарии, полезнее может оказаться MiniMax.

Есть ли смысл брать open-source модель?

Есть, если важны локальный запуск, гибкость и независимость от внешнего сервиса. Если нужен просто удобный интерфейс без технической сборки, open-source не всегда будет самым комфортным вариантом.

Можно ли использовать TTS вместо вокальной модели?

Для озвучки — да. Для полноценного музыкального вокала — скорее нет. Это разные задачи, даже если на слух [7] граница иногда кажется близкой.

Почему сейчас часто используют сразу несколько моделей?

Потому что одна лучше делает песню, другая — вариации, третья — озвучку. Такой набор обычно практичнее, чем попытка закрыть весь аудиопроцесс одним инструментом.

Какой вывод полезнее всего в 2026 году

Самый практичный вывод сейчас звучит довольно просто: не стоит искать одну модель на все случаи. Музыкальные нейросети уже достаточно разные, чтобы использовать их по ролям.

Чаще всего разумная схема выглядит так:

-

Suno — когда нужен быстрый песенный черновик с вокалом;

-

MiniMax — когда важны API, автоматизация и работа с референсом;

-

ACE-Step v1.5 Base — когда нужен open-source и локальный контроль;

-

xAI Text-to-Speech — когда нужна не музыка, а качественная озвучка текста.

Именно поэтому в 2026 году всё чаще работает не выбор одной «главной» модели, а комбинация нескольких:

-

одна делает мелодию или песню;

-

вторая — перестраивает материал;

-

третья — добавляет озвучку;

-

финальная доработка уходит в DAW или во внешний сервисный слой.

Для платформ и агрегаторов это особенно заметно: пользователю обычно важнее не название модели, а то, насколько удобно она встроена в сценарий работы. В этом смысле сервисы вроде Ranvik интересны как раз тем, что снимают часть технической нагрузки и сводят разные классы аудиоинструментов в один понятный пользовательский поток.

Автор: VisionSoul

Источник [8]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29038

URLs in this post:

[1] нейросети создают песни: https://ranvik.ru/audio

[2] Suno: https://ranvik.ru/suno

[3] MiniMax: https://ranvik.ru/minimax

[4] Промпты для музыки и аудио ИИ: https://ranvik.ru/feed/music-prompts

[5] внимание: http://www.braintools.ru/article/7595

[6] опыт: http://www.braintools.ru/article/6952

[7] слух: http://www.braintools.ru/article/6251

[8] Источник: https://habr.com/ru/companies/ranvik/articles/1025086/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1025086

Нажмите здесь для печати.