Разворачиваем RAG на Java без боли: практический гайд

Всем привет! Недавно столкнулся с проблемой, что в настоящее время большая часть обучающих материалов по Retrieval‑Augmented Generation (RAG) сосредоточена на Python‑экосистеме (LangChain, LlamaIndex и тому подобное), а пошаговые руководства, которые показывают, как быстро собрать рабочее RAG‑приложение на чистом Java‑стеке, встречаются крайне редко. Эта статья представляет собой простое практическое руководство, где мы разберём весь процесс от настройки окружения до полного примера кода, чтобы даже начинающий Java‑разработчик мог развернуть RAG.

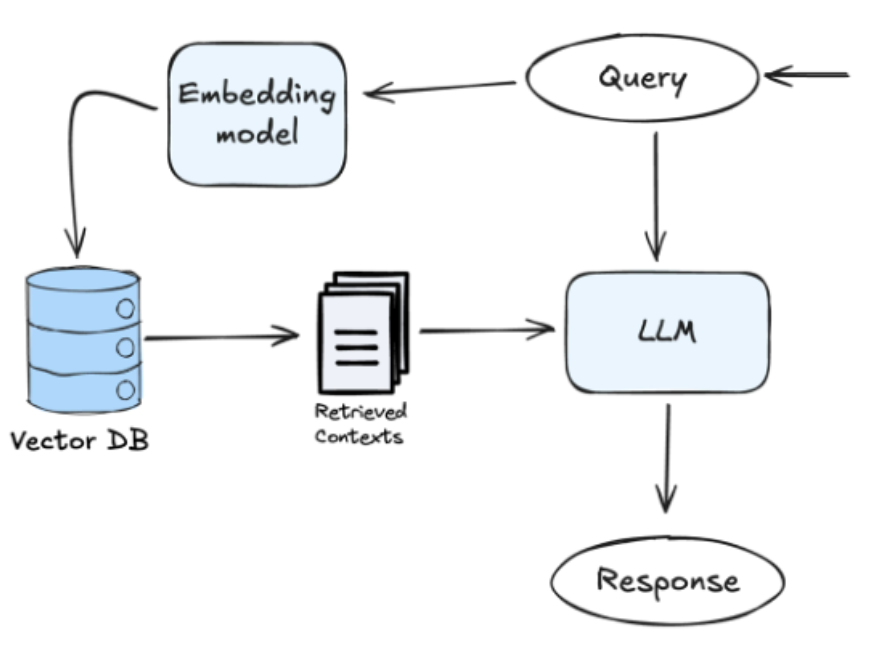

Архитектура RAG

Архитектуру тут можно представить как простую цепочку: пользователь стучится в REST‑endpoint на Spring Boot, запрос попадает в Spring AI, который векторизует его (Embedding model) и идёт в Qdrant (Vector DB) за релевантными кусками текста, а уже потом подмешивает их в промпт к локальной модели через Ollama.

Подготовка окружения

В этом гайде у нас три главных героя на стороне бэкенда: Spring Boot (Spring AI), векторное хранилище Qdrant и LLM через Ollama. Чтобы всё это заработало как единая RAG‑машина, нам нужно лишь аккуратно подтянуть нужные зависимость, поднять в docker векторную базу и настроить пару YAML конфигураций. Приступим к пошаговому руководству:

Шаг 1. Поднимаем Qdrant в Docker

Для RAG нам нужно отдельное векторное хранилище, куда будут складываться эмбеддинги документов. В этой роли отлично выступает Qdrant: он умеет быстрый ANN‑поиск, поддерживает gRPC и HTTP и хорошо интегрируется со Spring AI. Чтобы не возиться с установкой вручную, поднимем Qdrant в Docker‑контейнере.

services:

qdrant:

image: qdrant/qdrant:latest

container_name: qdrant

ports:

- "6333:6333"

- "6334:6334"

environment:

QDRANT__SERVICE__API_KEY: "your_secret_api_key_here"

configs:

- source: qdrant_config

target: /qdrant/config/production.yaml

volumes:

- ./qdrant_storage:/qdrant/storage:zЧто здесь происходит:

-

Пробрасываем порты 6333 (HTTP) и 6334 (gRPC) на хост — Spring AI по умолчанию общается с Qdrant по gRPC.

-

Включаем API‑ключ через

QDRANT__SERVICE__API_KEY, чтобы к векторному хранилищу нельзя было просто так достучаться извне. -

Монтируем

./qdrant_storageво внутреннюю директорию хранения Qdrant, чтобы коллекции и эмбеддинги не пропадали после перезапуска контейнера.

Шаг 2. Добавляем зависимости в Spring Boot

Теперь необходимые зависимости для Java Spring Boot приложения. Подключим к проекту Spring AI и стартеры для Ollama и Qdrant. Для Gradle (build.gradle.kts) это выглядит примерно так:

dependencies {

// spring boot

implementation("org.springframework.boot:spring-boot-starter")

implementation("org.springframework.boot:spring-boot-starter-web")

// qdrant

implementation("org.springframework.ai:spring-ai-starter-vector-store-qdrant")

// ollama

implementation("org.springframework.ai:spring-ai-starter-model-ollama")

}Здесь:

-

spring-boot-starter-webдаёт нам классический REST‑каркас на Spring Boot. -

spring-ai-ollama-spring-boot-starter— интеграция с локальной LLM через Ollama. -

spring-ai-qdrant-spring-boot-starter— готовый VectorStore поверх Qdrant и автоконфигурация подключения.

Шаг 3. Настраиваем application.yml

И наконец можем перейти к application.yaml конфигурации, добавьте блок ai к вашему конфигу:

spring:

application:

name: springboot-rag-demo

ai:

ollama:

base-url: http://localhost:11434

chat:

options:

model: llama3:8b

temperature: 0.0

num-ctx: 4096

embedding:

options:

model: bge-m3

request-timeout: 120s

vectorstore:

qdrant:

url: http://localhost:6333

collection-name: collection

embedding-model: ollama

api-key: "your_secret_api_key_here"

use-tls: false

initialize-schema: trueКлючевые моменты:

-

ollama.base-urlуказывает на локальный Ollama, который по умолчанию слушает порт 11434. -

В

chat.modelвыбираем конкретный тег Llama, напримерllama3:8b– это хороший компромисс между качеством и требованиями к железу. -

В

embedding.modelуказываем модель для построения эмбеддингов документов – в примере этоbge-m3, один из популярных вариантов для RAG‑сценариев. -

В блоке

vectorstore.qdrantпрописываем URL HTTP‑API (порт 6333), имя коллекции и тот же API‑ключ, который задавали вdocker-compose

С таким YAML Spring Boot при старте поднимет автосконфигурированный клиент для Ollama и VectorStore для Qdrant, и дальше в коде можно будет просто инжектить готовые бины.

Пример простой полноценной реализации на Java

Для примера использования напишем простейший универсальный контроллер, который позволяет сохранять документы и задавать вопросы, получая ответы, которые опираются на загруженные документы.

@RestController

@RequestMapping("/api/rag")

public class RagController {

private final RagService ragService;

private final DocumentIndexingService documentService;

public RagController(RagService ragService,

DocumentIndexingService documentService) {

this.ragService = ragService;

this.documentService = documentService;

}

@GetMapping("/ask")

public String ask(@RequestParam String question) {

return ragService.ask(question);

}

@PostMapping("/documents")

public String saveDocument(@RequestBody String content) {

documentIndexingService.saveDocument(content);

return "Документ успешно сохранён в Qdrant";

}

}Сделаем RAG сервис под него, используя готовые клиенты для Qdrant и Ollama, который должен отвечать на вопросы, опираясь на данные из векторной базы Qdrant.

package com.example.rag.service;

import java.util.List;

import org.springframework.ai.chat.client.ChatClient;

import org.springframework.ai.document.Document;

import org.springframework.ai.vectorstore.SearchRequest;

import org.springframework.ai.vectorstore.VectorStore;

import org.springframework.stereotype.Service;

@Service

public class RagService {

private final VectorStore vectorStore;

private final ChatClient chatClient;

public RagService(VectorStore vectorStore, ChatClient.Builder chatClientBuilder) {

this.vectorStore = vectorStore;

this.chatClient = chatClientBuilder.build();

}

public String ask(String question) {

List<Document> documents = vectorStore.similaritySearch(

SearchRequest.builder()

.query(question)

.topK(4)

.build()

);

String context = documents.stream()

.map(Document::getText)

.reduce("", (a, b) -> a + "nn" + b);

return chatClient.prompt()

.system("""

Ты помощник, который отвечает только на основе переданного контекста.

Если в контексте нет ответа, честно скажи об этом.

""")

.user("""

Контекст:

%s

Вопрос:

%s

""".formatted(context, question))

.call()

.content();

}

}Так как данных в Qdrant пока нет, нужно дописать сервис индексации и сохранения документов, который также очень просто интегрируется с помощью Spring AI.

package com.example.rag.service;

import java.util.List;

import java.util.Map;

import org.springframework.ai.document.Document;

import org.springframework.ai.vectorstore.VectorStore;

import org.springframework.stereotype.Service;

@Service

public class DocumentIndexingService {

private final VectorStore vectorStore;

public DocumentIndexingService(VectorStore vectorStore) {

this.vectorStore = vectorStore;

}

public void saveDocument(String content) {

Document document = new Document(content);

vectorStore.add(List.of(document));

}

public void saveDocument(String content, Map<String, Object> metadata) {

Document document = new Document(content, metadata);

vectorStore.add(List.of(document));

}

public void saveDocuments(List<String> contents) {

List<Document> documents = contents.stream()

.map(Document::new)

.toList();

vectorStore.add(documents);

}

}Завершение

Мы собрали локальный RAG‑сервис на Java: Spring Boot даёт REST‑API, Spring AI управляет моделями, Qdrant хранит эмбеддинги, а Ollama крутит Llama прямо на машине. По пути мы настроили окружение и docker-compose, прописали конфиг в application.yml, добавили сервисы загрузки документов и поиска, контроллер /api/rag/ask. Этот скелет уже можно превращать во внутреннего ассистента: менять модели, выносить Qdrant в прод и навешивать UI. Если будете собирать свою версию, то эту простую реализацию можно взять за основу и допилить под свои нужды.

Автор: dimkanl

Источник [1]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29316

URLs in this post:

[1] Источник: https://habr.com/ru/articles/1027426/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1027426

Нажмите здесь для печати.