Нейросеть для аудио: Топ-4 нейросетей для генерации аудио

Аудиомодели за последние пару лет заметно разошлись в разные стороны.

Под одним и тем же термином «генерация аудио [1]» сейчас скрываются как минимум два разных класса задач:

-

генерация музыки — когда модель собирает трек, аранжировку, вокал и структуру композиции;

-

синтез речи — когда система превращает текст в голос с нужной интонацией, тембром и паузами.

Из-за этого сравнивать все аудиомодели в одной плоскости уже не очень корректно.

Одни лучше подходят для музыкальных черновиков и демо, другие — для озвучки, голосовых интерфейсов и речевых агентов.

В этом разборе — четыре заметных решения:

-

Suno

-

MiniMax

-

ACE-Step v1.5 Base

-

xAI Text-to-Speech

Без попытки выбрать «лучшее». Только различия в подходах, характере синтеза и типовых сценариях.

Почему аудиомодели стали востребованы

Рост интереса [2] к аудиогенерации связан сразу с несколькими факторами:

-

стало проще запускать модели, работающие не только с короткими фрагментами, но и с длинными последовательностями;

-

улучшился контроль над интонацией, структурой и стилем;

-

генерация аудио стала частью прикладных пайплайнов, а не только исследовательским экспериментом;

-

появились модели, которые умеют не просто синтезировать звук, а редактировать его по частям.

Практически это дало несколько рабочих сценариев:

-

быстрые музыкальные идеи и демо;

-

озвучка интерфейсов и сервисов;

-

черновая дикторская дорожка;

-

голосовые агенты;

-

локальное прототипирование аудиопродуктов.

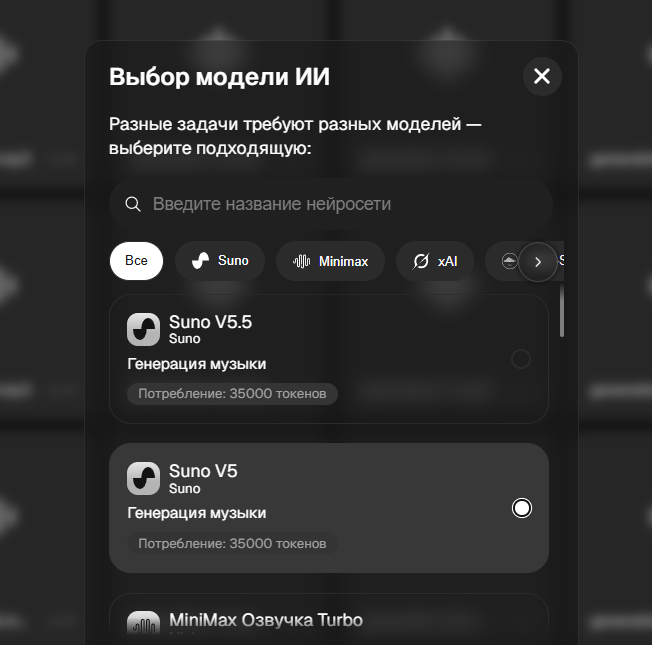

1. Suno

Нейросеть Suno [3] — модель и продуктовый пайплайн для генерации музыки по текстовому описанию.

Ее основная задача — собрать цельный музыкальный результат, а не просто озвучить текст.

Обычно речь идет о генерации:

-

инструментала;

-

вокальной партии;

-

общей структуры трека;

-

переходов между секциями;

-

музыкального настроения и жанровой рамки.

Подход к генерации

Suno работает как система, которая синтезирует песню целиком:

-

текст;

-

вокальную подачу;

-

музыкальную основу;

-

форму композиции.

Это важное отличие от обычного TTS.

На выходе получается не голосовая дорожка, а уже музыкальный объект с вокалом и аранжировкой.

Как звучит

Для Suno характерен результат, близкий к готовому демо трека:

-

есть ощущение завершенности формы;

-

вокал встроен в музыку, а не существует отдельно от нее;

-

трек часто воспринимается как черновая финальная версия, а не как набор отдельных stem-дорожек.

Где уместна

Suno подходит для задач, где нужно быстро проверить музыкальную идею:

-

набросать песню по описанию;

-

протестировать текст песни;

-

получить музыкальный референс;

-

собрать быстрый черновик трека;

-

посмотреть, как lyric ложится в куплетно-припевную структуру.

Ограничения

У такого подхода есть понятные ограничения:

-

результат сильно зависит от точности промпта для аудио ИИ [4];

-

длинные композиции часто требуют доработки секций;

-

трудно добиться полностью воспроизводимого результата между генерациями;

-

модель ориентирована на цельный трек, а не на детальный контроль каждой отдельной партии.

2. MiniMax

Нейросеть MiniMax [5] — это уже не музыкальный генератор, а стек речевых моделей с фокусом на синтез речи, стабильность длинной подачи и контроль голоса.

Здесь центральная задача другая: не собрать песню, а произнести текст предсказуемо и устойчиво.

Подход к генерации

MiniMax делает ставку на несколько вещей:

-

стабильный тембр;

-

удержание интонации на длинных фрагментах;

-

поддержку длинных текстов;

-

voice cloning;

-

мультиязычность;

-

потоковый и асинхронный режимы работы.

Если у музыкальных моделей основная единица — это трек, то у MiniMax — речевая последовательность, которую нужно произнести без сбоев по темпу и просодии.

Как звучит

По характеру синтеза MiniMax ближе к дикторской речи:

-

ритм более контролируемый;

-

паузы можно задавать явнее;

-

интонация ведет себя стабильнее на длинных кусках текста;

-

голос меньше «плавает» между фразами.

Это делает модель удобной не для музыкальных задач, а для речевых сценариев.

Где уместна

Типовые сценарии для MiniMax:

-

озвучка длинных текстов;

-

narration;

-

черновой дубляж;

-

голосовые интерфейсы;

-

сервисная озвучка;

-

голосовые ассистенты;

-

генерация реплик с контролем темпа и пауз.

Ограничения

Чтобы получить хороший результат, текст обычно приходится готовить:

-

разбивать на логические блоки;

-

размечать паузы;

-

учитывать длину реплик;

-

иногда дополнительно управлять выразительностью через специальные теги.

То есть MiniMax — это не «вставил текст и всегда получил идеальную речь», а скорее инструмент, который дает устойчивый результат при аккуратной разметке входа.

3. ACE-Step v1.5 Base

ACE-Step v1.5 Base [1] — открытая музыкальная foundation-модель, ориентированная не только на text-to-music, но и на более широкий набор задач вокруг музыкального синтеза и редактирования.

Это уже скорее инженерный инструмент, чем просто готовый пользовательский сервис.

Подход к генерации

У ACE-Step интересная архитектурная идея:

-

Language Model выступает как планировщик композиции;

-

Diffusion Transformer синтезирует уже само аудио.

То есть модель сначала формирует более абстрактный музыкальный план, а затем превращает его в звук.

Такой подход отличается от более «монолитной» генерации тем, что между текстовым запросом и аудиовыходом появляется промежуточный уровень музыкального планирования.

Что умеет

ACE-Step применяется не только для прямой генерации музыки, но и для связанных задач:

-

text-to-music;

-

cover;

-

inpainting / repaint;

-

completion;

-

извлечение и переработка аудиофрагментов;

-

эксперименты с кастомизацией и дообучением.

Как звучит

У базовой версии характер синтеза можно описать так:

-

больше вариативности;

-

меньше ощущения «отполированного финального результата»;

-

выше ценность как у платформы для экспериментов;

-

лучше подходит для исследовательских и инженерных сценариев, чем для кнопки «сделай готовый трек».

Где уместна

ACE-Step особенно полезна там, где нужен контроль над стеком:

-

локальный запуск;

-

интеграция в собственный пайплайн;

-

музыкальное прототипирование;

-

исследовательские задачи;

-

дообучение под свою доменную специфику;

-

разработка инструментов для редактирования музыки.

Ограничения

Открытая модель дает гибкость, но требует больше технической работы:

-

нужно подбирать режим инференса;

-

качество зависит от конфигурации пайплайна;

-

базовая версия не всегда воспринимается как «готовый продакшн-результат»;

-

для хорошего результата важны настройки, а не только текстовый запрос.

4. xAI Text-to-Speech

xAI Text-to-Speech [1] — речевая модель, ориентированная на TTS как сервисный слой.

Это не музыкальная система, а инструмент для озвучки текста в приложениях, интерфейсах и голосовых агентах.

Подход к генерации

В случае xAI акцент сделан на прикладной стороне:

-

API-интеграция;

-

потоковая выдача аудио;

-

управление интонацией через теги;

-

работа в voice- и real-time-сценариях;

-

поддержка разных форматов аудиовыхода.

То есть архитектурно здесь важен не только сам голос, но и то, как модель встраивается в продуктовый контур.

Как звучит

По характеру синтеза xAI TTS ближе к программируемой сервисной речи:

-

понятная дикторская подача;

-

управляемые паузы;

-

предсказуемое поведение [6] в репликах;

-

пригодность для поточной генерации.

Это голос не для музыкального исполнения, а для интерфейсного и прикладного использования.

Где уместна

Наиболее типичные сценарии:

-

voice agents;

-

озвучка интерфейсов;

-

телефония;

-

accessibility-функции;

-

системные голосовые ответы;

-

быстрые речевые прототипы для приложений.

Ограничения

Как и в других TTS-системах, многое зависит от качества текста:

-

длинные куски нужно логически разбивать;

-

интонация не возникает сама по себе без структуры входа;

-

музыкальные задачи и вокал такой стек не закрывает;

-

выразительность обычно приходится задавать явно.

Чем отличаются подходы

Если упростить, то модели делятся на две группы.

Музыкальные

-

Suno

-

ACE-Step v1.5 Base

Их задача — работать на уровне песни или музыкального фрагмента:

-

стиль;

-

структура;

-

вокал;

-

музыкальная форма;

-

общая композиционная логика [7].

Речевые

-

MiniMax

-

xAI Text-to-Speech

Их задача — работать на уровне голоса и текста:

-

тембр;

-

паузы;

-

устойчивость речи;

-

длительные реплики;

-

потоковый вывод;

-

интеграция в сервис.

Сравнение без оценок

Suno

-

ориентирован на цельную генерацию песни;

-

воспринимается как инструмент для быстрого музыкального результата;

-

удобен для демо, референсов и музыкальных черновиков.

MiniMax

-

ориентирован на стабильную речь;

-

подходит для длинных текстов и голосовых задач;

-

делает ставку на контроль подачи, а не на музыкальность.

ACE-Step v1.5 Base

-

открытая foundation-модель для музыки;

-

важен архитектурный и инженерный контроль;

-

применима там, где нужен собственный пайплайн и возможность доработки.

xAI Text-to-Speech

-

сервисный TTS-стек;

-

удобен для voice-интеграций и приложений;

-

ориентирован на программируемую озвучку, а не на музыкальный синтез.

Дополнительные возможности сервиса Ranvik

Генерация AI изображений [8] — площадка дает возможность создавать эксклюзивный визуал по текстовым запросам, улучшать четкость фото, корректировать картинки и моментально убирать фон.

ИИ для работы с текстами [9] — сервис оказывает помощь в написании и редактуре статей, переводе материалов, поиске идей и разработке сценариев любой степени сложности.

Генерация видео нейросетью [10] — функционал предназначен для генерации роликов по описанию, работы над кадрами, наложения субтитров, добавления анимации и спецэффектов.

Бесплатная нейросеть Ranvik [11] — универсальная платформа, объединяющая решения для производства и обработки текстов, графики, видео и звука.

AI для аудио [1] — возможности платформы позволяют переводить текст в голос, записывать музыку и создавать полноценные треки с индивидуальными настройками.

Оживление фото [12] — опция, позволяющая «оживить» статику, превращая обычные снимки в эффектные видеоролики с плавными движениями.

ИИ озвучка текста [13] — инструмент для трансформации написанного текста в живую речь с возможностью подбора нужного голоса, тембра и настроения.

Общие ограничения аудиомоделей

Независимо от класса модели, ограничения во многом повторяются.

1. Длина аудио

Чем длиннее результат, тем выше вероятность:

-

дрейфа интонации;

-

неудачных переходов;

-

расхождения стиля внутри одного куска;

-

потери устойчивости темпа.

2. Вариативность

Один и тот же промпт аудио [4] не гарантирует идентичный результат.

Это особенно заметно в музыке.

3. Стабильность

Для TTS критична стабильность:

-

тембра;

-

темпа;

-

пауз;

-

ударений;

-

фразировки на длинном тексте.

4. Требования к промпту

Хороший результат часто требует:

-

явного описания задачи;

-

аккуратной структуры текста;

-

разметки пауз и акцентов;

-

понимания, что именно модель вообще умеет генерировать.

Практические сценарии

Для чего подходит Suno

-

быстрые музыкальные идеи;

-

песенные демо;

-

проверка текстов песен;

-

черновая сборка трека.

Для чего подходит MiniMax

-

дикторская озвучка;

-

narration;

-

длинные текстовые фрагменты;

-

сервисные голосовые сценарии.

Для чего подходит ACE-Step v1.5 Base

-

локальное прототипирование;

-

исследовательские задачи;

-

кастомизация музыкального пайплайна;

-

генерация и редактирование музыки в собственном стеке.

Для чего подходит xAI Text-to-Speech

-

голосовые агенты;

-

real-time озвучка;

-

интерфейсные ответы;

-

прикладной TTS в веб- и телефонных сценариях.

Вывод

Эти четыре системы решают разные задачи, хотя формально все относятся к генерации аудио.

-

Suno — про цельную музыкальную композицию с вокалом и структурой.

-

MiniMax — про устойчивый синтез речи и работу с длинными текстами.

-

ACE-Step v1.5 Base — про открытую музыкальную foundation-модель с инженерным контролем.

-

xAI Text-to-Speech — про сервисный TTS для продуктовой интеграции.

Поэтому выбирать между ними имеет смысл не по абстрактному критерию качества, а по типу задачи:

-

нужен музыкальный черновик;

-

нужна озвучка;

-

нужен локальный open-source стек;

-

нужен потоковый TTS для приложения.

Именно в этой плоскости различия между моделями становятся практически полезными.

Автор: VisionSoul

Источник [14]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29322

URLs in this post:

[1] генерация аудио: https://ranvik.ru/audio

[2] интереса: http://www.braintools.ru/article/4220

[3] Нейросеть Suno: https://ranvik.ru/suno

[4] промпта для аудио ИИ: https://ranvik.ru/feed/music-prompts

[5] Нейросеть MiniMax: https://ranvik.ru/minimax

[6] поведение: http://www.braintools.ru/article/9372

[7] логика: http://www.braintools.ru/article/7640

[8] Генерация AI изображений : https://ranvik.ru/image

[9] ИИ для работы с текстами: https://ranvik.ru/chat

[10] Генерация видео нейросетью: https://ranvik.ru/video

[11] Бесплатная нейросеть Ranvik: https://ranvik.ru/

[12] Оживление фото: https://ranvik.ru/animate-photo

[13] ИИ озвучка текста: https://ranvik.ru/text-to-speech

[14] Источник: https://habr.com/ru/companies/ranvik/articles/1027218/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1027218

Нажмите здесь для печати.