Perplexity раскрыла, как обучает поискового AI-агента на Qwen

Команда Perplexity AI опубликовала техотчёт о создании своего поискового агента на базе моделей Qwen3.5.

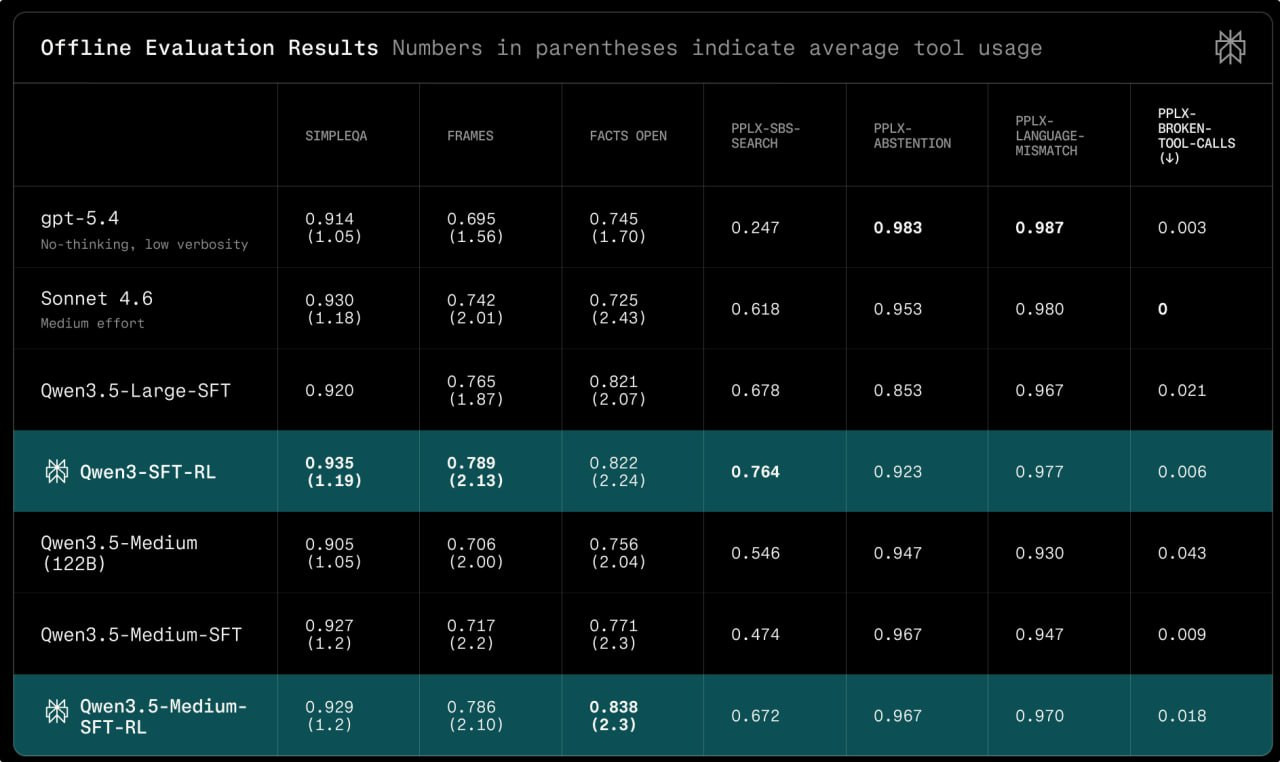

Результаты выглядят неожиданно сильными:

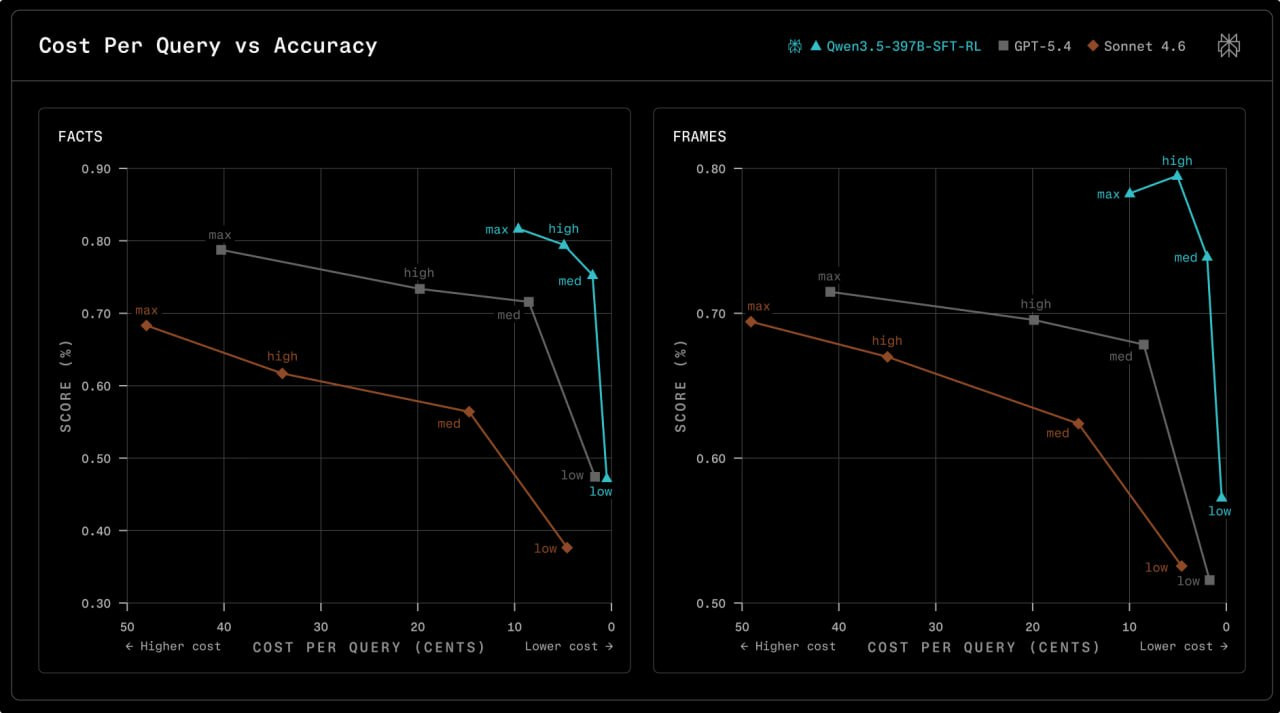

модель Qwen3.5-397B после SFT и RL достигает 73,9% точности на FRAMES при стоимости около 2 центов за запрос.

Для сравнения:

• GPT-5.4 — 67,8% и ~8,5 цента

• Sonnet 4.6 — 62,4% и ~15,3 цента

То есть лучше и значительно дешевле.

Как это сделал?

Система обучения [1] разделена на два этапа:

сначала SFT фиксирует «поведение» — формат ответа, следование инструкциям, корректные отказы

затем RL с GRPO дообучает именно поиск — точность и эффективность вызовов инструментов

Попытка объединить это в один этап ломает баланс: либо страдает качество поиска, либо продакшен-требования.

Данные для обучения:

Используются два типа данных:

• синтетические многошаговые вопросы с проверяемыми ответами

• диалоги, разбитые на чёткие критерии (формат, логика [2], структура)

Пропорция 90 к 10 в пользу проверяемых задач, чтобы модель училась именно находить правильный ответ, а не просто красиво отвечать.

Ключевая фишка — система наград

Reward устроен так, что «красивый» ответ не засчитывается, если он неправильный.

Сначала проверяется фактологическая корректность, и только потом учитывается стиль и качество формулировок.

Также добавлен штраф за неэффективность:

модель оптимизируется по числу вызовов инструментов и длине ответа относительно лучших решений внутри группы, а не по фиксированному лимиту.

Что это даёт?

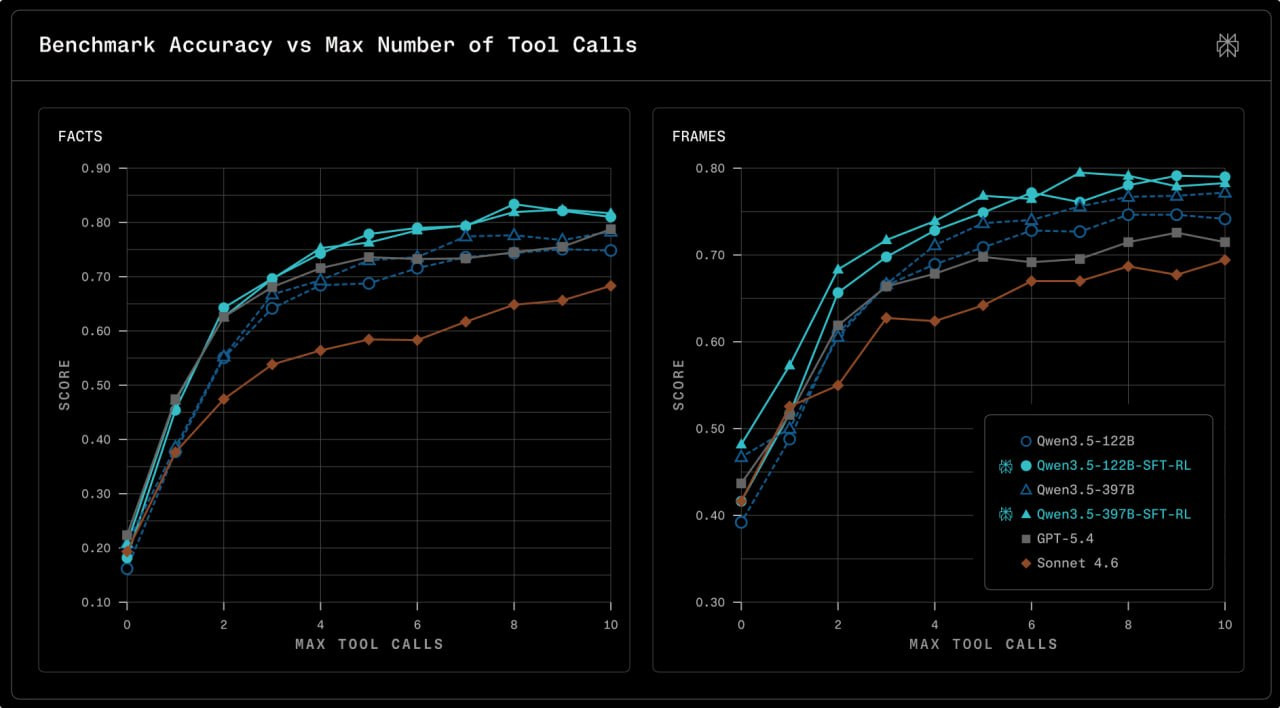

Даже при одном вызове инструмента модель уже обгоняет конкурентов, а в диапазоне 2–7 вызовов (типичный продакшен) разрыв становится ещё больше.

Дополнительно Perplexity снижает стоимость за счёт оптимизаций инференса — кэширование, квантование и переиспользование вычислений.

Делегируйте часть рутинных задач вместе с BotHub! [3] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [4] вы можете получить 300 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [5]

Автор: Spectrumm

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29343

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] логика: http://www.braintools.ru/article/7640

[3] BotHub!: https://bothub.chat/?utm_source=contentmarketing&utm_medium=habr&utm_campaign=news&utm_content=AI_AND_HACKERS

[4] По ссылке: https://bothub.chat/?invitedBy=iTNi-351UcHgc1BxGFWim

[5] Источник: https://research.perplexity.ai/articles/advancing-search-augmented-language-models

[6] Источник: https://habr.com/ru/companies/bothub/news/1027650/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1027650

Нажмите здесь для печати.