Средние модели, большие надежды: испытываем гибридные LLM

Привет, я Дмитрий, занимаюсь развитием LLMaaS. Перед нашей командой встала задача подбора «средней» языковой модели с примерно 9B параметров для обслуживания клиентских задач: оперативные чат-боты, саммаризация документов, генерация кода и аналитика на длинных контекстах. В таких сценариях критичны не только качество ответов, но и скорость, и стоимость инференса — ведь модель должна работать на одном GPU и при этом выдерживать заданный поток запросов.

Классические подходы — взять проверенную плотную модель вроде Llama 3.1 8B — дают неплохое качество, но упираются в память [1] из-за тяжеловесного KV-кеша. Поэтому мы обратили внимание [2] на гибридные архитектуры, где традиционное внимание чередуется с более экономичными механизмами: Mamba-2, Gated DeltaNet. Такие модели обещают радикально снизить расход памяти и увеличить пропускную способность без потери качества. Мы выделили три перспективные открытые модели этого класса: NVIDIA Nemotron-Nano 9B v2, Bamba-9B-v2 (IBM) и Qwen3.5 9B (Alibaba), и сравнили их с классической Llama 3.1 8B.

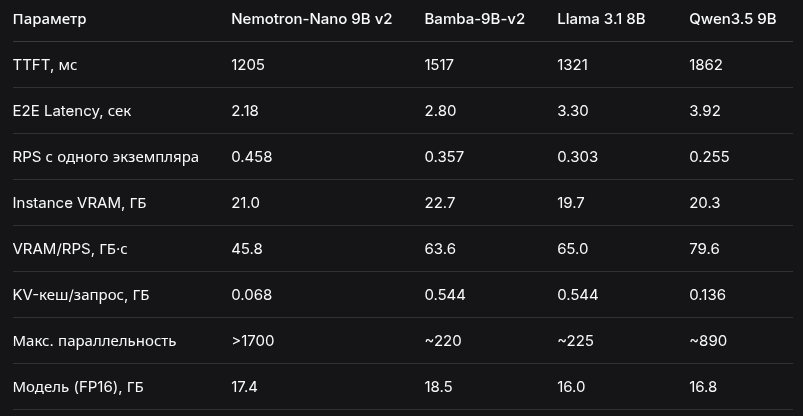

Моделирование проводилось для одного ускорителя NVIDIA H200 (141 ГБ) при типичной нагрузке: 4096 входных токенов, до 256 выходных. Рассчитывались метрики: Instance VRAM (память на один экземпляр с учётом весов, оверхеда и KV-кеша), E2E Latency, RPS с реплики, требуемый объём памяти на один RPS (VRAM/RPS), а также максимальная параллельность по памяти. Детальные расчёты и формулы мы ранее верифицировали с помощью собственного форка [InferSim](https://habr.com/ru/articles/1027358/ [3]) и публичных бенчмарков. Вот что получилось:

Почему у Nemotron такой микроскопический KV-кеш? Секрет — в архитектуре Nemotron-H. Модель построена не как классический Transformer, а как гибрид Mamba2, где 52 из 56 слоёв — это сверхбыстрые Mamba2-блоки, а полноценных Attention-слоёв, порождающих тяжёлый KV-кеш, всего четыре. Mamba2 работает как рекуррентная сеть: вместо того чтобы хранить раздувающуюся таблицу «ключей» и «значений» для каждого токена, она обновляет компактное скрытое состояние фиксированного размера. В результате весь KV-кеш для запроса из 4096 -> 256 токенов занимает 68 МБ — в 8 раз меньше, чем у Llama. Именно поэтому Nemotron способен держать в памяти почти 2000 одновременных запросов, упираясь уже не в память, а в вычислительную мощность GPU.

Почему Qwen3.5 тормозит на коротких контекстах? Архитектура Qwen3.5 построена вокруг Gated DeltaNet — механизма, который, как и Mamba2, оперирует фиксированным состоянием, а не растущим KV-кешем. Но у такого подхода есть своя цена. GDN-слои работают последовательно: для вычисления каждого нового токена им нужно обновить внутреннее состояние, и эта операция плохо параллелится на GPU. На коротких дистанциях, где классический Attention с его матричным умножением способен загрузить видеокарту почти на 100%, GDN-слои проигрывают в чистой скорости: TTFT у Qwen3.5 для 4096 токенов составляет 1.86 секунды против 1.32 секунды у Llama. Однако на дистанции 100K токенов маятник качается в другую сторону: там, где классический KV-кеш превращается в тормоз, Gated DeltaNet продолжает работать с той же эффективностью. Это классический компромисс «медленнее на коротких, быстрее на длинных».

Теперь о качестве. У каждой модели своя специализация. Nemotron-Nano 9B v2 — «математик»: AIME25 72.1%, MATH500 97.8% (лучший в классе), GPQA Diamond 64.0%, LiveCodeBench 71.1%. Qwen3.5 9B — «эрудит»: MMLU-Pro 82.5% (превосходит GPT-OSS-120B!), GPQA Diamond 81.7%, HMMT 83.2%. Bamba-9B-v2 — быстрый универсал, превосходящий Llama 3.1 8B по среднему баллу OpenLLM v2. С учётом скоростных характеристик выбор получается чётким. Для чат-ботов и потоковой обработки с высокой пропускной способностью нужен Nemotron — он в полтора раза быстрее Llama и примерно на 30% эффективнее использует память (VRAM/RPS 45.8 против 65.0 ГБ·с). Для саммаризации, аналитики документов и агентных систем, где во главе угла широкий кругозор и качество ответа, — Qwen3.5. Bamba занимает промежуточную позицию, обеспечивая заметный прирост скорости при сохранении привычного объема памяти.

LLM всё ещё потребляют много ускорителей, но прогресс архитектур (Mamba-2, Gated DeltaNet) позволяет шаг за шагом снижать стоимость владения: на одном H200 теперь можно обслуживать заметно больше клиентов, чем год назад. Выбор модели превращается в инженерную задачу с чёткими метриками, а не в гадание по маркетинговым обещаниям. Мы продолжаем калибровать наш симулятор и готовы делиться обновлёнными данными. Если у вас есть опыт [4] промышленного развёртывания этих моделей — присоединяйтесь к обсуждению.

Автор: Dmitriy_Khodykin

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29605

URLs in this post:

[1] память: http://www.braintools.ru/article/4140

[2] внимание: http://www.braintools.ru/article/7595

[3] https://habr.com/ru/articles/1027358/: https://habr.com/ru/articles/1027358/

[4] опыт: http://www.braintools.ru/article/6952

[5] Источник: https://habr.com/ru/articles/1029626/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1029626

Нажмите здесь для печати.