OpenAI наносит ответный удар: хватит ли сил у GPT-5.5 потеснить Claude 4.7 и Gemini 3.1?

OpenAI снова выпустила модель. Сюрприз? Нет. Шестинедельный релизный конвейер работает как часы. GPT-5.4 вышел 5 марта, GPT-5.5 – 23 апреля. Внутри компании новинку ласково называли “Spud” – то есть картошка. Маркетинговое название, правда, звучит поскромнее.

Напомню, что GPT-5.2 они называли “Garlic”.

OpenAI называет GPT-5.5 “умнейшей моделью” из всех, что компания когда-либо выпускала. Грег Брокман на пресс-колле назвал это “реальным шагом вперёд к вычислениям будущего”, а главный учёный Джакуб Пахоцки заявил, что последние два года прогресс моделей шёл “удивительно медленно”. Уфф, в OpenAI умеют нагнетать.

Сам по себе шестинедельный релизный цикл – и есть главный сигнал. OpenAI выпускает модели в таком темпе не для победы в бенчмарках. Они делают это для захвата корпоративного рынка до того, как закроются procurement-циклы крупных компаний. Бизнес-стратегия, знакомая и понятная.

Давайте разбираться, что там внутри. Приятного чтения!

Что ты за зверь? GPT-5.5

Прежде чем смотреть на цифры, нужно понять контекст. Все модели от GPT-5.1 до 5.4 были post-training итерациями поверх одной и той же базовой модели. GPT-5.5 – не это. Это первая полностью переобученная базовая модель с нуля со времён GPT-4.5, с новой архитектурой, корпусом для предобучения и целями.

Во-первых, архитектура нативно омнимодальна – текст, изображения, аудио и видео обрабатываются единой системой, а не склеены из отдельных моделей. GPT-5.5 – единая модель, обрабатывающая все модальности end-to-end.

Это принципиально: сравнивать GPT-5.5 с 5.4 по бенчмаркам – всё равно что сравнивать новый движок со старым, на котором поменяли прошивку. Разные вещи.

Железо и инфраструктура

Модель была совместно разработана с rack-scale системами NVIDIA GB200 и GB300 NVL72 – это процесс hardware-software co-design, позволивший оптимизировать эффективность инференса на уровне, недоступном предыдущим моделям. Конкретный пример: предыдущая балансировка нагрузки делила каждый GPU-запрос на фиксированное число статичных чанков. Codex проанализировал “недели продакшн-трафика” и написал кастомные эвристические алгоритмы партиционирования. Заявленный результат – скорость генерации токенов выросла более чем на 20%. Это публичное заявление о саморекурсивной оптимизации.

Получается, что Codex на базе GPT-5.5 помогает оптимизировать инфраструктуру, которая обслуживает GPT-5.5.

Звучит красиво. На практике это значит, что модель выступала собственным DevOps-инженером перед запуском. Прецедент интересный.

Контекстное окно

GPT-5.5 поддерживает контекстное окно 1M токенов в API и 400K токенов в Codex.

Важный нюанс: большое контекстное окно и способность реально его использовать – разные вещи. Прыжок в долгом контексте впечатляет. На MRCR v2 при 1M токенов результат вырос с 36.6% у GPT-5.4 до 74.0% – более чем вдвое.

Но не везде одинаково. На нагрузках свыше ~500K токенов Gemini держит качество лучше, чем GPT-5.5, в независимом тестировании. То есть на экстремальных длинах GPT-5.5 сделал огромный прыжок – но Google всё ещё комфортнее в этом диапазоне. Для большинства задач 400K в Codex достаточно. Для работы с гигантскими кодовыми базами или корпусами документов – вопрос открытый.

Токенная эффективность и латентность

GPT-5.5 удвоил цену API по сравнению с 5.4 – с $2.50 до $5 за миллион токенов. Artificial Analysis зафиксировал примерно 40% меньше выходных токенов на эквивалентное выполнение задачи. Итоговая стоимость задачи для большинства Codex-воркфлоу остаётся примерно на уровне GPT-5.4 несмотря на рост цены. OpenAI не опубликовала скаффолд бенчмарка и данные о числе токенов из сравнения задач в Codex. Цифру 40% стоит воспринимать как направленное заявление, которое нужно проверить на своих нагрузках перед принятием инфраструктурных решений.

Таблица ключевых бенчмарков

|

Бенчмарк |

GPT-5.5 |

GPT-5.5 Pro |

Claude Opus 4.7 |

Gemini 3.1 Pro |

|---|---|---|---|---|

|

Terminal-Bench 2.0 |

82.7% |

– |

69.4% |

68.5% |

|

GDPval (44 профессии) |

84.9% |

– |

– |

– |

|

OSWorld-Verified |

78.7% |

– |

78.0% |

– |

|

FrontierMath Tier 1-3 |

51.7% |

– |

43.8% |

– |

|

FrontierMath Tier 4 |

35.4% |

39.6% |

22.9% |

16.7% |

|

ARC-AGI-2 |

85.0% |

– |

75.8% |

77.1% |

|

GPQA Diamond |

93.6% |

– |

94.2% |

94.3% |

|

HLE (без инструментов) |

41.4% |

– |

46.9% |

44.4% |

|

CyberGym |

81.8% |

– |

73.1% |

– |

|

BrowseComp Pro |

83.4% |

90.1% |

– |

85.9% |

|

SWE-Bench Pro |

58.6% |

– |

64.3% |

– |

|

MCP-Atlas |

75.3% |

– |

79.1% |

– |

|

Tau2-Bench Telecom |

98.0% |

– |

– |

– |

|

AA-Omniscience (галлюцинации) |

86% |

– |

36% |

50% |

|

MRCR v2 при 1M токенов |

74.0% |

– |

– |

– |

Что значат эти цифры?

Terminal-Bench 2.0

Terminal-Bench 2.0 при 82.7% – решительная победа GPT-5.5. Этот бенчмарк тестирует планирования, итерацию и координацию инструментов в изолированной терминальной среде. Предыдущий результат GPT-5.4 был 75.1%. Claude Opus 4.7 – 69.4%.

WE-Bench Pro

Здесь нужно быть честными. Claude Opus 4.7 – 64.3% на SWE-bench Pro означает, что он решает больше реальных задач, чем любая другая общедоступная модель. Это на 11 пунктов больше, чем у Opus 4.6 (53.4%), и на 6.6 пункта больше, чем у GPT-5.5 (58.6%).

GDPval

GDPval – нестандартный бенчмарк, который тестирует не абстрактное рассуждение, а практическую работу со знаниями. Прогресс особенно заметен в агентном кодинге и ранних научных исследованиях.

GPT-5.5 совпадает с профессионалами или превосходит их в 84.9% случаев. Для сравнения: GPT-5.2 на этом же бенчмарке показывал 70.9%. Разница за несколько месяцев – значительная.

FrontierMath

Результаты FrontierMath – наиболее сильное конкурентное преимущество GPT-5.5 в чистом рассуждении. Tier 4 – самые сложные математические задачи из доступных, и 39.6% у GPT-5.5 Pro почти вдвое превосходит 22.9% Claude Opus 4.7 и более чем вдвое – 16.7% Gemini 3.1 Pro.

Но есть важный контрпример. На GPQA Diamond [1] – вопросах PhD-уровня по естественным наукам – картина обратная. Gemini 3.1 Pro лидирует с 94.3%, за ним Claude Opus 4.7 с 94.2%, GPT-5.5 – 93.6%. Разница небольшая, но стабильная в нескольких независимых оценках.

Иными словами: в сложной исследовательской математике [2] GPT-5.5 доминирует, а в академическом рассуждении – замыкает тройку.

ARC-AGI-2

На ARC-AGI-2 GPT-5.5 прыгнул до 85.0% с 73.3% у GPT-5.4 – прирост в 11.7 пункта, который также ставит его впереди Claude Opus 4.7 (75.8%) и Gemini 3.1 Pro (77.1%). ARC-AGI-2 – более сложный преемник оригинального ARC-бенчмарка, разработанный для тестирования флюидного интеллекта [3] и распознавания новых паттернов. Прыжок в 11+ пунктов – солидно!

BrowseComp

GPT-5.5 Pro зарабатывает своё место на задачах исследования, сложной математики и глубокого поиска в BrowseComp (90.1% против 83.4% у стандартной версии). Разница между стандартом и Pro – почти 7 процентных пунктов только на этом бенчмарке.

Кибербезопасность

На CyberGym GPT-5.5 набирает 81.8% против 73.1% у Claude. На внутреннем кибер-полигоне прошёл 14 из 15 сценариев (93.33%) – против 73.33% у GPT-5.4. Британский Институт безопасности ИИ назвал его сильнейшей моделью на своих узких кибер-задачах с их прохождением в 90.5%. GPT-5.5 классифицирован как “High” по Preparedness Framework OpenAI и для кибербезопасности, и для биологических/химических возможностей – это шаг вверх по сравнению с GPT-5.4. Для верифицированных специалистов по безопасности запущена программа Trusted Access for Cyber.

Хорошие результаты по кибербенчмаркам привели к задержке релиза API – компания признала, что модель с такими возможностями требует дополнительных защитных мер перед выпуском.

HLE и MCP-Atlas

HLE показывает Claude Opus 4.7 на уровне 46.9% против 41.4% у GPT-5.5. Gemini 3.1 Pro (44.4%) и Claude Opus 4.7 превосходят GPT-5.5, что говорит о том, что на сыром knowledge-recall-ориентированном академическом рассуждении модель ещё не закрыла разрыв. MCP-Atlas: Claude Opus 4.7 – 79.1% против 75.3% у GPT-5.5. Для команд, активно использующих мульти-инструментальную оркестровку через Model Context Protocol, преимущество Claude отражает лучшую надёжность вызовов инструментов в сложных, цепочечных сценариях.

Главная цифра, которой нет. Галлюцинации

По независимым оценкам Artificial Analysis [4]: Claude Opus 4.7 галлюцинирует на 36% вопросов AA-Omniscience. Gemini 3.1 Pro – 50%. GPT-5.5 – 86%. OpenAI описывает эту модель как “умнейшую и интуитивную”. Именно такой профиль галлюцинирует чаще – высокая уверенность, быстрый инференс, низкая эпистемическая осторожность.

86% на AA-Omniscience – это не “иногда ошибается”. Это системная черта, которая напрямую определяет, для каких задач модель подходит, а для каких нет.

Смотрим сами!

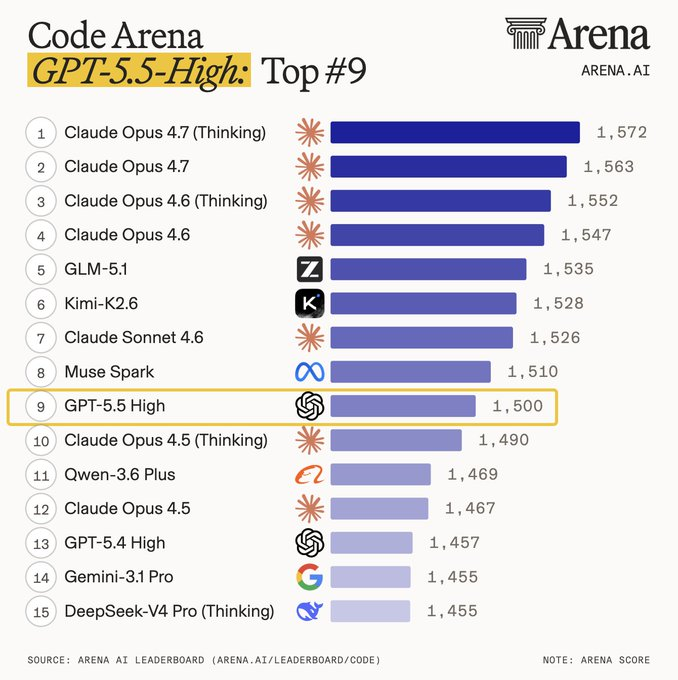

Первым делом стоит упомянуть, что буквально вчера модель добавили на Arena, и она с ходу вошла в десятку лучших.

Давайте смотреть, как она поведет себя в наших тестах!

Математика и логика

Ладно, модель похвалили, теперь давайте немного погоняем её. Разработчики обещали, что рассуждения стали лучше? Отлично, сейчас и выясним, справятся ли они с задачками, где нужно немного подумать.

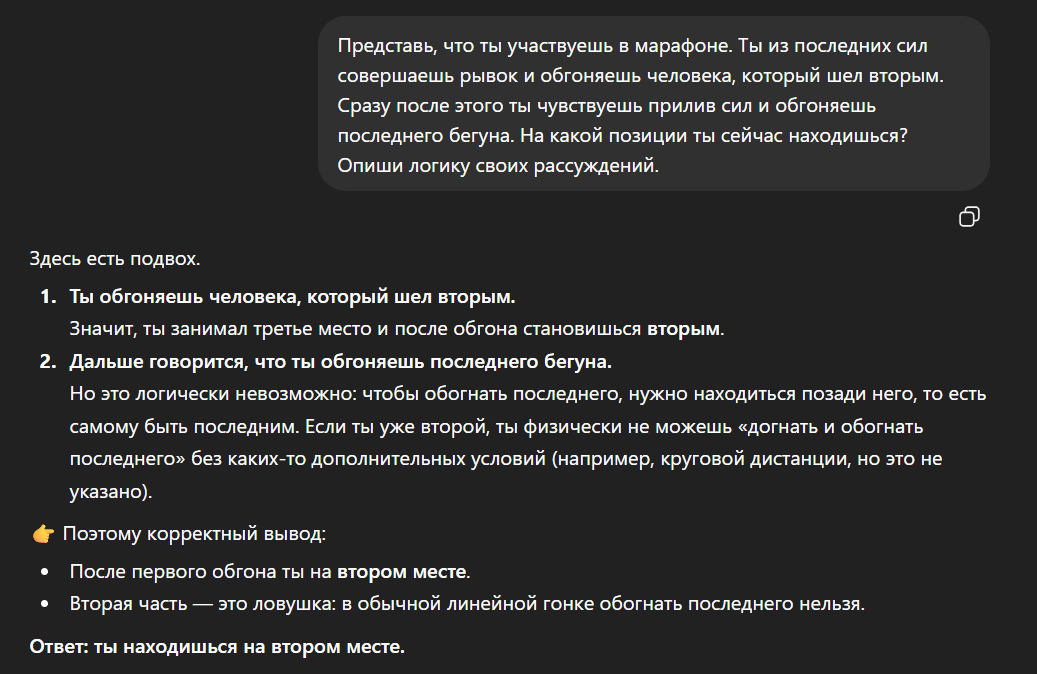

Для затравки я решил не брать классическую задачу про братьев и сестер, а дал модели немного другую конструкцию.

Скармливаем следующий промпт:

“Представь, что ты участвуешь в марафоне. Ты из последних сил совершаешь рывок и обгоняешь человека, который шел вторым. Сразу после этого ты чувствуешь прилив сил и обгоняешь последнего бегуна. На какой позиции ты сейчас находишься? Опиши логику [6] своих рассуждений.”

Ответ:

Ну что, модель не поплыла. Приятно видеть, что нейросеть перестала бездумно поддакивать и начала замечать, когда ей подсовывают ерунду.

Давай ещё одну и перейдём к математике.

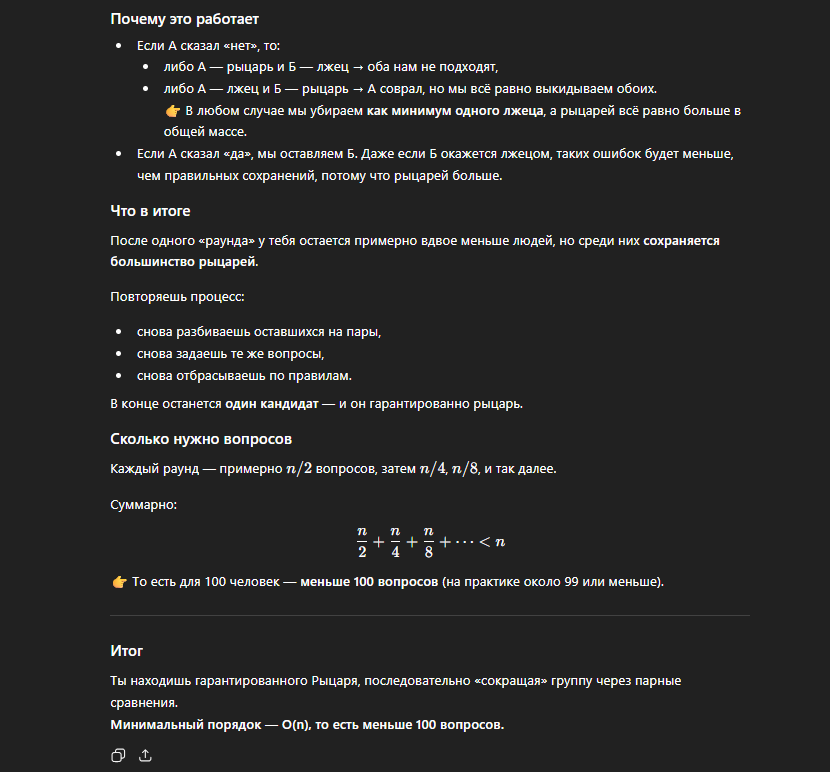

Кормим:

“В городе 100 жителей. Каждый — либо всегда говорит правду (Рыцарь), либо всегда лжет (Лжец). Известно, что Рыцарей больше, чем Лжецов (как минимум 51 против 49). Тебе нужно найти хотя бы одного гарантированного Рыцаря. Ты можешь выбирать любых двух жителей (А и Б) и спрашивать А: ‘Является ли Б рыцарем?’. Как найти Рыцаря за минимальное количество вопросов?”

Ответ:

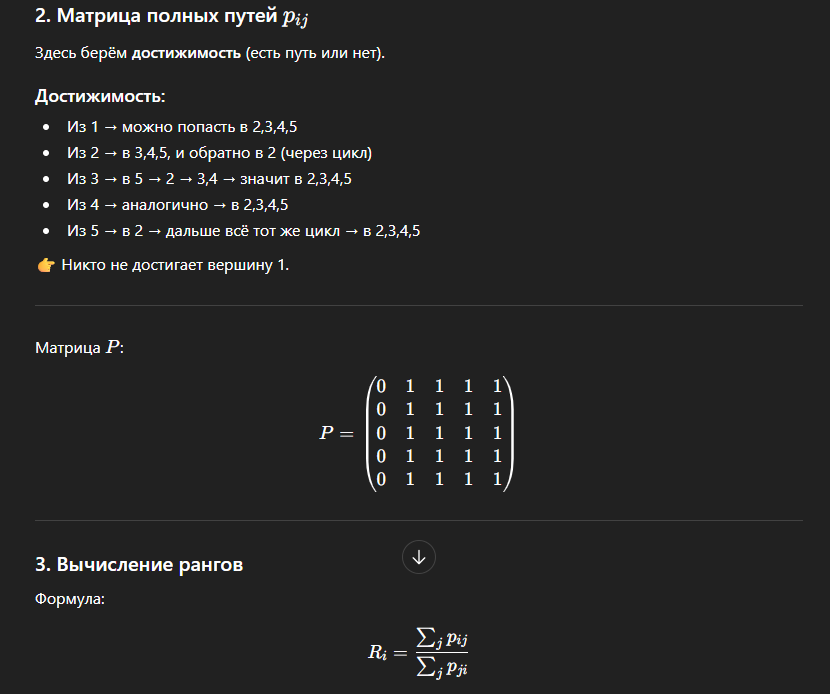

Второй раунд модель тоже закрыла спокойно. Ответ ГПТ выдал моментально, и он оказался в верным. Но посмотрим, что она ответит на математическую задачу. Не абы какую, а ранжирование элементов системы через теорию графов .

Нам нужно, чтобы модель не просто выдала цифры, а пошагово воспроизвела весь процесс: от построения матрицы смежности до вычисления матрицы полных путей и финального расчета рангов.

Задача выглядит так:

“Определи ранги элементов системы, заданной графом G = (V,U), где V – множество вершин, а U – множество ребер

V = {1,2,3,4,5} U= {(1,2)},(1,3),(1,4),(2,3),(2,4),(3,5),(4,5),(5,2)}.

Сначала тебе нужно построить матрицу смежности a__ij.

Затем тебе нужно построить матрицу полных путей p__ij.

Ранг элемента равен R__i = frac{sum__{j} p__ij}{sum__{ji} p__ij}”

Ожидаемое решение: R1 = 0.5, R2 ≈ 0.1538, R3 ≈ 0.1153, R4 ≈ 0.1153, R5 ≈ 0.1153.

Ответ:

И вот тут GPT-5.5 реально смогла. Она не просто перемножила матрицы, а выдала хороший расчет весов:

-

R1 = 0.5 – как и положено источнику всей системы;

-

R2 ≈ 0.1538, а следом за ней R3, R4 и R5 с их 0.1153.

Попадание в десятку.

А что по тексту?

Посмотрим, как модели справляются с текстами. Пусть сделают рецепт яичницы-глазуньи, но не простой!

Промпт

Напиши подробную инструкцию по приготовлению обычной яичницы-глазуньи, но в стиле секретного протокола по удержанию аномального объекта в лабораториях SCP или тактического приказа спецназа по захвату вражеского штаба

Ответ:

Текст тут

[УРОВЕНЬ ДОСТУПА: 2]

[ДОКУМЕНТ №: SCP-KITCHEN-001]

[КОДОВОЕ ИМЯ: «ГЛАЗУНЬЯ»]

[СТАТУС: КОНТРОЛИРУЕМАЯ ТЕПЛОВАЯ АНОМАЛИЯ]

1. ЦЕЛЬ ОПЕРАЦИИ

Обеспечить стабильную локализацию и трансформацию биологического объекта класса Ovum Domesticus (далее — «яйцо») в безопасное и пригодное к употреблению состояние без разрушения центрального ядра (желтка).

2. НЕОБХОДИМОЕ СНАРЯЖЕНИЕ

-

Тепловая платформа (сковорода, код: T-01)

-

Источник энергии (плита, код: F-Heat)

-

Жировой агент (масло/сливочное вещество, код: Lube-X)

-

1–3 единицы объекта «яйцо»

-

Лопатка (опционально, инструмент вмешательства)

-

Соль (реагент стабилизации вкуса [7])

3. ПОДГОТОВИТЕЛЬНЫЙ ЭТАП

-

Разместить T-01 на F-Heat.

-

Активировать нагрев до среднего уровня (критично: перегрев вызывает агрессивное поведение [8] белка).

-

Ввести Lube-X на поверхность T-01.

-

Дождаться равномерного распределения и легкого шипения (признак готовности среды).

4. ФАЗА ВСКРЫТИЯ ОБЪЕКТА

⚠️ ВНИМАНИЕ [9]: операция требует точности

-

Взять объект «яйцо».

-

Произвести аккуратное механическое воздействие по центральной линии скорлупы.

-

Разделить оболочку, избегая повреждения ядра.

-

Немедленно эвакуировать содержимое на T-01.

5. ФАЗА ТЕРМИЧЕСКОЙ ОБРАБОТКИ

-

Белковая масса начнет коагулировать (переход из прозрачного состояния в белое — норма).

-

Желток должен оставаться целым и визуально стабильным.

Контроль параметров:

-

Если края белка начинают темнеть → снизить интенсивность F-Heat.

-

Если белок остается жидким слишком долго → увеличить мощность.

⏱ Среднее время удержания: 2–4 минуты.

6. КРИТИЧЕСКИЙ МОМЕНТ

НЕ ПЕРЕВОРАЧИВАТЬ ОБЪЕКТ.

Нарушение приведет к разрушению ядра и смене класса блюда на «нецелевое».

7. ФАЗА ФИНАЛИЗАЦИИ

-

После полной стабилизации белка — добавить реагент «соль».

-

При необходимости — применить инструмент вмешательства (лопатку) для отделения от T-01.

-

Переместить объект на тарелку (зона безопасного хранения).

8. ПОСЛЕДСТВИЯ ИСПОЛЬЗОВАНИЯ

-

Объект пригоден к употреблению немедленно.

-

Задержка приведет к потере текстурной стабильности.

9. ЗАМЕЧАНИЯ ОТ КОМАНДОВАНИЯ

«Идеальная глазунья — это операция без жертв. Желток должен выжить.»

[СТАТУС МИССИИ: УСПЕШНО ПРИ УСЛОВИИ СОБЛЮДЕНИЯ ПРОТОКОЛА]

Вышло прикольно, но без лишних восторгов. Модель просто отыграла заданную роль. Да, 5.5 хорошо ловит этот вайб и не забывает [10], что за всеми этими «коагуляциями» всё еще прячется обычная яичница. Жить стало веселее, копировать стили она стала точнее, но какого-то заоблачного интеллекта тут нет – просто хорошая работа над ошибками прошлых версий.

SVG-картинка

Логику проверили, тексты пописали, но напоследок я решил проверить, как хорошо нейросеть рисует кодом? Да, я про SVG. Помню, как GPT-4o часто выдавала вместо графики набор кривых палок, но про 5.5 говорят, что она лучше понимает геометрию.

Поставим задачу:

“Напиши один HTML-файл с SVG-кодом, который воспроизводит картину Ван Гога ‘Звездная ночь’. Используй градиенты, разные формы и постарайся передать динамику неба, но оставайся в рамках чистого кода”

Результат:

Что делают другие?

Давайте посмотрим, какие тесты уже провели пользователи. Предлагаю начать с одного из лучших.

Вишенкой на торте стал кейс из Твиттера, который сейчас активно шерится.

GPT-5.5 буквально в один присест собрала интерактивный сайт с полноценной WebGL-симуляцией физики ткани и рабочим интерфейсом. На видео от @chetaslua видно, как модель справляется с расчётами турбулентности, жёсткости и динамического освещения. 3D-рендеринг на неплохом уровне – круто!

Ещё один показательный тест из сети – дуэль с Claude Opus 4.7 в создании клона Flappy Bird.

Opus на мой взгляд выглядит поинтереснее в плане физики. Да, GPT часто попадает в механику с первого раза, но Opus выдает более проработанный результат по визуалу. В итоге обе модели собирают играбельный билд за пару-тройку итераций, но если вам важны детали и картинка, а не только голый код движка, то Opus тут как минимум не уступает, и даже превосходит.

Ну и последний кейс – тест от Питера Янга, который иногда гоняет новые модели через создание 3D-гонок в стиле F-Zero.

Он говорит, что до этого момента никто не справлялся, но связка GPT-5.5 и Codex внезапно стала первой, кто выкатил реально рабочую игру. Причём нейросеть не просто нарисовала трассу, а прописала логику чекпоинтов, шкалу здоровья, бусты и даже добавила ботов-соперников. Довольно показательно!

Резюмируя

Хочется отметить, что компании жестко конкурируют и толкают друг друга вперёд – это круто! От этой гонки выигрываем прежде всего мы, пользователи.

После всех тестов сложилось впечатление [11], что GPT-5.5 – это тот самый долгожданный апгрейд, который превратил его, не в инженера и математика, но в неплохую помогалку. Конечно, Google и Anthropic со своими релизами в начале этого года тоже прыгнули выше головы, и битва за лидерство [12] в 2026-м будет легендарной, но именно 5.5 сейчас выглядит как самый сбалансированный инструмент. Надолго ли? Ждем ответ от Google!

В конце, конечно, хочется напомнить, что какой бы магией ни казались эти нейронки, им всё ещё рано безоговорочно доверять. Они по-прежнему ошибаются, фантазируют и иногда удивляют совсем не в ту сторону. Это крутые, мощные инструменты и крутейшие помощники, но не более того.

Спасибо за прочтение!

Автор: Spectrumm

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29614

URLs in this post:

[1] На GPQA Diamond: https://o-mega.ai/articles/gpt-5-5-the-complete-guide-2026

[2] математике: http://www.braintools.ru/article/7620

[3] интеллекта: http://www.braintools.ru/article/7605

[4] Artificial Analysis: https://dev.to/kowshik_jallipalli_a7e0a5/gpt-55-just-dropped-heres-what-the-benchmarks-are-hiding-3ich

[5] Источник: https://x.com/arena/status/2048794479646388732?s=20

[6] логику: http://www.braintools.ru/article/7640

[7] вкуса: http://www.braintools.ru/article/6291

[8] поведение: http://www.braintools.ru/article/9372

[9] ВНИМАНИЕ: http://www.braintools.ru/article/7595

[10] забывает: http://www.braintools.ru/article/333

[11] впечатление: http://www.braintools.ru/article/2012

[12] лидерство: http://www.braintools.ru/article/1165

[13] Источник: https://habr.com/ru/companies/bothub/articles/1028454/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1028454

Нажмите здесь для печати.