Брат, сестра и сорванец-канадец: кто стоит за Claude. Досье SpeShu.AI

OpenAI могут развалить бывшие сотрудники компании. Они объединились и создали конкурента, который уже обогнал компанию Сэма Альтмана на вторичном рынке — Antropic. Флагманский продукт Antropic — вирусная нейросеть Claude.

Кому удалось обойти отца ИИ-рынка, как образовался коллектив победителей и кто именно стоит за Claude, ответы на эти вопросы вы получите в этой статье.

Это рубрика досье SpeShu.AI [1]. Здесь мы составляем психологические портреты людей, которые ведут всех нас в будущее искусственного интеллекта [2] и прямо сейчас меняют мир, как в своё время изменили Лейбниц, Эйнштейн и Курчатов.

Нейросеть Claude. Краткий ликбез от SpeShu.AI

Claude — нейросеть от Anthropic, которую любят за работу с большими текстами, кодом и задачами, где нужно долго держать контекст. Ей можно скормить документ, кусок переписки, ссылку, фрагмент кода или целую задачу для анализа и получить ответ без ощущения, что модель забыла начало разговора на середине.

Особенно громко Claude выстрелил в разработке. Его отдельный инструмент Claude Code умеет читать кодовую базу, вносить изменения в файлы, запускать тесты и помогать доводить задачу до готового результата. Уровень доверия к Claude хорошо показывает реакция [3] индустрии. Глава NVIDIA Дженсен Хуанг называл [4] Claude «невероятным» и говорил, что Anthropic сделала большой скачок в кодинге и рассуждениях. По его словам, NVIDIA использует Claude внутри компании повсеместно.

К апрелю 2026 года Anthropic уже воспринимают как главного соперника OpenAI. В официальном раунде финансирования компания получила оценку $380 млрд, а на вторичном рынке, по данным Business Insider и Tom’s Hardware, спрос на акции разогнал неофициальную оценку до района $1 трлн.

При этом связь с OpenAI у Anthropic прямая: компанию основали бывшие сотрудники OpenAI, включая Дарио и Даниэлу Амодеи. Так что Claude — это команда людей из самой сердцевины ИИ-гонки, которая решила строить своего конкурента ChatGPT с упором на безопасность, длинный контекст и рабочие сценарии.

Дарио Амодеи — CEO и сооснователь Anthropic

Дарио Амодеи — человек, который стоял у истоков сразу двух главных ИИ-историй последних лет: GPT и Claude. По образованию он физик и биофизик: окончил Стэнфорд, получил докторскую степень в Принстоне, работал в Stanford Medicine, изучал нейронные цепи и применял машинное обучение [5] в исследованиях мозга [6].

До Anthropic он успел поработать в Google Brain, а затем стал вице-президентом по исследованиям в OpenAI. На его официальном сайте прямо сказано: Амодеи руководил разработкой крупных языковых моделей GPT-2 и GPT-3.

В 2021 году Амодеи вместе с сестрой Даниэлой и другими бывшими сотрудниками OpenAI основал Anthropic. Причина ухода из OpenAI без красивых легенд: у команды разошлись взгляды на то, как нужно развивать сильный искусственный интеллект. Амодеи хотел строить модели с жёстким фокусом на управляемость, интерпретируемость и безопасность. Эта логика [7] до сих пор видна во всех публичных заявлениях Anthropic.

В публичном поле Амодеи появляется редко, зато каждый его текст потом разбирают в индустрии. В октябре 2024 года он выпустил большое эссе «Machines of Loving Grace [8]» — о мире, где мощный ИИ помогает в медицине, образовании, экономике и управлении. Текст получился почти программным: меньше техно-паники, больше попытки описать, какой результат человечество вообще хочет получить от ИИ.

В январе 2025 года Амодеи отдельно писал [9] про DeepSeek, Китай и экспортный контроль. Его позиция жёсткая: демократические страны должны удерживать преимущество в ИИ, иначе технология быстро станет инструментом авторитарных режимов.

В апреле 2025-го он опубликовал «The Urgency of Interpretability [10]» — текст о главной проблеме современных нейросетей: мы уже научились делать очень сильные модели, но всё ещё плохо понимаем, что происходит у них внутри. Оба текста есть в архиве его официального сайта.

Самый громкий конфликт вокруг Амодеи случился в феврале 2026 года

Anthropic обсуждала работу Claude с Пентагоном, но отказалась убирать два ограничения из контрактов: запрет на массовую внутреннюю слежку и запрет на полностью автономное оружие. Амодеи объяснил позицию напрямую: массовая ИИ-слежка опасна для гражданских свобод, а фронтальные модели пока недостаточно надёжны, чтобы самостоятельно выбирать и поражать цели. По словам Anthropic, военное ведомство угрожало убрать Claude из своих систем и присвоить компании статус «supply chain risk».

Даниэла Амодеи — сестра Дарио, президент и сооснователь Anthropic

Даниэла Амодеи — сестра Дарио Амодеи и человек, который держит Anthropic в рабочем состоянии, пока исследователи спорят о моделях, безопасности и будущем ИИ. До Anthropic она работала в Stripe, где занималась риск-менеджментом и комплаенсом, затем перешла в OpenAI и стала вице-президентом по безопасности и политике. Уже после этого вместе с Дарио и другими бывшими сотрудниками OpenAI основала Anthropic.

В Anthropic у Даниэлы роль президента компании. Проще говоря, она отвечает за операционку: команды, процессы, партнёрства, безопасность продукта и всё, что превращает лабораторию с сильными исследователями в компанию, которая продаёт Claude бизнесу, разговаривает с регуляторами и выдерживает давление рынка.

Forbes [11] называет её сооснователем и президентом Anthropic, а Business Insider [12] пишет, что она курирует ежедневную работу компании.

На фоне Дарио она выглядит менее публичной фигурой, но для Anthropic это важная связка: он отвечает за исследовательскую и стратегическую линию, она — за то, чтобы компания не развалилась от собственного масштаба. Когда стартап за несколько лет превращается в одного из главных конкурентов OpenAI, одной сильной модели мало. Нужны найм, юристы, финансы, клиенты, правила использования и постоянные переговоры с партнёрами. Это зона Даниэлы.

Крис Ола — сооснователь, исследователь интерпретируемости

Он бросил университет в 18 лет, получил грант Тиля и начал работать самостоятельно.

Его карьера выглядит как маршрут по главным ИИ-лабораториям последних десяти лет: Google Brain, затем OpenAI, затем Anthropic. При этом у него нет классической академической траектории с бакалавриатом, магистратурой и PhD. По данным 80,000 Hours, он ушёл из университета, самостоятельно занялся машинным обучением и в итоге попал на стажировку в Google Brain. Позже получил Thiel Fellowship — грант для молодых людей, которые строят проекты вне стандартной университетской системы.

Для Anthropic это одна из центральных тем. Олах и его команда пытаются буквально вскрыть Claude как сложный цифровой организм: найти группы «нейронов», которые отвечают за понятия, намерения, языковые связи, токсичные паттерны или признаки мошенничества. TIME включил Олаха в список TIME100 AI 2024 и описал его как одного из пионеров механистической интерпретируемости.

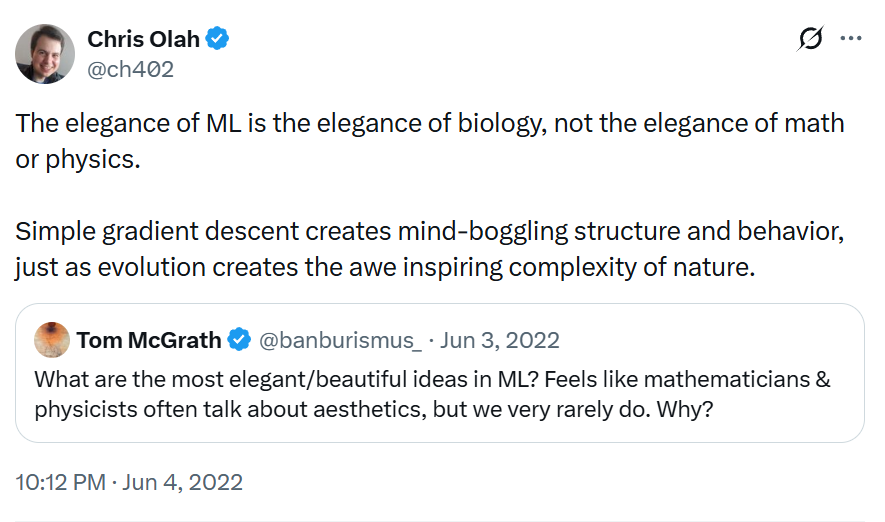

У Олаха редкая для ИИ-индустрии интонация. Он смотрит на нейросети скорее как биолог, чем как инженер с линейкой. Его известная фраза [13] из запрещённой в России соцсети X хорошо это передаёт: «Элегантность машинного обучения — это элегантность биологии, а не математики [14] или физики. Простой градиентный спуск создаёт головокружительные структуры и поведение [15], как эволюция [16] создаёт сложность природы».

Аманда Аскелл — философ, отвечает за «душу» Claude

Аманда Аскелл — редкий человек в верхнем слое ИИ-индустрии: её главный бэкграунд не инженерия, а философия. Она училась в Университете Данди, получила BPhil в Оксфорде и PhD по философии в Нью-Йоркском университете. Тема диссертации звучит почти как промпт для безумного эксперимента: «бесконечная этика», то есть моральные задачи в мирах с бесконечным числом участников. На личном сайте Аскелл пишет, что её философские интересы — этика, теория решений и формальная эпистемология.

До Anthropic она работала в OpenAI в команде политики. Там занималась AI safety через дебаты между моделями и оценку того, как люди справляются с задачами по сравнению с ИИ. В 2021 году Аскелл перешла в Anthropic и занялась тонкой настройкой моделей, выравниванием поведения [17] и тем, что внутри компании называют personality alignment. Проще говоря, она учит Claude быть честным, любопытным, осторожным, вежливым и полезным без ощущения, что с вами разговаривает стерильная инструкция из банка.

Wall Street Journal описал её работу совсем коротко [18]: научить Claude быть хорошим. New Yorker формулирует ещё ярче: Аскелл курирует «душу» Claude. За красивой метафорой скрывается конкретная работа: длинные инструкции, тесты поведения, этические сценарии, настройка ответов, проверка того, как модель реагирует на сомнительные просьбы, личные вопросы, конфликты и ситуации с риском вреда.

Неповторимый коллектив

Команда Anthropic выглядит как случайный набор людей, но по факту внутри коллектива рождается неповторимая синергия. Возможно, именно благодаря ей Claude получается таким.

Дарио Амодеи отвечает за стратегию и научную линию, Даниэла Амодеи — за операционку и рост компании, Крис Олах пытается понять, что происходит внутри моделей, а Аманда Аскелл настраивает характер Claude. Поэтому Claude получился не просто «ещё одним чат-ботом», а нейросетью с понятной философией: сильная модель должна быть полезной, честной и управляемой.

Досье SpeShu.AI — специальная рубрика о людях, которые формируют будущее человечества в сфере ИИ. Знакомьтесь с их высказываниями, карьерой, личной философией и техническими прогнозами. Познавайте ИИ-инструменты на глубинном уровне и не забывайте их тестировать на официальном сайте SpeShu.AI [19].

Автор: tsnis_journal

Источник [20]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29634

URLs in this post:

[1] SpeShu.AI: http://SpeShu.AI

[2] интеллекта: http://www.braintools.ru/article/7605

[3] реакция: http://www.braintools.ru/article/1549

[4] называл: https://finviz.com/news/286255/nvidia-ceo-jensen-huang-calls-anthropics-claude-incredible-says-every-software-company-needs-to-use-it

[5] обучение: http://www.braintools.ru/article/5125

[6] мозга: http://www.braintools.ru/parts-of-the-brain

[7] логика: http://www.braintools.ru/article/7640

[8] Machines of Loving Grace: https://darioamodei.com/essay/machines-of-loving-grace

[9] отдельно писал: http://t.co/LZAANEcZJW

[10] The Urgency of Interpretability: https://www.darioamodei.com/post/the-urgency-of-interpretability

[11] Forbes: https://www.forbes.com/profile/daniela-amodei

[12] Business Insider: https://www.businessinsider.com/here-are-the-executives-running-anthropic-right-now-2024-10?utm_source=chatgpt.com

[13] известная фраза: https://x.com/ch402/status/1533164918886703104

[14] математики: http://www.braintools.ru/article/7620

[15] поведение: http://www.braintools.ru/article/9372

[16] эволюция: http://www.braintools.ru/article/7702

[17] поведения: http://www.braintools.ru/article/5593

[18] описал её работу совсем коротко: https://www.wsj.com/tech/ai/anthropic-amanda-askell-philosopher-ai-3c031883

[19] SpeShu.AI: https://speshu.ai/?utm_source=habr&utm_medium=article&utm_campaign=doc_claude

[20] Источник: https://habr.com/ru/companies/tsnis/articles/1029930/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1029930

Нажмите здесь для печати.