AGI: это правда закат человечества? Обзор технологии, которой нас запугали

СМИ подали слова учёных так, будто человечеству осталось совсем недолго: мол, уже к середине 2030-х нас вытеснит суперинтеллект. Имя этой угрозы — AGI. По сути, речь идет о следующем этапе развития искусственного интеллекта [1]. И если вас уже сейчас впечатляет то, что умеют нейросети, то масштабы того, что приписывают AGI, выглядят куда тревожнее. По мнению многих, это уже не просто инструмент, а потенциальная замена человеку.

Но действительно ли всё настолько мрачно, как это рисуют в заголовках? Давайте спокойно разберёмся, что именно ученые пишут про AGI в научных публикациях — без истерики, громких клише и медийных преувеличений.

Что такое AGI

AGI (artificial general intelligence) обычно описывают как тип искусственного интеллекта, который способен решать не одну узкую задачу, а широкий спектр когнитивных задач — на уровне человека или даже выше.

В OpenAI формулируют это так: AGI — это «высокоавтономные системы, которые превосходят людей в большинстве экономически значимых видов деятельности». В свою очередь, в Google DeepMind говорят об ИИ, который «как минимум сопоставим с человеком по способностям в большинстве когнитивных задач».

При этом важно понимать: даже среди ведущих специалистов нет единого, чёткого определения. Например, Джеффри Хинтон отмечал, что AGI — это «важная, но размытая концепция», вокруг которой до сих пор нет полного согласия. Сам он предлагает считать AGI системой, способной выполнять практически любые когнитивные задачи не хуже человека.

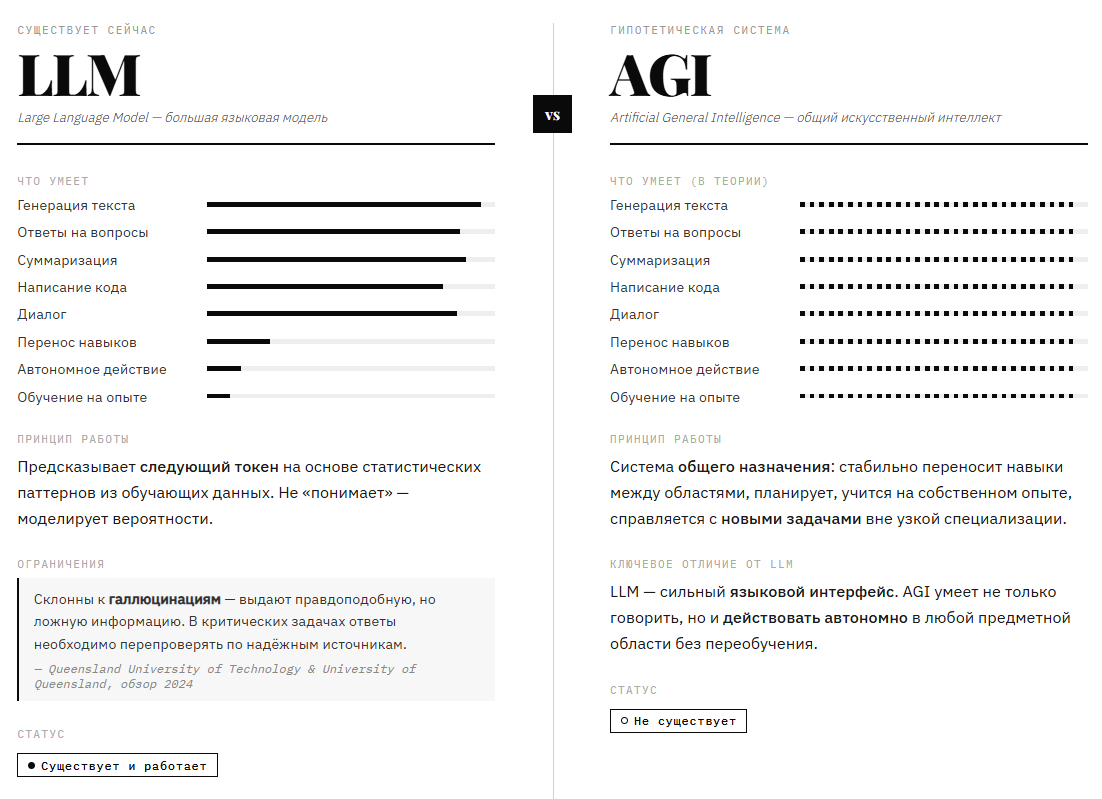

LLM и AGI: в чём разница

LLM (large language models) — это большие языковые модели, заточенные под работу с текстом. Их основная задача — предсказывать следующий токен: на этом строится генерация текста, ответы на вопросы, пересказ, программирование и диалог. Даже когда такие модели кажутся «разумными», это всё ещё не универсальный интеллект в полном смысле.

Исследователи из Queensland University of Technology и University of Queensland в обзоре [2] 2024 года прямо отмечают ограничения LLM: они могут «галлюцинировать», то есть уверенно выдавать правдоподобную, но неверную информацию. Поэтому в задачах, где важна точность, их ответы необходимо проверять по надёжным источникам.

Когда впервые начали говорить об AGI

Если рассматривать именно термин, а не саму идею, выражение artificial general intelligence впервые предложил [3] Марк Губруд ещё в 1997 году. Позже, в начале 2000-х, его заново ввели в активное использование и популяризировали Бен Гёрцель и Шейн Легг. Уже в 2006 году прошёл воркшоп AGIRI с темой «Transitioning from Narrow AI to Artificial General Intelligence» — тогда всерьёз обсуждали переход от узкоспециализированных систем к более универсальному интеллекту.

При этом сама концепция «универсально мыслящей машины» появилась задолго до этого. Ещё в XX веке пионеры искусственного интеллекта стремились создать не просто инструменты для отдельных задач — вроде обработки текста или распознавания изображений, — а системы, способные мыслить широко и решать разнообразные проблемы.

Но именно в 2000-х годах AGI окончательно закрепился как отдельный термин и стал использоваться для обозначения этой более амбициозной цели.

Актуальное мнение учёных и специалистов по ML

Джеффри Хинтон говорит [4], что, во-первых, определения AGI плавают, и это не до конца технический термин. Во-вторых, в декабре 2024 года Хинтон говорил о вероятности в 10–20%, что ИИ может привести к вымиранию человечества в ближайшие 30 лет.

Демис Хассабис из Google DeepMind считает [5], что AGI как система, способная к настоящему научному открытию и постановке новых объяснений мира, может появиться через 5–10 лет.

Эндрю Ын, наоборот, в интервью [6] Fast Company сказал, что «настоящий AGI» — ИИ, способный выполнять весь спектр интеллектуальных задач человека, — остаётся делом десятилетий, а практическая ценность сейчас скорее в ИИ-агентах и прикладных системах.

Дата, когда AGI заменит человека

Почему вокруг AGI на Западе сформировался почти культ — причём с откровенно тревожным оттенком? Всё чаще в обсуждениях всплывает образ некого «всевидящего ИИ-прокуратора», который выходит из-под контроля.

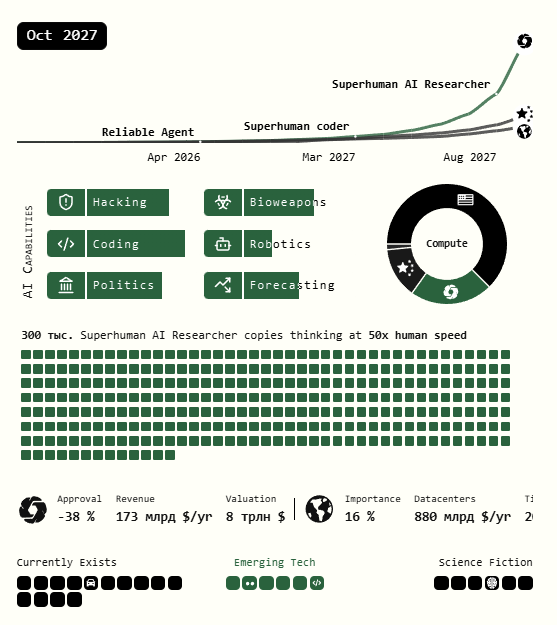

Одна из самых обсуждаемых «дат» последних месяцев — 2027 год. Она разошлась после публикации группы авторов во главе с бывшим сотрудником OpenAI Дэниелом Кокотайло. Их проект — это попытка не просто порассуждать, а дать более-менее конкретный сценарий развития ИИ с привязкой ко времени.

Дальше сработала классическая медийная цепная реакция [8]. Журнал Inc. в январе 2026 года вышел с громким заголовком в духе: «Эксперт по ИИ предсказал конец человечества к 2027 году — и теперь пересматривает сроки». В материале объяснялось, что в одной из версий сценария допускалось: уже к апрелю 2027 года неконтролируемый рост ИИ может привести к появлению суперинтеллекта и, в крайнем варианте, к гибели человечества.

Затем тему подхватил [9] The Guardian. В январе 2026 года издание написало, что в исходной версии AI 2027 рассматривалась развилка: после фазы автономного ускорения разработки ИИ один из сценариев ведёт к исчезновению людей уже к середине 2030-х. При этом сам Кокотайло позже скорректировал оценки — он сдвинул возможное появление суперинтеллекта ближе к 2034 году и отказался называть точные сроки каких-либо катастрофических исходов.

Итак

AGI всё ещё остаётся теоретической концепцией, но сами технологии уже подошли к уровню, где ИИ перестаёт быть просто инструментом и начинает выглядеть как реальный конкурент человеку — особенно в интеллектуальном труде.

Поэтому главный вопрос сегодня — не «появился ли AGI», а как быстро системы, приближающиеся к нему, начнут вытеснять людей из профессий и менять рынок труда.

Если хотите не отставать от этих изменений и понимать, куда всё движется, стоит следить за развитием нейросетей и учиться применять их на практике. Мы разбираем новые инструменты, объясняем тренды и показываем, как использовать ИИ так, чтобы оставаться востребованным.

Следите за обновлениями и оставайтесь на стороне тех, кто адаптируется быстрее — в такие периоды именно это и определяет, кто окажется впереди.

Автор: tsnis_journal

Источник [10]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/29764

URLs in this post:

[1] интеллекта: http://www.braintools.ru/article/7605

[2] обзоре: https://arxiv.org/html/2412.04503v1

[3] впервые предложил: https://www.wired.com/story/the-man-who-invented-agi

[4] говорит: https://www.theguardian.com/technology/2024/dec/27/godfather-of-ai-raises-odds-of-the-technology-wiping-out-humanity-over-next-30-years

[5] считает: https://time.com/7277608/demis-hassabis-interview-time100-2025/

[6] интервью: https://www.fastcompany.com/91499247/andrew-ng-agi-decades-away-interview

[7] https://ai-2027.com/: https://ai-2027.com/

[8] реакция: http://www.braintools.ru/article/1549

[9] подхватил: https://www.theguardian.com/technology/2026/jan/06/leading-ai-expert-delays-timeline-possible-destruction-humanity

[10] Источник: https://habr.com/ru/companies/tsnis/articles/1030998/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1030998

Нажмите здесь для печати.