NPU в ноутбуках: что меняется для тех, кто закупает корпоративную технику

Меня зовут Артем, я дата-инженер. В работе часто приходится выбирать: гонять вычисления в облаке или делать их ближе к данным, и у каждого варианта свои больные места. Но недавно ИИ-нагрузки начали переезжать с облачных GPU на обычные ноутбуки. Мне стало любопытно: что там на самом деле происходит?

ИИ все чаще работает прямо на ноутбуке, не в облаке. Microsoft вписала нейропроцессор в требования к Copilot+ PC. AMD и Intel встраивают NPU прямо в SoC. Часть задач, для которых раньше требовался серверный GPU, теперь выполняется локально — без отправки данных и без подписки.

За маркетинговой шумихой про «новый чип в чипе» скрывается интересный тренд: индустрия движется к гибридной архитектуре. Тяжелые вычисления остаются у облачных провайдеров, массовые задачи разъезжаются по устройствам сотрудников. Это меняет работу тех, кто закупает и обслуживает такой парк. Закупка теперь упирается в требования к памяти [1] и поддержку конкретных ИИ-фреймворков.

Появилась новая задача: доставлять и обновлять модели на устройствах — раньше ее просто не существовало. Горизонт планирования у ИТ-отделов при этом короче, чем кажется.

Я заинтересовался темой после одного бенчмарка [2]. NPU в ноутбуке AMD Ryzen AI 300 генерировал изображение 70 секунд, а встроенный GPU того же чипа справлялся за 30. Специализированный нейропроцессор проиграл универсальному вдвое на задаче, под которую его затачивали.

Через эту аномалию хорошо видно, как устроены три процессора в одном SoC и почему специализированное железо может проиграть универсальному даже на своей территории. Разберем: чем NPU отличается от соседей по чипу, почему все упирается в память, как LLM удается уместить на ноутбуке и что из этого реально работает в корпоративной среде уже сейчас.

CPU, NPU, GPU: три процессора под разные задачи

Сильная сторона CPU — логика [3] и ветвления. Несколько мощных ядер, каждое выполняет инструкции по очереди. Нейросеть же состоит из матричных умножений — тысяч однотипных операций подряд. Для такой задачи CPU оказывается слишком сложным.

С GPU история другая. Тысячи простых ядер работают по SIMD-принципу: одна инструкция — много данных. Как раз то, что нужно для матричных умножений. У GPU своя память (HBM на серверных, GDDR на дискретных картах), широкая шина, пропускная способность в разы выше, чем у системной DRAM. Эта связка — массовая параллельная арифметика плюс быстрая память — и сделала GPU основой ИИ-индустрии.

Серверные A100 и H100 — та же концепция, доведенная до предела: десятки тысяч тензорных ядер и HBM с пропускной способностью 2–3 ТБ/с. Но в ноутбуке GPU делит память и шину с CPU, теплопакет ограничен. Под ИИ-нагрузкой он съедает 30–40 ватт. На батарее — два-три часа работы, и ноутбук садится.

NPU устроен как GPU, из которого вырезали все лишнее. Нет растеризации [4], текстурных блоков, 3D-конвейера. Остались MAC-блоки (множитель-сумматор, базовая операция нейросети), близкая к ним SRAM и узкоспециализированный конвейер для тензорных операций с фиксированной точкой. На той же работе NPU укладывается в 5–10 ватт вместо 30–40 у GPU. Скорость тут вторична: главное — чтобы ноутбук не превращался в калорифер и не разряжался за два часа.

Почему NPU медленнее GPU

Маркетинг об этом молчит. NPU считает в INT8 — 8-битных целых числах, а серверный GPU чаще работает с FP32 (32-битная плавающая точка) или хотя бы FP16. Когда в презентации пишут «50 TOPS» — это 50 триллионов INT8-операций в секунду. Для сравнения: серверный V100 из 2017 года выдавал 125 TOPS в том же формате. NPU в ноутбуке 2026 года вдвое слабее серверного GPU семилетней давности по сырой мощности, зато энергоэффективнее в десять раз. Ради этого его и встраивают в SoC.

С TOPS как метрикой есть и более тонкая проблема. Реальная производительность зависит от того, какие операции NPU поддерживает (далеко не все справляются с attention и динамическими формами тензоров), от зрелости тулчейна и от оптимизации модели под конкретный чип. По публичным замерам, хорошо оптимизированный 45-TOPS Snapdragon X Elite на ряде Windows ИИ-задач обгоняет неоптимизированный 48-TOPS чип. Бумажные TOPS мало что говорят о реальной производительности.

Но и это не главное.

Memory wall

В 2026 году Дэвид Паттерсон, один из создателей RISC и лауреат премии Тьюринга, опубликовал в IEEE Computer работу [5] с неудобным для индустрии выводом: для инференса больших языковых моделей вычислительная мощность давно перестала быть узким местом. Узкое место — память и скорость доступа к ней.

Языковая модель генерирует текст токен за токеном. Для каждого нового токена вычислительные блоки должны загрузить все веса целиком. Модель на 7 миллиардов параметров в INT8 весит 7 ГБ. Эти 7 ГБ прокачиваются через шину памяти при каждом токене. Вычислительные блоки при этом большую часть времени просто ждут данные.

Пропускная способность памяти в ноутбуке с LPDDR5X — порядка 89–120 ГБ/с. У серверного A100 — 2 ТБ/с, у H100 — 3,35 ТБ/с. Разрыв в 20–40 раз. Сколько бы TOPS ни числилось у NPU на бумаге, данные не доезжают до него с нужной скоростью, и кремний простаивает в ожидании следующего фрагмента весов. Этот разрыв между скоростью вычислений и скоростью доступа к памяти и называют memory wall. Поэтому переход с 16-битных весов на 4-битные дает не четырехкратную экономию памяти, а четырехкратное ускорение генерации: через шину прокачивается вчетверо меньше байт.

Возвращаясь к бенчмарку, с которого я начал.

NPU AMD проиграл встроенному GPU не из-за слабых вычислений. Генерация изображений ложится на NPU-архитектуру намного хуже, чем инференс языковых моделей: и паттерн доступа к памяти, и набор операций тут другие — не те, под которые NPU оптимизировался. В цифрах TOPS этого вообще не видно.

Как модели все-таки впихивают в ноутбук

Раз главное ограничение — в памяти, оптимизировать имеет смысл именно ее. Этим занимается квантизация — перевод весов из FP16/FP32 в форматы с меньшей разрядностью: INT8, INT4, изредка INT2.

Еще в 2022 году считалось, что для генерации связного текста нужна модель как минимум на 7 миллиардов параметров. Сейчас модели меньше миллиарда справляются с суммаризацией, классификацией документов и ответами на вопросы по тексту.

Исследователи из Meta AI в работе MobileLLM [6] приходят к неочевидному выводу: на масштабах меньше миллиарда параметров качество модели определяется в первую очередь архитектурой, а не количеством параметров. Две модели с одинаковым числом параметров могут давать кратно разный результат — все зависит от того, как эти параметры разложены по слоям и attention-головам.

Стандартная идея «делать слои шире по мере роста модели» в этом диапазоне перестает работать. Приходится использовать другие подходы: глубокие узкие архитектуры, разделение весов между слоями, grouped-query attention [7].

Сама квантизация со временем тоже усложнилась. Mixed-precision quantization [8] квантует разные слои в разную точность: чувствительные оставляет в INT8, остальные сжимает до INT4. Баланс между качеством и скоростью оказывается заметно лучше, чем при равномерной квантизации.

Speculative decoding [9] обходит ограничение «один токен за проход» с другой стороны. Маленькая черновая модель быстро генерирует несколько токенов-кандидатов, основная модель проверяет их за один проход. Ускорение — двух-трехкратное, и любая маленькая draft-модель может ускорять любую большую, независимо от различий в словаре.

С KV-cache [10] тоже особая история. При генерации длинных текстов модель хранит промежуточные вычисления для всех предыдущих токенов. На больших контекстах этот кеш занимает памяти больше, чем сами веса. На ноутбуке с ограниченной RAM это особенно ощутимо, поэтому кеш режут разными способами: оставляют только «важные» токены, используют разную точность для разных голов attention, сжимают по семантическим блокам.

Совместный эффект всех этих оптимизаций: модели, которым два года назад нужен был серверный GPU, теперь запускаются на ноутбуке. Медленнее, с более коротким контекстом, но запускаются. Для задач, не требующих рассуждений уровня GPT-4 (а в корпоративной среде таких большинство), этого хватает.

Что работает сейчас, а что нет

Видеозвонки можно вынести за скобки — тут все работает достаточно уверенно. Windows Studio Effects [11] (шумоподавление, размытие фона, коррекция взгляда) выполняются целиком на NPU, CPU и GPU при этом свободны. Раньше размытие фона на слабых машинах заметно подлагивало, потому что GPU одновременно рендерил видео и обрабатывал эффекты. Сейчас этой проблемы нет, и во время созвона параллельно работает тяжелое приложение без потери качества картинки.

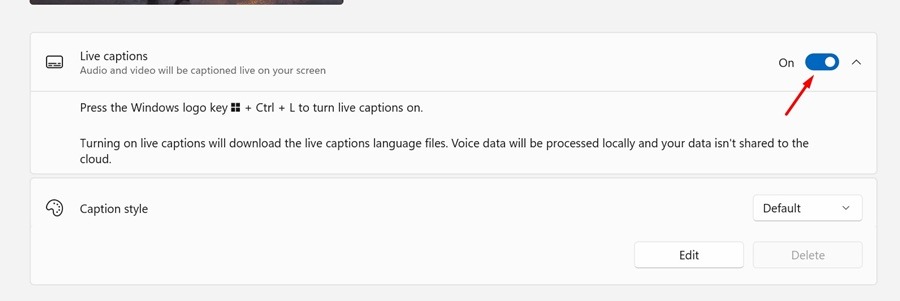

Live Captions переводят больше 40 языков на английский прямо на устройстве, в офлайн-режиме.

Для международных команд это рабочий сценарий: звонок с субтитрами и без отправки аудио наружу.

С Recall ситуация сложнее.

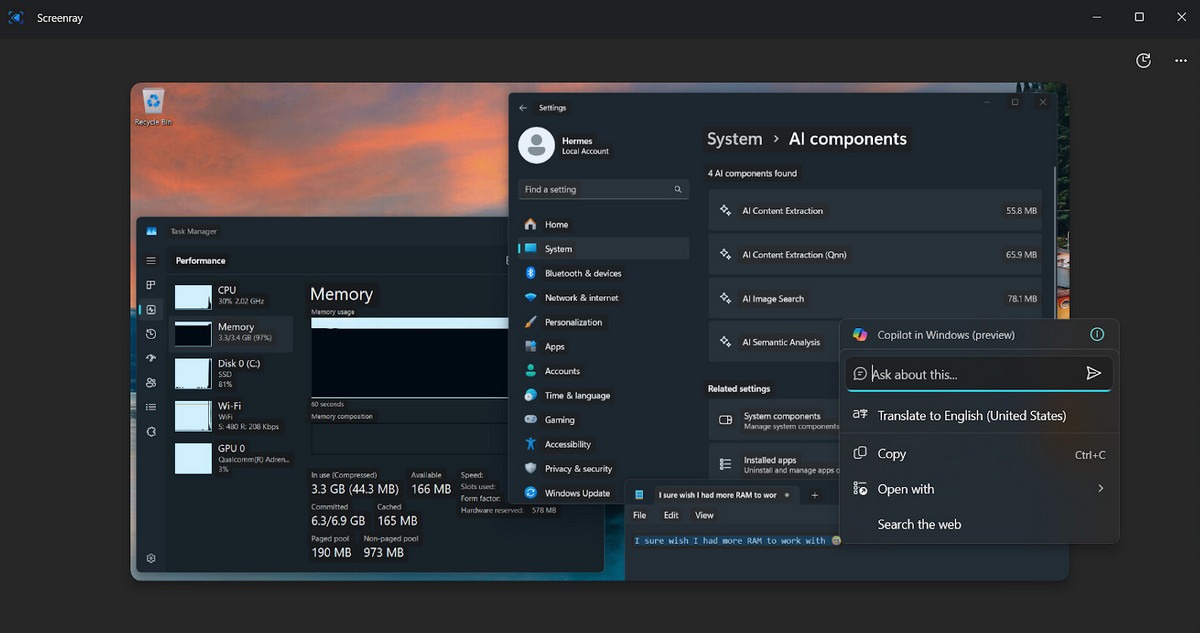

Windows каждые несколько секунд делает скриншот активного окна, NPU анализирует содержимое и строит семантический индекс. Дальше можно искать по описанию: «та таблица с квартальными результатами, которую я смотрел на прошлой неделе». Все локально, по умолчанию выключено, требуется аутентификация через Windows Hello.

На анонсе в 2024 году разразился скандал: скриншоты хранились незашифрованными, в базу попадали пароли. Microsoft переработала архитектуру, добавила шифрование, фильтрацию и интеграцию с Purview DLP, дала ИТ-администраторам контроль через Intune и Group Policy. В корпоративной Windows 11 Recall выключена по умолчанию. Технология сама по себе работает, но доверие к ней восстанавливается медленно.

Локальные LLM запускают через llama.cpp или ExecuTorch (runtime 50 КБ). Модели класса 7B (Llama, Mistral, Phi) на 32 ГБ RAM выдают 5–20 токенов в секунду, облачный API дает 30–100. Медленнее, зато автономно, без подписки и без отправки данных наружу. Суммаризация десятистраничного документа занимает 10–30 секунд.

В этом году поддержку NPU добавляют более 200 приложений. Adobe выгружает на NPU content-aware fill и автоматическое маскирование, DaVinci Resolve — видеоэффекты, LiquidText — аннотирование документов. Экосистема растет, хотя до зрелости CUDA ей пока далеко.

Дальше начинаются ограничения.

Модели крупнее 13-14B на типичном ноутбуке запустить проблематично. 7B в INT4 занимают 3,5 ГБ весов плюс KV-cache плюс overhead. На 32 ГБ RAM этого хватает, на 16 — уже впритык. GPT-4, Claude Opus, Gemini Ultra оперируют сотнями миллиардов параметров и в ноутбук не помещаются. Для глубокого рассуждения или контекста длиннее 100К токенов облако пока остается единственным вариантом. Модели меньше миллиарда параметров справляются с классификацией и суммаризацией, но для генерации сложного кода или разбора юридических текстов с нюансами им не хватает емкости.

Экосистема фрагментирована — и это, пожалуй, самая болезненная проблема. У GPU CUDA существует с 2007 года, PyTorch работает из коробки. У NPU единого стандарта нет: Intel продвигает OpenVINO, AMD использует Vitis AI, Qualcomm развивает AI Engine Direct, Apple делает Core ML. Microsoft пытается унифицировать все через Windows ML, который автоматически подбирает backend, но одна и та же модель на Intel и AMD ведет себя по-разному. Все это значит: нельзя просто «включить ИИ». Для каждой модели нужно проверять, как она поведет себя на конкретном чипе.

Гибридная архитектура как новая норма

Все перечисленное позволяет ноутбуку дополнять облачные сервисы. Индустрия движется к архитектуре, где рутинные задачи с чувствительными данными остаются на устройстве, а длинные контексты и сложные рассуждения уходят в облако. NPU не вытесняет облачный ИИ, он его разгружает — забирает массовые запросы, чтобы в облако уходили только действительно тяжелые.

Подталкивает к этому и экономика. Каждый запрос к облачному ИИ стоит денег, и расходы линейно масштабируются с числом пользователей. Дешевле эта история не становится: спрос на HBM для серверных GPU растет, провайдеры закладывают эти расходы в цену.

У NPU в ноутбуках экономическая модель совсем другая. Устройство уже куплено, NPU встроен в SoC, доплата за него почти символическая. Модели подгружаются один раз. Для задач, не требующих frontier-модели, инференс бесплатен. Если обработка данных в Excel на NPU экономит сотруднику полчаса в день, надбавка за AI PC окупается за несколько месяцев.

Что это значит для тех, кто закупает и обслуживает

Закупка техники усложняется. Сотруднику, который весь день в браузере, NPU почти ничего не меняет. Для аналитиков, юристов и разработчиков он открывает реальные сценарии, но при условии 32 ГБ RAM. Studio Effects и Live Captions работают и на 16, локальные модели — нет.

Если закупка корпоративных ноутбуков идет сейчас, имейте в виду: 7B в INT4 — это 3,5 ГБ весов, KV-cache растет с длиной контекста. После ОС с рабочим софтом на 16 ГБ для них уже не хватит места. Через два-три года это превратится в ограничение, которое будет неудобно объяснять руководству.

Появляется задача доставлять и обновлять модели на парк устройств. При облачном ИИ ее просто не существовало — всем занимался провайдер. Теперь нужны политики: какие модели разрешены, как они централизованно обновляются, что делать, если сотрудник скачал что-то непроверенное.

Для разработчиков, которые будут писать локальные ИИ-фичи внутри компании, рекомендуемый путь — Windows ML с моделями в ONNX. Из фреймворков доступны ONNX Runtime, ExecuTorch от Meta (тот самый 50-килобайтный runtime) и llama.cpp для прототипов.

Для квантизации используются GPTQ, AWQ и GGUF, у каждого свои компромиссы. Windows ML пытается быть универсальной абстракцией над разными NPU, но кастомные модели все равно могут потребовать оптимизации под конкретный чип. Если компания разрабатывает собственные ИИ-решения, привязка к вендору остается риском.

Горизонт планирования при этом не такой длинный, как может показаться. Текущих 40–50 TOPS хватает для компактных моделей и встроенных функций ОС. Следующее поколение чипов обещает 80–100+ TOPS. При таких мощностях и продолжающемся уменьшении моделей локально заработают вещи, которые сегодня требуют серверного GPU.

Параллельно идет другой тренд: то, что сегодня едва помещается в ноутбук, через пару поколений работает на смартфоне всего с парой гигабайтов RAM. SmolVLM-256M [12] от HuggingFace умещается меньше чем в гигабайт и при этом обгоняет модели в сотни раз тяжелее, Phi-3.5 [13] на 3,8 миллиарда параметров на ряде задач конкурирует с моделями в десятки раз крупнее, а Snapdragon 8 Elite NPU [14] выдает больше 100 токенов в секунду на оптимизированных SLM.

Рынок NPU в 2025 году оценивался в 178 миллионов долларов, прогноз до 2034 года — около 876 миллионов. Ноутбук, который сейчас закупается на четыре года, к концу срока службы окажется либо полноценным ИИ-устройством, либо явным узким местом. Решение по этой развилке принимается уже сейчас — независимо от того, осознанно или нет.

Автор: golangloves

Источник [15]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/30084

URLs in this post:

[1] памяти: http://www.braintools.ru/article/4140

[2] бенчмарка: https://ordinarytech.ca/blogs/news/on-device-ai-in-2026-how-npus-are-transforming-ai-pcs-for-creators-and-power-users-1

[3] логика: http://www.braintools.ru/article/7640

[4] растеризации: http://ru.wikipedia.org/wiki/%D0%A0%D0%B0%D1%81%D1%82%D0%B5%D1%80%D0%B8%D0%B7%D0%B0%D1%86%D0%B8%D1%8F

[5] работу: https://winbuzzer.com/2026/01/26/memory-bottleneck-llm-inference-hardware-challenge-xcxwbn/

[6] работе MobileLLM: https://arxiv.org/abs/2402.14905

[7] grouped-query attention: https://www.ibm.com/think/topics/grouped-query-attention

[8] Mixed-precision quantization: https://arxiv.org/abs/2412.03101

[9] Speculative decoding: https://research.google/blog/looking-back-at-speculative-decoding/

[10] KV-cache: https://habr.com/ru/companies/ru_mts/articles/1029644/

[11] Windows Studio Effects: https://support.microsoft.com/en-us/windows/windows-studio-effects-273c1fa8-2b3f-41b1-a587-7cc7a24b62d8

[12] SmolVLM-256M: https://huggingface.co/HuggingFaceTB/SmolVLM-256M-Instruct

[13] Phi-3.5: https://huggingface.co/microsoft/Phi-3.5-mini-instruct

[14] Snapdragon 8 Elite NPU: https://www.qualcomm.com/smartphones/products/8-series/snapdragon-8-elite-gen-5

[15] Источник: https://habr.com/ru/companies/ru_mts/articles/1033588/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1033588

Нажмите здесь для печати.