Чему именно учится word2vec?

Чему именно учится модель word2vec? Как она это делает? Ответы на эти вопросы мы поищем, анализируя то, как модель изучает представления данных при рассмотрении минималистичной, но достаточно актуальной задачи языкового моделирования. Модель word2vec — это широко известная предшественница современных языковых моделей. Но, несмотря на это, на протяжении долгих лет в распоряжении исследователей не было количественной прогностической теории, описывающей процесс обучения [1] модели. В нашей новой публикации [2] мы, наконец, представили общественности такую теорию. Мы доказали то, что существуют реалистичные, применимые на практике режимы, в которых задача обучения модели сводится к невзвешенной факторизации матриц с использованием метода наименьших квадратов. Мы занимаемся аналитическим моделированием градиентного потока. Представления данных, которые в итоге изучает модель, выводятся с помощью обычного метода главных компонент.

Прежде чем подробнее говорить о значимости этих результатов, обоснуем актуальность задачи. В основе моделей word2vec лежит широко известный алгоритм, благодаря которому модели способны изучать плотные векторные представления слов. Векторы эмбеддингов обучаются с использованием контрастивного алгоритма. После завершения обучения семантическая связь между любыми двумя словами выражается в виде угла между соответствующими эмбеддингами. На самом деле, геометрические характеристики изученных моделью эмбеддингов демонстрируют поразительную линейную структуру. Линейные подпространства в латентном пространстве часто кодируют идеи, которые поддаются интерпретации. Среди них — такие, как пол, время глагола, диалект. Это — так называемая гипотеза линейного представления реального мира, которая в последнее время привлекла к себе много внимания [3]. Дело в том, что большие языковые модели демонстрируют [4] аналогичное поведение [5], что позволяет проводить семантический анализ внутренних представлений данных [6] и даёт новые способы управления поведением моделей [7]. В модели word2vec именно эти линейные характеристики позволяют обученным эмбеддингам решать задачи на поиск аналогий (например: «мужчина : женщина :: король : королева») с помощью сложения векторов эмбеддингов.

Может, это и не должно выглядеть очень уж удивительным. В конце концов, алгоритм word2vec просто проходится по корпусу текстов и обучает двухслойную линейную нейросеть моделированию статистических закономерностей в естественном языке, используя градиентный спуск и обучение без учителя. При такой постановке вопроса очевидно то, что word2vec — это минимальная нейросетевая языковая модель. Получается, что знание о том, как работают модели word2vec, становится необходимым условием для понимания того, как происходит изучение признаков в данных при решении более сложных задач языкового моделирования.

Главный результат

Помня об особенностях и о важности рассматриваемой задачи, поговорим об основном результате нашего исследования. А именно, предположим, что мы инициализировали все векторы эмбеддингов случайными числами, находящимися очень близко к началу координат. При таком подходе они, по сути, имеют нулевую размерность. Далее (при некоторых небольших допущениях), эмбеддинги, все вместе, изучают по одному «концепту» (то есть — ортогональному линейному подпространству) за раз, проходя по последовательности дискретных шагов обучения.

Это похоже на то, как некто, как говорится, с головой погружается в изучение нового раздела математики [8]. Поначалу все специальные термины в его голове перемешаны. В чём, например, разница между функцией и функционалом? А как насчёт линейного оператора? Чем он отличается от матрицы? Постепенно, по мере погружения в новые интересные темы, человек начинает различать слова, их истинные значения становятся гораздо яснее, чем раньше.

Как результат — каждый новый изученный линейный концепт повышает ранг матрицы эмбеддингов, давая каждому словесному эмбеддингу больше места, где он сможет лучше выразить себя и свой смысл. Так как эти линейные подпространства, после того, как модель их изучит, не вращаются, они, по сути, выступают в роли признаков, которые изучила модель. Наша теория позволяет заранее, в аналитической форме, вычислять значения, формирующие каждый из этих признаков. Они — это просто собственные векторы некоей целевой матрицы, которая определяется исключительно измеримой статистикой корпуса текстов и гиперпараметрами алгоритма.

О каких признаках идёт речь?

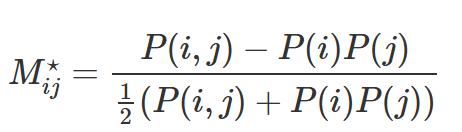

Ответ на вопрос, вынесенный в заголовок этого раздела, поразительно прост: латентные признаки — это просто старшие собственные векторы следующей матрицы:

Здесь i и j используются для индексирования слов в словаре, P(i,j) — вероятность совместной встречаемости слов i и j, а P(i) — это униграммная вероятность слова (то есть — маргинальная вероятность P(i,j)).

Если, основываясь на статистике Wikipedia, построить и диагонализовать эту матрицу, можно обнаружить, что старший собственный вектор соответствует словам, имеющим отношение к биографиям знаменитостей. Второй вектор соответствует словам, относящимся к государственному и муниципальному управлению, третий — словам, представляющим собой географические и картографические характеристики, и так далее.

Из всего этого можно сделать такой вывод: в ходе обучения модель word2vec обнаруживает последовательность оптимальных низкоранговых аппроксимаций матрицы M⋆. По сути, это эквивалентно применению метода главных компонент к M⋆.

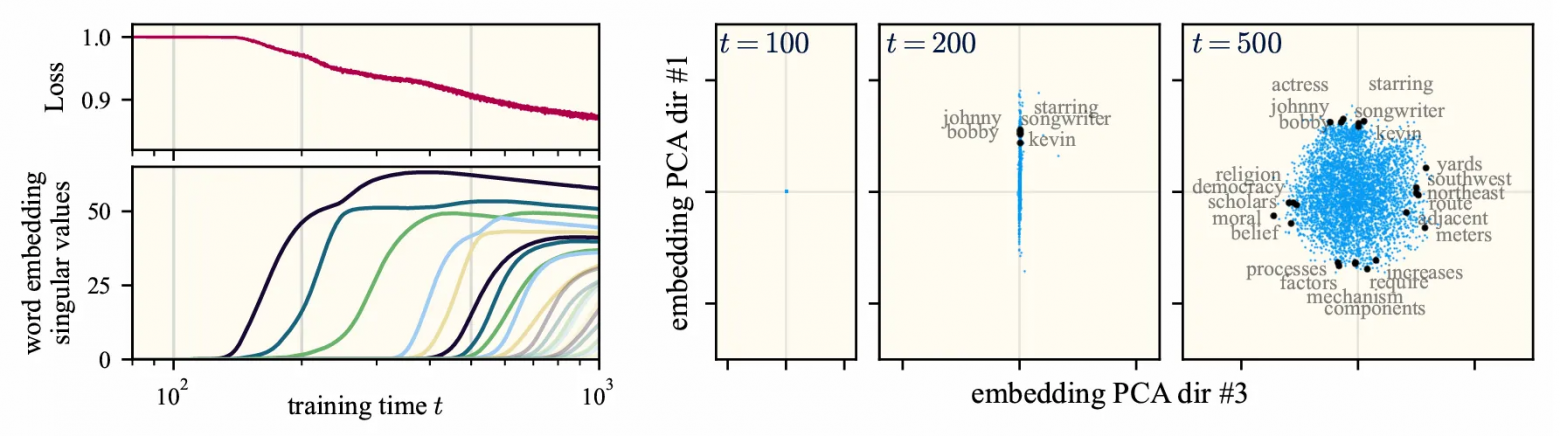

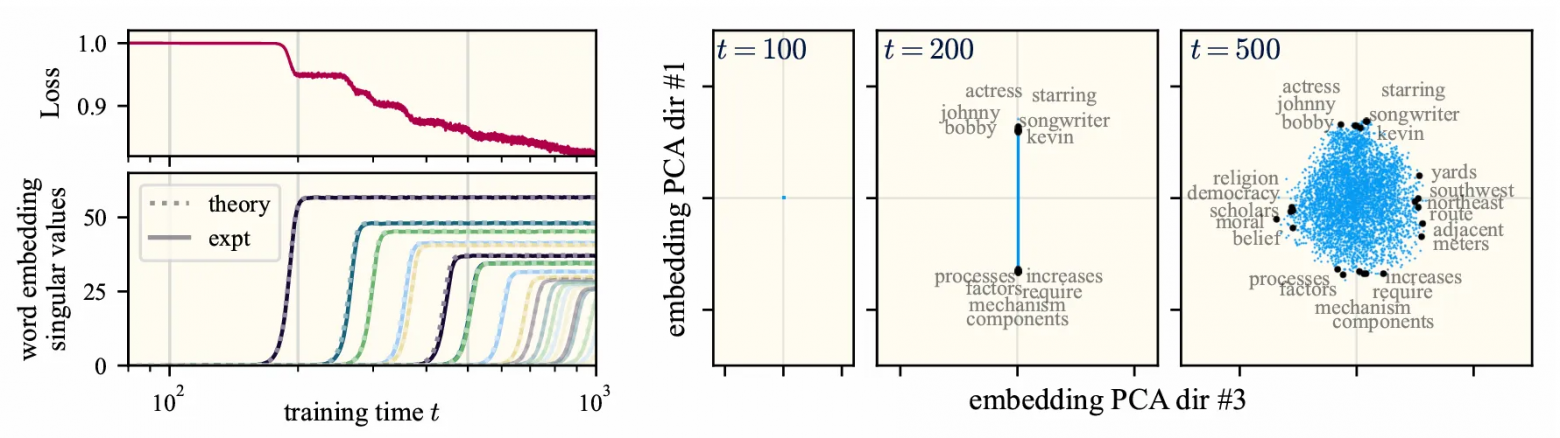

Такое поведение [9] модели показано на следующих схемах.

Слева показан результат основного эмпирического наблюдения, которое заключается в том, что word2vec (с учётом принятых нами небольших допущений) обучается, проходя последовательность дискретных шагов. Каждый шаг увеличивает эффективный ранг эмбеддингов, что приводит к ступенчатому снижению значения функции потерь. Справа показаны три временных среза латентного пространства эмбеддингов. Они демонстрируют то, как эмбеддинги на каждом шаге расширяются в новых ортогональных направлениях. Более того, изучая слова, которые сильнее всего связаны с этими уникальными направлениями, мы обнаружили, что каждый дискретный «фрагмент знаний» согласовывается с интерпретируемым тематическим концептом. Такая динамика обучения описывается в аналитической форме. Здесь мы наблюдаем отличное согласование теории и численного эксперимента.

А что представляют собой наши «небольшие допущения»? Во-первых — это аппроксимация четвёртого порядка для целевой функции в окрестности начала координат. Во вторых — особое ограничение алгоритмических гиперпараметров. В-третьих — достаточно малые исходные веса эмбеддингов. В-четвёртых — чрезвычайно маленькие шаги градиентного спуска. К счастью, эти условия не слишком строги и, на самом деле, они очень похожи на параметры, описанные в исходной работе по word2vec.

Важно то, что ни одно из «допущений» не затрагивает распределение данных! И действительно — огромный плюс нашей теории заключается в том, что в её рамках не делается никаких предположений, касающихся распределений. В результате теория, основываясь на статистических особенностях корпуса текстов и на особенностях гиперпараметров алгоритма, способна точно спрогнозировать то, какие именно признаки будут изучены моделью. Это особенно полезно, так как детальные описания динамики обучения в условиях, не зависящих от распределения, редки и их трудно раздобыть. Это, по нашим сведениям, первое подобное исследование, касающееся практической задачи, связанной с обработкой естественного языка.

Если говорить о принятых нами «допущениях», то можно сказать, что мы эмпирически показываем то, что наши теоретические результаты дают достоверное описание исходной модели word2vec. Грубым показателем соответствия наших приблизительных параметров реальной модели word2vec может служить сравнение практических результатов в стандартном бенчмарке на поиск аналогий. Так, word2vec достигает точности 68%, а изученная нами модель, с учётом всех допущений, достигает точности в 66%. Классический метод поиска аналогий (PPMI, Positive Pointwise Mutual Information, положительная поточечная взаимная информация) отличается точностью лишь в 51%. Подробности об этом, снабжённые соответствующими иллюстрациями, вы можете найти в нашей публикации.

Для того чтобы продемонстрировать полезность полученных результатов, мы использовали нашу теорию для изучения возникновения абстрактных линейных представлений (соответствующих бинарным концептам, вроде мужской/женский, или прошлое/будущее). Мы выяснили, что модель word2vec строит соответствующие линейные представления, проходя последовательность «шумных» шагов обучения. Их геометрические характеристики хорошо описываются моделью «шипастой» случайной матрицы (spiked random matrix). Для ранних этапов обучения характерно доминирование семантического сигнала. А вот позже инициативу может перехватить шум, что приводит к ухудшению возможностей модели по различению линейных представлений.

Итоги

Полученный результат даёт нам одну из первых полноценных аналитических теорий обучения признаков, исследованной на минималистичной, но вполне реальной задаче, касающейся обработки естественного языка. В этом смысле мы надеемся на то, что наша работа станет важным шагом к более масштабным проектам. К таким, которые направлены на получение реалистичных аналитических решений, описывающих особенности работы алгоритмов машинного обучения, применяемых на практике.

О, а приходите к нам работать? 🤗 💰

Мы в wunderfund.io [10] занимаемся высокочастотной алготорговлей [11] с 2014 года. Высокочастотная торговля — это непрерывное соревнование лучших программистов и математиков всего мира. Присоединившись к нам, вы станете частью этой увлекательной схватки.

Мы предлагаем интересные и сложные задачи по анализу данных и low latency разработке для увлеченных исследователей и программистов. Гибкий график и никакой бюрократии, решения быстро принимаются и воплощаются в жизнь.

Сейчас мы ищем плюсовиков, питонистов, дата-инженеров и мл-рисерчеров.

Автор: mr-pickles

Источник [13]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/30222

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] публикации: https://arxiv.org/abs/2502.09863

[3] внимания: http://www.braintools.ru/article/7595

[4] большие языковые модели демонстрируют: https://arxiv.org/abs/2311.03658

[5] поведение: http://www.braintools.ru/article/9372

[6] семантический анализ внутренних представлений данных: https://arxiv.org/abs/2309.00941

[7] новые способы управления поведением моделей: https://arxiv.org/abs/2310.01405

[8] математики: http://www.braintools.ru/article/7620

[9] поведение: http://www.braintools.ru/article/5593

[10] wunderfund.io: http://wunderfund.io

[11] высокочастотной алготорговлей: https://en.wikipedia.org/wiki/High-frequency%5C%5C%5C_trading

[12] Присоединяйтесь к нашей команде: http://wunderfund.io/#join%5C%5C%5C_us

[13] Источник: https://habr.com/ru/companies/wunderfund/articles/1031042/?utm_source=habrahabr&utm_medium=rss&utm_campaign=1031042

Нажмите здесь для печати.