10 мифов или заблуждений об искусственном интеллекте

Большинство из вас, читающих эту статью сегодня, вероятно, не слишком много знали об искусственном интеллекте четыре года назад. Даже если вы слышали об искусственном интеллекте, вы, скорее всего, не задумывались о нем.

На самом деле, согласно недавнему исследованию, 90% американцев заявили, что до 2023 года они почти ничего не знали об искусственном интеллекте [2]. В то время искусственный интеллект не привлекал к себе особого внимания [3]: это была всего лишь одна из сотен новых технологий, представленных технологической индустрии, – ничего особенного.

Но если перенестись на 3-5 лет вперед, можно понять, насколько сильно ИИ меняет нашу повседневную жизнь. Но за то короткое время, что мир ИИ стал известен всему миру, появилось множество мифов о нем. Сегодня я собираюсь их развенчать. Вот 10 самых правдоподобных и шокирующих мифов об ИИ, собранных специально для вас:

Миф № 1: ИИ мыслит как человек

Многие люди считают, что ИИ-модели мыслят точно так же или очень похоже на людей. Но на самом деле ИИ-системы работают и принимают решения, следуя алгоритмам, полученным данным и запрограммированной логике [4]. В отличие от людей, которые мыслят творчески и эмоционально, ИИ не обладает сознанием и самосознанием.

Например, несмотря на то, что ИИ может писать стихи или сочинять музыку, он делает это на основе анализа информации, а не на основе личных эмоций [5] или жизненного опыта [6]. Это ограничение связано с тем, как устроен ИИ.

Нейросети, лежащие в основе многих современных ИИ-систем, смоделированы по образцу человеческого мозга, но не воспроизводят сознание или самостоятельное мышление [7].

Одна из самых популярных моделей машинного обучения [8], используемых в ИИ-системах, называется нейронными сетями. Нейронные сети были созданы для того, чтобы функционировать подобно нейронам в человеческом мозге, передавая информацию через множество узлов для выполнения определенной задачи.

Однако, хотя нейронные сети и были призваны копировать мозг, они не воспроизводят человеческий мыслительный процесс, сознание, эмоции [9], интуицию [10] и т. д. Они просто выполняют задачи и передают информацию так же, как это делают нейроны [11] в человеческом мозге. Таким образом, ИИ-системы пока не могут мыслить как люди.

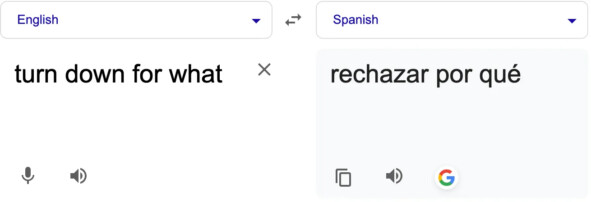

Кажущийся интеллект у ИИ часто принимают за реальное понимание. Когда ИИ переводит текст с одного языка на другой, он выполняет задачу, основанную на распознавании образов, статистике и идентификации данных из своего набора различных языков. Он не понимает тонкостей языка в его культурном или контекстуальном использовании. Именно поэтому переводчик Google Translate, представляющий собой ИИ-модель, иногда ошибается и неверно переводит значение распространенных фраз, идиом или метафор.

Только взгляните на эту ошибку [12] в Google Translate на изображении выше. ИИ-модель, управляющая им, ошибочно переводит популярную английскую фразу в песне «turn down for what» в «rechazar por qué» на испанском, что означает «отвергнуть почему». Она берет буквальное значение каждого слова и переводит его на выбранный язык. При этом контекст не учитывается (в данном случае). Изображение автора.

Это различие показывает, почему ИИ никогда не сможет по-настоящему повторить человеческое мышление. Это инструмент, предназначенный для расширения человеческих возможностей, а не для их замены. Так что пока не стоит пугаться восстания машин. Это подводит нас ко второму мифу…

Миф № 2: ИИ в конце концов захватит мир

С господством ИИ связано больше фантазий, чем фактов. ИИ работает в рамках параметров, заданных человеком. Хотя GPT-4 и другие продвинутые модели могут работать как люди, они не обладают такой способностью к автономии или осуществлению замыслов. В большинстве случаев страх [13] перед тем, что ИИ завоюет Землю и превратится в наших верховных злых повелителей, – это скорее пропаганда голливудских фильмов и выдуманных историй, чем реальное состояние технологий на данный момент.

ИИ, вероятно, не захватит мир в ближайшее время, по крайней мере, не в наше время. Причина? Он просто не сможет. ИИ и близко не способен даже всегда правильно сгенерировать изображение рук, не говоря уже о том, чтобы захватить весь мир. Если говорить начистоту, то это больше похоже на шутку, чем на реалистичное предположение. Эта концепция просто популяризируется в фильмах, научно-фантастических рассказах и книгах. Пока что ИИ не способен выполнить такую невероятную задачу

Существует 2 типа моделей ИИ – узкие ИИ и общие ИИ. По состоянию на 2025 год почти все ИИ-модели, которые вы используете и наблюдаете за тем, как используют другие люди, – это узкие ИИ. Эти модели способны выполнять только несколько конкретных задач или целей. Например, ChatGPT и Google Gemini относятся к узким моделям ИИ, поскольку они запрограммированы на максимально точный ответ на промпты пользователей.

Общий ИИ создать крайне сложно, и существует лишь небольшое количество таких моделей. Этот тип ИИ способен выполнять широкий спектр задач. Только ИИ-модели общего назначения имеют хотя бы небольшой шанс захватить мир.

ИИ пока не способны сотрудничать друг с другом и захватить мир людей. Они просто не запрограммированы на это, недостаточно умны для этого, а главное – у них нет для этого возможностей. Кроме того, даже самые совершенные, безопасные и чистые компьютеры и ИИ-боты должны обслуживаться людьми. В противном случае они будут вынуждены полагаться на ошибочные данные или вообще перестанут функционировать.

Тревога по поводу несанкционированного ИИ почти всегда игнорирует совместные проверки, проводимые при его создании, и привлекает людей, которые разрабатывают этический набор рекомендаций с помощью значительных технических средств и регулярных тщательных тестов. Поэтому он придерживается именно человеческих желаний в отношении технологии.

Миф 3: ИИ всегда справедлив

Многие полагают, что, поскольку ИИ обладает большим объемом информации и знаний, он всегда справедлив в принятии решений. Однако это не всегда так. ИИ может обнаружить предвзятость в данных, на которых он обучался. Если в обучающих данных содержатся общественные предрассудки, то результаты работы ИИ будут их отражать. Например, некоторые алгоритмы распознавания лиц попали под удар из-за того, что они имеют более высокий процент ошибок при идентификации лиц из числа меньшинств.

В любом случае, основная проблема, вызывающая подобную предвзятость, – это исторические данные, на которых обучается ИИ, которые уже так или иначе предвзяты. Если ИИ-система обучена на данных о приеме на работу в компании, которая всегда отдавала предпочтение определенным демографическим группам, она вполне может распространить эти предубеждения на свои рекомендации. Бороться с такими предубеждениями можно только с помощью тщательной обработки данных для обучения, постоянного аудита и четкой отчетности.

Большинство людей не знают об этом, но предвзятость в ИИ-моделях – довольно большая проблема в мире ИИ. Это ненужная дискриминация по отношению к определенным людям. Разработчики и другие сотрудники крупных компаний активно пытаются решить эту проблему, тщательно отбирая данные для включения в наборы обучающих данных своих ИИ-моделей, чтобы исключить предвзятость при взаимодействии.

Миф 4: ИИ заменит все рабочие места

Хотя ИИ автоматизирует некоторые задачи, он не заменит целые профессии. Наоборот, он изменит характер работы. Профессии, требующие решения проблем, эмоционального интеллекта и творческого подхода, в том числе преподавание, здравоохранение и руководство, не обязательно будут автоматизированы.

История повторяется

Во время промышленной революции люди думали, что машины полностью устранят необходимость в человеческом труде. На самом деле произошел бум в промышленности, создании рабочих мест и занятости. Таким образом, ИИ лишь дополнит возможности человека, а не вытеснит его. Возьмем пример журналистики. С появлением ИИ-инструментов, которые помогают проверять факты или анализировать данные, журналист может потратить время на более ценные виды деятельности: написание историй и расследования.

Посмотрите на этого строителя. Посмотрите на тяжелую трубу, которую он поднимает на плече, и на тяжелый труд, который он выполняет каждый день на своей работе. Как вы думаете, сможет ли ИИ заменить его работу? Ни в коем случае. Почти все виды работ в мире слишком сложны, чтобы их мог выполнять искусственный интеллект. Даже те, которые могут быть автоматизированы, не приведут к массовой безработице, а создадут новые вакансии на более ответственных должностях, на которых люди смогут сконцентрироваться.

ИИ создаст новые возможности, требуя от людей адаптации и приобретения новых навыков, чтобы они могли преуспевать наряду с машинами. Подготовка к этому переходу потребует инвестиций в образование, переквалификацию и культуру обучения на протяжении всей жизни. ИИ, автоматизирующий рабочие места, просто расширит возможности человечества для новых, более сложных проектов, которые ИИ никогда не сможет выполнить.

Миф 5: ИИ – это недавнее изобретение

Как я уже говорил ранее, большинство из вас, вероятно, даже не слышали об ИИ до 2022 или 2023 года, то есть примерно до того момента, когда ChatGPT стал использоваться во всем мире и начался бум ИИ. Сейчас, с каждым годом, в мире появляется все больше и больше ИИ, появляются новые современные чат-боты, такие как Google Gemini, Claude и даже Perplexity AI.

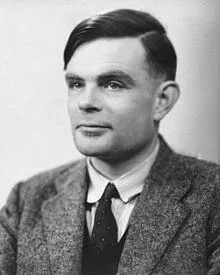

Однако большинство людей не знают, что термин «искусственный интеллект» был впервые использован в середине двадцатого века – в 1950-60-х годах. Группа влиятельных ученых-компьютерщиков и исследователей того времени работала над созданием концепции искусственного интеллекта более чем за 50 лет до того, как она стала всемирно известной. Среди этих пионеров были Алан Тьюринг [14], Джон Маккарти [15], Марвин Мински [16], Аллен Ньюэлл [17] и Герберт А. Саймон [18].

Начиная с самого примитивного «Logic Theorist [19]», который был первой компьютерной программой с автоматическим рассуждением в 1956 году, или «General Problem Solver [20]», еще одной ранней компьютерной программы, ранние ИИ-системы запустили в движение многие десятилетия неутомимых инноваций.

Начиная с больших данных и экспоненциального роста вычислительных мощностей, последние два десятилетия действительно ускорили темпы развития ИИ. Глубокое обучение и нейронные сети изменили машинное обучение, способствуя развитию обработки естественного языка и распознавания изображений.

Большинство людей не знают, что искусственный интеллект существует уже очень давно, ведь впервые он был представлен более 70 лет назад! Однако только в наше время он стал оказывать чрезвычайно широкое глобальное влияние на миллионы людей благодаря все большему развитию технологий и совместной работе людей и ИИ.

Миф 6: ИИ идеально понимает контекст

Предположение о том, что ИИ прекрасно понимает контекст, очень редко соответствует действительности. ИИ не хватает нюансов и контекста, особенно когда речь идет о языке. Чатбот может неправильно истолковать сарказм или не понять риторические вопросы. Такие модели, как GPT-4o и Google Gemini, довольно продвинуты, но они не понимают смысл так, как это делают люди; у них нет опыта реальной человеческой речи и ее атрибутов, таких как сарказм, ирония, акцентирование и т. д.

Большинство ИИ-моделей, с которыми мы взаимодействуем, часто не могут хорошо понимать контекст. Из-за этого они не могут правильно понять другие особенности человеческой речи, такие как ирония, риторические вопросы и т. д. Это происходит потому, что практически невозможно запрограммировать ИИ-модель, способную понимать эти особенности. Несколько обычных людей сами с трудом понимают этот тип речи, не говоря уже об ИИ-моделях.

Контекстный анализ является ограничением для ИИ-систем, поскольку он опирается на статистическую модель, а не на подлинное понимание или осмысление. Хотя ИИ может устанавливать корреляции и оценивать наиболее вероятные события на основе прошлых данных и прогнозов, ему не хватает той культурной, эмоциональной и опытной основы, на которой базируется человеческая интерпретация контекста. Это происходит, когда ИИ-инструменты не могут адаптироваться к нестандартным ситуациям или дают неуместные рекомендации.

Знание ограничений ИИ помогает установить реалистичные ожидания от его использования в общении и принятии решений. Разработчики должны продолжать совершенствовать ИИ-системы, чтобы они лучше справлялись с нестандартными ситуациями и лучше понимали контекст.

Миф 7: ИИ предназначен только для технологических компаний

ИИ находит применение практически во всех сферах – от сельского хозяйства и здравоохранения до розничной торговли и даже образования. Например, фермеры используют ИИ для мониторинга состояния посевов, а преподаватели – для разработки учебных материалов.

Современные педагоги используют ИИ в классах, чтобы сделать процесс обучения учащихся намного проще, эффективнее и результативнее. Приобщение детей к среде, наполненной искусственным интеллектом, с раннего возраста учит их тому, как он может использоваться, как он практичен и как он может изменить мир. ИИ в образовании – лишь один из многих примеров, доказывающих, что ИИ нужен не только крупным технологическим компаниям – он доступен каждому, в любом месте и в любое время. Все, что вам нужно, – это любое устройство и подключение к Интернету.

Универсальность ИИ обусловлена тем, что он достаточно эффективно анализирует данные на предмет выявления закономерностей. Благодаря этому свойству его можно использовать в самых разных областях и сценариях. Молодые студенты даже используют ИИ в повседневной жизни, чтобы помочь им с выполнением домашнего задания, получить ответы на вопросы по определенным аспектам, а также помочь им получить больше знаний о мире, который им еще предстоит изучить.

ИИ не является уделом технологических гигантов. Поскольку он может решать проблемы и делать другие процессы более эффективными, он имеет ценность в сотнях различных областей. Малые предприятия и стартапы также могут использовать ИИ, чтобы опередить своих конкурентов.

Малые предприятия и стартапы также могут использовать ИИ, чтобы обойти своих конкурентов. Вместо того чтобы анализировать сотни записей в старой книге, сотрудник может просто найти цифровую копию книги и загрузить данные в ИИ, чтобы тот сделал всю работу вместо него. Таким образом, можно сэкономить массу времени для выполнения более важных задач. ИИ можно использовать даже в таких мелких задачах, чтобы облегчить нашу жизнь.

Миф 8: ИИ всегда становится умнее со временем

Системы искусственного интеллекта не самосовершенствуются, по крайней мере, редко. Они требуют постоянного обучения с использованием новых данных и усовершенствованных алгоритмов для повышения производительности. Без вмешательства человека ИИ статичен. Его данные остаются ошибочными, старыми и неточными. Кроме того, алгоритмы и код становятся бесполезными и устаревшими с течением времени и появлением более совершенных технологий.

Алгоритм рекомендаций потокового сервиса потеряет актуальность, если его не обновлять, моделируя предпочтения пользователей или новые тенденции в контенте. Именно поэтому люди следят за тем, чтобы в обучающие данные ИИ-моделей вносились отзывы, а также адаптируют их к меняющимся условиям.

Если люди не будут постоянно обслуживать ИИ-модель, обновлять ее код и расширять набор данных, она начнет устаревать и в конечном итоге полностью потеряет актуальность, став в какой-то степени бесполезной по мере появления более совершенных, практичных и эффективных технологий.

Человеческий опыт по-прежнему играет важную роль в создании и поддержании работы ИИ-систем, в отличие от самосовершенствующихся и автономных машин. Это также один из главных примеров того, как люди и ИИ работают вместе. ИИ помогает людям узнавать больше и делать нашу жизнь проще, а люди помогают создавать и поддерживать эти ИИ, чтобы они продолжали это делать.

Миф 9: ИИ никогда не ошибается

ИИ далеко не безошибочен. Он склонен к ошибкам, особенно если данные вводятся неполные или неоднозначные. Например, медицинская диагностика с помощью ИИ иногда неверно интерпретирует симптомы, что свидетельствует о необходимости человеческого контроля.

Большинство сбоев в работе ИИ связано с ограничениями в обучающих данных или гипотетическими ситуациями. Автономный автомобиль может столкнуться с проблемами при движении по дорогам с необычной инфраструктурой или состоянием, а также с неопределенностью человеческого поведения [21]. Знание таких слабых мест имеет решающее значение для ответственного использования ИИ. Доверие к ИИ всегда должно сочетаться с осознанием его недостатков и проблем.

Миф 10: Все принимают ИИ

Взгляды на ИИ варьируются от любви к его потенциалу до скептицизма и страха. Это тема, которая касается всего: от этических дилемм при принятии решений до потери работы и проблем с конфиденциальностью.

По состоянию на 2025 год общественность относится к ИИ неоднозначно, испытывая как страх, так и одобрение новой технологии. Хотя ИИ действительно обладает как хорошим потенциалом, так и плохими характеристиками, человечество все еще взвешивает обе точки зрения [22], чтобы увидеть, как эта передовая технология проявит себя в ближайшем будущем.

Обе эти противоречивые реакции [23] свидетельствуют о более широких общественных дискуссиях о роли технологий в формировании нашего будущего. Прозрачность, образование и этические нормы необходимы для того, чтобы не было недоверия и заблуждений. В открытом обсуждении все заинтересованные стороны смогут ориентироваться в проблемах и возможностях, которые открывает ИИ.

Проще говоря, ИИ не является общепризнанным.

Это десятый и последний миф об ИИ в этом списке. Обязательно расскажите об этих мифах, чтобы остановить широко распространенную дезинформацию об ИИ и помочь человечеству вместе построить лучшее будущее.

Автор: NeyroEntuziast

Источник [24]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/11695

URLs in this post:

[1] интеллекте: http://www.braintools.ru/article/7605

[2] 90% американцев заявили, что до 2023 года они почти ничего не знали об искусственном интеллекте: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fwww.pewresearch.org%2Fshort-reads%2F2023%2F11%2F21%2Fwhat-the-data-says-about-americans-views-of-artificial-intelligence%2F&postId=1783268

[3] внимания: http://www.braintools.ru/article/7595

[4] логике: http://www.braintools.ru/article/7640

[5] эмоций: http://www.braintools.ru/article/9540

[6] опыта: http://www.braintools.ru/article/6952

[7] мышление: http://www.braintools.ru/thinking

[8] обучения: http://www.braintools.ru/article/5125

[9] эмоции: http://www.braintools.ru/article/9387

[10] интуицию: http://www.braintools.ru/article/6929

[11] нейроны: http://www.braintools.ru/article/9161

[12] ошибку: http://www.braintools.ru/article/4192

[13] страх: http://www.braintools.ru/article/6134

[14] Алан Тьюринг: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FAlan_Turing&postId=1783268

[15] Джон Маккарти: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FJohn_McCarthy_%28computer_scientist%29&postId=1783268

[16] Марвин Мински: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FMarvin_Minsky&postId=1783268

[17] Аллен Ньюэлл: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FAllen_Newell&postId=1783268

[18] Герберт А. Саймон: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FHerbert_A._Simon&postId=1783268

[19] Logic Theorist: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FLogic_Theorist&postId=1783268

[20] General Problem Solver: https://api.vc.ru/v2.8/redirect?to=https%3A%2F%2Fen.wikipedia.org%2Fwiki%2FGeneral_Problem_Solver&postId=1783268

[21] поведения: http://www.braintools.ru/article/9372

[22] зрения: http://www.braintools.ru/article/6238

[23] реакции: http://www.braintools.ru/article/1549

[24] Источник: https://habr.com/ru/articles/877944/?utm_source=habrahabr&utm_medium=rss&utm_campaign=877944

Нажмите здесь для печати.