Топ-5 ошибок при обучении нейросетей (и как их исправить, если вы новичок)

Привет! Я не так давно занимаюсь искусственным интеллектом [1]. Когда я только начинал, мне казалось, что всё это — какая-то магия: ты загружаешь данные, запускаешь код, и вуаля — модель работает! Но потом я понял, что это больше похоже на кулинарию: если не следовать рецепту или использовать плохие ингредиенты, результат будет… мягко говоря, несъедобным. 😅

В этой статье я расскажу о пяти самых распространённых ошибках, которые допускают люди при обучении [2] нейросетей. И самое главное — объясню, как их избежать, даже если вы совсем новичок.

1. Недостаточный объем или некачественные данные

Давайте начнём с самого важного: данных. Представьте, что вы учитесь готовить пиццу. Если у вас нет ни муки, ни сыра, ни даже сковородки, то шансов сделать что-то вкусное практически нет. Точно так же и с нейросетями: если у вас мало данных или они плохого качества, модель просто не сможет научиться.

Моя история:

Однажды я решил обучить модель различать кошек и собак. У меня было всего 50 фотографий, причём половина из них была сделана в темноте. В итоге модель решила, что все кошки — это собаки. Почему? Потому что она просто не видела достаточно примеров, чтобы понять разницу.

Что делать?

-

Добавьте больше данных. Чем больше примеров, тем лучше модель учится. Если данных мало, используйте датаугментацию: например, поворачивайте изображения или изменяйте их цвет. Это как превратить одного кота в десять разных котов. 🐱

-

Проверяйте качество данных. Убедитесь, что метки правильные. Например, если вы случайно пометили всех собак как кошек, модель будет путаться.

-

Балансируйте классы. Если у вас 1000 фото собак и всего 100 фото кошек, модель будет чаще “угадывать” собак. Чтобы этого избежать, увеличьте количество примеров для меньшего класса (oversampling).

2. Неправильный выбор архитектуры модели

Когда я только начинал, я думал, что чем сложнее модель, тем лучше. Однажды я взял огромную архитектуру ResNet-50 (это как огромная кухня со всеми возможными гаджетами) и попытался обучить её на маленьком датасете. Результат? Модель переобучилась и начала “зубрить” данные вместо того, чтобы учиться обобщать.

Как избежать?

-

Начинайте с простого. Если задача решается линейной регрессией, не нужно городить огромную нейросеть.

-

Используйте предобученные модели. Transfer learning — это как взять готовый рецепт и немного его адаптировать под свои нужды. Например, возьмите BERT для работы с текстами или VGG для работы с изображениями.

-

Экспериментируйте. Попробуйте разные архитектуры и посмотрите, какая из них работает лучше.

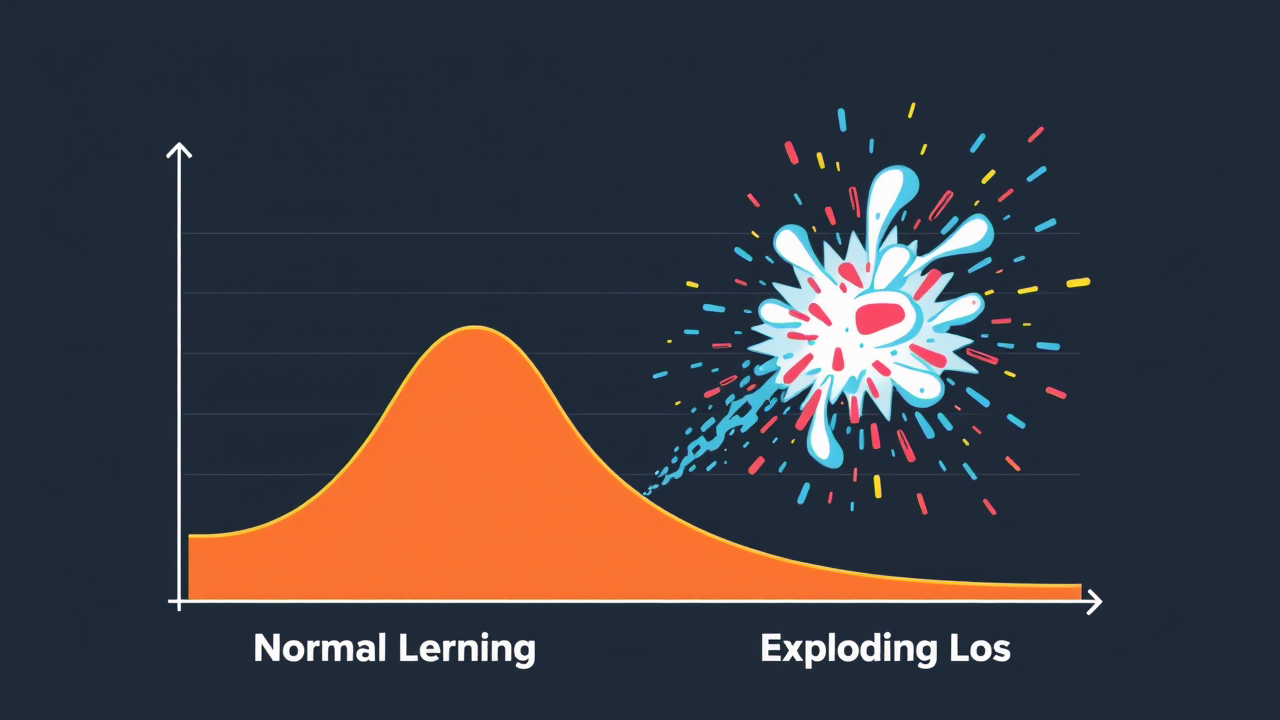

3. Неправильная настройка гиперпараметров

Гиперпараметры — это такие “регуляторы”, которые влияют на процесс обучения. Например, learning rate (скорость обучения) определяет, насколько быстро модель учится. Однажды я установил слишком высокий learning rate, и модель просто “взорвалась”. Loss (ошибка [3]) вырос до бесконечности, и я понял, что где-то явно накосячил.

Как избежать?

-

Начинайте с рекомендованных значений. Для Adam optimizer learning rate = 0.001 — хорошая отправная точка.

-

Используйте автоматические методы подбора. Например, Grid Search или Random Search помогут найти оптимальные параметры.

-

Мониторьте графики обучения. Если loss не уменьшается, а accuracy стоит на месте, пора менять параметры.

4. Пренебрежение валидацией

Идея для изображения:

-

Человек, который тренируется на экзаменационных билетах, а потом удивляется, что реальный экзамен совсем другой.

-

Альтернатива: две коробки с надписями “Training Data” и “Test Data”, где первая полна, а вторая пуста.

Как реализовать:

-

Нарисуйте простую иллюстрацию в Canva или Procreate .

-

Или используйте DALL·E : запросите “a person studying exam answers but surprised on real test day”.

5. Игнорирование интерпретируемости модели

Представьте, что ваша модель говорит: “Это кот.” Но почему? Как она это поняла? Иногда это кажется магией, но на самом деле есть способы разобраться.

Как избежать?

-

Используйте инструменты вроде SHAP или LIME. Они помогают понять, какие признаки влияют на решения модели.

-

Анализируйте важность признаков. Например, если вы работаете с изображениями, посмотрите, на что именно модель обращает внимание [4].

-

Визуализируйте всё, что можно. Графики, диаграммы, карты — чем больше, тем лучше.

Заключение

Эта статья — не подробное руководство, а скорее краткий разбор моего личного опыта [5] в обучении нейросетей. Я собрал здесь пять ошибок, которые чаще всего встречаются у новичков (и иногда даже у опытных разработчиков), чтобы помочь вам избежать хотя бы некоторых подводных камней. Надеюсь, эти советы сэкономят вам время и нервы.

Конечно, в машинном обучении всегда есть место для дискуссий и новых подходов. Если вы работаете в этой области уже давно, буду рад услышать ваше мнение: согласны ли вы с этими выводами или, у вас есть свои “фишки”, которые работают лучше?

Telegram-канал “ИИ Вселенная [6]” Ваш путеводитель в мир искусственного интеллекта.

Автор: aiexplor

Источник [7]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/13163

URLs in this post:

[1] интеллектом: http://www.braintools.ru/article/7605

[2] обучении: http://www.braintools.ru/article/5125

[3] ошибка: http://www.braintools.ru/article/4192

[4] внимание: http://www.braintools.ru/article/7595

[5] опыта: http://www.braintools.ru/article/6952

[6] ИИ Вселенная: https://t.me/aiexplor

[7] Источник: https://habr.com/ru/articles/891108/?utm_source=habrahabr&utm_medium=rss&utm_campaign=891108

Нажмите здесь для печати.