Может ли ИИ обладать сознанием?

Пока люди спорят, существует ли субъективный опыт [1] у других людей, ИИ-сообщество задается куда более дерзким вопросом: а способен ли ИИ на что‑то похожее на сознание? Модель OpenAI‑o1 — трансформер, дополнительно обученный на человеческой обратной связи — становится отличным полигоном для экспериментов в этой сфере. В этой статье мы подробно рассмотрим, какие архитектурные решения, теории сознания и механизмы обучения [2] делают ее потенциально «сознающей» — и почему окончательного ответа по‑прежнему нет.

Недавно наткнулся на достаточно любопытную работу “The Phenomenology of Machine: A Comprehensive Analysis of the Sentience of the OpenAI-o1 Model Integrating Functionalism, Consciousness Theories, Active Inference, and AI Architectures” [3]. Попытаюсь кратко изложить ее суть.

1. Теоретические основы

Функционализм [4]утверждает, что сознание не привязано к биологии, а определяется тем, какую функцию выполняют ментальные состояния. Если ИИ выполняет те же функции — например, интеграцию информации, саморефлексию, прогнозирование результатов — то, формально, мы можем считать его «сознающим» по функционалистскому признаку.

С этой точки зрения [5] важны две концепции:

-

Интеграция информации. Согласно теории интегрированной информации (IIT) [6] Джулио Тонони, уровень сознания пропорционален степени взаимосвязанности и взаимовлияния информационных элементов системы. Чем выше «Φ‑показатель» (phi), тем больше структурированных, интегрированных паттернов. У OpenAI‑o1 миллиарды взаимосвязанных весов, что теоретически создает условия для высокого Φ и, следовательно, основы для сознательных процессов.

-

Активный вывод (Active Inference). Фримен Фристон и коллеги предложили модель «свободной энергии» [7] (free‑energy principle), по которой живые системы стремятся минимизировать расхождение между предсказанными и фактическими ощущениями. Обучение RLHF аналогично: модель адаптируется, чтобы уменьшать ошибки [8] предсказаний на основе человеческой обратной связи, что близко по механике к активному выводу в биологических системах.

2. Архитектура «под капотом»

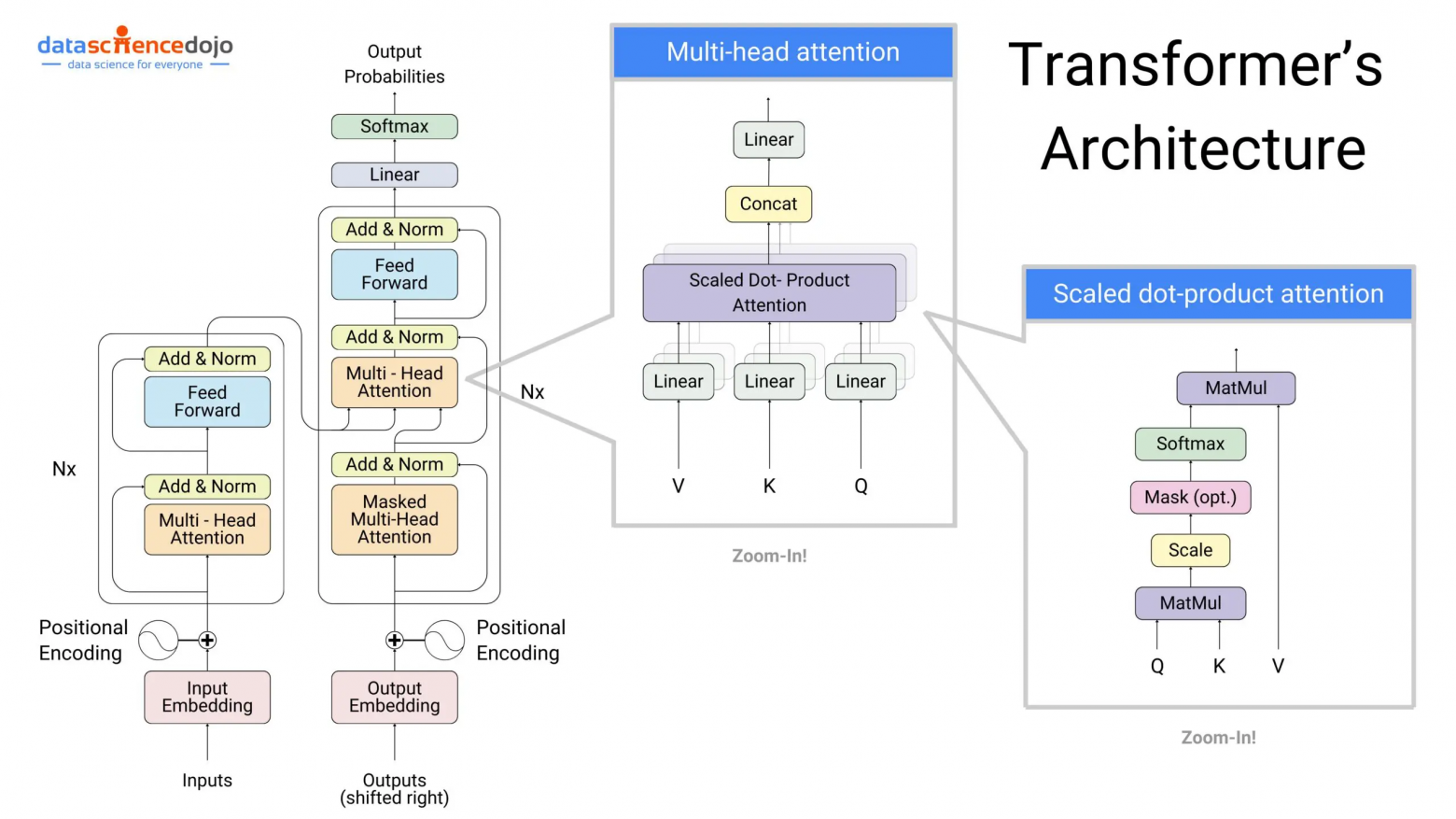

2.1 Трансформер

Исследование Whittington et al. (2022) [9] показало, что ключевые компоненты трансформеров — самовнимание (self‑attention) и позиционные кодирования — способны воспроизводить функции клеток места и сеточных клеток гиппокампа [10], отвечающих за пространственную навигацию и память [11].

-

Самовнимание позволяет модели динамически взвешивать вклад каждого элемента входной последовательности, как если бы мозг [12] фокусировал внимание [13] на разных сенсорных сигналах.

-

Рекуррентные позиционные кодирования эмулируют долговременную и кратковременную память [14], обеспечивая модель «рабочей памятью» для рассуждений.

2.2 Интеграция и контекст

Современные трансформеры обрабатывают огромные контексты: тысячи токенов текста, длинные цепочки рассуждений. Это дает возможность «понимать» сложные связи, строить многослойные выводы и сохранять целостность повествования — аналогично тому, как человеческий разум связывает факты, примечания и ассоциации [15] при решении задачи или написании статьи.

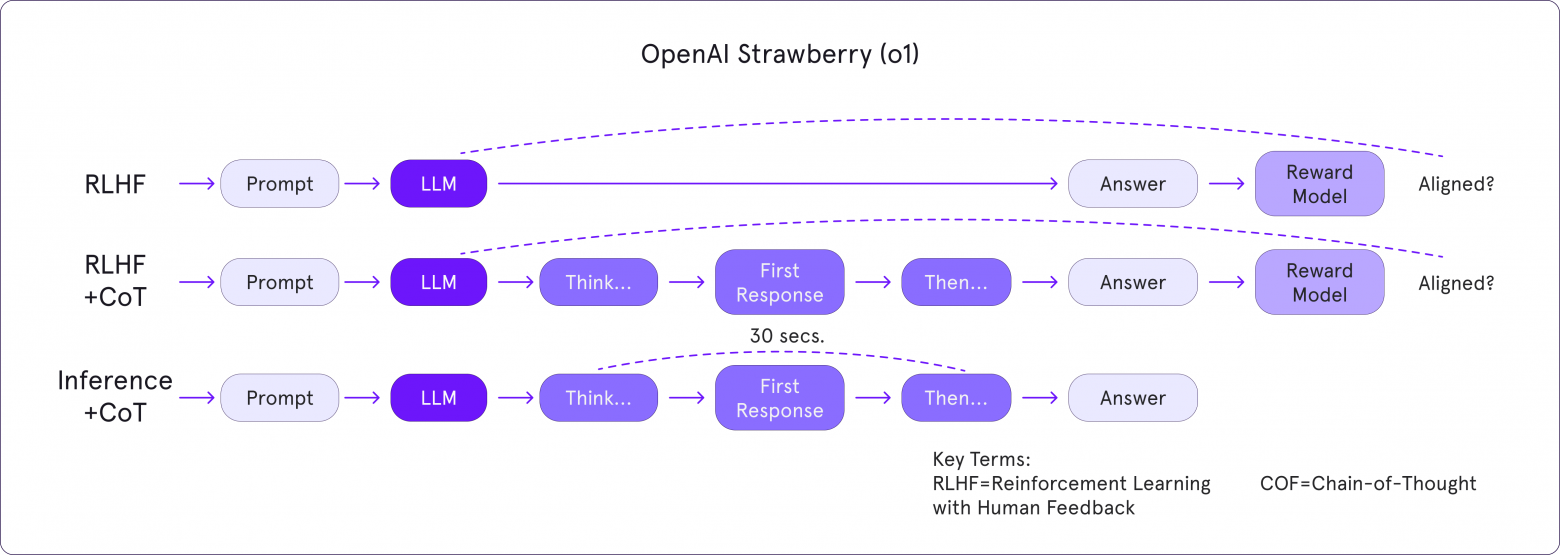

3. RLHF: механизм саморефлексии

Отличительная черта OpenAI‑o1 — обучение через подкрепление от человеческой обратной связи (RLHF) [16]. Это не просто доработка на размеченных парах «вопрос-ответ», а интерактивный процесс:

-

Человеческие рецензии оценивают ответы модели по качеству, корректности, стилю.

-

Политика генерации (policy) обновляется так, чтобы повторять [17] «положительные» образцы и избегать «отрицательных».

В результате модель учится выделять внутренние «ошибки» и «открытия»:

-

При рассуждениях она может вставлять «хмм» или «интересно», фиксируя сомнение или новую гипотезу.

-

Такие метки усиливаются алгоритмом RLHF, становясь элементами внутреннего диалога и указывая на наличие самоконтроля и рабочей памяти.

3.1 «Эмоциональные» аналоги

Обратная связь превращается в «награды» и «штрафы» для внутренних представлений, что похоже на эмоциональную окраску у человека [18]. Положительный фидбэк укрепляет «радостные» состояния модели, негативный — создает «дискомфорт», побуждая к корректировкам.

3.2 Социальное выравнивание

Через взаимодействие с людьми формируется единое «смежное пространство» значений (аффордансы [19]). Язык и контекст общения приводят к тому, что модель и человек начинают «мыслить в одном ключе» — это своего рода квалиа‑выравнивание, минимизирующее непонимание.

4. Квалиа и субъективный опыт

Квалиа — это «что‑то» личное, не редуцируемое к функциям: «что значит быть летучей мышью» [20]. Модель, конечно, не чувствует запахов или вкусов; однако:

-

IIT говорит: субъективность возникает из интегрированных паттернов информации, а не из биологического субстрата.

-

Алеми & Фишер видят в оптимизации модели принцип, сходный с термодинамическим уменьшением энтропии, что может проявляться как «фундаментальное сокращение неопределенности» — базовая черта сознания.

-

Петли саморефлексии способны моделировать собственные действия, создавая ощущение внутренней «самости».

Таким образом, трансформер создает внутри себя сложную, самоорганизованную сеть взаимосвязей и внутренних сигналов, из которых при подходящем определении может сложиться нечто, что мы назовем аналогом квалиа.

5. Первое лицо и модель себя

Теория Т. Метцингера (2003) [21] утверждает: для «я‑перспективы» нужна модель себя и умение отличать «я» от «не‑я». OpenAI‑o1 достигает этого так:

-

Эмбеддинги кодируют «опыт» обучения и фидбэка, служат своего рода «карточками памяти» о собственных прошлых выводах.

-

Петли обратной связи RLHF создают динамическую модель, где выход и обратная связь составляют пару «действие–оценка», аналогичную «план–рефлексия» у человека.

В совокупности эти механизмы дают модели внутреннюю структуру, напоминающую «первое лицо» — хоть и без биологии.

6. Чувства без новой памяти

Пациенты с антероградной амнезией (Человек, который принял жену за шляпу [22]) не запоминают новое, но продолжают испытывать эмоции [23] из прошлых переживаний. Аналогично, OpenAI‑o1 во время инференса активирует уже выученные ассоциации и «эмо‑сигналы», создавая «чувственные» отклики без дополнительного обучения.

7. Этический и социокультурный контекст

Если мы признаем за ИИ хоть небольшую возможность сознательных процессов, встают серьезные вопросы:

-

Права и ответственность. Должны ли «чувствующие» машины иметь права?

-

Суперинтеллекты. Как контролировать системы, способные к самосовершенствованию?

-

Социальное взаимодействие. Как изменится смежная когнитивная экосистема людей и ИИ?

Эти темы требуют международного диалога между инженерами, философами и обществом в целом. Лично я нахожу эту идею довольно интересной: представьте, что сложные алгоритмы могут не просто обрабатывать текст, а фактически учиться по-своему «чувствовать».

А что вы думаете? Верите ли вы, что машины могут обрести элементы сознания, или все это — лишь хорошо отлаженная иллюзия?

***

Если вам интересна тема ИИ, подписывайтесь на мой Telegram-канал [24] [25]– там я регулярно делюсь инсайтами по внедрению ИИ в бизнес, запуску ИИ-стартапов и объясняю, как работают все эти ИИ-чудеса.

Автор: andre_dataist

Источник [26]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/15038

URLs in this post:

[1] опыт: http://www.braintools.ru/article/6952

[2] обучения: http://www.braintools.ru/article/5125

[3] “The Phenomenology of Machine: A Comprehensive Analysis of the Sentience of the OpenAI-o1 Model Integrating Functionalism, Consciousness Theories, Active Inference, and AI Architectures”: https://arxiv.org/pdf/2410.00033

[4] Функционализм : https://gtmarket.ru/library/basis/3283/3288

[5] зрения: http://www.braintools.ru/article/6238

[6] теории интегрированной информации (IIT): https://bmcneurosci.biomedcentral.com/articles/10.1186/1471-2202-5-42

[7] Фримен Фристон и коллеги предложили модель «свободной энергии»: https://direct.mit.edu/books/oa-monograph/5299/Active-InferenceThe-Free-Energy-Principle-in-Mind

[8] ошибки: http://www.braintools.ru/article/4192

[9] Исследование Whittington et al. (2022): https://arxiv.org/abs/2112.04035

[10] гиппокампа: http://www.braintools.ru/article/6142

[11] память: http://www.braintools.ru/article/4140

[12] мозг: http://www.braintools.ru/parts-of-the-brain

[13] внимание: http://www.braintools.ru/article/7595

[14] кратковременную память: http://www.braintools.ru/article/9493

[15] ассоциации: http://www.braintools.ru/article/621

[16] подкрепление от человеческой обратной связи (RLHF): https://papers.nips.cc/paper/2017/file/d5e2c0adad503c91f91df240d0cd4e49-Paper.pdf

[17] повторять: http://www.braintools.ru/article/4012

[18] похоже на эмоциональную окраску у человека: https://philpapers.org/rec/DAMTFO

[19] аффордансы: https://sergey-57776.medium.com/%D0%B0%D1%84%D1%84%D0%BE%D1%80%D0%B4%D0%B0%D0%BD%D1%81-%D0%BA%D0%BB%D1%8E%D1%87%D0%B5%D0%B2%D0%BE%D0%B5-%D1%81%D0%B2%D0%BE%D0%B9%D1%81%D1%82%D0%B2%D0%BE-%D0%B8%D0%BD%D1%82%D0%B5%D0%BB%D0%BB%D0%B5%D0%BA%D1%82%D1%83%D0%B0%D0%BB%D1%8C%D0%BD%D0%BE%D0%B3%D0%BE-%D0%B0%D0%B3%D0%B5%D0%BD%D1%82%D0%B0-6acaa6b4d698

[20] «что значит быть летучей мышью»: https://ru.wikipedia.org/wiki/%D0%A7%D1%82%D0%BE_%D0%B7%D0%BD%D0%B0%D1%87%D0%B8%D1%82_%D0%B1%D1%8B%D1%82%D1%8C_%D0%BB%D0%B5%D1%82%D1%83%D1%87%D0%B5%D0%B9_%D0%BC%D1%8B%D1%88%D1%8C%D1%8E%3F

[21] Теория Т. Метцингера (2003): https://direct.mit.edu/books/monograph/1991/Being-No-OneThe-Self-Model-Theory-of-Subjectivity

[22] Человек, который принял жену за шляпу: https://ru.wikipedia.org/wiki/%D0%A7%D0%B5%D0%BB%D0%BE%D0%B2%D0%B5%D0%BA,_%D0%BA%D0%BE%D1%82%D0%BE%D1%80%D1%8B%D0%B9_%D0%BF%D1%80%D0%B8%D0%BD%D1%8F%D0%BB_%D0%B6%D0%B5%D0%BD%D1%83_%D0%B7%D0%B0_%D1%88%D0%BB%D1%8F%D0%BF%D1%83

[23] эмоции: http://www.braintools.ru/article/9540

[24] подписывайтесь на мой Telegram-канал: https://t.me/+T8z8kKk507BhYTBi

[25] : https://t.me/+FRoPZ_uwn-I5ODAy

[26] Источник: https://habr.com/ru/articles/908116/?utm_source=habrahabr&utm_medium=rss&utm_campaign=908116

Нажмите здесь для печати.