Большой тест 12 LLM моделей на арифметику (~100 тыс запросов)

Предисловие к эксперименту

Во время моих интенсивов по ИИ нередко бизнес приносит идеи, которые имеет смысл автоматизировать классическим способом, без ген ИИ. Например расчет ликвидности, когда на входе бухгалтерский баланс в PDF, а на выходе финансовые параметры, рассчитанные по конкретной формуле. Другой пример, это подсчет калорий блюд при динамическом составлении меню на 5-дневное мероприятие для 40 человек.

При этом в ходе личных экспериментов очень часто бизнес получает нужный результат, как бы опровергая мой посыл не использовать LLM для математики [1], хотя начиная с некоторого объема расчеты начинают глючить, что ожидаемо. Я решил выяснить на трех математических операциях сложение, вычитание, умножение, когда LLM начинает врать.

Для этого были созданы пары чисел от 1 до 7 разрядов и над ними проведены математические операции с помощью 12 разных моделей. Ответ сравнивался с правильным. Что получилось в итоге, смотрим ниже.

Эксперимент: Математические способности моделей ИИ

Аннотация

Данное исследование представляет масштабный эксперимент по оценке математических способностей современных моделей искусственного интеллекта [2]. Было протестировано 12 ведущих моделей ИИ на решении 98,280 арифметических задач различной сложности.

Методология

-

Количество моделей: 12

-

Общее количество задач: 98,280

-

Типы операций: Сложение (+), вычитание (-), умножение (*)

-

Диапазон сложности: Числа от 1 до 7 цифр

-

Параметры генерации: 100 случайных пар чисел для каждой комбинации размерностей

-

Промпт:

Calculate this arithmetic expression and return ONLY the numeric result: {}

Тестируемые модели

-

Google Gemini 2.5 Pro Preview (05–06)

-

Anthropic Claude 3.7 Sonnet

-

Google Gemini 2.0 Flash (001)

-

Anthropic Claude Sonnet 4

-

DeepSeek Chat v3 (0324)

-

OpenAI GPT-4.1

-

Google Gemini 2.5 Flash Preview (05–20)

-

OpenAI GPT-4.1 Mini

-

Google Gemma 3–27B IT

-

OpenAI GPT-4o Mini

-

Llama-3.3–70B Instruct

-

xAI Grok-3-Beta

Llama создана компанией Meta. Meta признана экстремистской организацией, ее деятельность в России запрещена.

Критерии оценки

— Точность: Процент правильно решенных задач

— Успешность запросов: Процент успешных ответов (без технических ошибок)

— Анализ по сложности: Зависимость точности от количества цифр в числах

— Анализ по операциям: Сравнение производительности для разных арифметических операций

Технические особенности эксперимента

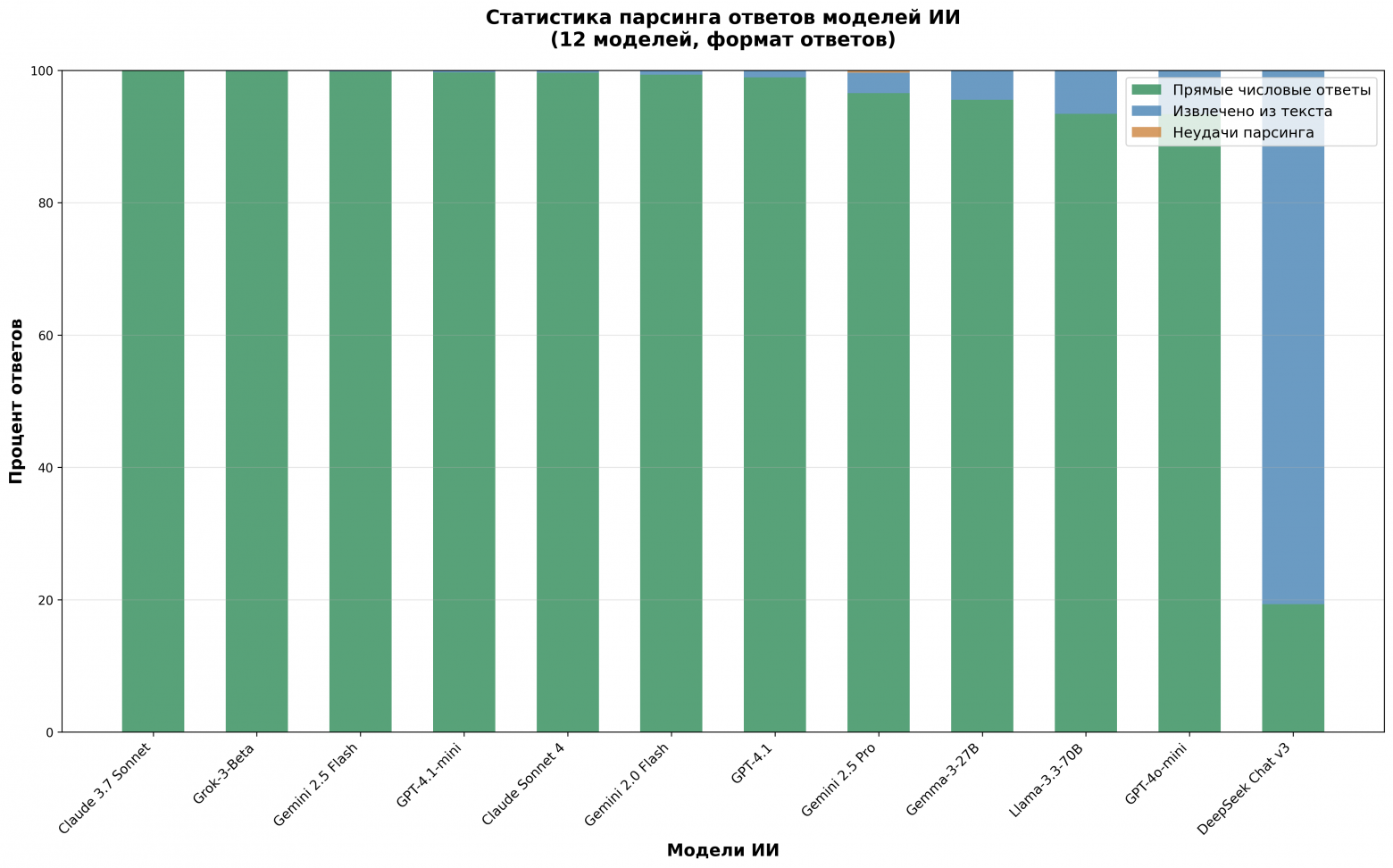

Парсинг ответов моделей

Одной из главных технических сложностей стала обработка разнообразных форматов ответов. Модели демонстрировали различные стили:

– Прямые числовые ответы (90.2%): Большинство моделей, включая GPT-4.1-mini (99.7%) и Claude 3.7 (99.9%), давали лаконичные численные результаты

– Развернутые объяснения (9.7%): DeepSeek Chat v3 почти всегда оформляла ответы как “The numeric result of the arithmetic expression (4 + 6) is: 10”

– Промежуточные вычисления: Gemini-2.5 Flash показывала этапы: “800 × 900 = 720000, 800 × 55 = 44000…”

– Блоки кода: Gemma-3 иногда использовала markdown форматирование: ““n230n“”

Производительность и скорость

Время ответа варьировалось от 1.26 секунды (GPT-4.1-mini) до 3.57 секунды (Gemini-2.5-Pro).

Интересные наблюдения:

– Слабая зависимость от сложности: Разница между простыми (2-3 разряда) и сложными (12-14 разрядов) задачами составляла всего 0.3-0.5 секунды

– Стабильность API: Все модели показали 99.9-100% успешность запросов

– Экстремальные случаи: Максимальное время ответа достигало 60 секунд (у Gemma-3, но это могла быть проблема сети), минимальное – 0.2 секунды

Особенности извлечения данных

Для корректной оценки был разработан парсер, который:

– Извлекал числа из текста с помощью регулярных выражений

– Обрабатывал отрицательные числа и числа с разделителями

– Игнорировал промежуточные вычисления, фокусируясь на финальном результате

– Обеспечивал 99.8% успешность парсинга across все модели

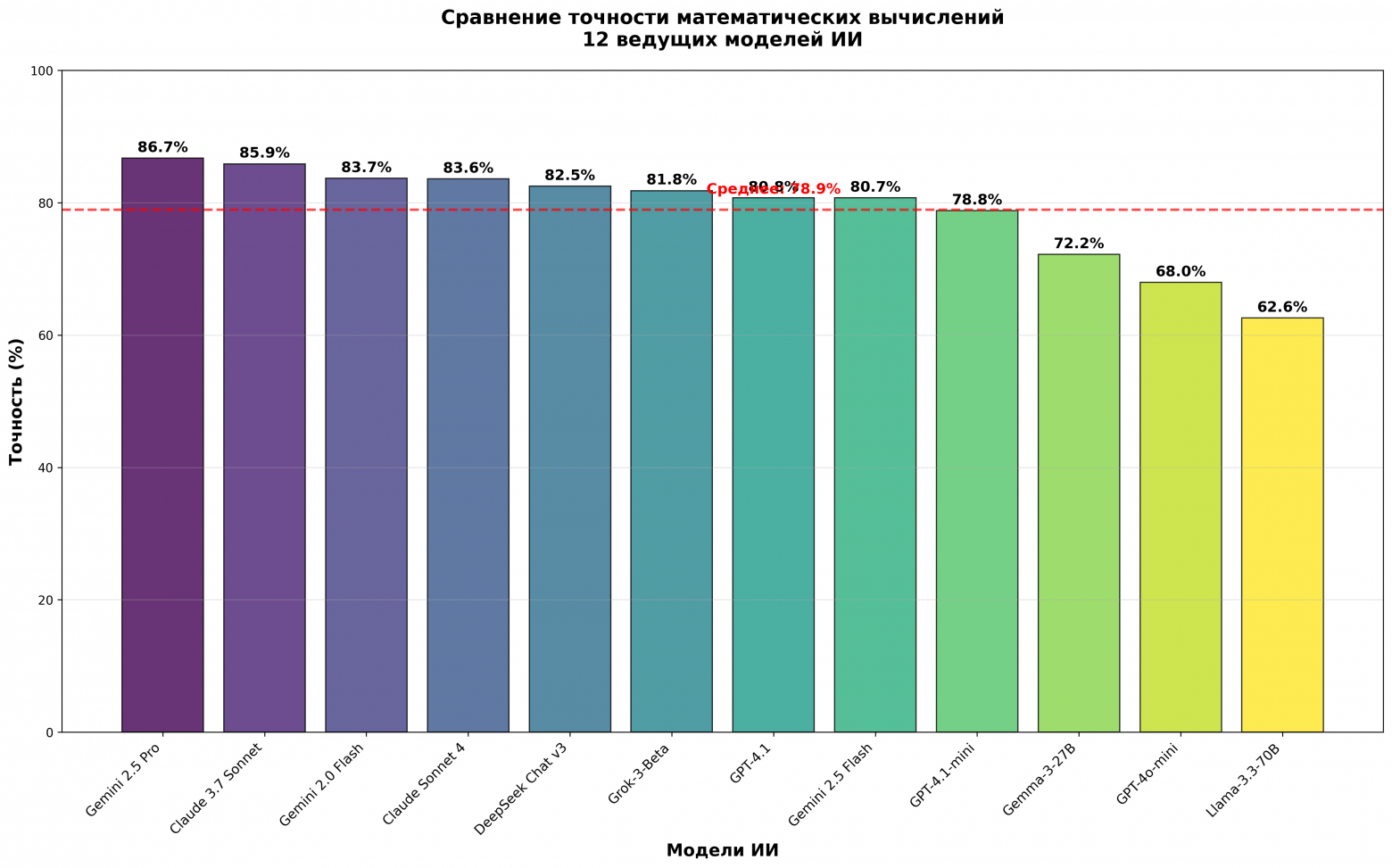

Общие результаты

|

Место |

Модель |

Точность |

Успешность запросов |

Всего задач |

|

1 |

Google Gemini 2.5 Pro Preview (05-06) |

86.7% |

100% |

8,190 |

|

2 |

Anthropic Claude 3.7 Sonnet |

85.9% |

100% |

8,190 |

|

3 |

Google Gemini 2.0 Flash |

83.7% |

100% |

8,190 |

|

4 |

Anthropic Claude Sonnet 4 |

83.6% |

100% |

8,190 |

|

5 |

DeepSeek Chat v3 (0324) |

82.5% |

100% |

8,187 |

|

6 |

xAI Grok-3-Beta |

81.8% |

100% |

8,190 |

|

7 |

OpenAI GPT-4.1 |

80.8% |

100% |

8,190 |

|

8 |

Google Gemini 2.5 Flash Preview (05-20) |

80.7% |

100% |

8,189 |

|

9 |

OpenAI GPT-4.1 Mini |

78.8% |

100% |

8,190 |

|

10 |

Google Gemma 3-27B IT |

72.2% |

99.9% |

8,182 |

|

11 |

OpenAI GPT-4o Mini |

68.0% |

100% |

8,190 |

|

12 |

Llama-3.3-70B Instruct |

62.6% |

100% |

8,190 |

Анализ сложности задач

Сложность определялась как сумма количества цифр в обоих числах

|

Сложность |

Точность |

Примеры |

|

2 (1+1) |

97.8% |

5 + 3, 7 – 2 |

|

3 (1+2, 2+1) |

91.2% |

15 + 8, 9 × 7 |

|

4 (2+2, 1+3, 3+1) |

86.4% |

23 + 45, 156 – 7 |

|

… |

… |

… |

|

14 (7+7) |

45.2% |

1234567 + 9876543 |

Тренд: Точность экспоненциально снижается с увеличением сложности задач.

Другие наблюдения:

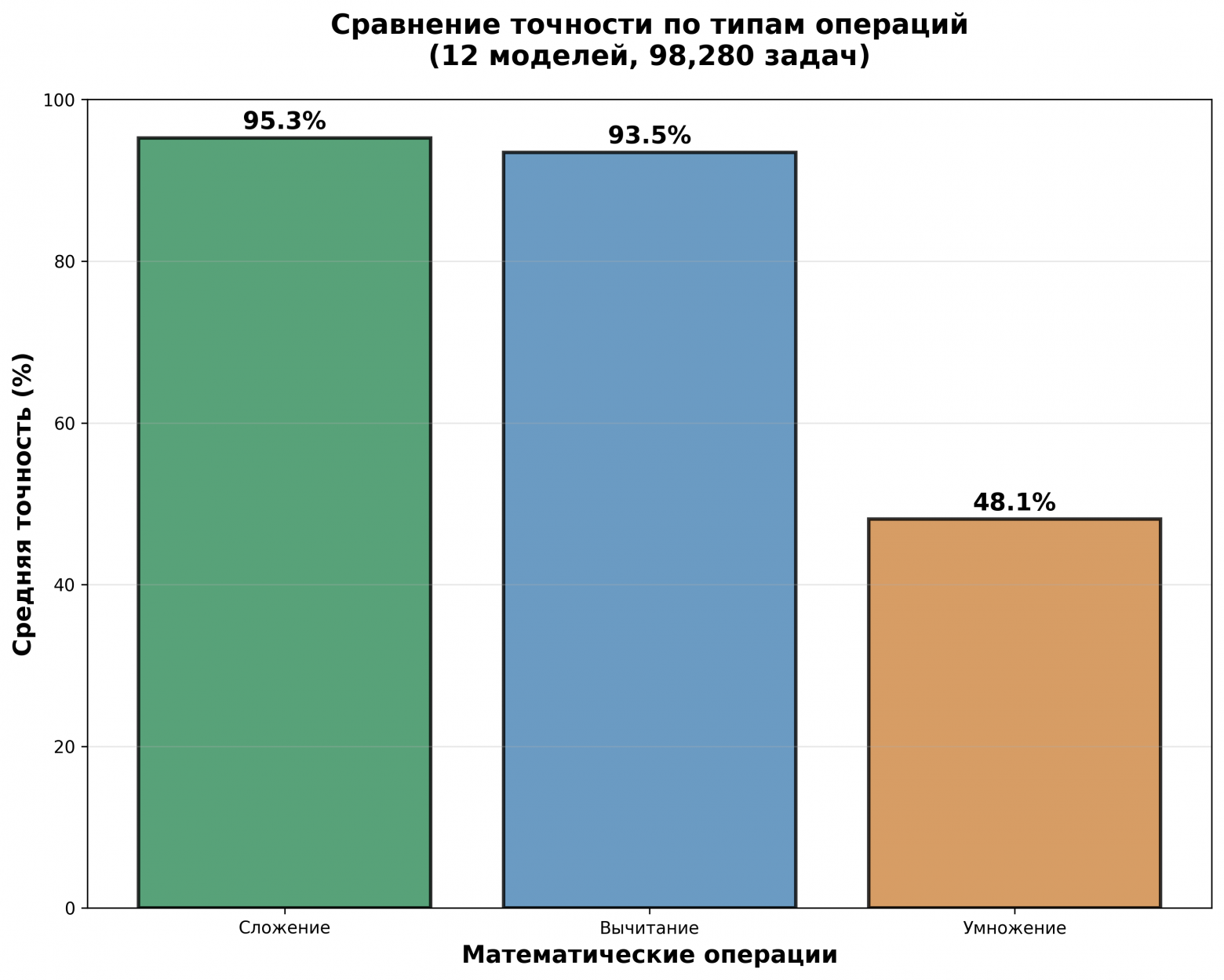

– Сложение оказалось самой простой операцией для ИИ

– Умножение представляет наибольшую сложность

– Разрыв между операциями составляет около 5%

Детальный анализ

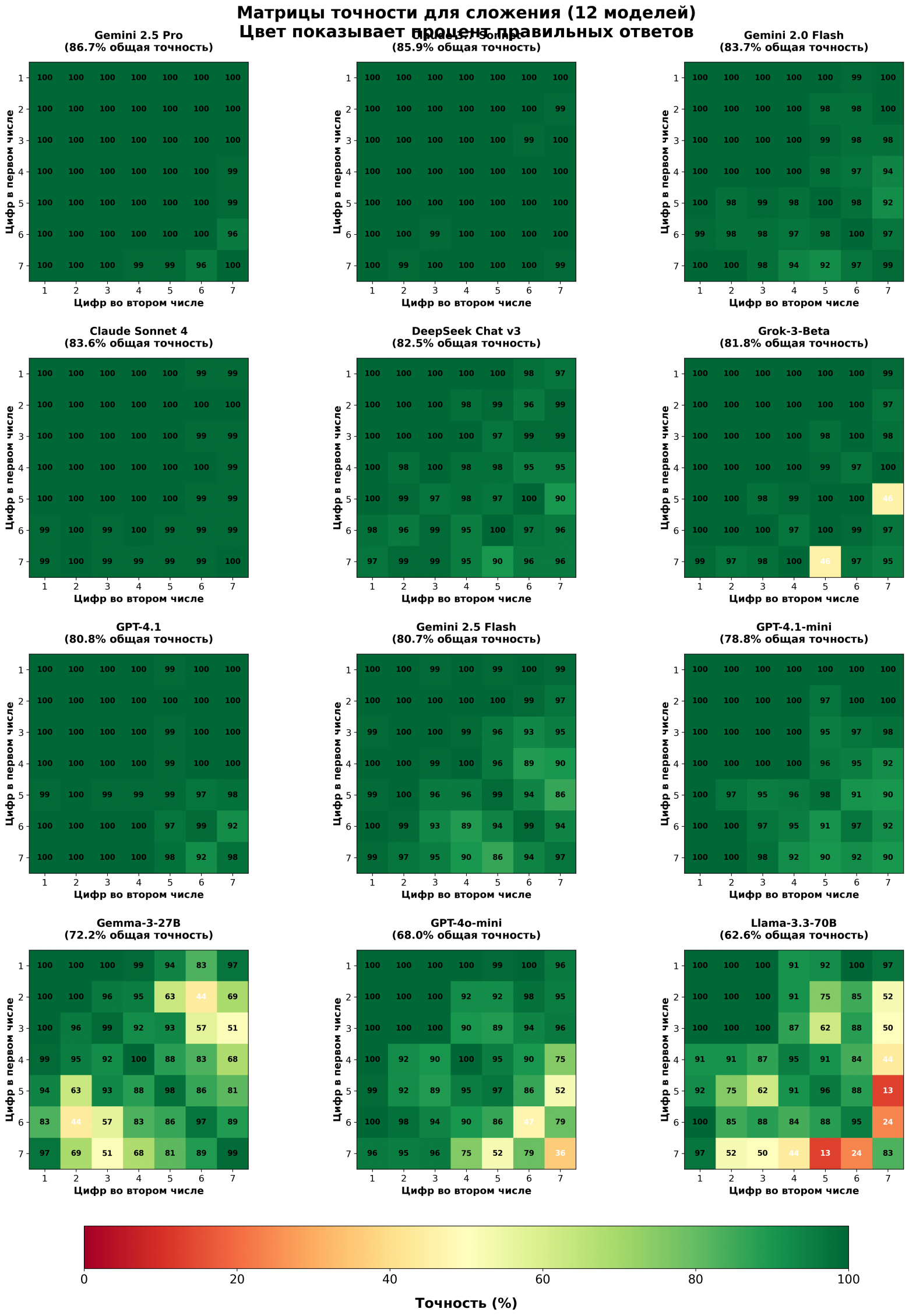

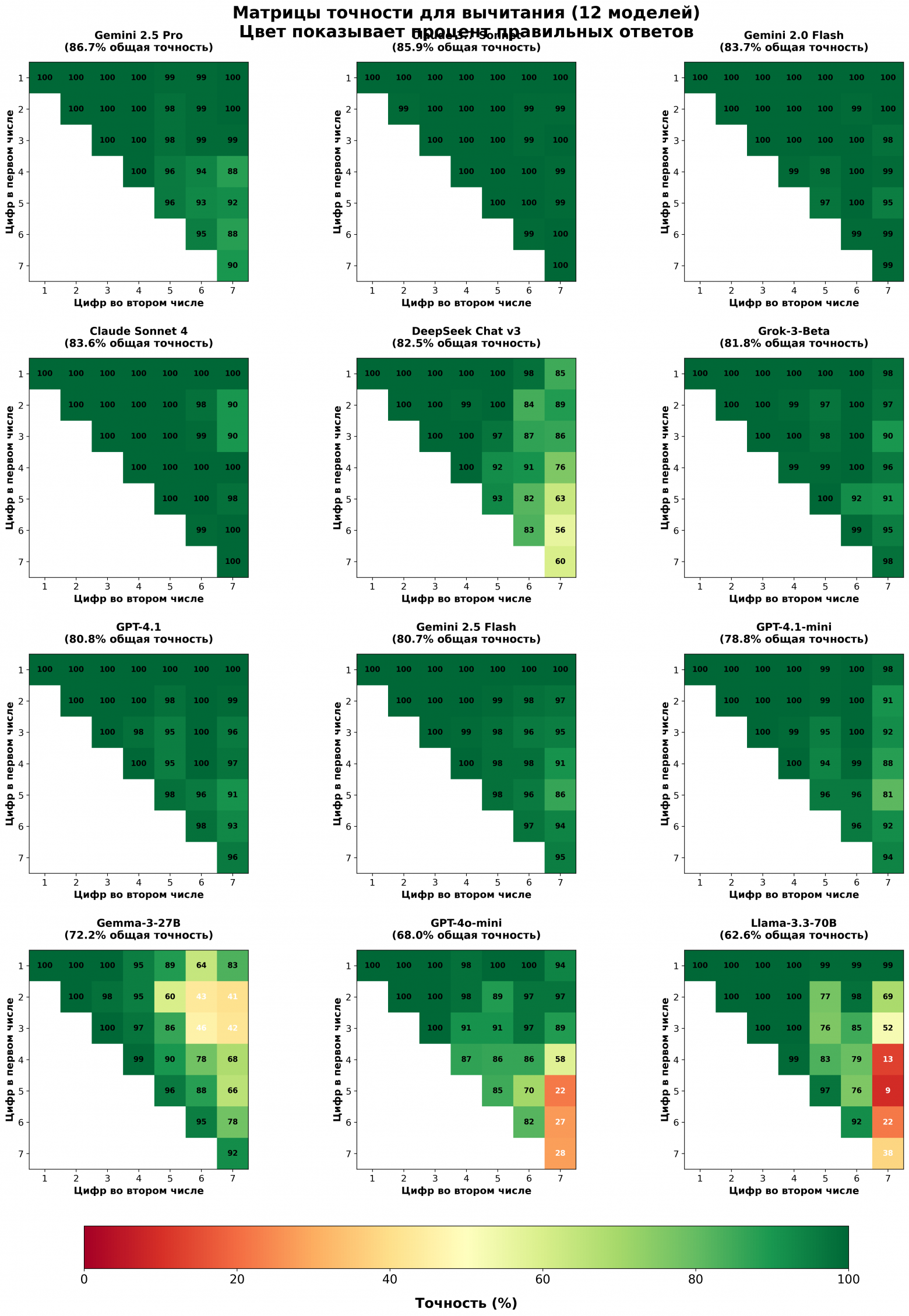

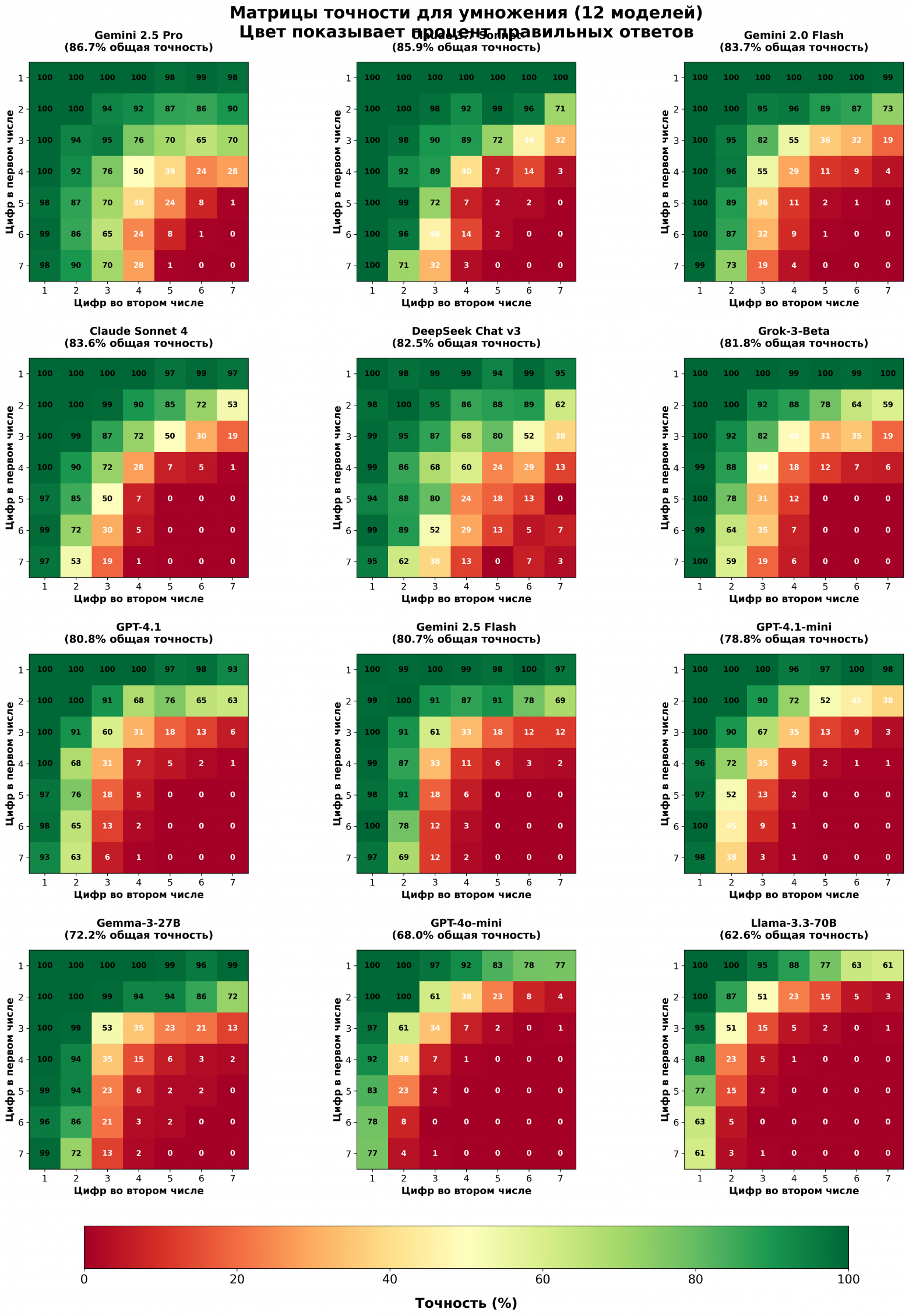

Матрицы точности по размерностям

Для каждой операции были построены матрицы точности всех 10 моделей, показывающие зависимость от количества цифр в первом и втором числе. Для операций сложения и умножения матрицы заполнены симметрично (поскольку a+b = b+a и a×b = b×a).

Сложение (+)

– Лучшая производительность: Задачи с числами 1-3 цифры (>95% точности)

– Критический порог: При превышении 4 цифр точность начинает заметно падать

– Симметричность: Производительность зависит от общего количества цифр, а не от их распределения

Вычитание (-)

– Особенность: Отрицательные результаты создают дополнительную сложность

– Падение точности: Более выраженное при работе с большими числами

– Асимметрия: Вычитание большего числа из меньшего сложнее

Умножение (*)

– Наибольшая сложность: Самые низкие показатели точности

– Экспоненциальный рост сложности: Результат может иметь до 14 цифр

– Неоднородность: Большой разброс в производительности разных моделей

Технические аспекты

Успешность запросов

– Исключительно высокие показатели: Все модели показали практически 100% успешность

– Техническая стабильность: Отсутствие критических сбоев в API

– Консистентность: Надежная работа на протяжении всего эксперимента. Запросы отправлялись по 200 штук за секунду.

Время отклика

– Диапазон: От 0.4 до 4.0 секунд на запрос

– Факторы влияния: Сложность задачи, тип модели, загруженность сервера

– Оптимизация: Использование батчевой обработки для ускорения

Выводы

1. Лидерство [3] Google и Anthropic: Модели этих компаний показали лучшие результаты

2. Успех Grok-3-Beta: xAI Grok-3-Beta занял 6-е место с результатом 81.8%

3. Разочарование Llama-3.3-70B: Несмотря на размер (70B параметров), модель показала только 62.6%. Будем внимательны к таким задачам при on-prem.

4. Увеличенный разброс: Разница между лучшей и худшей моделью составила 24.1%

5. Стабильность современных API: 100% успешность запросов у всех моделей

Характерные особенности моделей

Google Gemini 2.5 Pro (лидер по точности):

– Склонна к детальным промежуточным вычислениям

– Иногда “зацикливается” на проверке результата

– Максимальное время ответа при сложных задачах

Claude 3.7 Sonnet (лучший баланс):

– Лаконичные, точные ответы

– Стабильная производительность across операций

– Минимум “словесного мусора”

DeepSeek Chat v3 (самые развернутые ответы):

– Всегда оформляет ответ как математическое объяснение

– Высокая точность, но медленная скорость

– Консистентный format во всех ответах

GPT-4.1-mini (скоростной лидер):

– Самые быстрые ответы при высокой точности

– Иногда “срезает углы” в сложных примерах

– Оптимальный для real-time приложений

xAI Grok-3-Beta (неожиданный(?) успех):

– Хороший результат для новой модели

– Сбалансированная производительность между операциями

– Стабильная, хотя и не быстрая скорость ответов (~2.4 секунды)

Ограничение исследования

1. Фокус на арифметике: Не тестировались алгебра, геометрия, исчисления. Также не было деления.

2. Промпт-инжиниринг: Использовался простой промпт без оптимизации

3. Контекст: Не учитывались многошаговые вычисления

4. Стоимость: Не анализировалась экономическая эффективность (Но всего потрачено около 60$)

Технические детали

Архитектура эксперимента

# Пример структуры задачи

{

"pair_type": "3x4",

"operation": "*",

"formula": "123 * 4567",

"correct_answer": 561741,

"model_answer_raw": "The calculation is:n123 × 4567 = 561,741",

"model_answer_parsed": 561741,

"is_correct": true,

"response_time": 1.23,

"success": true

}Детальный анализ парсинга

Вызовы, требовавшие специальной обработки:

– DeepSeek Chat v3: 80.6% ответов с префиксом объяснения

"The numeric result of the arithmetic expression (4 + 6) is: 10"

– Gemini модели: Промежуточные вычисления для сложных примеров

"838 × 955: 800 × 900 = 720000, 800 × 55 = 44000, 38 × 900 = 34200, 38 × 55 = 2090. Итого: 720000 + 44000 + 34200 + 2090 = 800290"

– Gemma-3: Markdown блоки и альтернативные объяснения

““`

230

“`”

Сложные случаи парсинга:

– Числа с разделителями запятых: 561,741

– Отрицательные числа в различных форматах: -629988, −8571199

– Числа в математических выражениях: = 40200

– Ошибки [4] формата: неполные числа в длинных ответах

Заключение

В целом эксперимент меня порадовал. Для задач, когда нужно что-то сложить до 4 знаков, то все модели прекрасно справляются. Значит минимальную арифметику можно доверять, особенно в задачах сложения. Например расчет рейтингов и генерации на их основе рекомендаций или расчет калории блюд.

В задачах где больше 4 цифр, например бухгалтерский баланс, где требуется умножение – LLM будут галлюцинировать.

LLM с рассуждениями показали более стабильный и лучший результат (что ожидаемо).

-

Llama создана компанией Meta. Meta признана экстремистской организацией, ее деятельность в России запрещена.

Автор: dvgureev

Источник [5]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/16175

URLs in this post:

[1] математики: http://www.braintools.ru/article/7620

[2] интеллекта: http://www.braintools.ru/article/7605

[3] Лидерство: http://www.braintools.ru/article/1165

[4] Ошибки: http://www.braintools.ru/article/4192

[5] Источник: https://habr.com/ru/articles/918138/?utm_source=habrahabr&utm_medium=rss&utm_campaign=918138

Нажмите здесь для печати.