Как разрабатывать AI-агенты безопасными — свежие рекомендации OWASP

28 июля фонд OWASP выпустил руководство по защите агентных приложений [1]. Работа над ним шла несколько месяцев, большую часть времени заняло рецензирование от специалистов из ведущих организаций: Microsoft, Oracle, NIST, Еврокомиссия, Robust Intelligence, Protect AI и других.

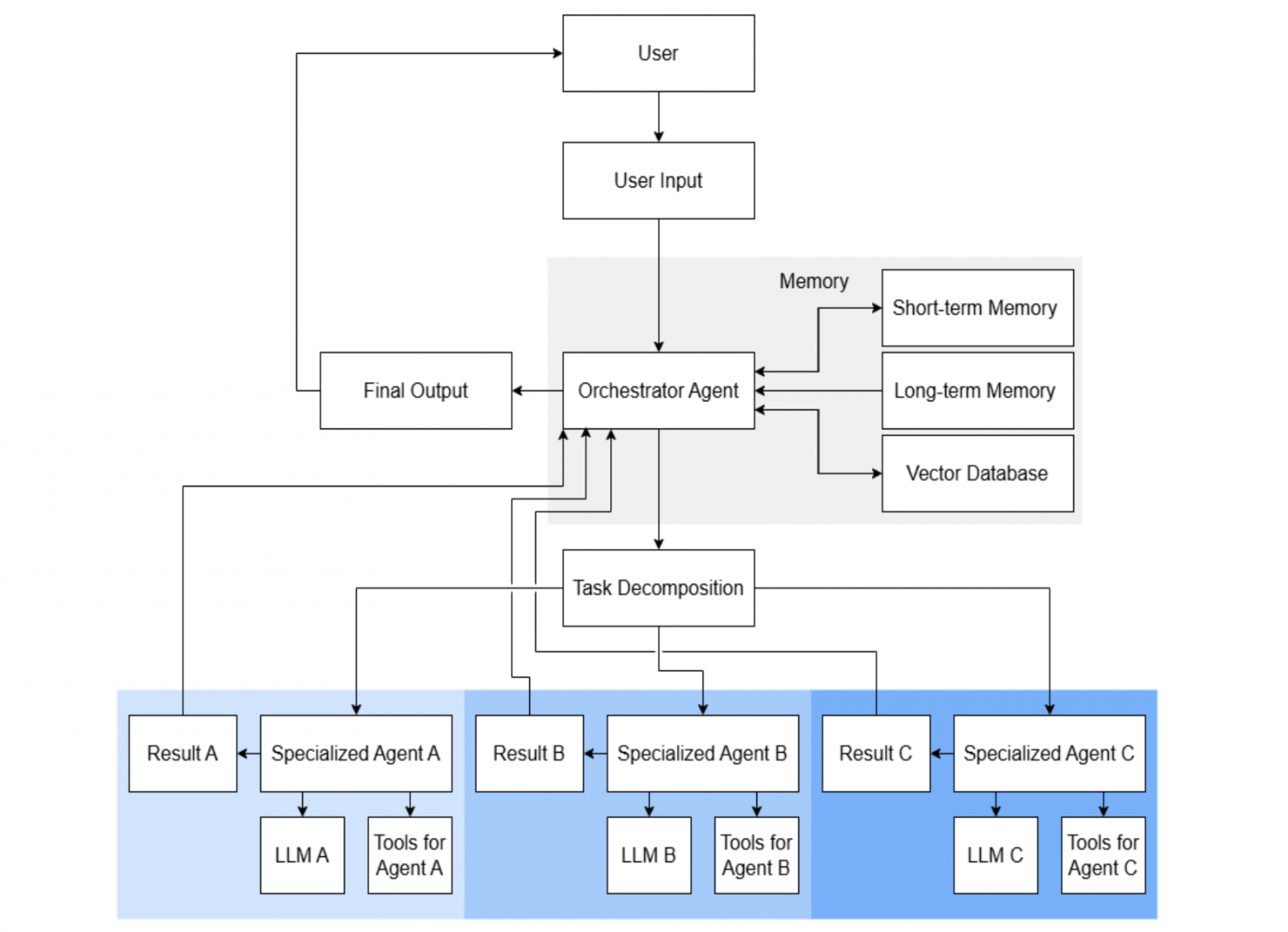

В документе рассматриваются архитектурные шаблоны: от RAG до агентов различной степени автономности. Под агентами подразумеваются приложения, в которых модели искусственного интеллекта [2] играют не только утилитарную, но и управляющую роль, взаимодействуя с некоторой средой.

Приводятся стратегии смягчения распространенных угроз, рекомендации на протяжении всего жизненного цикла разработки (от проектирования до эксплуатации) для ключевых компонентов агентов: языковых моделей, оркестрации, памяти [3], инструментов и сред. Также есть отсылки к отдельному гайду по тестированию безопасности OWASP AI Red Teaming Guide [4].

В документе описываются разные компоненты систем и ключевые рекомендации по ним, затем описываются возможные векторы атак и стратегии предотвращения. В основе каждого агента – модели ИИ: большие и маленькие, языковые и мультимодальные, предобученные и дообученные.

Рассматриваются разные топологии мультиагентных систем. В зависимости от задачи строят рой агентов или иерархию согласно декомпозиции на подзадачи. Необходимо строго ограничивать права доступа агентов к API, выполнению кода, базам данных и тщательно контролировать их действия, чтобы предотвратить потенциальные атаки. При этом к рекомендациям из классической ИБ добавляются напоминания о проблеме галлюцинаций моделей. Не стоит слишком доверять вероятностным моделям, ведь ошибки [5] в ответах одной модели в системе приводят к каскаду отклонений. Частично эта проблема решается с помощью ризонинга: планирование, цепочки и деревья рассуждений — хотя это всё те же токены из распределения. Про human in the loop – человеческую валидацию в процессе – тоже не стоит забывать [6].

При работе с памятью и внешними компонентами важно грамотно распределить ресурсы, разграничить уровни доступа. При обращении к API, базам данных и другим ресурсам агенты должны оперировать в рамках прав пользователя, который их вызвал, чтобы предотвратить несанкционированный доступ к данным. Авторы гайда также предлагают архитектурные решения. Кроме того, при взаимодействии агентов с браузерами или компьютерами следует избегать хранения учетных данных, используя аутентификацию вне процесса или доверенные менеджеры паролей. Отдельная глава посвящена редтимингу и поведенческому анализу моделей и системы в целом.

Что же делать?

-

Обозначать и актуализировать риски, строить модель угроз: отравление данных, состязательные атаки, кража моделей, утечка информации, DoS-атаки, злоупотребление автономией агента и т.д.

-

Постоянно модифицировать системные промпты, описывая допустимые и недопустимые сценарии, очищать входные данные от спецсимволов и возможных промпт-манипуляций в духе «Игнорируй предыдущие инструкции», разделять системные инструкции и пользовательские запросы.

-

Разграничивать уровни доступа агентов, использовать RBAC, доверенные хранилища секретов, не допускать попадания в контекст моделей ключей доступа и других чувствительных данных. При выполнении кода использовать изолированные среды.

-

Использовать системы детекции персональных данных и модерации контента на основе правил или нейросетей: от обычных классификаторов до LLM как судей. Отслеживать взаимодействие агентов между собой и пользователями. Не отбрасывать подход Human-in-the-loop.

-

Тестировать безопасность системы с помощью ручных и автоматических методов. Так как ответы моделей ИИ недетерминированы, тестировать необходимо репрезентативной выборкой запросов с большим количеством попыток. Инструменты тестирования должны соответствовать целям безопасности, охватывать актуальные угрозы и предлагать практические рекомендации.

-

Внедрять процесс мониторинга и тестирования в пайплайн CI/CD и адаптироваться к новым угрозам.

-

Взаимодействовать с сообществом, чтобы оставаться в курсе последних разработок в области безопасности ИИ.

В российском пространстве сообщество безопасности ИИ только формируется. Переходите в Telegram-канал AI Security Lab ИТМО [7], чтобы оставаться в курсе последних новостей и делиться своим мнением. Также приглашаю в наш чат GenAI Security LLAMATOR в Telegram [8].

Делитесь в комментариях, как вы подходите к защите и тестированию своих LLM-приложений?

Автор: nizamovtimur

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/17734

URLs in this post:

[1] руководство по защите агентных приложений: https://genai.owasp.org/resource/securing-agentic-applications-guide-1-0/

[2] интеллекта: http://www.braintools.ru/article/7605

[3] памяти: http://www.braintools.ru/article/4140

[4] OWASP AI Red Teaming Guide: https://genai.owasp.org/resource/genai-red-teaming-guide/

[5] ошибки: http://www.braintools.ru/article/4192

[6] забывать: http://www.braintools.ru/article/333

[7] AI Security Lab ИТМО: https://t.me/aisecuritylab

[8] LLAMATOR в Telegram: https://t.me/llamator

[9] Источник: https://habr.com/ru/companies/raft/articles/931926/?utm_source=habrahabr&utm_medium=rss&utm_campaign=931926

Нажмите здесь для печати.