Multi-Agent System для Radiology VQA: Новый шаг в интерпретации рентгеновских снимков

На arXiv появилась статья [1], описывающая революционный подход к задаче визуального ответа на вопросы в радиологии (Radiology Visual Question Answering, RVQA). Авторы представили мультиагентную систему (MAS), которая обещает повысить точность и интерпретируемость ответов на вопросы о рентгеновских снимках грудной клетки. Этот инструмент не только снижает нагрузку на радиологов, но и решает ключевые проблемы современных мультимодальных больших языковых моделей (MLLM), такие как фактические ошибки [2], галлюцинации и несоответствие между визуальными и текстовыми данными. Давайте разберёмся, как это работает.

Зачем нужен RVQA?

Рентген грудной клетки – это один из самых распространённых методов диагностики в медицине, используемый для выявления заболеваний лёгких, сердца и других структур. Однако интерпретация снимков требует от радиологов высокой квалификации, времени и внимания [3] к деталям. RVQA позволяет автоматизировать ответы на вопросы о снимках, например: «Есть ли признаки пневмонии?» или «Какова вероятность сердечной недостаточности?». Это снижает рутинную нагрузку и ускоряет диагностику.

Современные MLLM, такие как Med-PaLM 2 и LLaVA-Med, уже показывают впечатляющие результаты в RVQA, объединяя визуальные и текстовые данные. Но они сталкиваются с проблемами:

Фактические ошибки из-за недостаточной точности.

Галлюцинации, когда модель выдаёт вымышленные детали.

Несоответствие модальностей, когда визуальная и текстовая информация плохо согласуются.

Кроме того, существующие датасеты, такие как VQA-RAD и Slake, содержат преимущественно простые вопросы (да/нет или открытые), которые не отражают сложность реальных клинических сценариев. Новые датасеты, такие как EHRXQA, предлагают больше разнообразия, но часто не содержат экспертных объяснений, что затрудняет оценку сложного мышления [4] моделей.

Мультиагентная система: Как это работает?

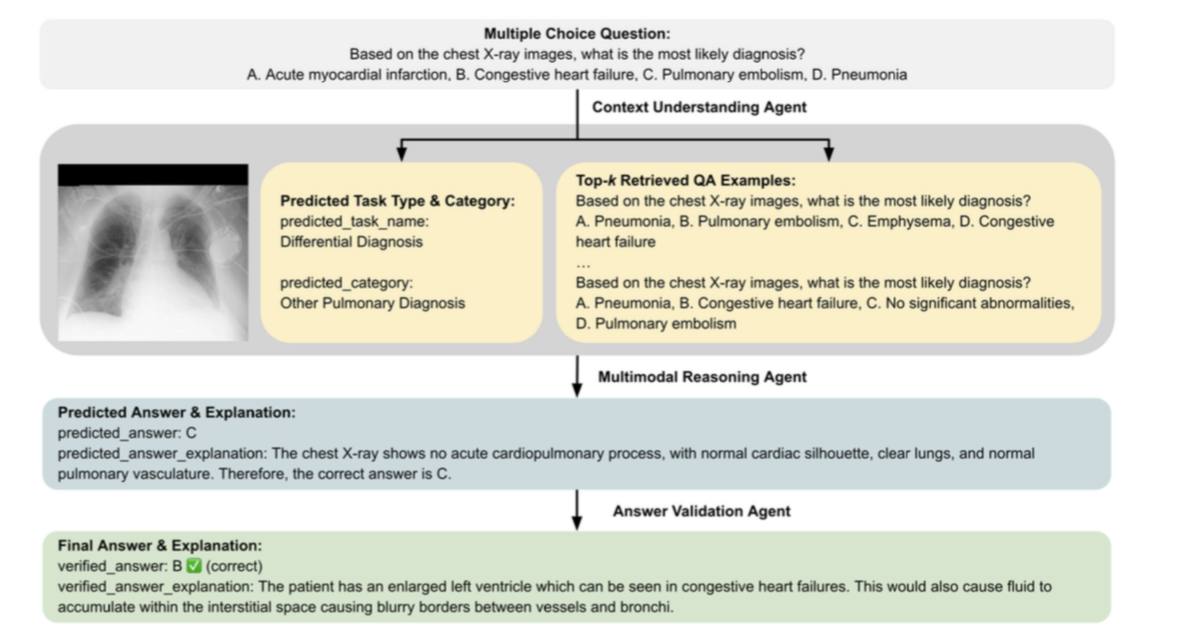

Авторы статьи предлагают мультиагентную систему (MAS), которая разбивает задачу RVQA на три этапа, выполняемых специализированными агентами:

-

Агент понимания контекста (CUA).

-

Агент мультимодального мышления (MRA).

-

Агент валидации ответа (AVA).

Эти агенты работают последовательно, обмениваясь структурированными промежуточными данными, что повышает прозрачность и точность процесса.

1. Агент понимания контекста (CUA)

CUA отвечает за подготовку контекста для последующего анализа. Он:

Использует эмбеддинги для поиска 10 наиболее релевантных примеров вопросов и ответов (QA) из базы ReXVQA-RAG (1006 примеров).

Переранжирует их с помощью MMed-Llama-3-8B, учитывая семантическую близость, клиническую релевантность и соответствие задаче.

Предсказывает тип задачи (например, оценка наличия патологии) и категорию (например, кардиология) на основе взвешенного голосования по 5 лучшим примерам.

Этот этап обеспечивает MRA богатый контекст, включая релевантные примеры и метаданные задачи.

2. Агент мультимодального мышления (MRA)

MRA объединяет вопрос, рентгеновский снимок, контекст от CUA и предсказанные метаданные, чтобы:

-

Сгенерировать ответ в формате множественного выбора (A/B/C/D).

-

Предоставить текстовое объяснение, обосновывающее выбор.

MRA использует Med-GEMMA, модель, специально настроенную для медицинских изображений и текстов. Она анализирует визуальные и текстовые данные, чтобы выдать клинически обоснованный ответ.

3. Агент валидации ответа (AVA)

AVA проверяет надёжность ответа MRA:

-

Оценивает уверенность ответа с помощью MMed-Llama-3-8B.

-

Если уверенность ниже порога (0.7), AVA пересматривает вопрос, используя примеры от CUA, и выдаёт исправленный ответ с новым объяснением.

Этот этап снижает риск ошибок и галлюцинаций, делая систему более надёжной.

Эксперименты и результаты

Датасеты

Система тестировалась на ReXVQA, большом наборе данных с множественными выборами по рентгенологии грудной клетки. Авторы выделили три поднабора:

-

ReXVQA-Pool: 3000 примеров (4795 снимков) для анализа разногласий моделей.

-

ReXVQA-Hard: 1131 сложных примеров, отобранных по разногласиям 5 MLLM (MedGemma, Janus, LLaVA, OpenFlamingo, Qwen25VL), где минимум 3 модели ошиблись.

-

ReXVQA-RAG: 1006 примеров для поиска релевантного контекста.

Базовые модели

MAS сравнивалась с SOTA-моделями: MedGemma, Janus-Pro-7B, LLaVA 1.5, OpenFlamingo-4B, Phi-3.5-Vision-Instruct и Qwen2.5-VL. GPT-модели исключены, так как GPT-4o использовался для создания эталонных ответов.

Метрики

-

Точность ответа (accuracy).

-

Качество объяснений: BLEU, ROUGE-L, METEOR, BERTScore.

Результаты

MAS показала выдающиеся результаты на ReXVQA-Hard:

-

Точность: 63.66% против 44.03% у лучшей базовой модели (MedGemma), прирост почти на 20%.

-

Качество объяснений: MAS лидирует по BLEU (0.1230) и ROUGE-L (0.3692), а по METEOR (0.3449) и BERTScore (0.8987) сопоставима с лучшими (Qwen25VL и Phi35).

Кейс-стади показывает, как система справляется с неоднозначным вопросом о сердечной недостаточности против лёгочной эмболии. MRA ошибочно выбрал эмболию, но AVA скорректировал ответ на правильный (сердечная недостаточность), опираясь на контекст и визуальные признаки.

Абляционный анализ

Абляция показала вклад каждого агента:

-

Только MRA: 44.03% точности, низкие метрики объяснений.

-

CUA + MRA: +10% точности (54.29%), значительный рост BLEU и ROUGE-L.

-

Полная система (CUA + MRA + AVA): 63.66% точности, лучшие метрики объяснений.

Это подтверждает, что каждый агент вносит существенный вклад в точность и интерпретируемость.

Почему это важно?

-

Повышение точности и надёжности. MAS превосходит одиночные MLLM, снижая галлюцинации и улучшая клиническую релевантность ответов.

-

Интерпретируемость. Модульный дизайн делает процесс прозрачным: каждый этап (контекст, мышление, валидация) можно проанализировать.

-

Клиническая применимость. Система справляется с задачами, требующими сложного мышления, что ближе к реальным сценариям радиологии.

Ограничения и перспективы

-

Фиксированный порог уверенности. AVA использует порог 0.7, который может не подходить для других медицинских доменов. Будущие работы могут внедрить динамическое пороговое значение.

-

Ограниченность датасета. ReXVQA-Hard фокусируется на сложных случаях, но может не охватывать редкие патологии.

-

Масштабируемость. Интеграция новых моделей и данных потребует оптимизации вычислений.

Будущие исследования могут:

Разработать адаптивные пороги для AVA.

Расширить датасеты на другие модальности (КТ, МРТ).

Интегрировать MAS с системами генерации отчётов.

Вывод

Мультиагентная система для RVQA – это шаг к созданию ИИ, который не только отвечает на вопросы о рентгеновских снимках, но и делает это с высокой точностью и прозрачностью. Разделение задачи на контекст, мышление и валидацию позволяет справляться с сложными клиническими сценариями, где одиночные модели терпят неудачу. Это исследование открывает путь к надёжным и интерпретируемым ИИ-решениям в радиологии, которые могут стать настоящими помощниками врачей.

Что думаете? Готовы ли такие системы изменить работу радиологов? Делитесь в комментариях. Для свежих инсайтов по ИИ и разработке присоединяйтесь к нашему Telegram-каналу [5]. Давайте обсуждать, как ИИ меняет мир!

Автор: Nikta3

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/18031

URLs in this post:

[1] появилась статья: https://arxiv.org/pdf/2508.02841

[2] ошибки: http://www.braintools.ru/article/4192

[3] внимания: http://www.braintools.ru/article/7595

[4] мышления: http://www.braintools.ru/thinking

[5] Telegram-каналу: https://t.me/nikta_ai

[6] Источник: https://habr.com/ru/articles/934534/?utm_source=habrahabr&utm_medium=rss&utm_campaign=934534

Нажмите здесь для печати.