MIT взломал «мозг» LLM: модели научились рассуждать как люди

MIT представил исследование, которое может изменить наше понимание того, как обучаются большие языковые модели. Учёные доказали, что если правильно подать материал, то LLM способны к логическим рассуждениям, а не только к генерации текста по шаблону.

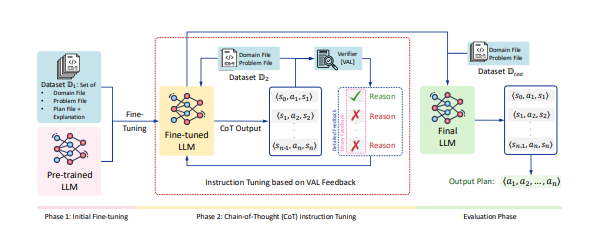

Для этого они предложили новый метод обучения — PDDL-INSTRUCT. Его суть в том, что модель больше не угадывает правильный ответ, а учится пошагово решать задачи с внешней проверкой.

Как это работает:

1) Сначала модели показывают правильные и неправильные планы действий с пояснениями.

2) Затем она сама строит рассуждения шаг за шагом.

3) Полученные рассуждения проверяет внешний инструмент (VAL), который указывает, где ошибка [2] и почему. Таким образом, модель получает чёткую обратную связь, а не формальное «правильно/неправильно».

Результаты впечатляют. У Llama-3-8B точность выполнения задач планирования выросла с 28% до 94%. Такой скачок объясняется именно качеством обратной связи: модель не просто копирует паттерны, а учится логике [3], фактически осваивая роль символического планировщика.

Важно, что LLM в этой схеме не заменяет классические системы, а работает в тандеме с ними — сохраняя внешнюю проверку и при этом перенимая навыки пошагового мышления [4].

Главная интрига: если метод масштабировать, то можно раскрыть скрытые способности моделей в самых разных областях — от сложной математики [5] и программирования до планирования процессов в бизнесе. Получается, что многие ограничения LLM связаны не с их природой, а с тем, как их обучают.

Делегируйте часть рутинных задач вместе с BotHub! [6] Для доступа к сервису не требуется VPN и можно использовать российскую карту. По ссылке [7] вы можете получить 100 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Источник [8]

Автор: cognitronn

Источник [9]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/19932

URLs in this post:

[1] обучения: http://www.braintools.ru/article/5125

[2] ошибка: http://www.braintools.ru/article/4192

[3] логике: http://www.braintools.ru/article/7640

[4] мышления: http://www.braintools.ru/thinking

[5] математики: http://www.braintools.ru/article/7620

[6] BotHub!: https://bothub.chat/?utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_source=contentmarketing&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_medium=habr&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_campaign=news&utm%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C%5C_content=MIT%20HACKED%20THE%20"BRAIN"%20OF%20LLMS:%20MODELS%20LEARNED%20TO%20REASON%20LIKE%20HUMANS

[7] По ссылке: https://bothub.chat/?invitedBy=m_aGCkuyTgqllHCK0dUc7

[8] Источник: https://arxiv.org/abs/2509.13351

[9] Источник: https://habr.com/ru/companies/bothub/news/950566/?utm_source=habrahabr&utm_medium=rss&utm_campaign=950566

Нажмите здесь для печати.