GLM-4.6: новый флагман от Zhipu AI в области агентных рабочих процессов и кодинга

Вчера китайская компания Zhipu AI (Z.ai [1]) представила обновлённую версию своей языковой модели – GLM-4.6. Это релиз, который заслуживает внимания [2] не только из-за улучшенных показателей на бенчмарках, но и благодаря практическим улучшениям в реальных задачах: агентных рабочих процессах, долгоконтекстной обработке, программировании и интеграции с инструментами поиска.

Разберём архитектурные особенности модели, её возможности, результаты тестирования и практические сценарии применения. Особое внимание уделю сравнению с конкурентами и способам использования через API и локальное развёртывание.

Архитектура и ключевые характеристики

GLM-4.6 построена на базе архитектуры Mixture of Experts (MoE) с общим количеством параметров 355 миллиардов. Это эволюция [3] предыдущей версии GLM-4.5, в которой разработчики сосредоточились на оптимизации работы с длинными контекстами и снижении токенозатрат при решении сложных многошаговых задач.

Основные улучшения:

✦ Расширенное контекстное окно

Размер входного контекста увеличен с 128K токенов в GLM-4.5 до 200K токенов. Максимальный объём генерации составляет 128K токенов. Это позволяет модели работать с объёмными техническими документами, кодовыми базами и многошаговыми сценариями без потери информации.

✦ Эффективность использования токенов

По результатам тестирования на бенчмарке CC-Bench, GLM-4.6 демонстрирует примерно на 15% меньшее потребление токенов по сравнению с GLM-4.5 при решении задач многораундового кодирования в изолированных Docker-окружениях. Это напрямую влияет на стоимость использования API и скорость генерации ответов.

✦ Поддержка инструментов на уровне инференса

Модель интегрирует возможность использования внешних инструментов (tool calling) непосредственно в процессе генерации. Это критично для агентных систем, где требуется динамический выбор и применение функций: поиск в интернете, выполнение кода, обращение к базам данных.

✦ Улучшенное выравнивание с человеческими предпочтениями

В области генерации текстов модель показывает более естественный стиль изложения, лучшую стилистическую согласованность и эмоциональную регуляцию. Это делает её подходящей для создания контента, сценариев, диалоговых систем и ролевых персонажей.

Производительность на бенчмарках

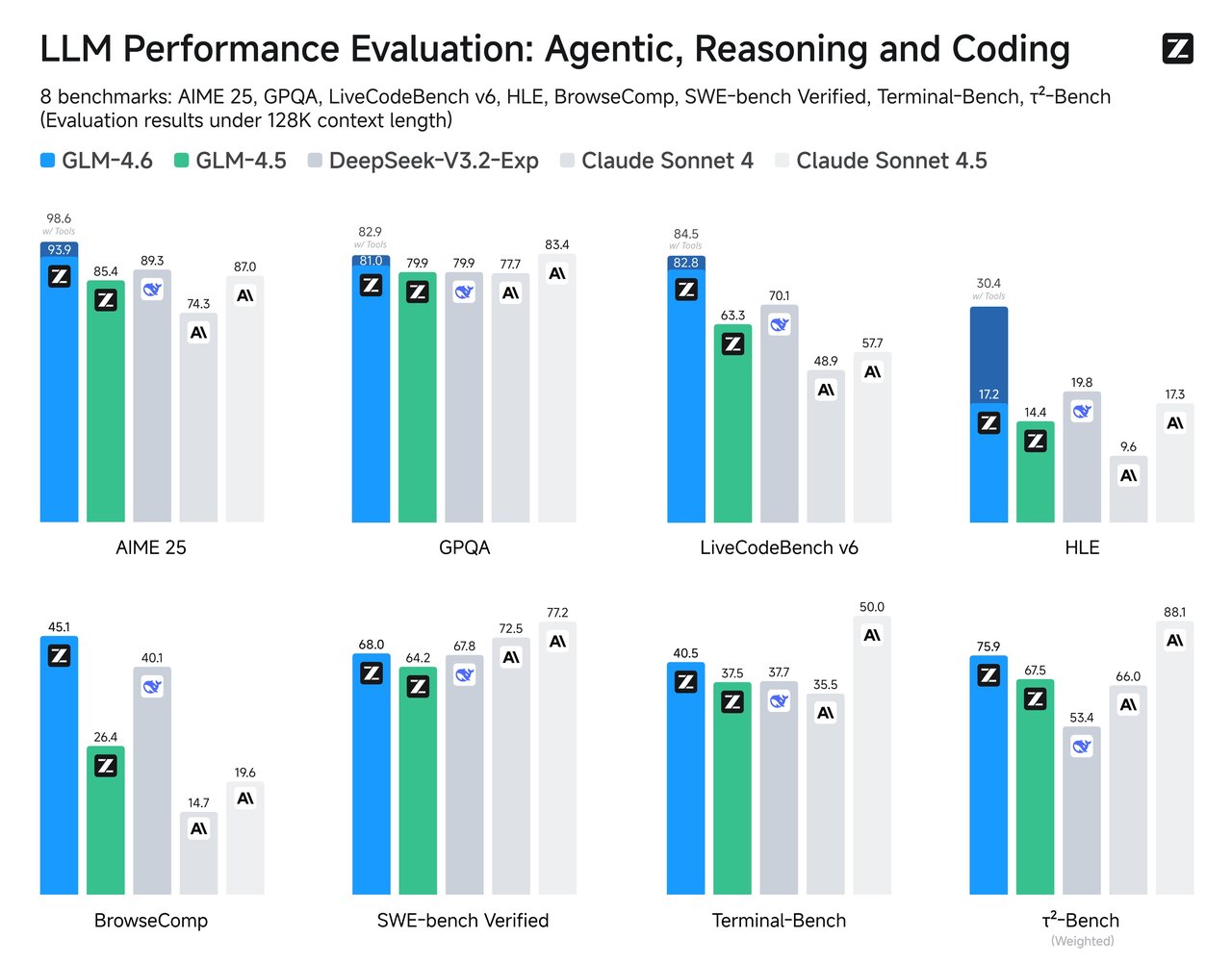

Zhipu AI провела тестирование GLM-4.6 на восьми авторитетных бенчмарках. Приводится сравнительная таблица с ключевыми конкурентами:

Что говорят цифры:

-

Математическое рассуждение — GLM-4.6 показывает выдающиеся результаты на AIME 25, превосходя все перечисленные модели, включая Claude Sonnet 4.5.

-

Кодинг — на LiveCodeBench модель значительно опережает конкурентов, что подтверждает заявления разработчиков о фокусе на реальном программировании.

-

Работа с длинным контекстом — результат на HLE демонстрирует эффективность увеличенного контекстного окна.

-

Инженерные задачи — на SWE-Bench Verified GLM-4.6 немного уступает моделям Claude Sonnet 4 и 4.5, что указывает на области для будущих улучшений.

Тестирование в реальных сценариях кодинга

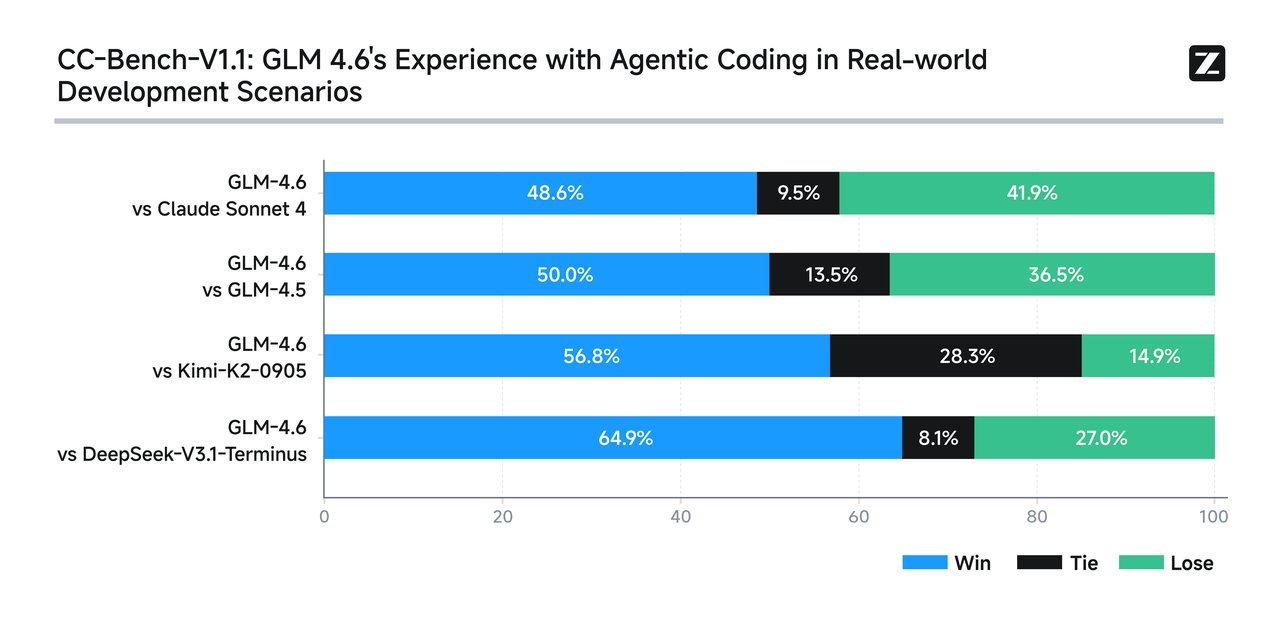

Особый интерес [4] представляют результаты тестирования на CC-Bench v1.1 — бенчмарке для оценки агентного кодинга в практических условиях. Здесь учитывается не только корректность решения, но и эффективность использования токенов.

Ключевые наблюдения:

-

GLM-4.6 показывает конкурентный результат против Claude Sonnet 4 при существенно меньшем потреблении токенов.

-

Против китайских конкурентов модель демонстрирует уверенное лидерство [5] как по качеству, так и по эффективности.

-

Процент ничьих с Kimi K2 достигает 28.3%, что говорит о близком уровне решений в части задач.

Возможности и практические применения

1. Разработка программного обеспечения

GLM-4.6 поддерживает более 40 языков программирования, включая Python, JavaScript, Java, Go, Rust и другие. Модель особенно эффективна в:

-

Фронтенд-разработке: генерация HTML/CSS/JavaScript с логически организованной структурой и эстетичным оформлением.

-

Декомпозиции задач: разбиение сложных требований на подзадачи с чёткой последовательностью выполнения.

-

Кросс-инструментальной интеграции: использование нескольких инструментов в рамках одного workflow (например, поиск документации + генерация кода + запуск тестов).

-

Алгоритмической работе: реализация сложных алгоритмов, анализ данных, оптимизация производительности.

2. Агентные системы

Благодаря встроенной поддержке tool calling, модель идеально подходит для создания автономных агентов:

-

Интеграция с поисковыми API для получения актуальной информации.

-

Выполнение многошаговых планов с динамической корректировкой стратегии.

-

Работа с файловыми системами, базами данных, внешними сервисами.

3. Автоматизация офисных задач

GLM-4.6 демонстрирует высокое качество в создании презентаций PowerPoint, обработке документов, анализе таблиц. Модель сохраняет целостность контента и создаёт логичные визуальные структуры.

4. Перевод и локализация

Модель показывает сильные результаты в переводе на французский, русский, японский и корейский языки, особенно в неформальных контекстах: социальные сети, электронная коммерция, развлекательный контент.

5. Создание контента

Естественность выражений в многораундовых диалогах делает GLM-4.6 подходящей для:

-

Разработки виртуальных персонажей и чат-ботов.

-

Написания сценариев, новелл, рекламных текстов.

-

Генерации контента для блогов и социальных сетей.

6. Исследовательские задачи

Интеграция с поисковыми инструментами позволяет модели проводить глубокий анализ информации с синтезом результатов из множества источников.

Способы использования

Доступ через API

Основной способ работы с GLM-4.6 — через API Zhipu AI:

Endpoint: https://api.z.ai/api/paas/v4/chat/completionsДля использования требуется API-ключ, доступный по подписке GLM Coding Plan от $3/месяц.

Рекомендуемые параметры:

-

temperature: 1.0— для общих задач -

top_p: 0.95, top_k: 40— для кодинга и задач с оцениванием

Пример запроса (Python):

import requests

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

data = {

"model": "glm-4-6",

"messages": [

{"role": "user", "content": "Напиши функцию для сортировки массива методом быстрой сортировки на Python"}

],

"temperature": 1.0,

"max_tokens": 2000

}

response = requests.post(

"https://api.z.ai/api/paas/v4/chat/completions",

headers=headers,

json=data

)

print(response.json()["choices"][0]["message"]["content"])

Интеграция с инструментами разработки

GLM-4.6 поддерживается основными платформами:

-

Cursor – IDE с AI-ассистентом для программирования

-

Claude Code – инструмент агентного кодинга из командной строки

-

Cline, Roo Code, Kilo Code – альтернативные решения для AI-assisted разработки

Публичный доступ

Модель доступна на платформах OpenRouter и Novita AI с оплатой по токенам:

-

$0.60 за миллион входных токенов

-

$2.20 за миллион выходных токенов

Локальное развёртывание

Как open-weight модель под лицензией MIT, GLM-4.6 можно развернуть локально:

Доступные репозитории:

-

Hugging Face:

zai-org/GLM-4.6 -

ModelScope (для пользователей из Китая)

Фреймворки для инференса:

-

vLLM

-

SGLang

Пример загрузки с Hugging Face:

from transformers import AutoTokenizer, AutoModelForCausalLM

tokenizer = AutoTokenizer.from_pretrained("zai-org/GLM-4.6")

model = AutoModelForCausalLM.from_pretrained(

"zai-org/GLM-4.6",

device_map="auto",

torch_dtype="auto"

)

inputs = tokenizer("Объясни принцип работы трансформеров", return_tensors="pt")

outputs = model.generate(**inputs, max_new_tokens=500)

print(tokenizer.decode(outputs[0]))

Для локального развёртывания потребуется значительная вычислительная мощность. Сообщество активно работает над квантизацией модели для запуска на рабочих станциях.

Ограничения и рекомендации

При всех преимуществах GLM-4.6, важно учитывать следующие моменты:

-

Верификация выходных данных: как и любая языковая модель, GLM-4.6 может генерировать ошибки [6] и галлюцинации. Критически важные решения требуют проверки.

-

Задачи инженерного уровня: на бенчмарке SWE-Bench Verified модель немного уступает Claude Sonnet 4/4.5, что может быть важно для сложных инженерных задач.

-

Языковые особенности: модель оптимизирована для китайского и английского языков. Качество работы с другими языками может варьироваться.

-

Стоимость API: при интенсивном использовании расходы на токены могут быть значительными, несмотря на эффективность модели.

Сравнение с конкурентами

GLM-4.6 vs Claude Sonnet 4.5

Преимущества GLM-4.6:

-

Лучшие результаты на бенчмарках математики [7] и кодинга

-

Значительно более эффективное использование токенов

-

Открытые веса для локального развёртывания

-

Более низкая стоимость использования

Преимущества Claude Sonnet 4.5:

-

Чуть выше результаты на SWE-Bench Verified

-

Более зрелая экосистема инструментов

-

Стабильность и надёжность от Anthropic

GLM-4.6 vs DeepSeek-V3.2-Exp

GLM-4.6 опережает DeepSeek по большинству бенчмарков, особенно в задачах кодинга, долгого контекста и агентных workflow. DeepSeek показывает лучший результат только на GPQA (научные знания).

GLM-4.6 vs GLM-4.5

Новая версия демонстрирует улучшения по всем направлениям: от математического рассуждения до работы с инструментами. Особенно заметен прогресс в токенозатратах и возможностях агентных систем.

Перспективы развития

Выход GLM-4.6 показывает серьёзные амбиции Zhipu AI на глобальном рынке языковых моделей. Компания делает ставку на практическую применимость, эффективность и открытость.

Ожидаемые направления развития:

-

Дальнейшая оптимизация для специфических задач (медицина, юриспруденция, финансы)

-

Улучшение мультимодальных возможностей

-

Расширение языковой поддержки

-

Снижение требований к вычислительным ресурсам через квантизацию

Заключительный вердикт

GLM-4.6 – это значительный шаг вперёд в развитии китайских языковых моделей. Модель демонстрирует конкурентоспособность с ведущими западными решениями при меньшей стоимости использования и открытых весах.

Кому подойдёт GLM-4.6:

-

Разработчикам, ищущим эффективный AI-ассистент для кодинга

-

Компаниям, строящим агентные системы и автоматизацию

-

Исследователям, заинтересованным в экспериментах с open-weight моделями

-

Проектам с ограниченным бюджетом на API

Модель заслуживает внимания как альтернатива коммерческим решениям, особенно в задачах, требующих баланса между качеством, эффективностью и стоимостью.

Полезные ссылки:

-

API Zhipu AI [10]

Автор: stas-clear

Источник [11]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/20137

URLs in this post:

[1] Z.ai: http://Z.ai

[2] внимания: http://www.braintools.ru/article/7595

[3] эволюция: http://www.braintools.ru/article/7702

[4] интерес: http://www.braintools.ru/article/4220

[5] лидерство: http://www.braintools.ru/article/1165

[6] ошибки: http://www.braintools.ru/article/4192

[7] математики: http://www.braintools.ru/article/7620

[8] Документация GLM-4.6: https://docs.z.ai/guides/llm/glm-4.6

[9] Репозиторий на Hugging Face: https://huggingface.co/zai-org/GLM-4.6

[10] API Zhipu AI: https://api.z.ai/

[11] Источник: https://habr.com/ru/articles/952338/?utm_source=habrahabr&utm_medium=rss&utm_campaign=952338

Нажмите здесь для печати.