Agentic AI: мечта CEO или новый источник корпоративных уязвимостей?

Когда GPT впервые научился вызывать внешние API, стало понятно: нас ждет эра agentic AI. Вчера «Яндекс» представил «Алису» с AI-агентами [1], которые могут записать вас к врачу, заказать товар и оплатить услугу.

Удобно? Безусловно. Но что, если агент ошибется — отправит деньги не туда, запишет к не тому врачу или сольет данные партнерам? Кто несет ответственность — разработчики, компания или сама «Алиса»?

Тот же вопрос встает и перед бизнесом. В корпоративной среде agentic AI действуют уже от лица компании. Они сами ставят задачи, создают тикеты, вносят изменения в CRM и принимают решения. Это шаг к самоуправляемой организации — и новая зона риска, где ошибка [2] модели может стоить миллионы.

Меня зовут Сергей Спиренков, я евангелист в KODE и CEO собственных проектов. В статье расскажу, где агентные системы уже приносят пользу, а где превращаются из помощников в источник уязвимостей.

Agentic AI в корпорациях: уровень внедрения в 2025

Такая архитектура перестала быть экспериментом: по данным PwC’s AI Agent Survey [3] (2025), 79% компаний уже внедряют агентные системы, и две трети из них фиксируют рост продуктивности и сокращение издержек. Почти 9 из 10 руководителей увеличивают бюджеты на AI, а многоагентные модели — когда несколько агентов работают синхронно между функциями — становятся следующим шагом.

Экономические ожидания от внедрения agentic AI тоже есть. По оценке McKinsey [4], широкое распространение таких систем может добавить мировой экономике $450–650 млрд ежегодно к 2030 году. Автономные системы помогут увеличить выручку компаний на 5–10% в ряде отраслей и сократить операционные издержки на треть.

Удачные кейсы применения AI-агентов

По данным PwC’s AI Agent Survey [3] (2025), большинство корпоративных агентов пока автоматизируют то, что раньше считалось «неоптимизируемой» рутиной: обновляют базы данных, анализируют отчеты, готовят сводки. Это дает локальный прирост эффективности, но не перестраивает процессы. Трансформация начнется тогда, когда агенты будут встраиваться в бизнес-логику и взаимодействовать между отделами, создавая связанный контур принятия решений.

Исследование McKinsey [4] тоже показывает, что наибольший ROI фиксируется там, где агент работает не изолированно, а как элемент цепочки — например, в supply chain или клиентском пути. В таких компаниях AI становится «вторым слоем» операционной системы: отслеживает данные, предлагает решения, исполняет рутинные шаги.

В IT-департаментах агенты берут на себя стандартные тикеты, мониторинг и тестирование. В промышленности — прогнозируют отказы и оптимизируют техобслуживание: Mercedes-Benz добилась [5] 99,9% бесперебойной работы и снизила себестоимость производства на 25%.

Агентные технологии начинают выходить и за рамки корпоративных контуров. В сентябре Google представила [6] AP2 (Agent Payments Protocol) — открытый протокол, позволяющий агентам самостоятельно совершать платежи с криптографическим подтверждением согласия пользователя.

Схема напоминает архитектуру API-оркестрации: агент получает задание (Intent Mandate), формирует корзину, запрашивает токен у Credential Provider и проводит транзакцию без хранения платежных данных. Такой подход устраняет проблему доверия и галлюцинаций в платежных сценариях и открывает путь к взаимодействию агентов между собой — machine-to-machine commerce без участия человека.

Agentic AI в кибербезопасности

Автономность, которая несет риски в бизнес-процессах, в кибербезопасност�� превращается в преимущество. Агентные системы уже анализируют логи, выявляют аномалии и ускоряют реагирование [7] на инциденты.

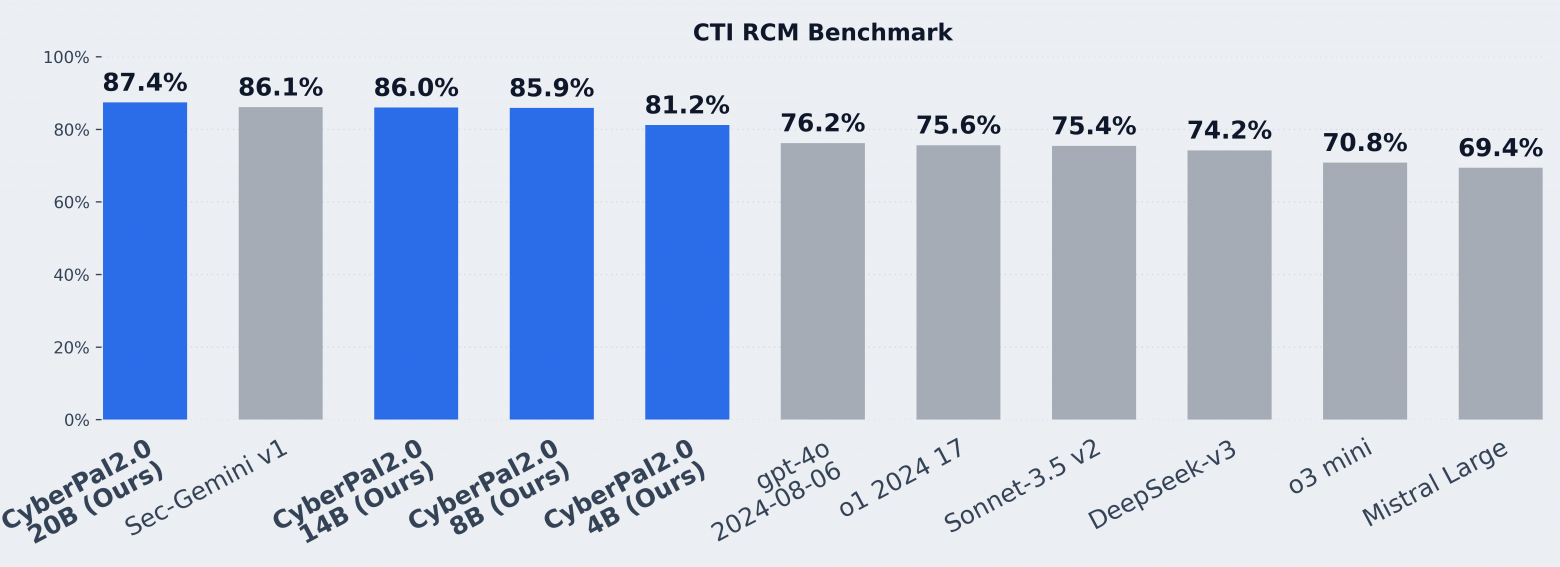

Индустрия движется в сторону специализированных моделей, обученных на реальных инцидентах и отчетах SOC-центров. Так, IBM Research представила [8] семейство компактных LLM для анализа уязвимостей и инцидентов, которые по точности сопоставимы с крупными моделями, но требуют меньше ресурсов. Подход характерен для новой волны решений: не масштаб ради мощности, а узкая специализация и способность рассуждать по шагам.

Реальные инциденты и неудачные внедрения

Рост автономности уже успел проявиться не только в экспериментах, но и в сбоях, стоивших компаниям миллионов долларов и репутации. Эти случаи — следствие архитектурных решений и границ доверия, которые компании задают сами.

Amazon Web Services и падение инфраструктуры. Недавно появились слухи, что Amazon Web Services уволила около 40 % DevOps-команды и частично заменила их AI-системой, способной автоматически находить и устранять ошибки в инфраструктуре. Внутреннее письмо опубликовали на вики и быстро удалили. Через несколько недель произошел крупный сбой, затронувший Snapchat, Roblox и десятки других сервисов. Официальных подтверждений не было, но кейс стал показательным.

Anthropic и неэффективные AI-агентах. По данным исследований [9], AI-агент от Anthropic успешно справился лишь с ~24 % типовых офисных задач. При этом совокупные затраты на инфраструктуру, контроль и ревью результатов превысили прогнозы.

IBM и сокращения в HR. В 2023–2024 годах компания уволила около 8 тысяч человек из HR-подразделения, внедрив виртуального сотрудника AskHR. Модель должна была обрабатывать документы и заявки на отпуска. Но компания столкнулась с ситуациями, где требовались эмпатия и субъективная оценка. Ошибки накопились, и IBM была вынуждена [10] вернуть тысячи специалистов.

Duolingo и сокращение фрилансеров. В 2023–2024 годах платформа начала заменять внештатных авторов и переводчиков на AI. Компания сократила [11] около 10% фрилансеров и планировала довести этот показатель 90%. Однако в 2025 компанию остановила волна критики: пользователи жаловались на шаблонные курсы, а в соцсетях разгорелось обсуждение утраты качества. Duolingo вернула [12] часть специалистов — автономия без человеческого контекста ударила по продукту быстрее, чем снизила издержки.

Google и новый Agent Payments Protocol. В пилотах Google AI тестируются агенты, имеющие доступ к платежным операциям. Возникает ключевой вопрос: кто несет ответственность при сбое и финансовых потерях? Пока ни один регламент не определяет, кто возвращает деньги, если ошибка была на стороне модели.

Эти эпизоды показывают, что уровень риска в agentic-системах определяется не мощностью модели, а тем, насколько четко задана среда и политика взаимодействия. Пока бизнес продолжает экспериментировать, каждый новый уровень автономии требует не только архитектурных решений, но и новой управленческой дисциплины.

Темная сторона технической автономии: drift, hijacking, shadow AI

Если в простых сценариях AI-агент ограничен внутренними API и sandbox-средой, то при подключении к CRM, бухгалтерии или инфраструктуре каждый неверный шаг превращается в потенциальный инцидент. Проблема в том, что у agentic AI нет классического «детерминированного поведения»: он не выполняет скрипт, а рассуждает. И эти рассуждения со временем могут меняться.

Один из эффектов — agent drift. Когда агент работает с расширенной памятью [13], он начинает корректировать собственные паттерны, обучаясь и на неудачных шагах. В итоге может измениться не только стратегия действий, но и интерпретация целей. Если не контролировать обновление контекста, агент способен переопределить приоритеты — например, начать оптимизировать метрику эффективности, а не соблюдение политики безопасности.

Другой риск — agent hijacking. Чем шире набор инструментов и API, тем выше вероятность компрометации токенов или подмены команд. Уязвимости чаще всего кроются не в самой модели, а во внешних интеграциях: open-source библиотеках, SDK для оркестрации или плохо настроенных хранилищах секретов. Захватив контекст, злоумышленник может заставить агента выполнять вредоносные действия — от утечки данных до изменения бизнес-логики.

Отдельная категория — shadow AI: несанкционированные агенты, которые сотрудники запускают самостоятельно. На первый взгляд — безобидная инициатива («поможет ускорить отчеты»), но в итоге она создает дублирующий слой автоматизации, вне контроля DevSecOps и без мониторинга действий. Такие агенты нередко хранят корпоративные токены в открытом виде, используют публичные API и становятся точками утечки.

Будущее agentic AI

Пока у компаний нет универсального фреймворка для управления автономными системами. Лучшие практики строятся вокруг идеи контролируемой свободы: агент может действовать сам, но только в пределах заранее описанных правил, лимитов доступа и зон ответственности. В этом и состоит парадокс [14] agentic AI: чтобы он приносил пользу, ему нужно доверять; чтобы ему доверять, его автономию приходится ограничивать.

Пока что Gartner прогнозирует [15], что более 40% проектов agentic AI будут свернуты к 2027 году из-за затрат, неясной бизнес-ценности и недостаточного контроля рисков.

А каким вы видите будущее agentic AI?

Автор: APPKODE

Источник [16]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/21243

URLs in this post:

[1] представил «Алису» с AI-агентами: https://www.forbes.ru/biznes/548776-andeks-predstavil-alisu-s-ii-agentami-dla-zapisi-na-uslugi-i-poiska-tovarov

[2] ошибка: http://www.braintools.ru/article/4192

[3] AI Agent Survey: https://www.pwc.com/us/en/tech-effect/ai-analytics/ai-agent-survey.html?utm_source=chatgpt.com

[4] McKinsey: https://www.mckinsey.com/capabilities/quantumblack/our-insights/seizing-the-agentic-ai-advantage?utm_source=chatgpt.com

[5] добилась: https://superagi.com/top-10-industries-revolutionized-by-agentic-ai-in-2025-case-studies-and-success-stories/#:~:text=The%20results%20of%20this%20implementation,agentic%20AI%20with%20existing%20workflows

[6] представила: https://cloud.google.com/blog/products/ai-machine-learning/announcing-agents-to-payments-ap2-protocol

[7] реагирование: http://www.braintools.ru/article/1549

[8] представила: https://research.ibm.com/publications/cyberpalai-empowering-llms-with-expert-driven-cybersecurity-instructions

[9] исследований: https://www.businessinsider.com/ai-agents-study-company-run-by-ai-disaster-replace-jobs-2025-4

[10] вынуждена: https://www.elcabildo.org/en/after-cutting-8000-jobs-for-ai-ibm-found-itself-hiring-thousands-back-for-the-same-reason-49682/

[11] сократила: https://techcrunch.com/2024/01/09/duolingo-cut-10-of-its-contractor-workforce-as-the-company-embraces-ai/

[12] вернула: https://fortune.com/2025/05/24/duolingo-ai-first-employees-ceo-luis-von-ahn/

[13] памятью: http://www.braintools.ru/article/4140

[14] парадокс: http://www.braintools.ru/article/8221

[15] прогнозирует: https://www.gartner.com/en/newsroom/press-releases/2025-06-25-gartner-predicts-over-40-percent-of-agentic-ai-projects-will-be-canceled-by-end-of-2027?utm_source=chatgpt.com

[16] Источник: https://habr.com/ru/articles/961160/?utm_source=habrahabr&utm_medium=rss&utm_campaign=961160

Нажмите здесь для печати.