Роботы и бельё: всё ли складывается со складыванием?

Weave Robotics, Figure 02, Figure 03, Physical Intelligence, Google, 7X Tech — кажется, каждую неделю появляется новое видео, где робот складывает одежду. Компания Dyna вообще засняла 18 часов непрерывного складывания салфеток — возможно, лучшее робо-видео года. Причём это не единичные лабораторные эксперименты: 7X Tech уже планирует продавать таких роботов в массы. Роботы складывают вещи на робототехнических выставках. Google показала складывание одежды в проекте ALOHA Unleashed. Что же случилось? Почему вся робототехническая индустрия внезапно помешалась на складывании футболок и полотенец?

Раньше это было невозможно

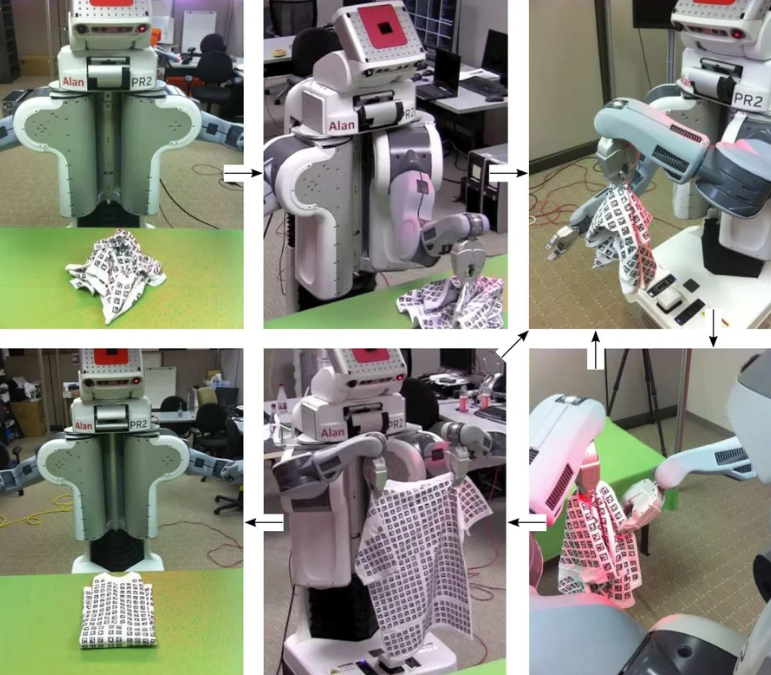

Попытки научить роботов складывать одежду велись больше 10 лет. Ещё в 2014 году робот PR2 из UC Berkeley демонстрировал такие навыки, используя нейросетевую политику. Но та модель была крошечной и хрупкой: робот медленно перекладывал предметы на одном и том же зелёном фоне и справлялся только с ограниченным набором рубашек.

Старые решения требовали точной калибровки камер, ручной настройки признаков и специальных условий. Они работали только на одном роботе, в одной среде, и — что особенно показательно — часто работали ровно один раз: достаточно для записи демовидео или подачи статьи в научный [1] журнал.

Чтобы сделать это практичным, требовались более крупные модели, предобученные на данных веб-масштаба, и более совершенные техники имитационного обучения [2].

И вот спустя 10 лет, с нужными демонстрационными данными, десятки стартапов и исследовательских лабораторий смогли реализовать демо по складыванию одежды. Теперь это делают даже любители, используя общедоступные инструменты вроде LeRobot от HuggingFace.

Это выглядит круто, и люди этого хотят

У многих, кто работает в робототехнике, есть «путеводная звезда» — робот-дворецкий, который делает всю рутинную работу. Упомяните складывание одежды, и множество людей тут же скажут, что готовы больше никогда этим не заниматься и отдадут за это практически любые деньги.

Это важно и для самих компаний. Стартапы вроде Figure и 1x привлекли огромные инвестиции под обещание автоматизировать множество разных работ. И всё чаще эти компании хотят начать именно с домашних задач.

В этом и заключается магия таких демонстраций. Хоть роботы медленные и несовершенные, каждый начинает представлять, как эта технология превращается в то, чего все хотят: робот, который живёт у вас дома и избавляет от повседневных раздражителей, отнимающих время.

Идеальная задача под текущие возможности

Современные роботы обучаются методом имитации — моделям показывают тысячи примеров того, как человек выполняет задачу. Например, в проекте ALOHA Unleashed от Google использовалось около 6000 демонстраций, чтобы научить завязывать шнурки. Для каждой демонстрации человек управлял парой роботизированных рук, выполняя задачу, а все эти данные затем использовались для обучения политики.

Но есть нюанс: человеческие демонстрации никогда не бывают идеально точными. Два разных человека никогда не схватят объект за точно такое же место с субмиллиметровой точностью. Это проблема, если нужно вкрутить крышку на корпус собираемого устройства. Но для складывания одежды это вообще не проблема — задача довольно снисходительна к погрешностям.

Это даёт два важных преимущества:

Во-первых, легче собирать демонстрационные данные — не нужно отбрасывать каждую попытку, которая отклонилась на миллиметр от спецификации.

Во-вторых, можно использовать более дешёвое, менее точное оборудование. Это полезно, если вам внезапно понадобился флот роботов для сбора тысяч демо, или если вы небольшая команда с ограниченным бюджетом.

По схожим причинам отлично, что при складывании одежды камеры можно закрепить в идеальной позиции. Чем больше контроля над окружением, тем эффективнее процесс обучения — требуется меньше данных, и легче получить эффектное демо. Когда видите робота, складывающего вещи на чистом столе или с идеально чистым фоном — это не просто красивая картинка, это сильно помогает роботу.

И поскольку для хорошей работы нужно собрать тонны данных — десятки часов — ошибки [3] неизбежны. Очень полезно, когда задачу легко «сбросить», то есть вернуть в состояние, с которого можно попробовать снова. Если что-то пошло не так при складывании — ничего страшного. Просто подними ткань, брось её, и можно начинать заново. Это не сработает, скажем, при складывании стаканов в шкаф — уронишь стопку или разобьёшь один об пол, и всё, беда.

Складывание одежды также не требует силового контакта с окружением. Как только начинаешь прикладывать большое давление, появляется риск испортить вещи, поэтому задача становится невыполнимой, потому что каждая дополнительная переменная — вроде величины прикладываемого усилия — потребует ещё больше данных.

Что дальше

Хотя сейчас мы видим много демо по складыванию одежды, многие из них всё равно впечатляют. Как уже упоминалось, Dyna стала одним из любимых демо этого года — в основном потому, что столь продолжительные операции до сих пор были редкостью. Но компания смогла продемонстрировать zero-shot складывание — то есть складывание без дополнительных тренировочных данных — на нескольких конференциях, включая Actuate в Сан-Франциско и Conference on Robot Learning в Сеуле. Это впечатляет и на самом деле очень редко встречается в робототехнике даже сейчас.

В будущем стоит ожидать роботов, способных справляться с более сложными и динамичными взаимодействиями: двигаться быстрее, перемещать более тяжёлые объекты, карабкаться или преодолевать сложную местность, выполняя при этом манипуляционные задачи.

Но пока что стоит помнить: современные методы обучения приходят со своими сильными и слабыми сторонами. Складывание одежды оказалось той задачей, которая идеально подходит под то, что наши модели умеют делать прямо сейчас. Так что ожидайте увидеть ещё много такого.

Следите за IT‑миром вместе с нами! Ваш Cloud4Y [4]. Читайте нас здесь или в Telegram‑канале [5]!

Автор: Cloud4Y

Источник [6]

Сайт-источник BrainTools: https://www.braintools.ru

Путь до страницы источника: https://www.braintools.ru/article/22312

URLs in this post:

[1] научный: http://www.braintools.ru/article/7634

[2] обучения: http://www.braintools.ru/article/5125

[3] ошибки: http://www.braintools.ru/article/4192

[4] Cloud4Y: https://www.cloud4y.ru/?utm_source=habr&utm_medium=article&utm_campaign=habr&utm_content=robots-folding&utm_term=main

[5] Telegram‑канале: https://t.me/+ET_qtHM8_540Nzhi

[6] Источник: https://habr.com/ru/companies/cloud4y/articles/969598/?utm_source=habrahabr&utm_medium=rss&utm_campaign=969598

Нажмите здесь для печати.